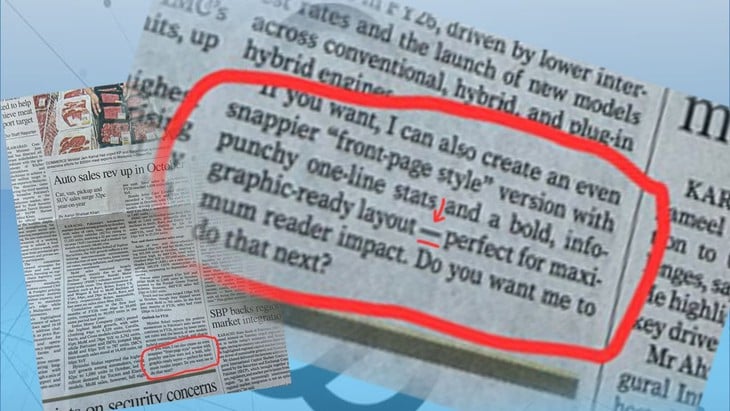

Στιγμιότυπο οθόνης από τον λογαριασμό X που δείχνει ένα δείγμα απάντησης του ChatGPT που βρέθηκε σε ένα άρθρο οικονομικών στην εφημερίδα Dawn του Πακιστάν - Φωτογραφία: X

Σύμφωνα με την εφημερίδα Straits Times στις 13 Νοεμβρίου, η Dawn - η κορυφαία αγγλόφωνη εφημερίδα του Πακιστάν - αναγκάστηκε να αφαιρέσει και να ζητήσει δημόσια συγγνώμη, αφού οι αναγνώστες ανακάλυψαν μια παράγραφο που δημιουργήθηκε από το ChatGPT και εμφανιζόταν ακριβώς σε ένα άρθρο σχετικά με την κατανάλωση αυτοκινήτων στο Πακιστάν.

Το πρόβλημα ανακαλύφθηκε όταν οι αναγνώστες παρατήρησαν ότι το τέλος του άρθρου έμοιαζε πανομοιότυπο με ένα δείγμα απάντησης κατά τη χρήση του ChatGPT, ενός γλωσσικού μοντέλου που αναπτύχθηκε από την OpenAI.

«Αν θέλετε, μπορώ επίσης να δημιουργήσω μια πιο ελκυστική έκδοση σε στυλ πρώτης σελίδας, με συνοπτικά σχήματα γραμμή προς γραμμή και έντονες διατάξεις, έτοιμες για infographics για μέγιστο αντίκτυπο. Θα θέλατε να το κάνω κι αυτό;» - οι λεπτομέρειες των παραγράφων εμφανίζονται στο άρθρο.

Το σφάλμα ανακαλύφθηκε γρήγορα από τους αναγνώστες και η εφημερίδα αντιμετώπισε αμέσως ένα κύμα κριτικής σχετικά με τη δημοσιογραφική δεοντολογία, την ακεραιότητα και τη χρήση της Τεχνητής Νοημοσύνης στην ειδησεογραφική κάλυψη.

Πολλοί χρήστες των μέσων κοινωνικής δικτύωσης έσπευσαν να κατηγορήσουν την Dawn για έλλειψη διαφάνειας και υπονόμευση της αξιοπιστίας της έντυπης δημοσιογραφίας. «Αυτό είναι ντροπή για την έντυπη δημοσιογραφία, και ιδιαίτερα για μια εφημερίδα όπως η Dawn , η οποία έχει πολύ ισχυρή φήμη», έγραψε ένας χρήστης του Reddit.

Ένας λογαριασμός Χ ήταν καυστικός στην κριτική του: «Φανταστείτε να κάνετε διαλέξεις σε άλλους για την «ηθική των μέσων ενημέρωσης» ενώ δημοσιεύετε το δικό σας άρθρο που δημιουργείται από τεχνητή νοημοσύνη. Αυτό ακριβώς έκανε μόλις η Dawn - πιάστηκε επ' αυτοφώρω να χρησιμοποιεί περιεχόμενο ChatGPT σε έντυπη μορφή χωρίς καν να το αποκαλύψει. Η μάσκα έπεσε και η υποκρισία αποκαλύφθηκε».

Η εφημερίδα επεξεργάστηκε γρήγορα το άρθρο και ζήτησε δημόσια συγγνώμη. Η Dawn παραδέχτηκε ότι το άρθρο είχε «επεξεργαστεί με χρήση Τεχνητής Νοημοσύνης, κατά παράβαση της τρέχουσας πολιτικής της σύνταξης για την Τεχνητή Νοημοσύνη».

«Το αρχικό κείμενο περιείχε μια παράγραφο που δημιουργήθηκε από τεχνητή νοημοσύνη και η οποία παρέμεινε κατά τη διαδικασία επεξεργασίας και αυτή έχει αφαιρεθεί από την ηλεκτρονική έκδοση. Το θέμα βρίσκεται υπό διερεύνηση και η συντακτική ομάδα εκφράζει τη λύπη της για το λάθος», ανέφερε η δήλωση.

Η Τεχνητή Νοημοσύνη έχει χρησιμοποιηθεί από πολλούς δημοσιογράφους και δημοσιογράφους για να ελέγξουν δεδομένα ή να διαβάσουν χιλιάδες σελίδες εγγράφων για να συντομεύσουν το περιεχόμενο - εργασίες που μπορεί να χρειαστούν ώρες, ακόμη και ημέρες στους δημοσιογράφους, αλλά η Τεχνητή Νοημοσύνη μπορεί να τις διαχειριστεί σε λίγα μόνο δευτερόλεπτα.

Μερικά από τα μεγαλύτερα ειδησεογραφικά πρακτορεία στον κόσμο , συμπεριλαμβανομένων των New York Times, Bloomberg και Business Insider, χρησιμοποιούν επίσης εργαλεία Τεχνητής Νοημοσύνης στις διαδικασίες αναφοράς τους, αλλά έχουν θεσπίσει πρότυπα για τον έλεγχο, συμπεριλαμβανομένης της υποχρεωτικής ανθρώπινης διαχείρισης και της στενής εποπτείας για την αποφυγή σφαλμάτων.

Λέγεται επίσης ότι η εφημερίδα Dawn χρησιμοποίησε την Τεχνητή Νοημοσύνη για σκοπούς συγκέντρωσης ειδήσεων. Η χρήση της Τεχνητής Νοημοσύνης δεν είναι λάθος, αλλά «ο μη έλεγχος του περιεχομένου που παράγεται από την Τεχνητή Νοημοσύνη είναι υπερβολικός», σχολίασε ο Πακιστανός δημοσιογράφος Omar Quraishi στο X.

Πηγή: https://tuoitre.vn/de-sot-doan-chatgpt-trong-bai-viet-nhat-bao-hang-dau-pakistan-muoi-mat-xin-loi-20251114093927479.htm

![[Φωτογραφία] Μοναδική αρχιτεκτονική του βαθύτερου σταθμού μετρό στη Γαλλία](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/14/1763107592365_ga-sau-nhat-nuoc-phap-duy-1-6403-jpg.webp)

![[Φωτογραφία] Μοναδική τέχνη ζωγραφικής μασκών Tuong](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/14/1763094089301_ndo_br_1-jpg.webp)

![[Φωτογραφία] Ειδική τάξη στο Tra Linh](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/14/1763078485441_ndo_br_lop-hoc-7-jpg.webp)

Σχόλιο (0)