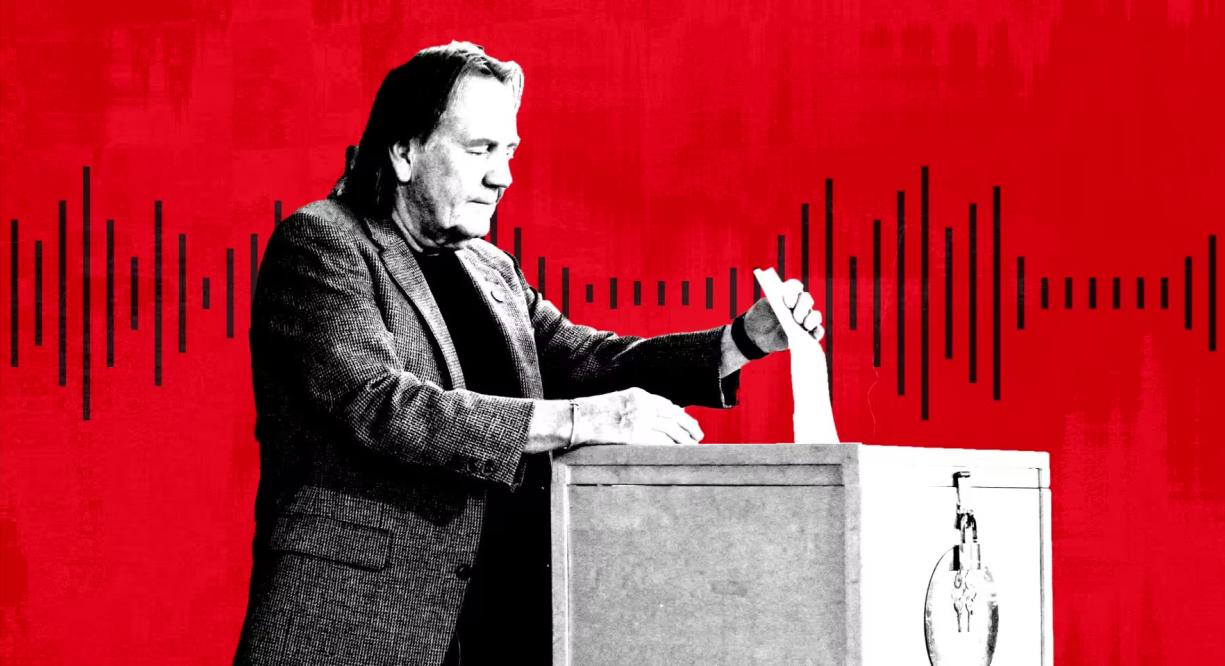

Το Γραφείο του Γενικού Εισαγγελέα του Νιου Χάμσαϊρ ανακοίνωσε τη Δευτέρα ότι διερευνά πιθανή χειραγώγηση των ψηφοφόρων μετά από καταγγελίες για ψεύτικη φωνή που ακουγόταν ακριβώς σαν τον πρόεδρο των ΗΠΑ Τζο Μπάιντεν να προτρέπει τους ψηφοφόρους να μην ψηφίσουν στις προκριματικές εκλογές της πολιτείας.

Οι ερευνητές προειδοποίησαν επίσης για τη χρήση deepfake ήχου για τη μίμηση πολιτικών και ηγετών, με εξέχουσες περιπτώσεις να σημειώνονται το 2023 στο Ηνωμένο Βασίλειο, την Ινδία, τη Νιγηρία, το Σουδάν, την Αιθιοπία και τη Σλοβακία.

Ένα άτομο ψηφίζει στις προκριματικές εκλογές στο Νιου Χάμσαϊρ των ΗΠΑ. Φωτογραφία: Getty

Ο deepfake ήχος έχει γίνει μια δημοφιλής μορφή παραπληροφόρησης λόγω της εμφάνισης μιας σειράς φθηνών και αποτελεσματικών εργαλείων τεχνητής νοημοσύνης από νεοσύστατες επιχειρήσεις, σύμφωνα με τους ειδικούς. Η Microsoft έχει επίσης αναπτύξει ένα νέο μοντέλο τεχνητής νοημοσύνης που μπορεί να αντιγράψει φωνές από μόλις τρία δευτερόλεπτα ηχογράφησης.

«Όσον αφορά την οπτική χειραγώγηση, όλοι είναι εξοικειωμένοι με το Photoshop ή τουλάχιστον γνωρίζουν την ύπαρξή του», δήλωσε ο Henry Ajder, ειδικός στην τεχνητή νοημοσύνη και το deepfake και σύμβουλος για την Adobe, την Meta και την EY. «Υπάρχει πολύ μικρή επίγνωση του πώς μπορεί να χειραγωγηθεί ο ήχος, οπότε για μένα αυτό μας αφήνει πραγματικά ευάλωτους».

Τον Σεπτέμβριο, το NewsGuard, ένα σύστημα που αξιολογεί την ποιότητα και την αξιοπιστία των ειδησεογραφικών ιστότοπων, ανακάλυψε ένα δίκτυο λογαριασμών TikTok που μεταμφιέζονταν σε νόμιμους ειδησεογραφικούς ιστότοπους, χρησιμοποιώντας περιεχόμενο που δημιουργείται από τεχνητή νοημοσύνη για τη διάδοση θεωριών συνωμοσίας και πολιτικής παραπληροφόρησης. Οι ηχογραφήσεις deepfake, συμπεριλαμβανομένης της φωνής του πρώην προέδρου των ΗΠΑ Μπαράκ Ομπάμα, συγκέντρωσαν εκατοντάδες εκατομμύρια προβολές.

Οι ψεύτικες ηχογραφήσεις φαίνεται να έχουν δημιουργηθεί από ένα εργαλείο που παρέχεται από την ElevenLabs, η οποία υποστηρίζεται από τον Andreessen Horowitz, ενώ τα κλιπ έχουν συγκεντρώσει εκατοντάδες εκατομμύρια προβολές, ανέφερε το NewsGuard.

«Πάνω από το 99% των χρηστών στην πλατφόρμα μας δημιουργούν ενδιαφέρον, δημιουργικό και χρήσιμο περιεχόμενο, αλλά αναγνωρίζουμε ότι υπάρχουν περιπτώσεις κακής χρήσης και έχουμε συνεχώς αναπτύξει και εισαγάγει μέτρα προστασίας για τον περιορισμό τους», δήλωσε η ElevenLabs.

Η ElevenLabs, η οποία ιδρύθηκε πριν από δύο χρόνια από τους πρώην υπαλλήλους της Google και της Palantir, Piotr Dabkowski και Mati Staniszewski, προσφέρει στοιχειώδη εργαλεία δημιουργίας ήχου με τεχνητή νοημοσύνη δωρεάν με ένα μόνο κλικ. Τα προγράμματα συνδρομής κυμαίνονται από 1 $ το μήνα έως 330 $ το μήνα και άνω για όσους αναζητούν πιο σύνθετες υπηρεσίες.

Πέρυσι, οι αμερικανικές υπηρεσίες πληροφοριών προειδοποίησαν σε μια έκθεση ότι «οι εξατομικευμένες απάτες με τεχνητή νοημοσύνη έχουν αυξηθεί σημαντικά λόγω της κυκλοφορίας εξελιγμένων και καλά εκπαιδευμένων μοντέλων κλωνοποίησης φωνής με τεχνητή νοημοσύνη».

Εκτός από τις απάτες με οικονομικά κίνητρα, οι πολιτικοί εμπειρογνώμονες κρούουν τώρα τον κώδωνα του κινδύνου για τα ιογενή ηχητικά αποσπάσματα deepfake, καθώς και για τη χρήση deepfake για αυτοματοποιημένες κλήσεις ή εκστρατείες. «Μπορείτε να δημιουργήσετε μια ισχυρή, εκτεταμένη εκστρατεία παραπληροφόρησης στοχεύοντας τηλέφωνα», δήλωσε ο AJ Nash, αντιπρόεδρος και διακεκριμένος συνεργάτης πληροφοριών στην ομάδα κυβερνοασφάλειας ZeroFox.

Ορισμένες από αυτές τις εταιρείες έχουν ενεργήσει προληπτικά στην εξεύρεση άλλων τρόπων για την καταπολέμηση της παραπληροφόρησης. Η Microsoft έχει εκδώσει μια δήλωση δεοντολογίας, προτρέποντας τους χρήστες να αναφέρουν οποιαδήποτε κακή χρήση του εργαλείου ήχου τεχνητής νοημοσύνης. Η ElevenLabs έχει κατασκευάσει τα δικά της εργαλεία ανίχνευσης για την αναγνώριση ηχογραφήσεων που δημιουργούνται από το σύστημά της.

Κατά τη διάρκεια των εκλογών της Νιγηρίας το 2023, ένα βίντεο που χειραγωγήθηκε από τεχνητή νοημοσύνη έγινε viral στα μέσα κοινωνικής δικτύωσης «υπονοώντας ότι ένας υποψήφιος της αντιπολίτευσης σχεδίαζε να νοθεύσει την ψηφοφορία», σύμφωνα με την ομάδα ανθρωπίνων δικαιωμάτων Freedom House.

Στη Σλοβακία, μια ψεύτικη ηχητική ηχογράφηση του υποψηφίου της αντιπολίτευσης Μίχαλ Σίμετσκα, ο οποίος φαινομενικά σχεδίαζε νοθεία στις εκλογές, έγινε viral λίγες μέρες πριν από τις προεδρικές εκλογές της χώρας τον Σεπτέμβριο.

«Το deepfake του Νιου Χάμσαϊρ αποτελεί υπενθύμιση των πολλών τρόπων με τους οποίους τα deepfake μπορούν να προκαλέσουν σύγχυση και να εξαπατήσουν», δήλωσε ο Ρόμπερτ Βάισμαν, πρόεδρος της μη κερδοσκοπικής ομάδας υπεράσπισης των καταναλωτών Public Citizen. «Η στιγμή του πολιτικού deepfake έχει φτάσει. Οι υπεύθυνοι χάραξης πολιτικής πρέπει να κινηθούν γρήγορα για να θέσουν σε εφαρμογή μέτρα ασφαλείας, διαφορετικά θα αντιμετωπίσουμε εκλογικό χάος».

Μάι Αν (σύμφωνα με τους FT)

[διαφήμιση_2]

Πηγή

![[Φωτογραφία] Ο Πρωθυπουργός Φαμ Μινχ Τσινχ παρευρίσκεται σε συνέδριο για την ανασκόπηση ενός έτους ανάπτυξης δυνάμεων για τη συμμετοχή στην προστασία της ασφάλειας και της τάξης σε επίπεδο βάσης.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/12/1762957553775_dsc-2379-jpg.webp)

![[Φωτογραφία] Αυτοκινητόδρομοι που διέρχονται από το Ντονγκ Νάι](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/12/1762940149627_ndo_br_1-resize-5756-jpg.webp)

![Μετάβαση στο Dong Nai OCOP: [Άρθρο 3] Σύνδεση του τουρισμού με την κατανάλωση προϊόντων OCOP](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/10/1762739199309_1324-2740-7_n-162543_981.jpeg)

Σχόλιο (0)