Nvidia ເຄີຍເປັນທີ່ຮູ້ຈັກວ່າເປັນຜູ້ຜະລິດຊິບທີ່ໃຊ້ໃນເກມວີດີໂອ, ແຕ່ໄດ້ປ່ຽນຈຸດສຸມຂອງຕົນໄປສູ່ຕະຫຼາດສູນຂໍ້ມູນໃນຊຸມປີມໍ່ໆມານີ້.

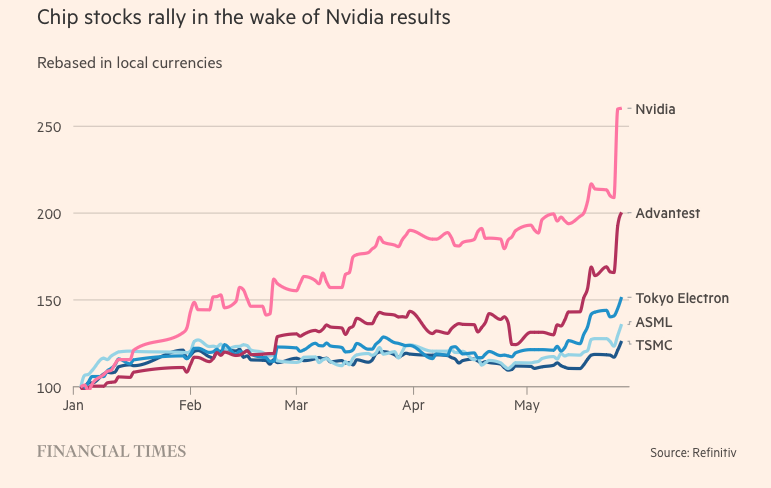

ບໍລິສັດຊິບສະຫະລັດໄດ້ມີຄວາມຈະເລີນຮຸ່ງເຮືອງໃນລະຫວ່າງການແຜ່ລະບາດ, ເນື່ອງຈາກຄວາມຕ້ອງການຂອງການຫຼິ້ນເກມແລະຄໍາຮ້ອງສະຫມັກຟັງໄດ້ເພີ່ມຂຶ້ນແລະຄວາມຢາກຂຸດຄົ້ນ cryptocurrency ໄດ້ແຜ່ລາມໄປທົ່ວ ໂລກ . ໃນຕອນທ້າຍຂອງປີງົບປະມານທີ່ສິ້ນສຸດໃນວັນທີ 29 ມັງກອນ, ທຸລະກິດຊິບສູນຂໍ້ມູນໄດ້ກວມເອົາຫຼາຍກວ່າ 50% ຂອງລາຍໄດ້ຂອງບໍລິສັດ.

ໃນຂະນະດຽວກັນ, chatbot ທີ່ນິຍົມ ChatGPT ໄດ້ເອົາປັນຍາປະດິດ (AI) ໄປສູ່ລະດັບຕໍ່ໄປໃນປີນີ້, ການນໍາໃຊ້ຂໍ້ມູນຈໍານວນຫລາຍທີ່ມີຢູ່ເພື່ອສ້າງເນື້ອຫາໃຫມ່ໃນຫົວຂໍ້ຕ່າງໆຕັ້ງແຕ່ບົດກະວີຈົນເຖິງການຂຽນໂປຼແກຼມຄອມພິວເຕີ.

Microsoft ແລະ Alphabet, ສອງບໍລິສັດເຕັກໂນໂລຢີຍັກໃຫຍ່, ຍັງເປັນຜູ້ນໃຫຍ່ໃນຊ່ອງ AI, ເຊື່ອວ່າເຕັກໂນໂລຢີການຜະລິດສາມາດປ່ຽນແປງວິທີການເຮັດວຽກຂອງຄົນ. ທັງສອງໄດ້ເປີດຕົວການແຂ່ງຂັນເພື່ອປະສົມປະສານ AI ເຂົ້າໃນເຄື່ອງຈັກຊອກຫາເຊັ່ນດຽວກັນກັບຊອບແວຫ້ອງການທີ່ມີຄວາມທະເຍີທະຍານທີ່ຈະຄອບຄອງອຸດສາຫະກໍານີ້.

Goldman Sachs ຄາດຄະເນວ່າການລົງທຶນຂອງສະຫະລັດໃນ AI ອາດຈະປະມານ 1% ຂອງຜົນຜະລິດ ເສດຖະກິດ ຂອງປະເທດໃນປີ 2030.

ຊຸບເປີຄອມພີວເຕີທີ່ໃຊ້ໃນການປະມວນຜົນຂໍ້ມູນ ແລະແລ່ນ AI ທົ່ວໄປແມ່ນອີງໃສ່ຫົວໜ່ວຍປະມວນຜົນກຣາຟິກ (GPUs). GPUs ຖືກອອກແບບມາເພື່ອຈັດການກັບການຄິດໄລ່ສະເພາະທີ່ກ່ຽວຂ້ອງກັບຄອມພິວເຕີ້ AI, ມີປະສິດທິພາບຫຼາຍກ່ວາຫນ່ວຍປະມວນຜົນກາງຈາກຜູ້ຜະລິດຊິບອື່ນເຊັ່ນ Intel. ຕົວຢ່າງ, ChatGPT ຂອງ OpenAI ແມ່ນຂັບເຄື່ອນໂດຍ Nvidia GPUs ຫຼາຍພັນຄົນ.

ໃນຂະນະດຽວກັນ, Nvidia ມີປະມານ 80% ຂອງສ່ວນແບ່ງຕະຫຼາດ GPU. ຄູ່ແຂ່ງຕົ້ນຕໍຂອງ Nvidia ລວມມີ Advanced Micro Devices ແລະຊິບ AI ພາຍໃນຈາກບໍລິສັດເຕັກໂນໂລຢີເຊັ່ນ Amazon, Google ແລະ Meta Platforms.

ຄວາມລັບຂອງການ sublimation

ການກ້າວກະໂດດຂອງບໍລິສັດແມ່ນເປັນໄປໄດ້ໂດຍ H100, ຊິບທີ່ອີງໃສ່ສະຖາປັດຕະຍະກໍາໃຫມ່ຂອງ Nvidia ທີ່ເອີ້ນວ່າ "Hopper" - ຕັ້ງຊື່ຕາມຜູ້ບຸກເບີກໂຄງການອາເມລິກາ Grace Hopper. ການລະເບີດຂອງປັນຍາປະດິດໄດ້ເຮັດໃຫ້ H100 ເປັນສິນຄ້າທີ່ຮ້ອນທີ່ສຸດໃນ Silicon Valley.

ຊິບຂະໜາດໃຫຍ່ທີ່ໃຊ້ໃນສູນຂໍ້ມູນມີ 80 ພັນລ້ານ transistor, ຫ້າເທົ່າຂອງຊິລິໂຄນທີ່ໃຊ້ພະລັງງານ iPhone ລຸ້ນຫຼ້າສຸດ. ເຖິງແມ່ນວ່າພວກເຂົາມີລາຄາຖືກກວ່າສອງເທົ່າຂອງລຸ້ນກ່ອນ, A100 (ປ່ອຍອອກມາໃນປີ 2020), ຜູ້ໃຊ້ H100 ເວົ້າວ່າພວກເຂົາສະເຫນີສາມເທົ່າຂອງການປະຕິບັດ.

H100 ໄດ້ພິສູດວ່າເປັນທີ່ນິຍົມໂດຍສະເພາະກັບບໍລິສັດ "Big Tech" ເຊັ່ນ Microsoft ແລະ Amazon, ເຊິ່ງກໍາລັງສ້າງສູນຂໍ້ມູນທັງຫມົດສຸມໃສ່ການເຮັດວຽກຂອງ AI, ແລະການເລີ່ມຕົ້ນຂອງ AI ຮຸ່ນໃຫມ່ເຊັ່ນ OpenAI, Anthropic, Stability AI, ແລະ Inflection AI, ຍ້ອນວ່າມັນຫມັ້ນສັນຍາປະສິດທິພາບທີ່ສູງຂຶ້ນທີ່ສາມາດເລັ່ງການເປີດຕົວຜະລິດຕະພັນຫຼືຫຼຸດຜ່ອນຄ່າໃຊ້ຈ່າຍໃນການຝຶກອົບຮົມໃນໄລຍະເວລາ.

Brannin McBee, ຫົວຫນ້າຍຸດທະສາດແລະຜູ້ກໍ່ຕັ້ງຂອງ CoreWeave, ບໍລິສັດ AI-based cloud startup, ກ່າວວ່າ "ນີ້ແມ່ນຫນຶ່ງໃນຊັບພະຍາກອນດ້ານວິສະວະກໍາທີ່ຫາຍາກທີ່ສຸດ," .

ລູກຄ້າອື່ນໆບໍ່ໂຊກດີຄືກັບ CoreWeave, ຕ້ອງລໍຖ້າເຖິງຫົກເດືອນເພື່ອໃຫ້ຜະລິດຕະພັນການຝຶກອົບຮົມແບບຈໍາລອງຂໍ້ມູນຂະຫນາດໃຫຍ່ຂອງພວກເຂົາ. ຜູ້ເລີ່ມຕົ້ນ AI ຫຼາຍຄົນກັງວົນວ່າ Nvidia ຈະບໍ່ສາມາດຕອບສະຫນອງຄວາມຕ້ອງການຂອງຕະຫຼາດ.

Elon Musk ຍັງໄດ້ສັ່ງຊື້ຊິບ Nvidia ຫລາຍພັນຊິບສໍາລັບການເລີ່ມຕົ້ນ AI ຂອງລາວ, ໂດຍກ່າວວ່າ "GPUs ແມ່ນຍາກກວ່າທີ່ຈະມາໂດຍຢາເສບຕິດໃນປັດຈຸບັນ."

"ຄ່າໃຊ້ຈ່າຍໃນຄອມພິວເຕີ້ໄດ້ເພີ່ມຂຶ້ນສູງ. ຈໍານວນເງິນຂັ້ນຕ່ໍາທີ່ໃຊ້ໃນຮາດແວເຊີຟເວີທີ່ໃຊ້ໃນການສ້າງ AI ສ້າງສັນໄດ້ບັນລຸເຖິງ 250 ລ້ານໂດລາ," CEO Tesla ແບ່ງປັນ.

ໃນຂະນະທີ່ H100 ແມ່ນທັນເວລາ, ການພັດທະນາ AI ຂອງ Nvidia ມີມາເຖິງສອງທົດສະວັດເພື່ອປະດິດສ້າງຊອບແວແທນທີ່ຈະເປັນຮາດແວ. ໃນປີ 2006, ບໍລິສັດໄດ້ນໍາສະເຫນີຊອບແວ Cuda, ເຊິ່ງອະນຸຍາດໃຫ້ GPUs ຖືກນໍາໃຊ້ເປັນຕົວເລັ່ງສໍາລັບວຽກງານນອກເຫນືອຈາກກາຟິກ.

Nathan Benaich, ຄູ່ຮ່ວມງານຂອງ Air Street Capital ແລະນັກລົງທຶນໃນບໍລິສັດ AI startups ກ່າວວ່າ "Nvidia ໄດ້ເຫັນອະນາຄົດກ່ອນຄົນອື່ນແລະຫັນໄປສູ່ GPUs ທີ່ມີໂປຼແກຼມ.

(ຕາມ Reuters, FT)

ທີ່ມາ

![[ຮູບພາບ] ທາງຫຼວງຜ່ານດົງນາຍ](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/12/1762940149627_ndo_br_1-resize-5756-jpg.webp)

![ການຫັນປ່ຽນ OCOP ດົງນາຍ: [ມາດຕາ 3] ເຊື່ອມໂຍງການທ່ອງທ່ຽວກັບການບໍລິໂພກຜະລິດຕະພັນ OCOP](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/10/1762739199309_1324-2740-7_n-162543_981.jpeg)

(0)