Momenteel heeft Australië geen specifieke wetgeving over AI, hoewel de Australische overheid vorig jaar aangaf dat zij vrijwillige richtlijnen zou invoeren vanwege zorgen over privacy, veiligheid en transparantie.

De Australische overheid gaf in haar Nationale AI-plan , dat dinsdag (2 december) werd gepubliceerd, aan dat de nadruk ligt op het aantrekken van investeringen in geavanceerde datacenters, het ontwikkelen van AI-vaardigheden om banen te ondersteunen en te beschermen en het waarborgen van de openbare veiligheid, nu AI steeds meer in het dagelijks leven wordt geïntegreerd.

"De aanpak van de overheid ten aanzien van AI-regulering zal voortbouwen op de bestaande sterke juridische en regelgevende kaders van Australië, en ervoor zorgen dat de gevestigde wetgeving de basis blijft voor het aanpakken en beperken van de risico's die verband houden met AI", aldus het plan.

Daarom blijven instanties en toezichthouders verantwoordelijk voor het identificeren en beheersen van potentiële gevaren die verband houden met AI op hun vakgebied.

Het stappenplan is opgesteld nadat de Australische overheid vorige maand aankondigde dat zij uiterlijk in 2026 een AI Safety Institute wil oprichten. Dit instituut moet autoriteiten helpen bij het monitoren van nieuwe risico's en het reageren op bedreigingen.

Wereldwijde toezichthouders maken zich steeds meer zorgen over misinformatie met betrekking tot generatieve AI-tools zoals ChatGPT van OpenAI en Gemini van Google, nu deze steeds breder worden gebruikt.

Tim Ayres, federaal minister van Industrie, zei dat het AI-stappenplan ervoor moet zorgen dat Australiërs kunnen profiteren van nieuwe technologie en tegelijkertijd een evenwicht tussen innovatie en risicobeheer in stand houdt.

"Naarmate de technologie zich blijft ontwikkelen, zullen we dit plan blijven verfijnen en versterken om nieuwe kansen te grijpen en daadkrachtig op te treden om de veiligheid van Australiërs te waarborgen", aldus de heer Ayres.

Bron: https://congluan.vn/uc-cong-bo-lo-trinh-phat-trien-ai-quoc-gia-10320083.html

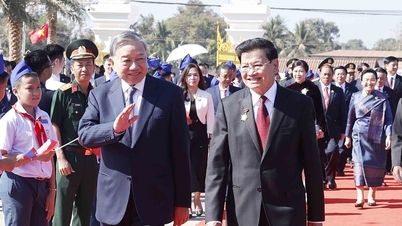

![[Foto] Parade ter viering van de 50e verjaardag van de nationale feestdag van Laos](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764691918289_ndo_br_0-jpg.webp&w=3840&q=75)

![[Foto] Aanbidding van het Tuyet Son-beeld - een bijna 400 jaar oude schat in de Keo-pagode](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764679323086_ndo_br_tempimageomw0hi-4884-jpg.webp&w=3840&q=75)

Reactie (0)