Kunstig intelligens hjelper folk med å skrive e-poster, anbefale filmer, analysere data og bistå i å diagnostisere sykdommer ...

Men etter hvert som AI blir smartere, øker også følelsen av usikkerhet den medfører. En del av det skyldes at vi ikke fullt ut forstår teknologien vi bruker. Resten stammer fra våre egne psykologiske instinkter.

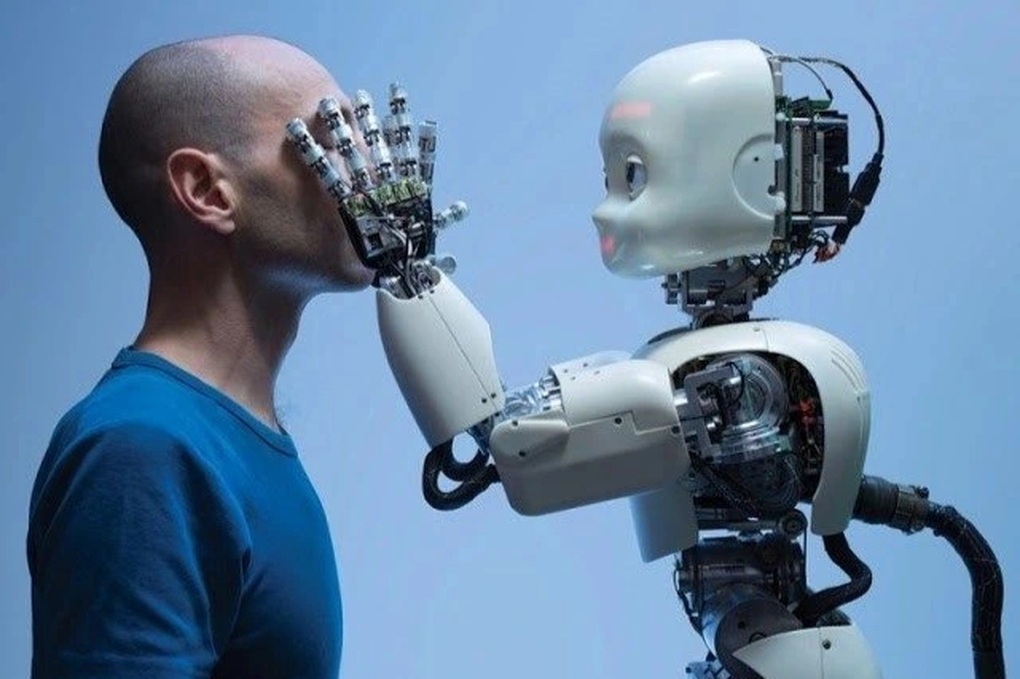

AI utvikler seg raskere enn menneskelig psykologisk tilpasningsevne (Illustrasjonsfoto).

Når AI blir en «svart boks» og brukerne mister kontrollen

Folk har en tendens til å stole på det de forstår og kontrollerer. Når du trykker på en knapp, beveger heisen seg. Når du slår på en bryter, slår lyset seg på. Tydelige svar skaper en følelse av trygghet.

I motsetning til dette fungerer mange AI-systemer som en lukket boks. Du legger inn data, men måten de produserer resultater på er skjult. Det gjør det umulig for brukere å forstå eller spørre.

Den følelsen av ugjennomsiktighet er urovekkende. Brukere trenger ikke bare et verktøy som fungerer, men også hvorfor det fungerer.

Hvis AI ikke klarer å gi en forklaring, begynner folk å stille spørsmål ved den. Dette fører til et konsept som kalles «algoritmeaversjon», som atferdsforskere beskriver som et fenomen der folk har en tendens til å velge andres avgjørelser, selv om de tar feil, i stedet for å stole på en maskins dømmekraft.

Mange er skeptiske til at AI blir for nøyaktig. En innholdsanbefalingsmotor kan være irriterende hvis den leser dem for godt. Følelsen av å bli overvåket eller manipulert begynner å dukke opp, selv om systemet i seg selv ikke har noen følelser eller intensjoner.

Denne reaksjonen stammer fra en instinktiv atferd: antropomorfisme. Selv om vi vet at KI ikke er menneskelig, reagerer vi fortsatt på den som om vi kommuniserer med et individ. Når KI er for høflig eller for kald, føler brukerne seg rare og mistroiske.

Mennesker tilgir mennesker, men ikke maskiner.

Et interessant paradoks er at når mennesker gjør feil, kan vi være empatiske og aksepterende. Men når feilen kommer fra AI, spesielt når den markedsføres som objektiv og datadrevet, føler brukerne seg ofte forrådt.

Dette er relatert til fenomenet forventningsbrudd. Vi forventer at maskiner skal være logiske, nøyaktige og ufeilbarlige. Når denne tilliten brytes, er den psykologiske reaksjonen ofte mer intens. Selv en liten feil i en algoritme kan oppfattes som alvorlig hvis brukeren føler seg ute av kontroll eller uforklarlig.

Vi trenger instinktivt å forstå årsaken til en feil. Med mennesker spør vi kanskje hvorfor. Med AI er svaret ofte ikke-eksisterende eller for vagt.

Når lærere, forfattere, advokater eller designere ser at kunstig intelligens gjør deler av jobben deres, frykter de ikke bare å miste jobben, men bekymrer seg også for verdien av ferdighetene og den personlige identiteten deres.

Dette er en naturlig reaksjon, kalt identitetstrussel. Det kan føre til fornektelse, motstand eller psykologisk forsvar. I disse tilfellene er mistanke ikke lenger en emosjonell reaksjon, men en selvbeskyttelsesmekanisme.

Tillit kommer ikke bare fra logikk.

Mennesker stoler på hverandre gjennom følelser, gester, øyekontakt og empati. AI kan være veltalende, til og med humoristisk, men den vet ikke hvordan den skal skape en ekte forbindelse.

Fenomenet «uncanny valley» beskrives av eksperter som den ubehagelige følelsen av å bli konfrontert med ting som nesten er menneskelige, men som mangler noe som gjør dem uvirkelige.

Når maskiner blir for menneskelige, blir følelsen av usikkerhet enda tydeligere (Foto: Getty).

Med AI er det fraværet av følelser som gjør at mange føler seg desorienterte, usikre på om de skal stole på eller tvile.

I en verden fylt med falske nyheter, falske videoer og algoritmiske beslutninger, gjør følelser av emosjonell forlatelse folk skeptiske til teknologi. Ikke fordi AI gjør noe galt, men fordi vi ikke vet hvordan vi skal føle om det.

Dessuten er mistenksomhet noen ganger mer enn bare en følelse. Algoritmer har allerede skapt skjevheter i ansettelser, strafferettslige vurderinger og kredittgodkjenninger. For de som har blitt skadet av ugjennomsiktige datasystemer, er det fornuftig å være forsiktige.

Psykologer kaller dette lært mistillit. Når et system gjentatte ganger svikter, er det forståelig at tilliten vil gå tapt. Folk vil ikke stole bare fordi de blir bedt om det. Tillit må fortjenes, ikke påtvinges.

Hvis AI skal bli bredt tatt i bruk, må utviklere lage systemer som kan forstås, stilles spørsmål ved og holdes ansvarlige. Brukere må involveres i beslutningstaking, i stedet for bare å observere fra sidelinjen. Tillit kan bare opprettholdes virkelig når folk føler seg respektert og myndiggjort.

Kilde: https://dantri.com.vn/cong-nghe/vi-sao-tri-tue-nhan-tao-cham-vao-noi-so-sau-nhat-cua-con-nguoi-20251110120843170.htm

![[Foto] Statsminister Pham Minh Chinh mottar Laos' arbeids- og velferdsminister Phosay Sayasone](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/11/1762872028311_dsc-2246-jpg.webp)

![Overgang til Dong Nai OCOP: [Artikkel 3] Kobling av turisme med forbruk av OCOP-produkter](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/10/1762739199309_1324-2740-7_n-162543_981.jpeg)

Kommentar (0)