В настоящее время в Австралии нет специальных законов об ИИ, хотя в прошлом году правительство Австралии дало понять, что введет добровольные руководящие принципы в связи с опасениями по поводу конфиденциальности, безопасности и прозрачности.

В своем Национальном плане по ИИ, опубликованном во вторник (2 декабря), правительство Австралии заявило, что сосредоточится на привлечении инвестиций в передовые центры обработки данных, развитии навыков в области ИИ для поддержки и сохранения рабочих мест, а также обеспечении общественной безопасности, поскольку ИИ все больше интегрируется в повседневную жизнь.

«Подход правительства к регулированию ИИ будет по-прежнему основываться на прочной правовой и нормативной базе Австралии, гарантируя, что действующее законодательство останется основой для устранения и снижения рисков, связанных с ИИ», — говорится в плане.

Соответственно, агентства и регулирующие органы продолжат нести ответственность за выявление и управление потенциальным вредом, связанным с ИИ в их областях.

Дорожная карта появилась после того, как в прошлом месяце правительство Австралии заявило, что к 2026 году создаст Институт безопасности ИИ, который будет помогать властям отслеживать возникающие риски и реагировать на угрозы.

Глобальные регулирующие органы все чаще выражают обеспокоенность по поводу дезинформации, связанной с инструментами генеративного ИИ, такими как ChatGPT от OpenAI и Gemini от Google, поскольку их использование становится все более распространенным.

Федеральный министр промышленности Тим Айрес заявил, что дорожная карта в области ИИ направлена на то, чтобы австралийцы могли извлекать выгоду из новых технологий, сохраняя при этом баланс между инновациями и управлением рисками.

«Поскольку технологии продолжают развиваться, мы продолжим совершенствовать и укреплять этот план, чтобы использовать новые возможности и действовать решительно для обеспечения безопасности австралийцев», — сказал г-н Айрес.

Источник: https://congluan.vn/uc-cong-bo-lo-trinh-phat-trien-ai-quoc-gia-10320083.html

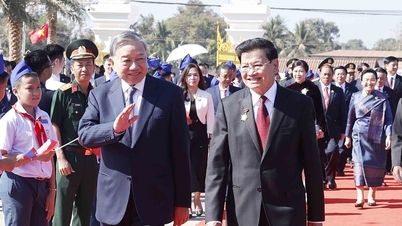

![[Фото] Парад в честь 50-летия Национального дня Лаоса](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764691918289_ndo_br_0-jpg.webp&w=3840&q=75)

![[Фото] Поклонение статуе Тует Сон — почти 400-летнему сокровищу в пагоде Кео](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764679323086_ndo_br_tempimageomw0hi-4884-jpg.webp&w=3840&q=75)

Комментарий (0)