Teknikjätten är under ökande press i USA och Europa på grund av anklagelser om att dess appar är beroendeframkallande och orsakar psykiska problem bland unga.

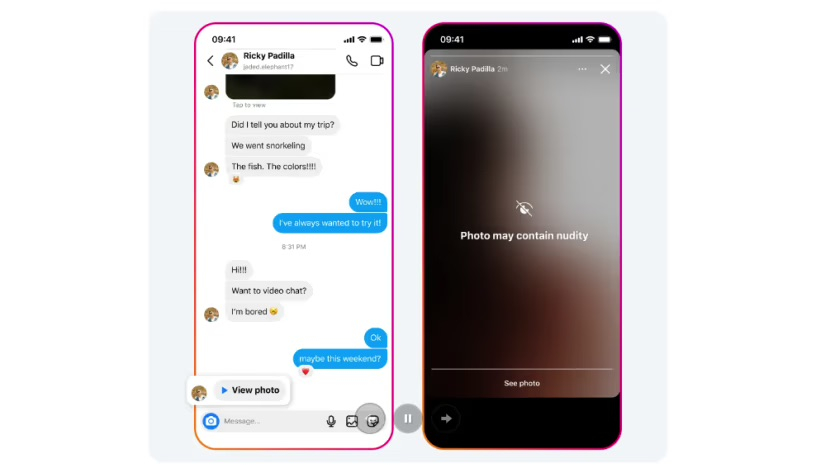

När någon får ett Instagram-meddelande som innehåller ett nakenfoto, suddas bilden automatiskt ut under varningsskärmen. Foto: Meta

Instagrams funktion för direktmeddelandeskydd kommer att använda maskininlärning på enheten för att analysera om bilder som skickas via tjänsten innehåller nakenhet, sa Meta.

Den här funktionen kommer att vara aktiverad som standard för användare under 18 år, och Meta kommer att meddela vuxna för att uppmuntra dem att aktivera den.

"Eftersom bilderna analyseras på själva enheten kommer nakenhetsskyddet även att fungera i end-to-end-krypterade chattar, där Meta inte kommer att ha tillgång till dessa bilder – såvida inte någon väljer att rapportera dem till oss", sa företaget.

Till skillnad från Metas Messenger- och WhatsApp-appar är Instagrams direktmeddelanden inte krypterade, men företaget säger att de planerar att lansera kryptering för fotodelningstjänsten.

Meta sa också att de utvecklar teknik för att identifiera konton som kan vara inblandade i sextortionbedrägerier, och att de testar att möjliggöra nya aviseringar för användare som kan ha interagerat med dessa konton.

I januari meddelade Meta att de skulle dölja mer innehåll från tonåringar på Facebook och Instagram, och tillade att detta skulle göra det svårare för unga att få tillgång till känsligt innehåll som självmord, självskadebeteende och ätstörningar.

Trettiotre amerikanska delstater, inklusive Kalifornien och New York, stämde Meta i oktober 2023 och hävdade att teknikföretaget upprepade gånger ljög för allmänheten om farorna med sin plattform. Europeiska kommissionen har också beordrat Meta att skydda barn från olagligt och skadligt innehåll.

Mai Anh (enligt CNA)

[annons_2]

Källa

![[Foto] Premiärminister Pham Minh Chinh leder det andra mötet i styrkommittén för privat ekonomisk utveckling.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/01/1762006716873_dsc-9145-jpg.webp)

Kommentar (0)