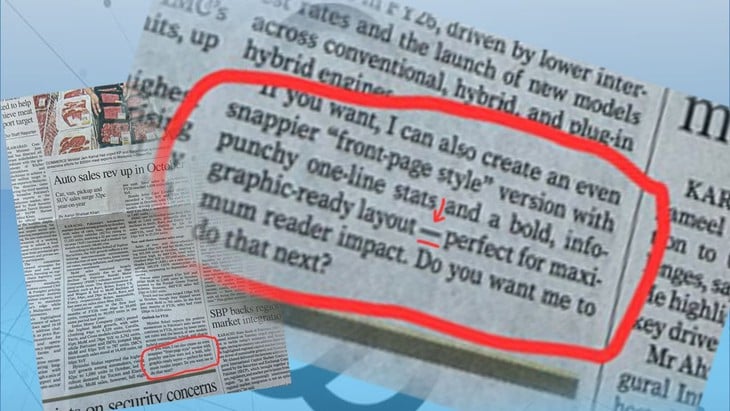

Знімок екрана з облікового запису X, на якому показано зразок відповіді ChatGPT, знайдений у статті з економіки в пакистанській газеті Dawn – Фото: X

Згідно з повідомленням Straits Times від 13 листопада, Dawn — провідна англомовна газета Пакистану — була змушена видалити статтю та публічно вибачитися після того, як читачі виявили абзац, створений ChatGPT, прямо у статті про споживання автомобілів у Пакистані.

Проблему було виявлено, коли читачі помітили, що кінець статті виглядав ідентично зразку відповіді під час використання ChatGPT, мовної моделі, розробленої OpenAI.

«Якщо хочете, я також можу створити більш привабливу версію «в стилі першої сторінки» з лаконічними порядковими рисунками та жирним шрифтом, готову до інфографіки для максимального ефекту. Хочете, щоб я теж це зробив?» – деталі абзацу з’являються у статті.

Читачі швидко виявили помилку, і газета одразу зіткнулася з хвилею критики, пов'язаної з журналістською етикою, чесністю та використанням штучного інтелекту в новинних репортажах.

Багато користувачів соціальних мереж поспішили звинуватити Dawn у відсутності прозорості та підриві довіри до друкованої журналістики. «Це ганьба для друкованої журналістики, а особливо для такого видання, як Dawn , яке має дуже сильну репутацію», – написав один із користувачів Reddit.

Один обліковий запис X висловив різку критику: «Уявіть, що ви читаєте іншим лекції про «медіаетику», водночас публікуєте власну статтю, створену штучним інтелектом. Саме це щойно й зробила Dawn – її спіймали на гарячому, використовуючи контент ChatGPT у друкованому вигляді, навіть не розкриваючи його. Маска впала, і лицемірство викрилося».

Газета швидко відредагувала статтю та публічно вибачилася. Дон визнала, що статтю було «відредаговано за допомогою штучного інтелекту, що порушує чинну політику редакції щодо штучного інтелекту».

«Оригінальний текст містив абзац, згенерований штучним інтелектом, який залишився під час процесу редагування, і його було видалено з онлайн-версії. Це питання розслідується, і редакційна команда шкодує про помилку», – йдеться у заяві.

Штучний інтелект використовувався багатьма журналістами та репортерами для перевірки даних або читання тисяч сторінок документів для скорочення контенту – завдання, які можуть займати у репортерів години, навіть дні, але з якими ШІ може впоратися лише за кілька секунд.

Деякі з найбільших новинних служб світу , включаючи New York Times, Bloomberg та Business Insider, також використовують інструменти штучного інтелекту у своїх процесах репортажів, але вони встановили стандарти модерації, включаючи обов'язкову модерацію людиною та ретельний нагляд, щоб уникнути помилок.

Газета Dawn також, як повідомляється, використовувала штучний інтелект для агрегації новин. Використання штучного інтелекту не є неправильним, але «не перевіряти контент, згенерований штучним інтелектом, є надмірним», – прокоментував X пакистанський журналіст Омар Курайші.

Джерело: https://tuoitre.vn/de-sot-doan-chatgpt-trong-bai-viet-nhat-bao-hang-dau-pakistan-muoi-mat-xin-loi-20251114093927479.htm

![[Фото] Унікальна архітектура найглибшої станції метро у Франції](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/14/1763107592365_ga-sau-nhat-nuoc-phap-duy-1-6403-jpg.webp)

![[Фото] Унікальне мистецтво розпису масок Туонг](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/14/1763094089301_ndo_br_1-jpg.webp)

![[Фото] Спеціальний клас у Тра Лінь](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/14/1763078485441_ndo_br_lop-hoc-7-jpg.webp)

Коментар (0)