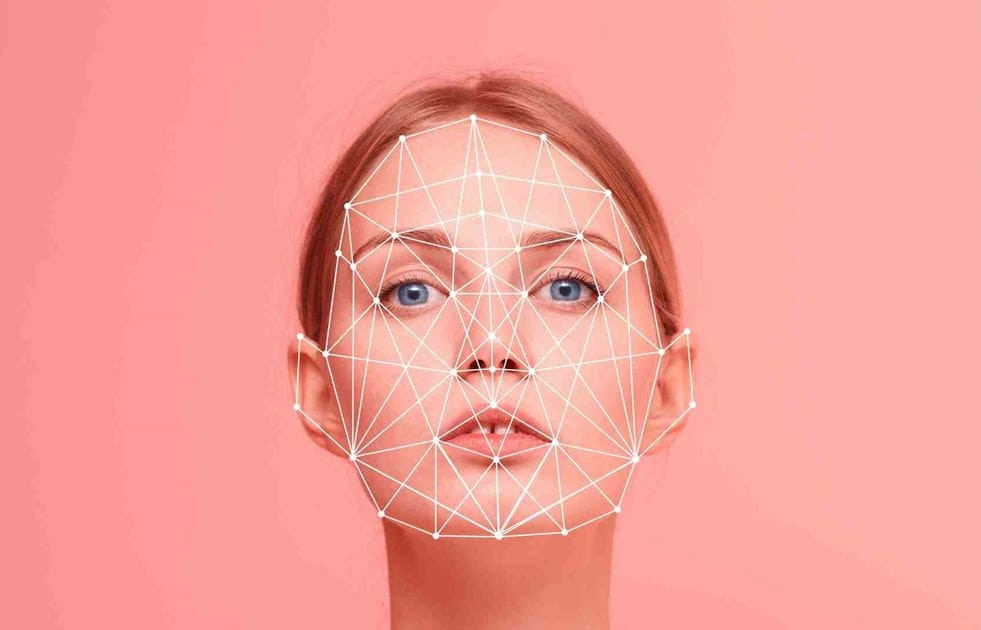

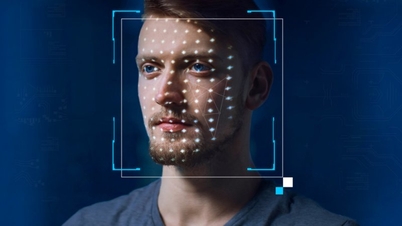

ڈیپ فیک ایک اصطلاح ہے جو 'ڈیپ لرننگ' اور 'فیک' کو ملا کر بنائی گئی ہے۔ سیدھے الفاظ میں، یہ نقلی آڈیو، تصویر یا حتیٰ کہ ویڈیو پروڈکٹس کو نقل کرنے اور تخلیق کرنے کی ٹیکنالوجی ہے۔

مصنوعی ذہانت (AI) کی دھماکہ خیز ترقی کے بعد سے، ڈیپ فیک کا مسئلہ تیزی سے مقبول ہو گیا ہے، جس سے پریس میں غلط معلومات کی لہریں پھیل رہی ہیں۔ لہذا، تصاویر اور ویڈیوز کی اصلیت کی تصدیق کرنا دنیا کی معروف کیمرہ کمپنیوں کے لیے ایک فوری مسئلہ ہے۔

سونی، کینن اور نیکن سے توقع کی جاتی ہے کہ وہ ایسے ڈیجیٹل کیمرے لانچ کریں گے جو براہ راست اپنے مرر لیس کیمروں (یا DSLR ڈیجیٹل کیمروں) پر ڈیجیٹل دستخطوں کی حمایت کرتے ہیں۔ کیمروں پر ڈیجیٹل دستخطوں کو نافذ کرنے کی کوشش ایک انتہائی اہم اقدام ہے، جس سے تصاویر کی اصل اور سالمیت کا ثبوت ملتا ہے۔

ان ڈیجیٹل دستخطوں میں تاریخ، وقت، مقام، فوٹوگرافر کے بارے میں معلومات شامل ہوں گی اور یہ چھیڑ چھاڑ سے پاک ہوں گے۔ یہ خاص طور پر فوٹو جرنلسٹ اور دوسرے پیشہ ور افراد کے لیے اہم ہے جن کے کام کو تصدیق کی ضرورت ہوتی ہے۔

کیمرہ انڈسٹری کے تین بڑے اداروں نے آن لائن تصدیقی ٹول Verify کے ساتھ ہم آہنگ ڈیجیٹل دستخطوں کے لیے عالمی معیار پر اتفاق کیا ہے۔ عالمی خبر رساں اداروں، ٹیک کمپنیوں، اور کیمرہ مینوفیکچررز کے اتحاد کے ذریعے شروع کیا گیا، یہ ٹول کسی بھی تصویر کی صداقت کی مفت تصدیق کے قابل بنائے گا۔ اگر تصاویر کو AI کا استعمال کرتے ہوئے بنایا یا تبدیل کیا جاتا ہے، تو Verify انہیں 'No Content Verification' کے طور پر پرچم لگائے گا۔

اینٹی ڈیپ فیک ٹیکنالوجیز کی اہمیت سابق امریکی صدر ڈونلڈ ٹرمپ اور جاپانی وزیر اعظم فومیو کشیدا جیسی مشہور شخصیات کے ڈیپ فیکس کے تیزی سے بڑھنے سے ہے۔

مزید برآں، چین کی سنگھوا یونیورسٹی کے محققین نے ایک نیا تخلیقی AI ماڈل تیار کیا ہے جو روزانہ تقریباً 700,000 تصاویر بنانے کی صلاحیت رکھتا ہے۔

کیمرہ بنانے والوں کے علاوہ، دیگر ٹیک کمپنیاں بھی ڈیپ فیکس کے خلاف جنگ میں شامل ہو رہی ہیں۔ گوگل نے AI سے تیار کردہ تصاویر کو ڈیجیٹل طور پر واٹر مارک کرنے کے لیے ایک ٹول جاری کیا ہے، جب کہ انٹیل نے ایسی ٹیکنالوجی تیار کی ہے جو تصاویر میں جلد کے رنگ کی تبدیلیوں کا تجزیہ کرتی ہے تاکہ ان کی صداقت کا تعین کیا جا سکے۔ ہٹاچی آن لائن شناختی فراڈ کو روکنے کے لیے ٹیکنالوجی پر بھی کام کر رہا ہے۔

نئی ٹیکنالوجی 2024 کے اوائل میں دستیاب ہونے کی امید ہے۔ سونی نے میڈیا میں ٹیکنالوجی کو فروغ دینے کا منصوبہ بنایا ہے اور اکتوبر 2023 میں پہلے ہی فیلڈ ٹرائلز کر چکے ہیں۔ کینن تھامسن رائٹرز اور سٹارلنگ ڈیٹا پرزرویشن لیب (اسٹینفورڈ یونیورسٹی اور سدرن کیلیفورنیا یونیورسٹی کے ذریعہ قائم کردہ ایک تحقیقی ادارہ) کے ساتھ شراکت داری کر رہا ہے تاکہ ٹیکنالوجی کو مزید بہتر بنایا جا سکے۔

کیمرہ بنانے والوں کو امید ہے کہ نئی ٹیکنالوجی تصاویر پر عوام کے اعتماد کو بحال کرنے میں مدد کرے گی، جس کے نتیجے میں دنیا کے بارے میں ہمارے تاثرات کی تشکیل ہوتی ہے۔

(OL کے مطابق)

ڈیپ فیک انویسٹمنٹ اسکینڈل کی ویڈیو پھیلانے کے لیے فیس بک کو $5,000 ادا کیا۔

نیا میلویئر سمارٹ فونز کو کنٹرول کر رہا ہے، ڈیپ فیک ویڈیوز زیادہ نفیس ہو رہی ہیں۔

ڈیپ فیک ویڈیوز زیادہ نفیس اور حقیقت پسند ہو رہی ہیں۔

ڈیپ فیک ویڈیو کالز کے جال میں پھنسنے سے بچنے کے لیے کیا کرنا چاہیے جو رقم کی منتقلی کا گھپلہ کرتی ہیں؟

ڈیپ فیک کا استحصال متاثرین کے چہروں کو فحش ویڈیوز میں ڈالنے کے لیے کیا جا رہا ہے۔

ماخذ

![[تصویر] لام ڈونگ: ٹوئی فونگ میں مشتبہ جھیل پھٹنے کے بعد نقصان کی تصاویر](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/02/1762078736805_8e7f5424f473782d2162-5118-jpg.webp)

![[تصویر] صدر لوونگ کوانگ امریکی وزیر جنگ پیٹ ہیگستھ کا استقبال کر رہے ہیں۔](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/02/1762089839868_ndo_br_1-jpg.webp)

تبصرہ (0)