|

يتطور برنامج الدردشة الآلي من OpenAI باستمرار بفضل التقنيات الجديدة. الصورة: نيويورك تايمز . |

في سبتمبر 2024، أطلقت OpenAI برنامج ChatGPT، وهو إصدار من الذكاء الاصطناعي يدمج نموذج o1، القادر على التفكير في المهام المتعلقة بالرياضيات والعلوم وبرمجة الكمبيوتر.

بخلاف الإصدار السابق من ChatGPT، ستستغرق التقنية الجديدة وقتًا للتفكير في حلول للمشاكل المعقدة قبل تقديم رد.

بعد OpenAI، قدمت العديد من الشركات المنافسة، مثل جوجل وأنثروبيك وديب سيك، نماذج استدلال مماثلة. ورغم أنها ليست مثالية، إلا أنها لا تزال تقنية متطورة لتطوير برامج الدردشة الآلية، تحظى بثقة العديد من المطورين.

كيف يُفكّر الذكاء الاصطناعي

باختصار، يعني التفكير المنطقي أن روبوتات الدردشة يمكنها قضاء المزيد من الوقت في حل المشكلات التي يطرحها المستخدمون.

قال دان كلاين، أستاذ علوم الكمبيوتر في جامعة كاليفورنيا، لصحيفة نيويورك تايمز : "إن الاستدلال هو كيف يقوم النظام بعمل إضافي بعد تلقي سؤال".

يمكن للنظام المنطقي أن يقسم المشكلة إلى خطوات فردية أصغر، أو أن يحلها من خلال التجربة والخطأ.

عند إطلاقه لأول مرة، كان برنامج ChatGPT قادراً على الإجابة عن الأسئلة فوراً من خلال استخلاص المعلومات وتجميعها. في المقابل، كانت أنظمة الاستدلال تحتاج إلى بضع ثوانٍ إضافية (أو حتى دقائق) لحل المشكلة وتقديم إجابة.

|

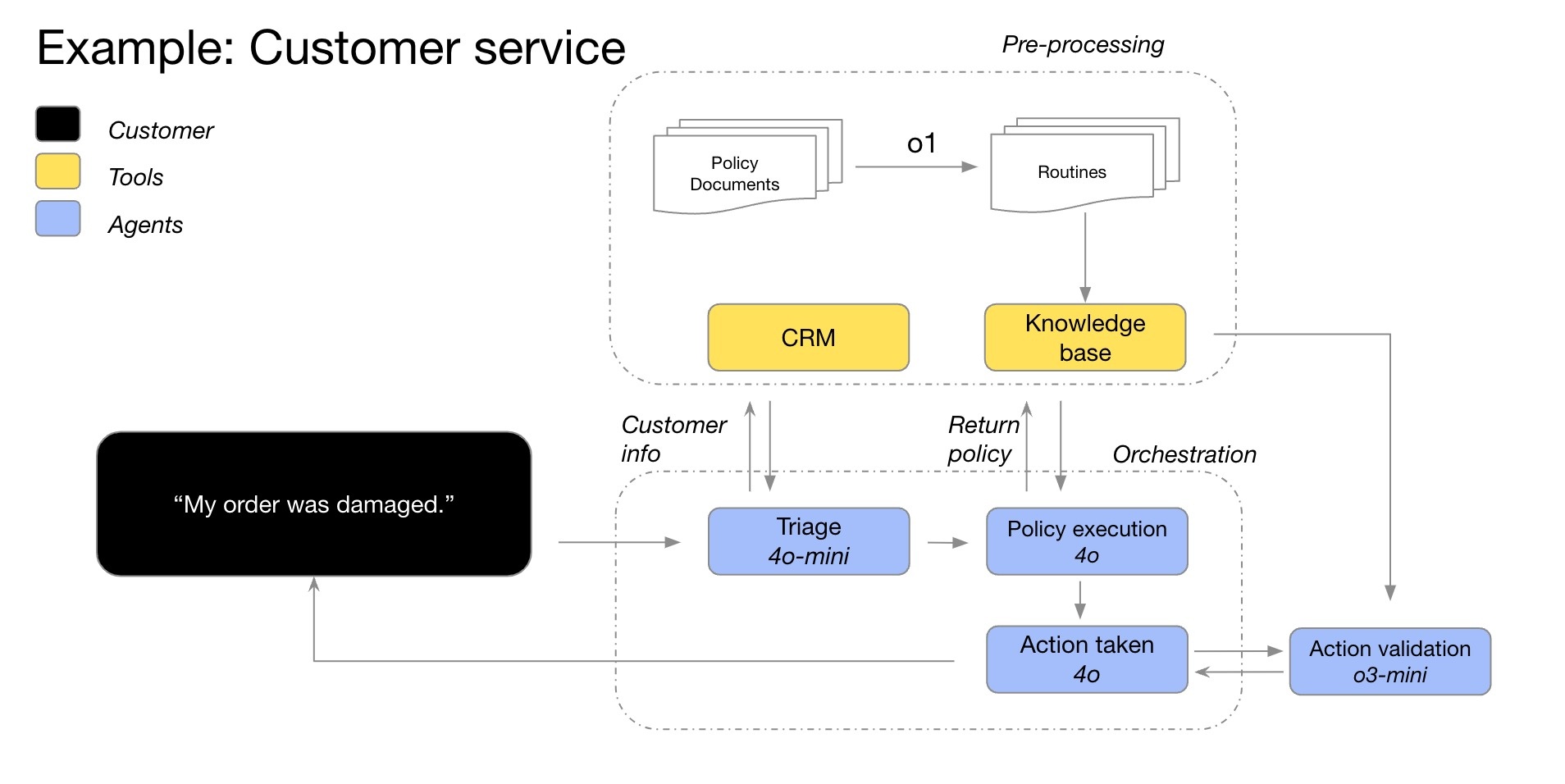

مثال على عملية الاستدلال في نموذج O1 ضمن روبوت محادثة لخدمة العملاء. الصورة: OpenAI . |

في بعض الحالات، يُغيّر نظام الاستدلال منهجه في معالجة المشكلة، مُحسّناً الحل باستمرار. إضافةً إلى ذلك، قد يختبر النموذج حلولاً متعددة قبل اتخاذ الخيار الأمثل، أو يتحقق من دقة الاستجابات السابقة.

بشكل عام، سيأخذ نظام الاستدلال في الاعتبار جميع الإجابات الممكنة للسؤال. وهذا يشبه قيام طلاب المرحلة الابتدائية بكتابة العديد من الخيارات على الورق قبل اختيار الحل الأنسب لمسألة رياضية.

بحسب صحيفة نيويورك تايمز ، أصبح الذكاء الاصطناعي قادراً الآن على التفكير المنطقي في أي موضوع تقريباً. ومع ذلك، سيكون أكثر فعالية في المسائل المتعلقة بالرياضيات والعلوم وبرمجة الحاسوب.

كيف يتم تدريب النظام النظري؟

في روبوتات الدردشة التقليدية، لا يزال بإمكان المستخدمين طلب توضيحات حول العملية أو التحقق من دقة الرد. في الواقع، تتضمن العديد من مجموعات بيانات تدريب ChatGPT إجراءات لحل المشكلات.

يصبح نظام الاستدلال أكثر تطوراً عندما يتمكن من تنفيذ العمليات دون تدخل المستخدم. هذه العملية أكثر تعقيداً وشمولاً. تستخدم الشركات مصطلح "الاستدلال" لأن النظام يعمل بطريقة مشابهة لطريقة تفكير البشر.

تتوقع العديد من الشركات، مثل OpenAI، أن تكون أنظمة الاستدلال هي الحل الأمثل لتحسين روبوتات المحادثة المتاحة حاليًا. ولسنوات، اعتقدت هذه الشركات أن أداء روبوتات المحادثة يتحسن كلما زادت المعلومات التي تتلقاها من الإنترنت.

بحلول عام 2024، ستكون أنظمة الذكاء الاصطناعي قد استنفدت تقريباً جميع النصوص المتاحة على الإنترنت. وهذا يعني أن الشركات بحاجة إلى إيجاد حلول جديدة لتطوير روبوتات المحادثة، بما في ذلك أنظمة الاستدلال.

|

أثارت شركة DeepSeek الناشئة ضجةً كبيرةً بنموذجها الاستدلالي الذي تميز بتكاليف أقل من OpenAI. الصورة: بلومبيرغ . |

منذ العام الماضي، ركزت شركات مثل OpenAI على تقنيات التعلم المعزز. تستغرق هذه العملية عادةً عدة أشهر، يتعلم خلالها الذكاء الاصطناعي السلوك من خلال التجربة والخطأ.

فعلى سبيل المثال، من خلال حل آلاف المسائل، يستطيع النظام تحديد الطريقة الأمثل للوصول إلى الإجابة الصحيحة. ومن ثم، يبني الباحثون آليات تغذية راجعة متطورة تساعد النظام على التمييز بين الحلول الصحيحة والخاطئة.

"الأمر مشابه لكيفية تدريب الكلب. إذا كان النظام يعمل بشكل جيد، فإنك تعطيه مكافأة. وإلا، فإنك تقول: "هذا الكلب مشاغب"."، هذا ما قاله جيري توورك، الباحث في OpenAI.

هل الذكاء الاصطناعي هو المستقبل؟

بحسب صحيفة نيويورك تايمز ، تُعدّ تقنيات التعلّم المعزز فعّالة عند التعامل مع متطلبات الرياضيات والعلوم وبرمجة الحاسوب، وهي مجالات يمكن فيها تحديد الإجابات الصحيحة والخاطئة بوضوح.

في المقابل، يُعدّ التعلّم المعزز غير فعّال في الكتابة والفلسفة والأخلاق، وهي مجالات يصعب فيها التمييز بين الصواب والخطأ. ومع ذلك، يؤكد الباحثون أن هذه التقنية لا تزال قادرة على تحسين أداء الذكاء الاصطناعي، حتى في المسائل غير الرياضية.

قال جاريد كابلان، كبير المسؤولين العلميين في شركة أنثروبيك: "ستتعلم الأنظمة المسارات التي تؤدي إلى نتائج إيجابية وسلبية".

|

موقع شركة أنثروبيك الناشئة، المالكة لنموذج الذكاء الاصطناعي كلود. الصورة: بلومبيرغ . |

من المهم الإشارة إلى أن التعلم المعزز وأنظمة الاستدلال مفهومان مختلفان. فالتعلم المعزز، تحديداً، هو أسلوب لبناء أنظمة الاستدلال، وهو المرحلة التدريبية النهائية لتمكين روبوتات المحادثة من الاستدلال.

نظرًا لحداثة هذا المجال نسبيًا، لا يستطيع العلماء حتى الآن الجزم بما إذا كان التفكير المنطقي باستخدام برامج الدردشة الآلية أو التعلم المعزز قادرًا على مساعدة الذكاء الاصطناعي على التفكير كالبشر. تجدر الإشارة إلى أن العديد من اتجاهات تدريب الذكاء الاصطناعي الحالية تتطور بسرعة كبيرة في البداية ثم تتباطأ تدريجيًا.

علاوة على ذلك، قد يرتكب نظام المحادثة الآلية أخطاءً. فبناءً على الاحتمالات، سيختار النظام العملية التي تُشابه البيانات التي تعلمها، سواءً من الإنترنت أو من خلال التعلم المعزز. لذا، قد يختار نظام المحادثة الآلية حلولًا خاطئة أو غير منطقية.

المصدر: https://znews.vn/ai-ly-luan-nhu-the-nao-post1541477.html

![[صورة] الأمين العام يقدم لقب بطل القوات المسلحة الشعبية إلى البحرية.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/02/28/1772251730336_vna-potal-tong-bi-thu-to-lam-du-va-trao-danh-hieu-anh-hung-llvt-nhan-dan-cho-quan-chung-hai-quan-8612073-jpg.webp)

تعليق (0)