|

يُعدّ المحتوى البشري الخالص من بين الموارد النادرة في عصر الذكاء الاصطناعي. الصورة: أسبوع الإعلان . |

أدى ظهور برنامج ChatGPT في عام 2022 إلى طفرة هائلة في المحتوى المدعوم بالذكاء الاصطناعي على الإنترنت. وتتوقع شركة غارتنر أنه بحلول عام 2026، سيتم توليد 90% من محتوى الإنترنت بواسطة الذكاء الاصطناعي، بما في ذلك النصوص والصور والفيديوهات .

يتم تدريب الذكاء الاصطناعي على فهم الفكر البشري. ومع ذلك، إذا لم تعد هناك بيانات بشرية خالصة، فستستخدم هذه التقنية معلوماتها القديمة، مثل آلة تصوير تنسخ نفسها.

يشبّه العديد من الباحثين المحتوى الأصلي الذي ينتجه الإنسان بنوع من الفولاذ "النظيف" في العصر الحديث، أي ما يعادل ندرته وصعوبة العثور عليه. ويخشون أنه إذا لم يقم أحد بتخزين نسخ من البيانات قبل عام 2022، فسيفقد الإنترنت سلامته تمامًا.

كارثة تاريخية تتكرر.

في حقبة ما بعد الحرب النووية، اكتشف العلماء أن جميع أنواع الصلب المنتجة بعد عام 1945 كانت ملوثة. فقد لوثت القنابل الذرية الغلاف الجوي بالإشعاع، الذي انتشر إلى المعادن المنتجة في تلك البيئة.

ونتيجةً لذلك، أصبح جزء كبير من الفولاذ غير صالح للاستخدام في معدات القياس عالية الدقة، مثل عدادات جايجر والعديد من أجهزة الاستشعار الحساسة الأخرى. وكان الحل هو استخراج الفولاذ القديم من السفن الحربية التي غرقت قبل الحرب، والراسية في أعماق المحيط، حيث لا تتأثر بالتساقط الإشعاعي.

بالنسبة لمطوري الذكاء الاصطناعي، يتم تدريب معظم النماذج باستخدام مجموعات بيانات ضخمة من البيانات البشرية التي يتم جمعها من الإنترنت. ولكن إذا تعلمت البرامج الحالية من نصوص أنتجتها في الماضي، فإن النماذج معرضة لخطر الانهيار، مما يقلل من أصالتها وعمقها.

|

تم انتشال البارجة هيندنبورغ، التي غرقت خلال الحرب العالمية الأولى. الصورة: رويترز كونكت. |

هذا يجعل المحتوى الذي ينتجه البشر، وخاصةً ما تم إنشاؤه قبل عام 2022، أكثر قيمة، وفقًا لما ذكره ويل ألين، نائب رئيس شركة كلاود فلير، التي تدير إحدى أكبر شبكات الإنترنت في العالم . ويؤكد ألين أن هذا يُساعد نماذج الذكاء الاصطناعي، والمجتمع ككل، على البقاء مُرتبطين بواقع مشترك. فبدون هذا الأساس، ستصبح الأمور مُعقدة.

تكتسب المنصات أهمية خاصة في المجالات التقنية المتقدمة كالطب والقانون والضرائب. فعلى سبيل المثال، ينبغي للطبيب الاعتماد على المحتوى الذي يكتبه خبراء بشريون وعلى البحوث الواقعية، لا على المصادر التي تولدها برامج الذكاء الاصطناعي.

هذا التهديد يتحول إلى واقع ملموس. فبعد عام من إطلاق ChatGPT، ذكر المستثمر بول غراهام أنه اضطر للبحث عن محتوى قديم لإجراء بحث بسيط لتجنب "المحتوى المُضلل المُولّد بواسطة الذكاء الاصطناعي". وردّ مالتي أوبل، المدير التقني لشركة Vercel الناشئة في مجال الذكاء الاصطناعي، بأن غراهام كان في الأساس يُصفّي الإنترنت بحثًا عن المحتوى "قبل أن يُلوّثه الذكاء الاصطناعي".

يتفق مات ريكارد، المهندس السابق في جوجل، مع هذا الرأي. فقد كتب في تدوينة له عام 2023 أن الذكاء الاصطناعي يجمع البيانات من الإنترنت، ولكن بشكل متزايد، يتم إنشاء جزء كبير من محتوى الإنترنت بواسطة الذكاء الاصطناعي نفسه. وأوضح ريكارد قائلاً: "يصعب للغاية اكتشاف مخرجات تشاتنر. وسيصبح العثور على بيانات تدريب لم يتم التلاعب بها بواسطة الذكاء الاصطناعي أكثر صعوبة".

"البحث عن الفولاذ في قاع البحر"

يكمن حل هذه المشكلة في الحفاظ على النسخة البشرية من البيانات التي تم إنشاؤها قبل طفرة الذكاء الاصطناعي. ومن رواد هذا المجال جون غراهام-كومينغ، عضو مجلس الإدارة والرئيس التنفيذي للتكنولوجيا في شركة كلاود فلير.

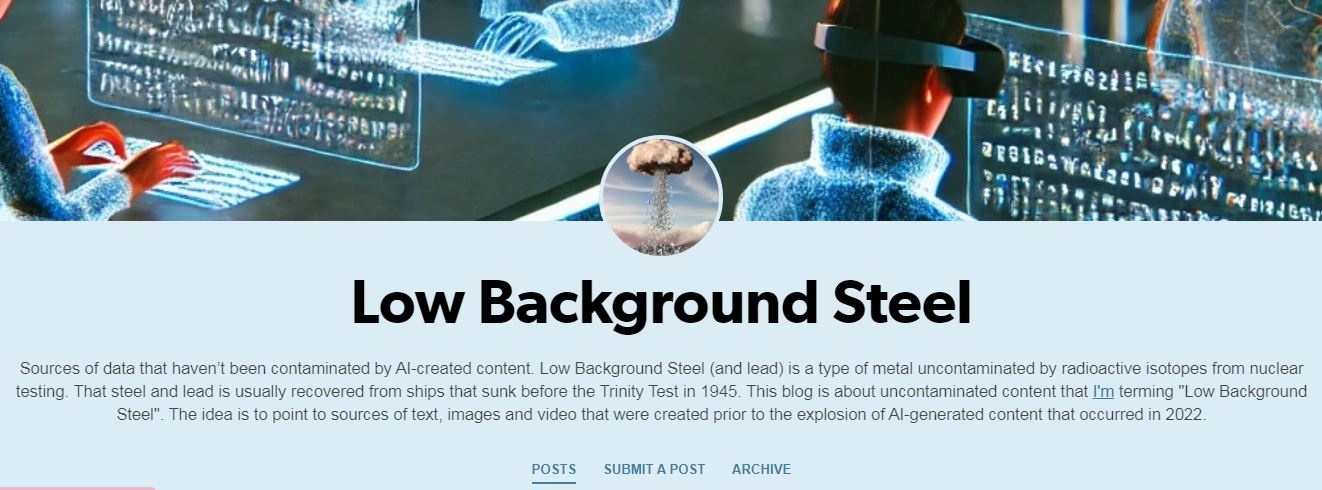

يقوم مشروعه، وهو موقع LowBackgroundSteel.ai، بإدراج مجموعات البيانات والمسارات والوسائط التي كانت موجودة قبل عام 2022. ومن الأمثلة المذكورة على ذلك مستودع Arctic Code Vault التابع لـ GitHub، وهو أرشيف برامج مفتوح المصدر مدفون في منجم فحم مهجور في النرويج، ويحتوي على بيانات منذ فبراير 2020.

|

مشروع غراهام-كومينغ لحفظ البيانات البشرية. الصورة: Lowbackgroundsteel.ai. |

ومن مصادر البيانات الأخرى التي استشهد بها مشروع "wordfreq"، وهو مشروع يتتبع تكرار استخدام الكلمات على الإنترنت. وقد تولت اللغوية روبين سبير إدارته حتى عام 2021.

قالت سبير: "لقد لوّثت تقنيات الذكاء الاصطناعي البيانات". وأعطت مثالاً على ذلك هوس برنامج ChatGPT المفرط بكلمة "delve"، مما أدى إلى ازدياد ظهورها مؤخراً. وهذا يشوّه البيانات على الإنترنت، ويجعلها أقل موثوقية في عكس طريقة كتابة البشر وتفكيرهم.

يمكن لنماذج الذكاء الاصطناعي المدربة جزئيًا على محتوى مُصنّع أن تُسرّع سير العمل وتُزيل الرتابة في المهام الإبداعية. مع ذلك، فإنه بالإضافة إلى الأداء، قد يظل المستخدمون بحاجة إلى الاعتماد على محتوى أصلي من إنتاج البشر لإجراء تقييمات دقيقة، تمامًا كما هو الحال عند استخدام "الفولاذ منخفض الجودة" لإجراء قياسات دقيقة.

طوّر العلماء طرقًا مختلفة لإنتاج الفولاذ باستخدام الأكسجين النقي. ووفقًا لموقع بيزنس إنسايدر ، فإن هذا يُذكّرنا بأن الحفاظ على الماضي قد يكون السبيل الوحيد لبناء مستقبل موثوق.

المصدر: https://znews.vn/thu-sap-thanh-hoai-niem-บн-internet-post1559151.html

![[صورة] رئيس الجمعية الوطنية تران ثانه مان يختتم بنجاح مشاركته في المؤتمر الدولي للاتحاد البرلماني رقم 152](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/04/18/1776502638199_vna-potal-chu-tich-quoc-hoi-ket-thuc-tot-dep-chuong-trinh-tham-du-ipu-152-8709975-jpg.webp)

تعليق (0)