Οι ερευνητές της DeepSeek ανακοίνωσαν ένα νέο πειραματικό μοντέλο που ονομάζεται V3.2-exp, το οποίο έχει σχεδιαστεί για να μειώνει σημαντικά το κόστος της συμπερασματολογίας όταν χρησιμοποιείται σε λειτουργίες μεγάλου πλαισίου.

Το DeepSeek ανακοίνωσε το μοντέλο σε μια ανάρτηση στο Hugging Face και δημοσίευσε επίσης μια ακαδημαϊκή εργασία με σύνδεσμο στο GitHub.

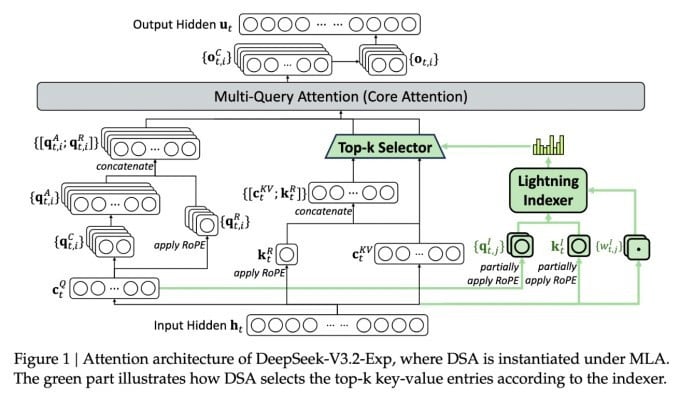

Το πιο σημαντικό χαρακτηριστικό του σύνθετου νέου μοντέλου ονομάζεται DeepSeek Sparse Attention. Ουσιαστικά, το σύστημα χρησιμοποιεί μια ενότητα που ονομάζεται «lightning indexer» για να ιεραρχήσει συγκεκριμένα αποσπάσματα από το παράθυρο περιβάλλοντος.

Το DeepSeek ανακοινώνει ένα οικονομικά αποδοτικό μοντέλο συμπερασμού.

Ένα ξεχωριστό σύστημα που ονομάζεται «σύστημα επιλογής διακριτικών με λεπτομέρεια» επιλέγει στη συνέχεια συγκεκριμένα διακριτικά από αυτά τα τμήματα (snippets) για να τα φορτώσει στο παράθυρο περιορισμένης προσοχής της ενότητας. Σε συνδυασμό, επιτρέπουν στα μοντέλα Sparse Attention να λειτουργούν σε μεγάλα τμήματα περιεχομένου με σχετικά μικρό φόρτο εργασίας διακομιστή.

Για λειτουργίες μεγάλου πλαισίου, τα οφέλη του συστήματος είναι σημαντικά. Οι προκαταρκτικές δοκιμές του DeepSeek δείχνουν ότι το κόστος μιας κλήσης απλής συνάρτησης συμπερασμού (API) μπορεί να μειωθεί έως και στο μισό σε σενάρια μεγάλου πλαισίου.

Απαιτούνται περαιτέρω δοκιμές για τη δημιουργία μιας πιο αξιόπιστης αξιολόγησης, αλλά επειδή το μοντέλο είναι ανοιχτό και ελεύθερα διαθέσιμο στο Hugging Face, δεν θα χρειαστεί πολύς χρόνος μέχρι να μπορέσουν οι δοκιμές τρίτων να αξιολογήσουν τους ισχυρισμούς της εργασίας.

Σε αντίθεση με άλλα μοντέλα AI Chatbot που καταναλώνουν πολλή ενέργεια, το DeepSeek στρέφεται προς την εξοικονόμηση κόστους, από την εκπαίδευση έως τη λειτουργία.

Το νέο μοντέλο της DeepSeek είναι ένα από μια σειρά πρόσφατων καινοτομιών που αντιμετωπίζουν το πρόβλημα του κόστους συμπερασμάτων — ουσιαστικά, το κόστος του διακομιστή για την εκτέλεση ενός προ-εκπαιδευμένου μοντέλου Τεχνητής Νοημοσύνης, σε αντίθεση με το κόστος εκπαίδευσής του.

Στην περίπτωση του DeepSeek, οι ερευνητές αναζητούσαν τρόπους για να κάνουν την βασική αρχιτεκτονική μετασχηματιστών πιο αποτελεσματική — και διαπίστωσαν ότι έπρεπε να γίνουν σημαντικές βελτιώσεις.

Με έδρα την Κίνα, η DeepSeek αποτελεί μια ασυνήθιστη φιγούρα στη μανία της Τεχνητής Νοημοσύνης, ειδικά για όσους βλέπουν την έρευνα για την Τεχνητή Νοημοσύνη ως ανταγωνισμό μεταξύ ΗΠΑ και Κίνας. Η εταιρεία έκανε αίσθηση νωρίτερα φέτος με το μοντέλο R1, το οποίο εκπαιδεύτηκε κυρίως με χρήση ενισχυτικής μάθησης με πολύ χαμηλότερο κόστος από τους ανταγωνιστές της στις ΗΠΑ.

Ωστόσο, το μοντέλο απέτυχε να πυροδοτήσει την πλήρη επανάσταση στην εκπαίδευση στην Τεχνητή Νοημοσύνη, όπως προέβλεπαν ορισμένοι, και η εταιρεία σιγά σιγά αποσύρθηκε από τα φώτα της δημοσιότητας τους μήνες που ακολούθησαν.

Η νέα προσέγγιση της «αραιάς προσοχής» είναι απίθανο να προκαλέσει τόση οργή όσο η R1 — αλλά θα μπορούσε να διδάξει στους παρόχους υπηρεσιών των ΗΠΑ μερικά απαραίτητα κόλπα για να διατηρήσουν χαμηλό το κόστος συμπερασμάτων.

https://techcrunch.com/2025/09/29/deepseek-releases-sparse-attention-model-that-cuts-api-costs-in-half/

Πηγή: https://khoahocdoisong.vn/deepseek-dao-tao-da-re-nay-con-co-ban-suy-luan-re-hon-post2149057353.html

![[Φωτογραφία] Επίσημη έναρξη του 8ου Συνεδρίου της Κεντρικής Επιτροπής Δημόσιας Ασφάλειας του Κόμματος, περίοδος 2025-2030](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/4/f3b00fb779f44979809441a4dac5c7df)

![[Φωτογραφία] Ο Γενικός Γραμματέας Το Λαμ παρευρίσκεται στο 8ο Συνέδριο της Κεντρικής Επιτροπής Δημόσιας Ασφάλειας του Κόμματος](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/4/79fadf490f674dc483794f2d955f6045)

![[Φωτογραφία] Οι μαθητές του Δημοτικού Σχολείου Binh Minh απολαμβάνουν το φεστιβάλ της πανσελήνου, απολαμβάνοντας τις χαρές της παιδικής ηλικίας](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/3/8cf8abef22fe4471be400a818912cb85)

![[Πληροφοριακό γράφημα] Αξιοσημείωτοι αριθμοί μετά από 3 μήνες «αναδιοργάνωσης της χώρας»](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/4/ce8bb72c722348e09e942d04f0dd9729)

Σχόλιο (0)