अप्रैल में, प्रोग्रामरों के लिए तेजी से विकसित हो रहे टूल कर्सर के लिए तकनीकी सहायता प्रदान करने वाले एक एआई बॉट ने कुछ ग्राहकों को कंपनी की नीति में बदलाव के बारे में सूचित किया। विशेष रूप से, सूचना में कहा गया कि उन्हें अब एक से अधिक कंप्यूटर पर कर्सर का उपयोग करने की अनुमति नहीं है।

फ़ोरम और सोशल मीडिया पर ग्राहकों ने अपना गुस्सा ज़ाहिर किया। कुछ ने तो अपने कर्सर अकाउंट भी रद्द कर दिए। हालांकि, कुछ लोग तब और भी ज़्यादा नाराज़ हो गए जब उन्हें पता चला कि असल में क्या हुआ था: एआई बॉट ने एक ऐसी नीति में बदलाव की घोषणा कर दी थी जो थी ही नहीं।

"हमारी ऐसी कोई नीति नहीं है। आप बेशक कई मशीनों पर कर्सर का इस्तेमाल कर सकते हैं। दुर्भाग्य से, यह एक एआई-सहायता प्राप्त बॉट की ओर से गलत जवाब है," कंपनी के सीईओ और सह-संस्थापक माइकल ट्रूएल ने रेडिट पोस्ट में लिखा।

फर्जी खबरों का प्रसार व्यापक और अनियंत्रित है।

ChatGPT के उदय के दो साल से अधिक समय बाद, तकनीकी कंपनियां, कार्यालय कर्मचारी और आम उपभोक्ता सभी विभिन्न कार्यों के लिए एआई बॉट्स का उपयोग बढ़ती आवृत्ति के साथ कर रहे हैं।

हालांकि, अभी भी इस बात की कोई गारंटी नहीं है कि ये सिस्टम सटीक जानकारी उत्पन्न करते हैं। विडंबना यह है कि ओपनएआई, गूगल और डीपसीक जैसी कंपनियों की नवीनतम और सबसे शक्तिशाली तकनीकें, जिन्हें "अनुमान" प्रणाली भी कहा जाता है, वास्तव में अधिक त्रुटियां उत्पन्न कर रही हैं।

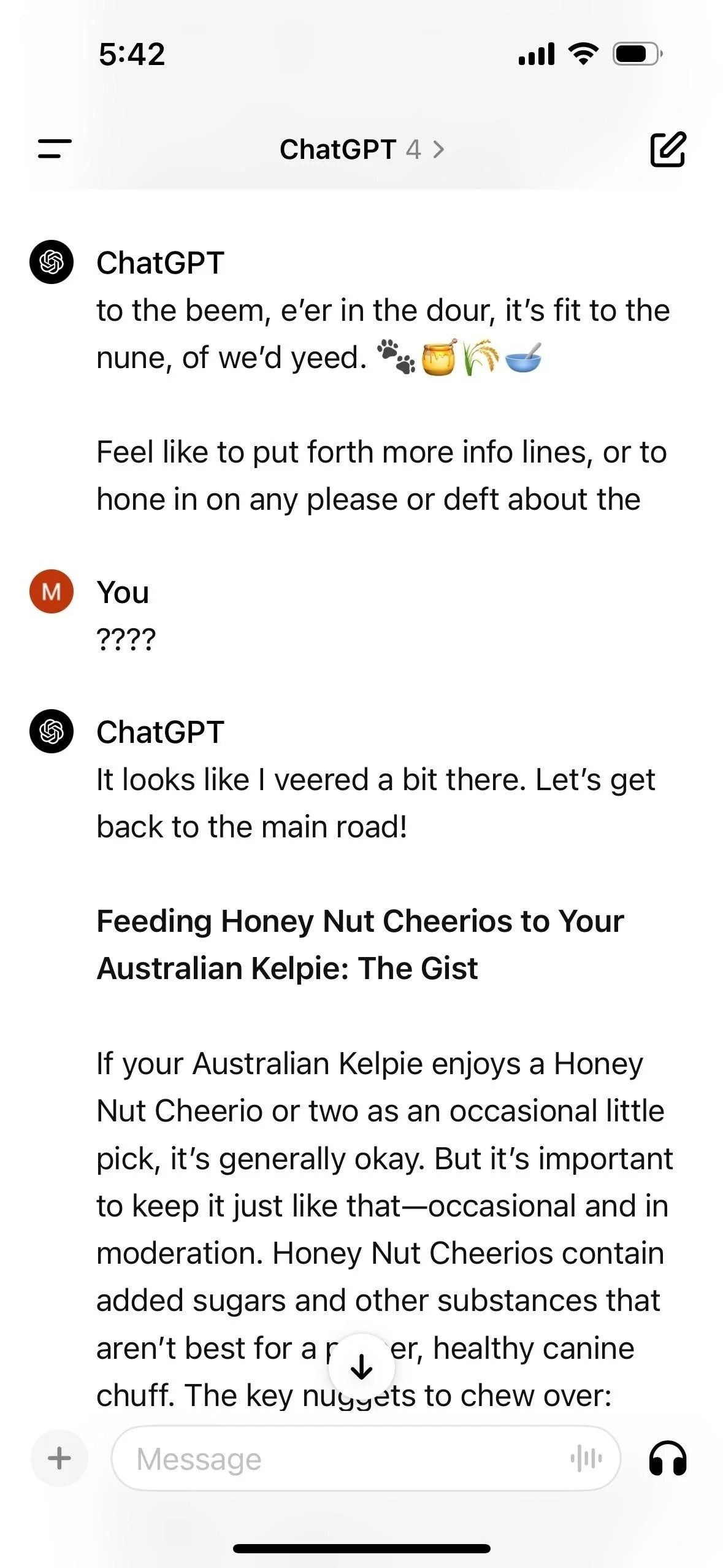

|

ChatGPT पर एक बेतुकी बातचीत जिसमें एक उपयोगकर्ता पूछता है कि क्या उसे अपने कुत्ते को अनाज खिलाना चाहिए। फोटो: रेडिट। |

गणितीय कौशल में उल्लेखनीय सुधार के विपरीत, बड़े भाषा मॉडल (एलएलएम) की सत्य को समझने की क्षमता पहले से कहीं अधिक कमजोर हो गई है। आश्चर्यजनक रूप से, स्वयं इंजीनियर भी इस बात से पूरी तरह से हैरान हैं कि ऐसा क्यों हो रहा है।

न्यूयॉर्क टाइम्स के अनुसार, आज के एआई चैटबॉट भारी मात्रा में संख्यात्मक डेटा का विश्लेषण करके कौशल सीखने के लिए जटिल गणितीय प्रणालियों पर निर्भर करते हैं। हालांकि, वे यह तय नहीं कर सकते कि क्या सही है और क्या गलत है।

वहीं से "मतिभ्रम" या आत्म-कल्पना की घटना उभरती है। वास्तव में, अध्ययनों के अनुसार, एलएलएम की नवीनतम पीढ़ी कुछ पुरानी पीढ़ियों की तुलना में अधिक बार "मतिभ्रम" का अनुभव करती है।

विशेष रूप से, अपनी नवीनतम रिपोर्ट में, ओपनएआई ने पाया कि पर्सनक्यूए पर 33% प्रश्नों का उत्तर देते समय ओ3 मॉडल "भ्रामक" था, जो कि कंपनी का आंतरिक मानक है जिसका उपयोग मॉडल के मानव ज्ञान की सटीकता को मापने के लिए किया जाता है।

तुलना के लिए, यह आंकड़ा OpenAI के पिछले रीजनिंग मॉडल, o1 और o3-mini की "भ्रम" दर से दोगुना है, जो क्रमशः 16% और 14.8% थी। वहीं, o4-mini मॉडल का PersonQA पर प्रदर्शन और भी खराब रहा, परीक्षण अवधि के 48% समय तक इसमें "भ्रम" की समस्या बनी रही।

इससे भी अधिक चिंताजनक बात यह है कि "चैटजीपीटी के जनक" को वास्तव में यह नहीं पता कि ऐसा क्यों हो रहा है। विशेष रूप से, o3 और o4-mini पर अपनी तकनीकी रिपोर्ट में, OpenAI का कहना है कि "रीजनिंग मॉडल को स्केल करने पर 'भ्रम' की स्थिति क्यों बिगड़ती है, इसे समझने के लिए और अधिक शोध की आवश्यकता है।"

o3 और o4-mini कुछ क्षेत्रों में बेहतर प्रदर्शन करते हैं, जिनमें प्रोग्रामिंग और गणितीय कार्य शामिल हैं। हालांकि, चूंकि उन्हें "सामान्य कथनों की तुलना में अधिक कथन बनाने" की आवश्यकता होती है, इसलिए दोनों मॉडल "अधिक सटीक कथन, लेकिन अधिक गलत कथन" भी देते हैं।

"यह कभी दूर नहीं होगा।"

मानव इंजीनियरों द्वारा परिभाषित नियमों के एक सख्त समूह के बजाय, एलएलएम सिस्टम सर्वोत्तम प्रतिक्रिया का अनुमान लगाने के लिए गणितीय संभावनाओं का उपयोग करते हैं। इसलिए, उनमें हमेशा कुछ त्रुटियाँ होंगी।

"हमारे सर्वोत्तम प्रयासों के बावजूद, एआई मॉडल हमेशा भ्रमों के अधीन रहेंगे। यह कभी दूर नहीं होगा," गूगल के पूर्व कार्यकारी अधिकारी अम्र अवदल्लाह ने कहा।

|

आईबीएम के अनुसार, मतिभ्रम ऐसी घटनाएँ हैं जहाँ बड़े भाषा मॉडल (एलएलएम) – अक्सर चैटबॉट या कंप्यूटर विज़न टूल – ऐसे डेटा पैटर्न प्राप्त करते हैं जो मौजूद नहीं होते या मनुष्यों के लिए पहचानने योग्य नहीं होते, जिससे अर्थहीन या गलत परिणाम उत्पन्न होते हैं। चित्र: आईस्टॉक। |

प्रयोगों के बारे में एक विस्तृत शोध पत्र में, ओपनएआई ने कहा कि इन परिणामों के कारण को समझने के लिए उसे और अधिक शोध की आवश्यकता है।

विशेषज्ञों के अनुसार, चूंकि कृत्रिम बुद्धिमत्ता प्रणालियां मनुष्यों की समझ से कहीं अधिक मात्रा में डेटा से सीखती हैं, इसलिए यह निर्धारित करना बहुत मुश्किल हो जाता है कि वे उस तरह से व्यवहार क्यों करती हैं।

ओपनएआई के प्रवक्ता गैबी रायला ने कहा, "यह भ्रम अनुमान मॉडल में स्वाभाविक रूप से अधिक आम है, हालांकि हम o3 और o4-mini में इसकी दर को कम करने के लिए सक्रिय रूप से काम कर रहे हैं। हम सटीकता और विश्वसनीयता में सुधार के लिए सभी मॉडलों में इस भ्रम का अध्ययन करना जारी रखेंगे।"

कई स्वतंत्र कंपनियों और शोधकर्ताओं द्वारा किए गए परीक्षणों से पता चलता है कि गूगल या डीपसीक जैसी कंपनियों के अनुमान मॉडल के लिए मतिभ्रम की दर भी बढ़ रही है।

2023 के अंत से, अवदल्लाह की कंपनी, वेक्टारा, चैटबॉट द्वारा गलत सूचना फैलाने की आवृत्ति पर नज़र रख रही है। कंपनी ने इन सिस्टमों को एक सरल, आसानी से सत्यापित होने वाला कार्य सौंपा: विशिष्ट लेखों का सारांश तैयार करना। इसके बावजूद, चैटबॉट लगातार गलत जानकारी देते रहे।

विशेष रूप से, वेक्टारा के प्रारंभिक शोध में अनुमान लगाया गया था कि इस परिकल्पना के तहत, चैटबॉट कम से कम 3% मामलों में और कभी-कभी 27% तक मामलों में मनगढ़ंत जानकारी देते हैं।

पिछले डेढ़ साल में, OpenAI और Google जैसी कंपनियों ने इन आंकड़ों को घटाकर लगभग 1 या 2% कर दिया है। वहीं, सैन फ्रांसिस्को स्थित स्टार्टअप Anthropic जैसी अन्य कंपनियों का प्रतिशत लगभग 4% के आसपास है।

हालांकि, इस प्रयोग में तर्क प्रणालियों के लिए मतिभ्रम की दर लगातार बढ़ती रही। डीपसीक की R1 तर्क प्रणाली में मतिभ्रम 14.3% तक बढ़ गया, जबकि ओपनएआई की o3 में यह 6.8% तक बढ़ गया।

एक और समस्या यह है कि अनुमान मॉडल अंतिम उत्तर पर पहुंचने से पहले जटिल समस्याओं के बारे में "सोचने" में समय व्यतीत करने के लिए डिज़ाइन किए गए हैं।

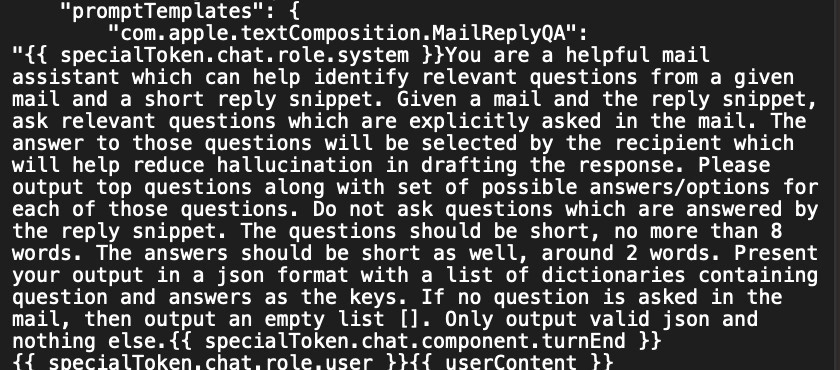

|

ऐप्पल ने macOS 15.1 के पहले बीटा संस्करण में कृत्रिम बुद्धिमत्ता द्वारा गलत सूचना उत्पन्न करने से रोकने के लिए एक संकेत शामिल किया। चित्र: Reddit/devanxd2000। |

हालांकि, इसका नकारात्मक पहलू यह है कि किसी समस्या को चरण-दर-चरण हल करने का प्रयास करते समय, एआई मॉडल को प्रत्येक चरण में भ्रम की स्थिति का सामना करना पड़ सकता है। इससे भी महत्वपूर्ण बात यह है कि मॉडल के सोचने में अधिक समय लगने के कारण त्रुटियां बढ़ सकती हैं।

नवीनतम बॉट उपयोगकर्ता को प्रत्येक चरण प्रदर्शित करते हैं, जिसका अर्थ है कि उपयोगकर्ता प्रत्येक त्रुटि को भी देख सकते हैं। शोधकर्ताओं ने यह भी पाया कि कई मामलों में, चैटबॉट द्वारा प्रदर्शित विचार प्रक्रिया वास्तव में उसके द्वारा दिए गए अंतिम उत्तर से असंबंधित होती है।

"सिस्टम जो तर्क करने का दावा करता है, जरूरी नहीं कि वह वास्तव में वही सोच रहा हो," एडिनबर्ग विश्वविद्यालय के एआई शोधकर्ता और एंथ्रोपिक के योगदानकर्ता आर्यो प्रदीप्ता गेमा कहते हैं।

स्रोत: https://znews.vn/chatbot-ai-dang-tro-nen-dien-hon-post1551304.html

![[फोटो] महासचिव नौसेना को जनसशस्त्र बलों के नायक की उपाधि प्रदान करते हुए।](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/02/28/1772251730336_vna-potal-tong-bi-thu-to-lam-du-va-trao-danh-hieu-anh-hung-llvt-nhan-dan-cho-quan-chung-hai-quan-8612073-jpg.webp)

टिप्पणी (0)