|

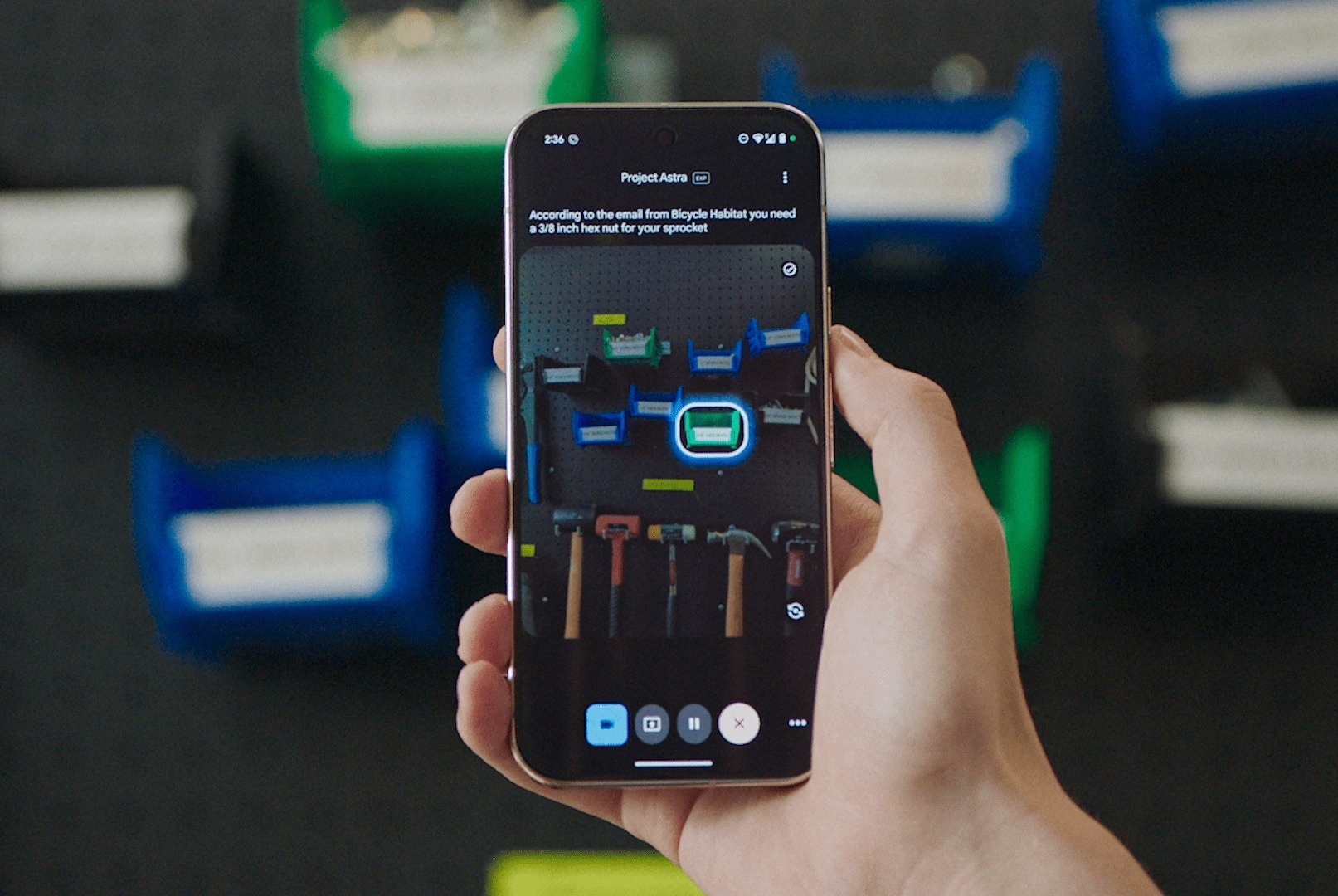

ចំណុចប្រទាក់អន្តរកម្មរបស់គម្រោង Astra ។ រូបថត៖ Google ។ |

នៅក្នុងព្រឹត្តិការណ៍ I/O 2025 ដែលធ្វើឡើងនៅព្រឹកព្រលឹមថ្ងៃទី 21 ឧសភា (ម៉ោងនៅវៀតណាម) Google បានប្រកាសអំពីមុខងារថ្មីៗមួយចំនួនរបស់ Project Astra ។ ចាប់ផ្តើមដំបូងក្នុងឆ្នាំ 2024 គម្រោង Astra ប្រើប្រាស់គំរូ AI ពហុមុខងារ ដើម្បីទាញយក និងវិភាគរូបភាព និងព័ត៌មានដែលមើលឃើញក្នុងពេលវេលាជាក់ស្តែង។ នេះគឺជាមហិច្ឆតាដ៏អស្ចារ្យរបស់ Google ជាមួយនឹងគោលដៅធ្វើឱ្យ AI កាន់តែមានប្រយោជន៍ក្នុងជីវិត។

បន្ទាប់ពីរយៈពេលសាកល្បង លក្ខណៈពិសេសមួយចំនួនរបស់ Project Astra ដូចជាការបញ្ចេញសំឡេង ការចងចាំ និងការគណនាជាមូលដ្ឋាននឹងបង្ហាញនៅលើកម្មវិធី Gemini និង Google ។

ក្នុងអំឡុងពេលព្រឹត្តិការណ៍នេះ Google បានបង្ហាញនូវវិធីមួយចំនួនដែល Astra អាចជួយក្នុងជីវិតប្រចាំថ្ងៃ។ បន្ថែមពីលើការឆ្លើយសំណួរ និងការប្រើប្រាស់កាមេរ៉ាដើម្បីចងចាំកន្លែងដែលអ្នកដាក់វ៉ែនតារបស់អ្នក ឥឡូវនេះ Astra អាចបំពេញកិច្ចការយ៉ាងសកម្មដោយមិនចាំបាច់សួរ។

លោក Greg Wayne អ្នកស្រាវជ្រាវនៅ DeepMind បាននិយាយថា "Astra អាចជ្រើសរើសនៅពេលណាដែលត្រូវនិយាយដោយផ្អែកលើអ្វីដែលវាមើលឃើញ។ វាតែងតែសង្កេត និងឆ្លើយតបទៅតាមនោះ" ។

យោងតាម The Verge មុខងារនេះអាចផ្លាស់ប្តូររបៀបដែល AI ដំណើរការ។ ជំនួសឱ្យការរង់ចាំឱ្យអ្នកប្រើប្រាស់ចង្អុលកាមេរ៉ារបស់ពួកគេ ហើយសុំជំនួយ Astra អាចបន្តតាមដាន ស្តាប់ និងជួយដោយស្វ័យប្រវត្តិប្រសិនបើចាំបាច់។ បច្ចុប្បន្ននេះ Google កំពុងផ្តោតលើការអភិវឌ្ឍន៍ Astra សម្រាប់ស្មាតហ្វូន និងវ៉ែនតាឆ្លាតវៃ។

Wayne ផ្តល់ឧទាហរណ៍មួយចំនួនអំពីរបៀបដែល Astra ដំណើរការ។ ខណៈពេលកំពុងធ្វើកិច្ចការផ្ទះ ឧបករណ៍អាចត្រួតពិនិត្យ និងជូនដំណឹងភ្លាមៗដល់អ្នកប្រើប្រាស់ នៅពេលរកឃើញកំហុស ជាជាងរង់ចាំឱ្យអ្នកប្រើប្រាស់បញ្ចប់ និងស្នើសុំការត្រួតពិនិត្យ។

លោក Demis Hassabis នាយកប្រតិបត្តិនៃ DeepMind បាននិយាយថា ការបណ្តុះបណ្តាល Astra ដើម្បីដំណើរការភារកិច្ចដោយខ្លួនឯង គឺជាជំនាញបច្ចេកទេសដ៏លំបាកបំផុតមួយ។ គាត់បានហៅវាថា "ការអានស្ថានភាព" ដោយសារតែ AI ត្រូវការដើម្បីកំណត់ថាពេលណាត្រូវជួយ របៀបជួយ និងពេលណាត្រូវនៅស្ងៀម។ ទាំងនេះជាសកម្មភាពដែលមនុស្សធ្វើបានល្អ ប៉ុន្តែពិបាកក្នុងការកំណត់បរិមាណ និងសិក្សា។

ការអាប់ដេតបន្ទាប់របស់ Astra គឺដើម្បីរុករកព័ត៌មានអ្នកប្រើប្រាស់នៅលើគេហទំព័រ និងផលិតផល Google ។ យោងតាម គេហទំព័រ The Verge ឧបករណ៍នេះអាចដឹងពីកាលវិភាគដើម្បីជូនដំណឹងថាពេលណាត្រូវចាកចេញពីផ្ទះ អានខ្លឹមសារនៃអ៊ីមែល ដើម្បីទាញយកលេខទូរស័ព្ទនៅពេលចូលស្នាក់នៅក្នុងសណ្ឋាគារ…

|

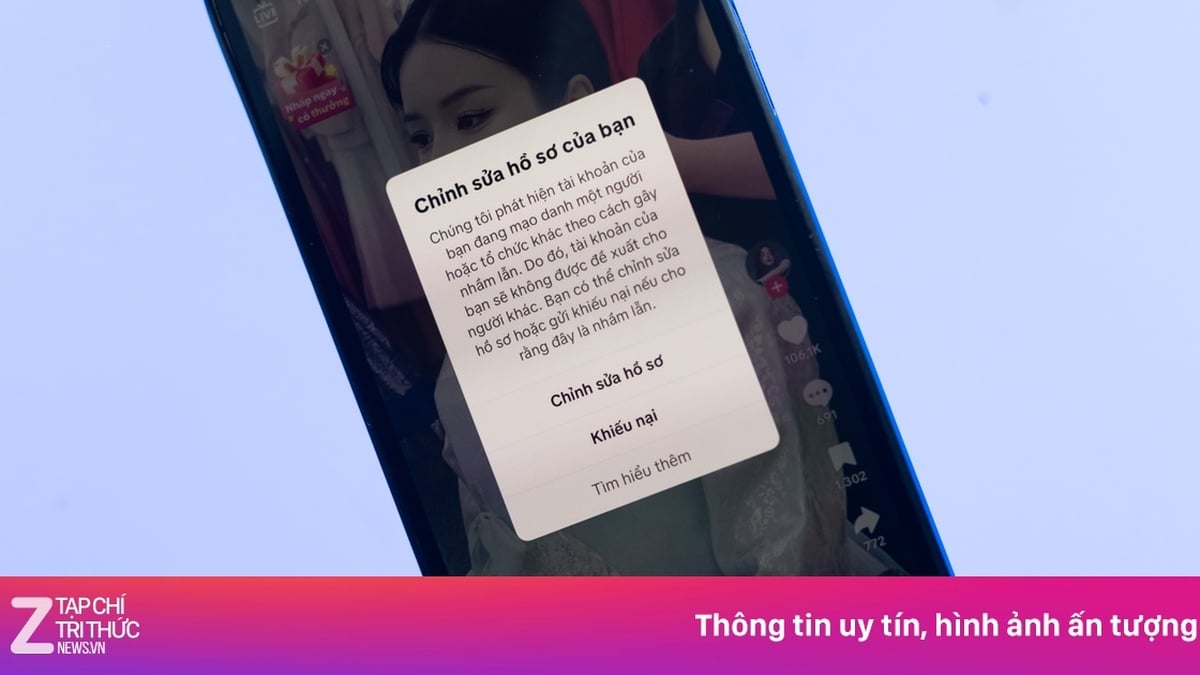

មុខងារ Highlighting របស់ Project Astra ដែលជួយស្កែនវត្ថុ និងប្រៀបធៀបព័ត៌មានដែលបានស្រង់ចេញពីកម្មវិធីផ្សេងៗ។ រូបថត៖ Google ។ |

បំណែកចុងក្រោយនៃល្បែងផ្គុំរូបរបស់ Astra គឺសមត្ថភាពរបស់វាក្នុងការរៀនពីរបៀបប្រើទូរស័ព្ទ Android ។ ការបង្ហាញនៅក្នុងព្រឹត្តិការណ៍នោះ លោក Bibo Xiu តំណាងផ្នែកផលិតផលរបស់ DeepMind បានចង្អុលកាមេរ៉ារបស់ទូរស័ព្ទទៅកាន់កាសស្តាប់ Sony ហើយបានស្នើឱ្យ Astra កំណត់អត្តសញ្ញាណម៉ូដែលនេះ។

បន្ទាប់ពី Astra ឆ្លើយតបថាកាសអាចជា Sony WH-1000XM4 ឬ WH-1000XM3 Xiu បានបន្តសួរឧបករណ៍ដើម្បីស្វែងរកសៀវភៅណែនាំអ្នកប្រើប្រាស់ បន្ទាប់មកពន្យល់ពីរបៀបភ្ជាប់ទៅទូរស័ព្ទ។ បន្ទាប់ពី Astra ណែនាំ Xiu បានរំខាន ហើយសុំឱ្យ chatbot ភ្ជាប់សម្រាប់គាត់។ Astra ភ្លាមៗបានបើកការកំណត់ហើយធ្វើវាដោយខ្លួនឯង។

ដំណើរការនេះមិនមានភាពរលូនទាំងស្រុងទេ ព្រោះ Xiu ត្រូវអនុញ្ញាតឱ្យ Astra ត្រួតពិនិត្យអេក្រង់ទូរសព្ទ។ នៅពេលអនាគត Google មានបំណងឱ្យ chatbot អាចត្រួតពិនិត្យអេក្រង់ដោយស្វ័យប្រវត្តិ។

នៅក្នុង វីដេអូ Google មួយផ្សេងទៀត មនុស្សម្នាក់សុំឱ្យ Astra ស្វែងរកសៀវភៅណែនាំអំពីកង់ Huffy បន្ទាប់មករុករកទៅទំព័រជាក់លាក់ដែលមានការណែនាំសម្រាប់ជួសជុលផ្នែកកង់។ Astra ថែមទាំងអាចស្វែងរកវីដេអូ YouTube អំពីរបៀបដកវីសដែលបិទចេញ បន្ទាប់មកទាក់ទងហាងដែលនៅជិតបំផុតដើម្បីស្វែងរកផ្នែកជំនួស។ វាកើតឡើងយ៉ាងរលូនក្នុងការធ្វើបាតុកម្ម។

ទោះបីជា Astra មិនត្រូវបានចេញផ្សាយយ៉ាងទូលំទូលាយក៏ដោយ ក៏ Google បាននិយាយថា មុខងារវិភាគរូបភាព Gemini Live នឹងត្រូវបានបញ្ចេញទៅកាន់អ្នកប្រើប្រាស់ iOS ទាំងអស់ (ពីមុនគាំទ្រតែ Android ប៉ុណ្ណោះ)។

លោក Xiu បាននិយាយថា នៅពេលអនាគត AI របស់ Google នឹងមិនគ្រាន់តែធ្វើសកម្មភាពលើពាក្យបញ្ជាប៉ុណ្ណោះទេ ប៉ុន្តែ Astra នឹងជួយឱ្យ "យល់ពីអ្វីដែលអាចមើលឃើញ និងមិនអាចត្រូវបានគេមើលឃើញនៅពេលនេះ" ។

ប្រភព៖ https://znews.vn/ai-cua-google-ngay-cang-thong-minh-post1554615.html

![[ព័ត៌មានសមុទ្រ] ជាង 80% នៃសមត្ថភាពដឹកជញ្ជូនកុងតឺន័រសកលគឺស្ថិតនៅក្នុងដៃរបស់ MSC និងសម្ព័ន្ធដឹកជញ្ជូនធំៗ](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/7/16/6b4d586c984b4cbf8c5680352b9eaeb0)

Kommentar (0)