소셜 미디어를 이용해 본 적이 있다면 AI가 만든 이미지나 동영상을 접했을 가능성이 높습니다. 토끼들이 트램폴린에서 뛰는 영상처럼 많은 사람들이 속아 넘어갔습니다. 하지만 OpenAI에서 개발한 ChatGPT의 자매 앱인 Sora는 AI 동영상 기술을 한 단계 끌어올려 가짜 콘텐츠 탐지의 중요성을 더욱 부각시키고 있습니다.

AI 기반 영상 분석 도구들이 등장하면서 진짜 영상을 식별하는 것이 그 어느 때보다 어려워지고 있다. (출처: CNET)

2024년에 출시되어 최근 Sora 2로 업그레이드된 이 앱은 모든 영상이 AI로 생성되는 TikTok과 유사한 인터페이스를 가지고 있습니다. "카메오" 기능을 사용하면 실제 사람을 AI가 생성한 영상에 삽입하여 소름 끼칠 정도로 사실적인 영상을 만들 수 있습니다.

따라서 많은 전문가들은 소라가 딥페이크 확산을 초래하여 정보를 왜곡하고 현실과 허구의 경계를 모호하게 만들 것을 우려하고 있습니다. 특히 유명인들이 취약한 상황이며, 이에 따라 SAG-AFTRA와 같은 단체들은 OpenAI에 보호 강화를 촉구하고 있습니다.

AI가 생성한 콘텐츠를 식별하는 것은 기술 기업, 소셜 미디어 플랫폼, 그리고 사용자 모두에게 큰 과제입니다. 하지만 Sora를 사용하여 제작된 영상을 인식하는 방법이 있습니다.

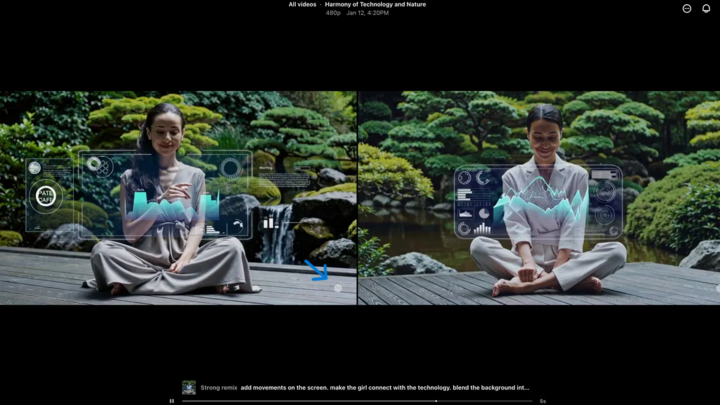

소라 워터마크를 찾아보세요

소라 워터마크(파란색 화살표로 표시됨)는 해당 영상을 제작하는 데 사용된 도구를 식별하는 표시입니다. (출처: CNET)

Sora iOS 앱에서 제작된 모든 동영상은 다운로드 시 워터마크가 표시됩니다. 흰색 Sora 로고(구름 아이콘)가 동영상 가장자리를 따라 움직이며, 이는 TikTok의 워터마크와 유사합니다.

이는 AI가 생성한 콘텐츠를 식별하는 시각적인 방법입니다. 예를 들어, 구글의 제미니 "나노 바나나" 모델은 이미지에 자동으로 워터마크를 추가합니다. 하지만 워터마크가 항상 신뢰할 수 있는 것은 아닙니다. 정적인 워터마크는 쉽게 잘라낼 수 있고, 소라의 경우처럼 동적인 워터마크조차도 특수 애플리케이션을 사용하면 제거할 수 있습니다.

이에 대해 오픈AI CEO 샘 알트만은 누구나 가짜 영상을 만들 수 있다는 현실에 사회가 적응해야 한다고 주장했습니다. 소라 이전에는 이처럼 대중적이고 접근성이 좋으며 특별한 기술 없이도 가짜 영상을 제작할 수 있는 도구가 존재하지 않았습니다. 그의 관점은 대안적인 검증 방법에 의존해야 할 필요성을 강조합니다.

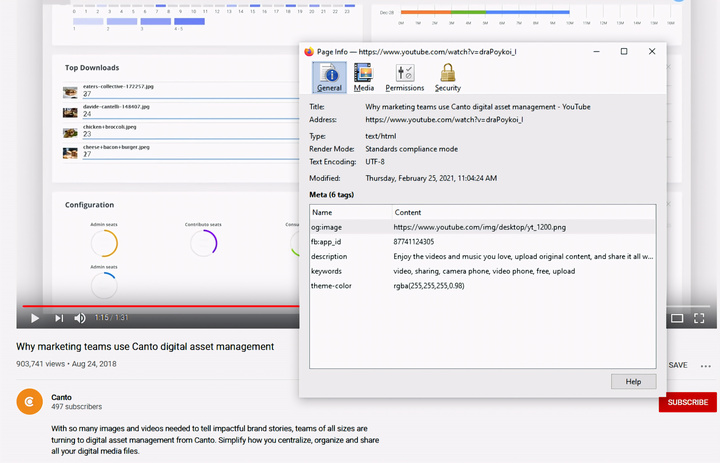

메타데이터를 확인하세요

메타데이터 확인은 소라처럼 AI가 제작한 영상인지 여부를 판단하는 데 중요한 단계입니다. (출처: Canto)

메타데이터를 확인하는 것이 너무 복잡하다고 생각할 수도 있지만, 실제로는 매우 간단하고 효과적입니다.

메타데이터는 카메라 종류, 위치, 녹화 시간, 파일 이름 등 콘텐츠 생성 시 자동으로 첨부되는 정보 집합입니다. 콘텐츠가 사람이 제작했든 AI가 생성했든 관계없이 메타데이터가 포함됩니다. AI 생성 콘텐츠의 경우 메타데이터에는 출처 정보가 포함되는 경우가 많습니다.

OpenAI는 콘텐츠 출처 및 진위성 연합(C2PA)의 회원사이므로 Sora 동영상에는 C2PA 메타데이터가 포함됩니다. 콘텐츠 진위성 이니셔티브의 검증 도구를 사용하여 이를 확인할 수 있습니다.

메타데이터를 확인하는 방법:

- verify.contentauthenticity.org를 방문하세요.

- 검토할 파일을 업로드하세요.

- "열기"를 누르세요

- 오른쪽 표의 정보를 참조하십시오.

AI가 제작한 영상이라면 요약 설명에 그 사실이 명확하게 표시됩니다. 소라 영상을 확인할 때 "OpenAI에서 게시"라는 문구와 함께 AI를 사용하여 제작되었다는 정보가 표시됩니다. 모든 소라 영상에는 출처를 확인할 수 있도록 이러한 정보가 반드시 포함되어야 합니다.

출처: https://vtcnews.vn/cach-nhan-biet-video-that-hay-do-ai-tao-ar972891.html

![[사진] 팜 민 찐 총리가 주베트남 중국 대사를 접견하고 있다](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/04/05/1775397481797_ndo_br_dsc-5512-jpg.webp)

댓글 (0)