|

Sztuczna inteligencja nie jest jeszcze w stanie zastąpić ludzi w dziedzinie programowania. Zdjęcie: John McGuire . |

Ostatnio wiodące modele sztucznej inteligencji (AI) firm OpenAI i Anthropic są coraz częściej wykorzystywane w aplikacjach programistycznych. ChatGPT i Claude mają zwiększoną pamięć i moc obliczeniową, umożliwiającą analizę setek linii kodu, a Gemini integruje dedykowaną funkcję wyświetlania wyników Canvas dla programistów.

W październiku 2024 roku Sundar Pichai, prezes Google, stwierdził, że 25% nowego kodu w firmie zostało wygenerowane przez sztuczną inteligencję. Mark Zuckerberg, prezes Meta, również wyraził ambicje szerokiego wdrożenia modeli kodowania opartych na sztucznej inteligencji w korporacji.

Jednak nowe badanie przeprowadzone przez Microsoft Research, dział badań i rozwoju firmy Microsoft, pokazuje, że modele sztucznej inteligencji, w tym Claude 3.7 Sonnet firmy Anthropic i o3-mini firmy OpenAI, nie radzą sobie z wieloma błędami w teście porównawczym programowania o nazwie SWE-bench Lite.

Autorzy badania przeanalizowali dziewięć różnych modeli sztucznej inteligencji, które wykorzystywały szereg narzędzi debugowania, takich jak debugger Pythona, i były w stanie obsłużyć problemy w ramach jednego polecenia. Modele miały za zadanie rozwiązać 300 błędów oprogramowania wybranych z zestawu danych SWE-bench Lite.

|

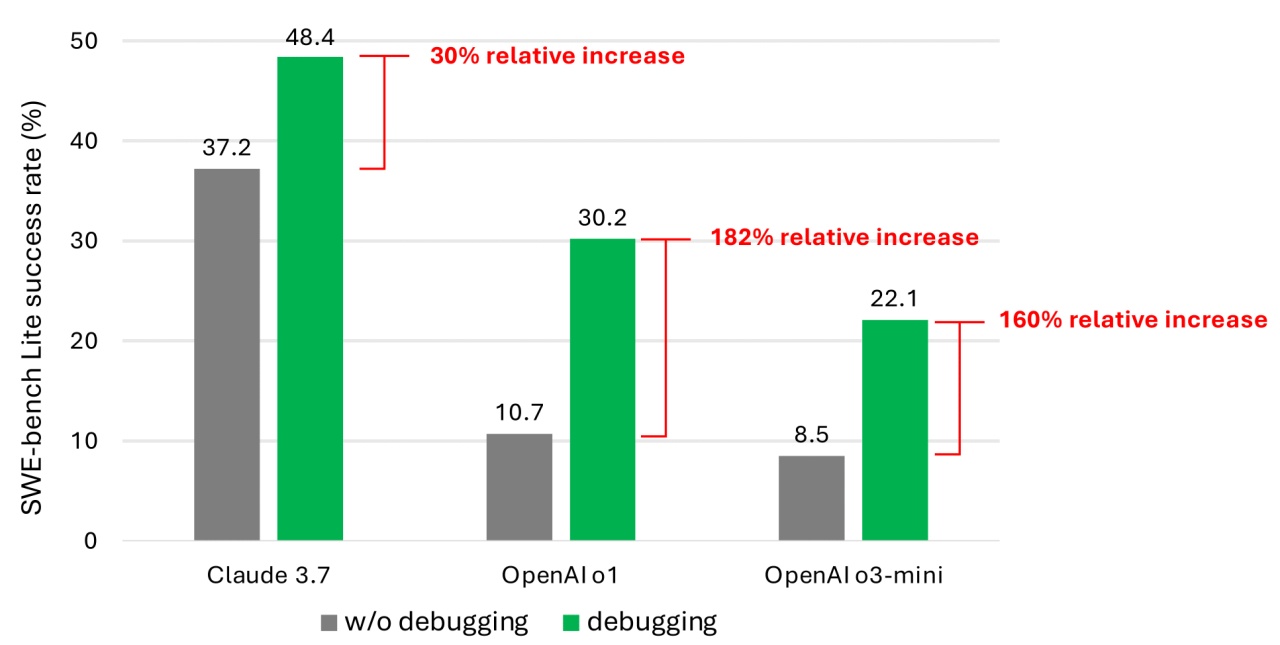

Wskaźnik sukcesu przy rozwiązywaniu problemów programistycznych z zestawu danych SWE-bench Lite. Grafika: Microsoft. |

Nawet w przypadku wyposażenia w bardziej wydajne i nowsze modele, wyniki pokazały, że agent AI rzadko z powodzeniem wykonywał więcej niż połowę przypisanych zadań debugowania. Spośród przetestowanych modeli, Claude 3.7 Sonnet osiągnął najwyższy średni wskaźnik sukcesu – 48,4%, następnie o1 firmy OpenAI (30,2%) i o3-mini (22,1%).

Niektóre z przyczyn niskiej wydajności, o których mowa powyżej, obejmują brak zrozumienia przez niektóre modele sposobu stosowania udostępnionych narzędzi do debugowania. Ponadto, zdaniem autorów, poważniejszym problemem jest brak wystarczającej ilości danych.

Argumentują, że systemowi szkoleniowemu modeli wciąż brakuje danych symulujących kroki debugowania, które ludzie wykonują od początku do końca. Innymi słowy, sztuczna inteligencja nie nauczyła się wystarczająco dużo o tym, jak ludzie myślą i działają krok po kroku, radząc sobie z rzeczywistym błędem oprogramowania.

Szkolenie i udoskonalanie modeli pomoże im stać się bardziej biegłymi w debugowaniu oprogramowania. „Będzie to jednak wymagało specjalistycznych zestawów danych do procesu szkolenia” – stwierdzili autorzy.

Liczne badania wskazują na luki w zabezpieczeniach i błędy w sztucznej inteligencji podczas generowania kodu, wynikające ze słabości, takich jak ograniczone zrozumienie logiki programowania. Niedawny przegląd Devina, narzędzia programistycznego opartego na sztucznej inteligencji, wykazał, że narzędzie to ukończyło tylko 3 z 20 testów programistycznych.

Możliwości programistyczne sztucznej inteligencji (AI) pozostają przedmiotem ożywionej debaty. Wcześniej Kevin Weil, dyrektor ds. produktu w OpenAI, zasugerował, że do końca tego roku sztuczna inteligencja prześcignie programistów.

Z drugiej strony, Bill Gates, współzałożyciel Microsoftu, wierzy, że programowanie pozostanie stabilnym zajęciem w przyszłości. Inni liderzy, tacy jak Amjad Masad (prezes Replit), Todd McKinnon (prezes Okta) i Arvind Krishna (prezes IBM), również wyrazili poparcie dla tego poglądu.

Choć badania Microsoftu nie są nowe, stanowią przestrogę dla programistów, a także menedżerów, aby zastanowili się dokładniej, zanim oddadzą pełną kontrolę nad kodowaniem sztucznej inteligencji.

Źródło: https://znews.vn/diem-yeu-chi-mang-cua-ai-post1545220.html

Komentarz (0)