|

A inteligência artificial ainda não é capaz de substituir os humanos na área da programação. Foto: John McGuire . |

Recentemente, os principais modelos de IA da OpenAI e da Anthropic estão sendo cada vez mais utilizados em aplicações de programação. O ChatGPT e o Claude aumentaram a memória e o poder de processamento para analisar centenas de linhas de código, enquanto o Gemini integra um recurso dedicado de exibição de resultados em Canvas para programadores.

Em outubro de 2024, Sundar Pichai, CEO do Google, afirmou que 25% dos novos códigos da empresa eram gerados por IA. Mark Zuckerberg, CEO da Meta, também expressou a ambição de implementar amplamente modelos de codificação com IA dentro da corporação.

No entanto, um novo estudo da Microsoft Research, divisão de P&D da Microsoft, mostra que modelos de IA, incluindo o Claude 3.7 Sonnet da Anthropic e o o3-mini da OpenAI, são incapazes de lidar com muitos erros em um benchmark de programação chamado SWE-bench Lite.

Os autores do estudo examinaram nove modelos de IA diferentes que incorporavam uma variedade de ferramentas de depuração, como um depurador de Python, e eram capazes de lidar com problemas em uma única instrução. Os modelos foram incumbidos de resolver 300 bugs de software selecionados do conjunto de dados SWE-bench Lite.

|

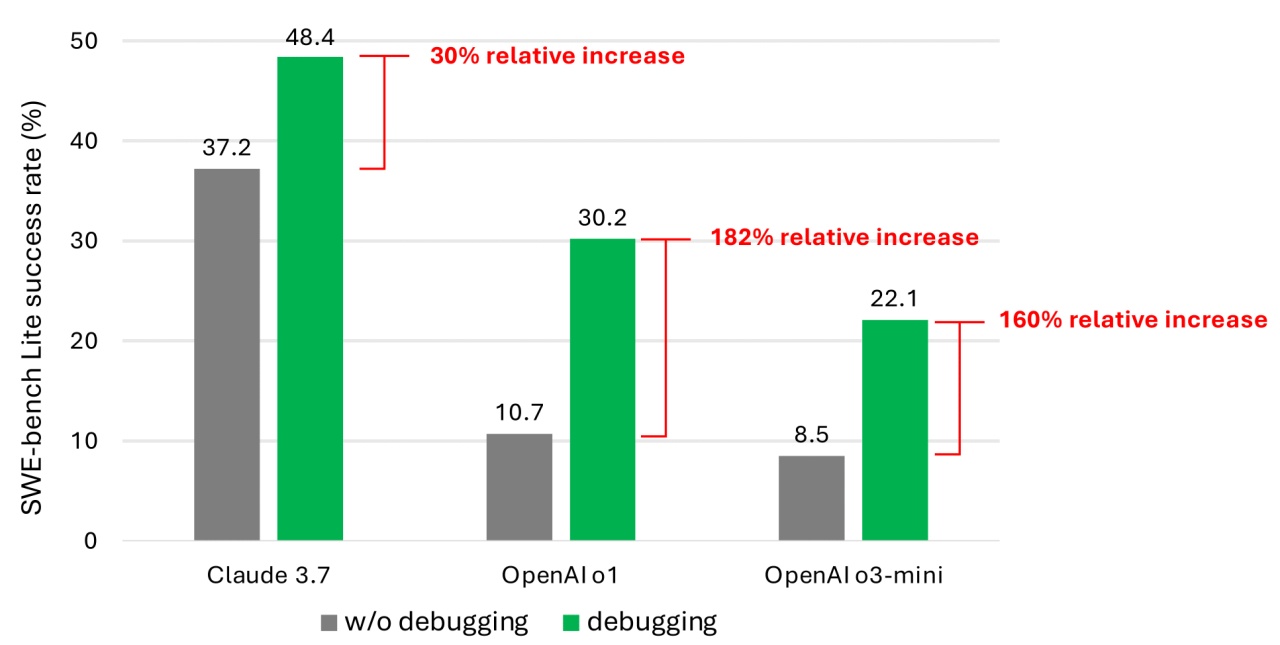

Taxa de sucesso na resolução de problemas de programação a partir do conjunto de dados SWE-bench Lite. Imagem: Microsoft. |

Mesmo equipados com modelos mais potentes e recentes, os resultados mostraram que o agente de IA raramente concluiu com sucesso mais da metade das tarefas de depuração atribuídas. Entre os modelos testados, o Claude 3.7 Sonnet alcançou a maior taxa média de sucesso, com 48,4%, seguido pelo o1 da OpenAI, com 30,2%, e pelo o3-mini, com 22,1%.

Algumas razões para o baixo desempenho mencionado acima incluem o fato de alguns modelos não saberem como aplicar as ferramentas de depuração fornecidas. Além disso, segundo os autores, um problema ainda maior reside na falta de dados suficientes.

Eles argumentam que o sistema de treinamento dos modelos ainda carece de dados que simulem as etapas de depuração que os humanos realizam do início ao fim. Em outras palavras, a IA não aprendeu o suficiente sobre como os humanos pensam e agem passo a passo ao lidar com um bug de software real.

O treinamento e o aprimoramento dos modelos os ajudarão a se tornarem mais proficientes na depuração de software. "No entanto, isso exigirá conjuntos de dados especializados para o processo de treinamento", afirmaram os autores.

Diversos estudos apontaram vulnerabilidades de segurança e erros em IA durante a geração de código, devido a fragilidades como a compreensão limitada da lógica de programação. Uma análise recente do Devin, uma ferramenta de programação baseada em IA, mostrou que ela completou apenas 3 dos 20 testes de programação.

As capacidades de programação da IA continuam sendo um tema de muito debate. Anteriormente, Kevin Weil, Diretor de Produto da OpenAI, sugeriu que, até o final deste ano, a IA superaria os programadores humanos.

Por outro lado, Bill Gates, cofundador da Microsoft, acredita que a programação continuará sendo uma carreira sustentável no futuro. Outros líderes, como Amjad Masad (CEO da Replit), Todd McKinnon (CEO da Okta) e Arvind Krishna (CEO da IBM), também manifestaram apoio a essa visão.

A pesquisa da Microsoft, embora não seja nova, serve como um lembrete para programadores, incluindo gerentes, de que devem pensar com mais cuidado antes de entregar a autoridade completa de programação à IA.

Fonte: https://znews.vn/diem-yeu-chi-mang-cua-ai-post1545220.html

![[Foto] Meu filho à noite: um patrimônio milenar em meio à Via Láctea.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/04/15/1776261039184_ndo_br_chon6-jpg.webp)

![[Foto] A Sra. Ngo Phuong Ly se encontra e troca ideias com a Sra. Peng Li Yuan.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/04/16/1776277858080_phu-nhan-1-jpg.webp)

![[Foto] O presidente da Assembleia Nacional, Tran Thanh Man, participa da sessão de abertura da IPU-152.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/04/16/1776277863731_ctqh5-jpg.webp)

![[Foto] O Secretário-Geral, o Presidente e sua esposa se reúnem com líderes das relações de amizade entre Vietnã e China.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/04/15/1776264829725_vna-potal-tong-bi-thu-chu-tich-nuoc-to-lam-gap-mat-nhan-sy-huu-nghi-viet-nam-trung-quoc-8703641-3130-jpg.webp)

Comentário (0)