Este timpul ca fiecare utilizator să devină un „scut digital”, fiind alert, vigilent și responsabil cu fiecare clic și distribuire.

Beneficiile și linia fină a inteligenței artificiale

Niciodată până acum inteligența artificială nu a fost atât de aproape de viața de zi cu zi. Cu doar câteva clicuri și o comandă scurtă, putem crea voci, imagini și chiar videoclipuri cu un realism uimitor. IA economisește timp, reduce costurile de producție de conținut și inaugurează o eră a mediilor digitale flexibile.

Totuși, însăși această capacitate de a „simula realitatea într-un mod realist” a devenit o sabie cu două tăișuri. Recent, rețelele de socializare au fost inundate de videoclipuri create folosind tehnologia deepfake, în care fețele liderilor poliției și imaginile ofițerilor de aplicare a legii în cazuri sensibile sunt manipulate și distorsionate cu voiceover-uri pentru a induce în eroare și a diviza publicul.

Imaginile puse în scenă de acest gen devin din ce în ce mai frecvente pe rețelele de socializare.

Într-un clip viral de pe TikTok, imaginile unui ofițer de poliție rutieră în timpul serviciului au fost juxtapuse cu dialoguri jignitoare, însoțite de hashtagul „amenzi doar de prezentare”, sugerând că ofițerul a abuzat de puterea sa în scop personal. Mulți utilizatori, în special tinerii, au crezut cu ușurință acest conținut, deoarece imaginile erau atât de realiste, iar vocea se potrivea îndeaproape cu mișcările buzelor, ceea ce făcea extrem de dificilă distincția între real și fals.

Pur și simplu pentru că a vrut să-și „etaleze” abilitățile tehnologice cu inteligență artificială, un tânăr YouTuber din Dien Bien a plătit prețul cu o amendă administrativă și scuze publice forțate. În după-amiaza zilei de 24 ianuarie, Poliția Provincială Dien Bien a anunțat că Departamentul de Securitate Cibernetică și Prevenire a Criminalității de Înaltă Tehnologie a emis o amendă administrativă de 7,5 milioane VND împotriva lui Tong Van T. (născut în 2001, domiciliat în districtul Muong Ang) pentru utilizarea inteligenței artificiale pentru a crea un videoclip fabricat care conținea conținut distorsionat și insultător la adresa ofițerilor de poliție rutieră.

Mai exact, pe 7 ianuarie, T. a încărcat pe contul său de YouTube „Tuyen Vlog” un videoclip de peste 3 minute cu titlul șocant: „În timp ce eram afară, am fost urmărită de poliția rutieră”. În videoclip, imaginile și situațiile au fost puse în scenă folosind tehnologia inteligenței artificiale, simulând poliția rutieră urmărind cetățeni și au fost combinate cu efecte și comentarii jignitoare și defăimătoare la adresa forțelor de ordine.

În colaborare cu poliția, T. a recunoscut că întregul conținut al videoclipului era un produs fabricat, creat în scopuri de „divertisment” și pentru a-și demonstra capacitatea de a utiliza tehnologia inteligenței artificiale. Pe lângă amendă, autoritățile i-au ordonat lui T. să elimine videoclipul fals și să își ceară public scuze poliției rutiere pe canalul său personal de YouTube.

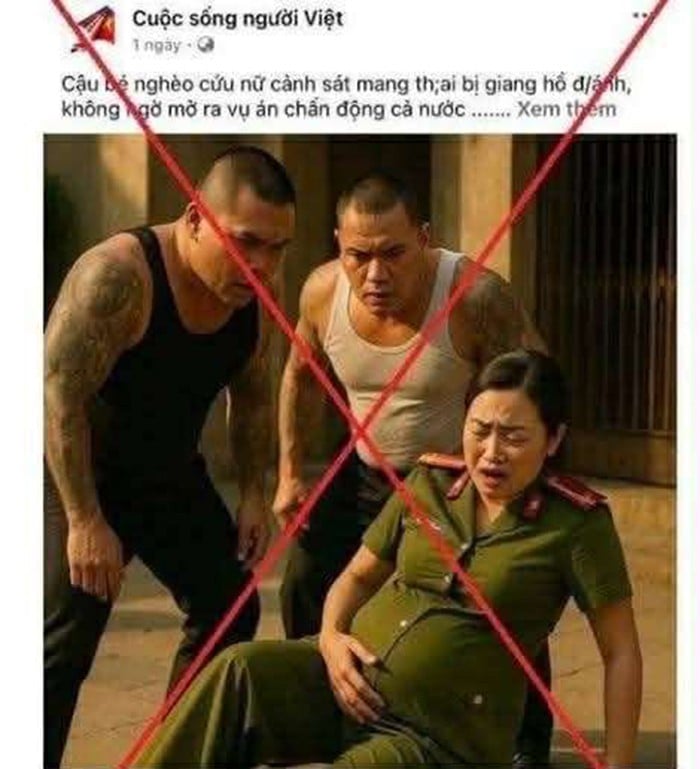

În era revoluției digitale , în special a dezvoltării rapide a inteligenței artificiale, forțele ostile și reacționare nu au ezitat să exploateze acest instrument pentru a crea imagini și povești fabricate, menite să distorsioneze și să păteze imaginea Forțelor Poliției Populare Vietnameze. O fotografie care a circulat recent pe rețelele de socializare, care arată o femeie însărcinată în uniformă de poliție amenințată de doi bărbați cu aspect de „gangster”, este o dovadă clară a acestei tactici.

Imaginea, creată cu ajutorul inteligenței artificiale, a devenit recent virală pe rețelele de socializare.

La prima vedere, spectatorii ar putea confunda cu ușurință această scenă cu cea reală, însoțită de titluri senzaționale precum: „Săracul băiat salvează o polițistă însărcinată care era atacată de gangsteri, dezvăluind fără să știe un caz care șochează întreaga națiune...”. Cu toate acestea, aceasta este de fapt doar o scenă pusă în scenă, posibil dintr-un film sau un produs de divertisment sau, mai rău, o imagine creată de inteligența artificială pentru a înșela emoțiile cititorului, determinându-l să simtă milă și să se îndoiască de autenticitatea forțelor de ordine.

Mai îngrijorător este faptul că răspândirea unui astfel de conținut nu numai că dăunează reputației și imaginii Forțelor Poliției Populare, care lucrează zi și noapte pentru a proteja securitatea și ordinea societății, dar constituie și o formă sofisticată de război psihologic. Atunci când încrederea oamenilor în autorități este erodată de imagini înșelătoare, motivele ascunse ale forțelor ostile de a diviza unitatea națională vor fi treptat realizate.

Prin urmare, fiecare cetățean trebuie să își sporească vigilența, să își dezvolte abilități de gândire critică și capacitatea de a identifica informațiile false și să denunțe și să respingă cu fermitate conținutul fals, contribuind la protejarea fundamentului ideologic și la menținerea stabilității sociale în fața valului actual de informații dăunătoare de pe internet.

În orașul Ho Și Min, un videoclip de aproape un minut a devenit viral în mod neașteptat pe rețelele de socializare, arătând o persoană în uniformă de poliție „constrângând” un suspect să mărturisească o încălcare a regulilor de circulație într-un birou. În videoclip, persoana despre care se crede că este ofițer de poliție manifestă o atitudine agresivă, țipă constant și chiar folosește un limbaj vulgar, provocând indignarea publică.

Totuși, la scurt timp după ce videoclipul a devenit viral, Poliția din Ho Chi Minh a investigat rapid și a confirmat că era vorba de un deepfake sofisticat. Conform descoperirilor lor, fețele din videoclip au fost extrase dintr-o înregistrare a unei conferințe interne a poliției, apoi manipulate de persoane rău intenționate folosind tehnologia inteligenței artificiale pentru a le suprapune pe o scenă înscenată, făcându-i pe telespectatori să creadă că a fost un eveniment real.

În special, înregistrarea audio însoțitoare include voci amenințătoare și insultătoare care nu sunt de fapt cuvintele reale ale vreunui oficial, ci mai degrabă voci sintetizate de inteligență artificială, programate și editate pentru a înșela emoțiile spectatorului.

Acest incident este un exemplu excelent al utilizării tehnologiei deepfake pentru a denatura și defăima Forțele Poliției Populare, o tactică exploatată din ce în ce mai mult de forțele reacționare și subversive din spațiul cibernetic. În mod semnificativ, dacă nu sunt expuse prompt, astfel de produse false pot duce la consecințe grave: subminarea încrederii publicului în forțele de ordine, incitarea la rezistență în cadrul comunității și facilitarea răspândirii unor narațiuni false. Aceasta servește drept un avertisment clar cu privire la nevoia urgentă de a îmbunătăți capacitățile de comunicare pentru a infirma, detecta și combate știrile false și face apel la fiecare cetățean să fie vigilent și să se abțină de la distribuirea sau comentarea în grabă a conținutului neverificat din surse oficiale.

Într-un alt caz recent, care a implicat gestionarea neregulilor la un centru de inspecție auto din Sud, elemente ostile au răspândit o înregistrare video falsă cu un lider al poliției provinciale care vorbea în apărarea oficialilor corupți. Această înregistrare, răspândită pe Telegram și pe rețelele de socializare cu titlul „susținut de forțe puternice”, a fost de fapt un produs al inteligenței artificiale și nu a apărut în nicio conferință de presă sau document oficial.

O tendință periculoasă se răspândește în mod discret online: actorii rău intenționați folosesc tehnologia inteligenței artificiale pentru a crea videoclipuri false în scopul fraudei și extorcării. Recent, multe persoane au devenit victime atunci când imaginile lor, în special cele ale unor persoane respectate social, cum ar fi avocați, medici și oameni de afaceri, sunt suprapuse peste videoclipuri care promovează „recuperarea banilor pierduți în escrocheriile online”.

În aceste videoclipuri, inteligența artificială este folosită pentru a imita vocea și chipul avocaților, făcându-i pe telespectatori să creadă escrocii și să le ofere cu ușurință informații personale sau să le transfere bani. Și mai periculos este faptul că unii infractori folosesc tehnologia deepfake pentru a suprapune fețele victimelor pe videoclipuri sexuale, apoi le trimit soților/soțiilor sau colegilor cu intenția de a-i amenința sau de a-i constrânge să transfere bani pentru a „pătra tăcerea”.

Un incident șocant a avut loc în martie 2025, când o victimă din Hanoi a fost rugată să transfere zeci de milioane de dong după ce a primit un videoclip sexual fals în care apare. Între timp, în orașul Ho Chi Minh, o altă persoană a fost șantajată pentru 2 miliarde de dong dacă nu dorea ca videoclipul sensibil să se răspândească. Ministerul Securității Publice a lansat o anchetă, identificând mai multe grupuri criminale transnaționale, în principal din China și Asia de Sud-Est, în spatele acestor rețele, folosind cartele SIM de unică folosință, portofele electronice și platforme de socializare pentru a-și ascunde identitatea.

Aceasta nu mai este o înșelătorie măruntă, ci o formă de „război psihologic de înaltă tehnologie”, care exploatează profund temerile legate de onoare și relațiile sociale pentru a pune presiune pe victime. Fără o vigilență sporită și abilități în identificarea informațiilor și comportamentelor neobișnuite, oricine poate deveni pradă acestor infractori de înaltă tehnologie. În fața acestui val sofisticat de uzurpare de identitate, fiecare cetățean trebuie să fie vigilent, să se abțină absolut de la partajarea fără discriminare a informațiilor personale și să fie pregătit să se pronunțe împotriva activităților ilegale, contribuind la protejarea propriei siguranțe și a comunității.

Este nevoie de un „scut digital” din partea comunității pentru a combate amenințarea deepfake-urilor.

Potrivit Departamentului de Radiodifuziune, Televiziune și Informații Electronice (Ministerul Culturii, Sportului și Turismului), în 2024, platformele digitale din Vietnam au fost nevoite să elimine peste 4.000 de videoclipuri care conțineau informații false și distorsionate, majoritatea fiind produse create folosind tehnologia inteligenței artificiale, cum ar fi deepfake-uri și clone vocale. Numai TikTok - o platformă populară în rândul tinerilor - a fost solicitată să șteargă peste 1.300 de videoclipuri deepfake, legate în principal de forțele de poliție, guvern și politici sociale.

În era boom-ului tehnologic, inteligența artificială deblochează un potențial inovator, dar aduce și pericole fără precedent, în special produse deepfake care conțin conținut distorsionat ce atacă reputația agențiilor guvernamentale. Un sondaj realizat de Institutul de Cercetare Media MICRI arată că 62% dintre utilizatorii de rețele sociale din Vietnam nu pot distinge între informațiile reale și cele false fără avertismente din partea mass-media sau a autorităților. Aceasta este o „lacuna cognitivă” pe care forțele rău intenționate o exploatează pe deplin pentru a răspândi dezinformare și a perturba psihologia socială.

Tong Van T. la secția de poliție.

Potrivit generalului-maior, profesor asociat și doctor Do Canh Thin, expert în criminologie, utilizarea inteligenței artificiale pentru a crea videoclipuri false care se prezintă ca lideri, a edita declarații false sau a distorsiona acțiunile profesionale ale forțelor de poliție este o tactică nouă, dar deosebit de periculoasă. „Deepfake nu este doar un produs de divertisment, ci o formă de război informațional modern, capabilă să submineze încrederea, să provoace instabilitate socială și este foarte dificil de controlat”, a declarat generalul-maior Do Canh Thin.

În realitate, videoclipurile manipulate de inteligența artificială sunt departe de a fi inofensive; acestea vizează adesea subiecte sensibile, cum ar fi gestionarea încălcărilor, investigarea infracțiunilor și combaterea corupției, provocând confuzie publică și neîncredere față de forțele de ordine. Și mai îngrijorător este faptul că multe videoclipuri sunt distribuite pe platforme importante precum YouTube și TikTok, acumulând sute de mii de vizualizări înainte de a fi eliminate, creând un efect negativ în lanț.

Expertul în media digitală Hoang Minh avertizează: „O singură distribuire sau un like din neglijență te poate transforma în complice la știri false. Fiecare utilizator de internet trebuie să înțeleagă că acțiunile din spațiul digital au și consecințe reale.”

În acest context, ceea ce este necesar mai mult ca niciodată este construirea unui „scut digital” din interiorul comunității însăși: adică vigilență, imunitate informațională și un simț al responsabilității față de mediul online. Tehnologia poate fi neutră, dar modul în care oamenii o folosesc va determina dacă IA devine o forță motrice pentru dezvoltare sau o forță distructivă împotriva încrederii sociale. Menținerea statorniciei ideologice și protejarea imaginii ofițerului de poliție reprezintă protejarea fundamentului securității naționale - o sarcină nu numai pentru autoritățile relevante, ci pentru fiecare cetățean în era digitală.

Sursă: https://baolangson.vn/tinh-hai-mat-cua-ai-5050403.html

![[Foto] Prim-ministrul Pham Minh Chinh prezidează un dialog cu mediul de afaceri japonez.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/03/21/1774097547316_ndo_br_dsc-0448-jpg.webp)

Comentariu (0)