|

OpenAIs chatbot förbättras ständigt genom nya teknologier. Foto: New York Times . |

I september 2024 lanserade OpenAI ChatGPT, en version av AI som integrerar o1-modellen, kapabel att resonera i uppgifter relaterade till matematik, naturvetenskap och datorprogrammering.

Till skillnad från den tidigare versionen av ChatGPT kommer den nya tekniken att ta tid att "tänka" på lösningar på komplexa problem innan den ger ett svar.

Efter OpenAI har många konkurrenter som Google, Anthropic och DeepSeek också introducerat liknande resonemangsmodeller. Även om det inte är perfekt är detta fortfarande en teknik för uppgradering av chatbotar som många utvecklare litar på.

Hur AI resonerar

I grund och botten innebär resonemang att chatbotar kan lägga mer tid på att lösa problem som användare ställer.

"Resonemang är hur systemet utför ytterligare arbete efter att ha mottagit en fråga", sa Dan Klein, professor i datavetenskap vid University of California, till New York Times .

Ett logiskt system kan dela upp ett problem i mindre, individuella steg, eller lösa det genom trial and error.

När ChatGPT först lanserades kunde det svara på frågor direkt genom att extrahera och syntetisera information. Däremot behövde resonemangssystem några sekunder (eller till och med minuter) längre för att lösa problemet och ge ett svar.

|

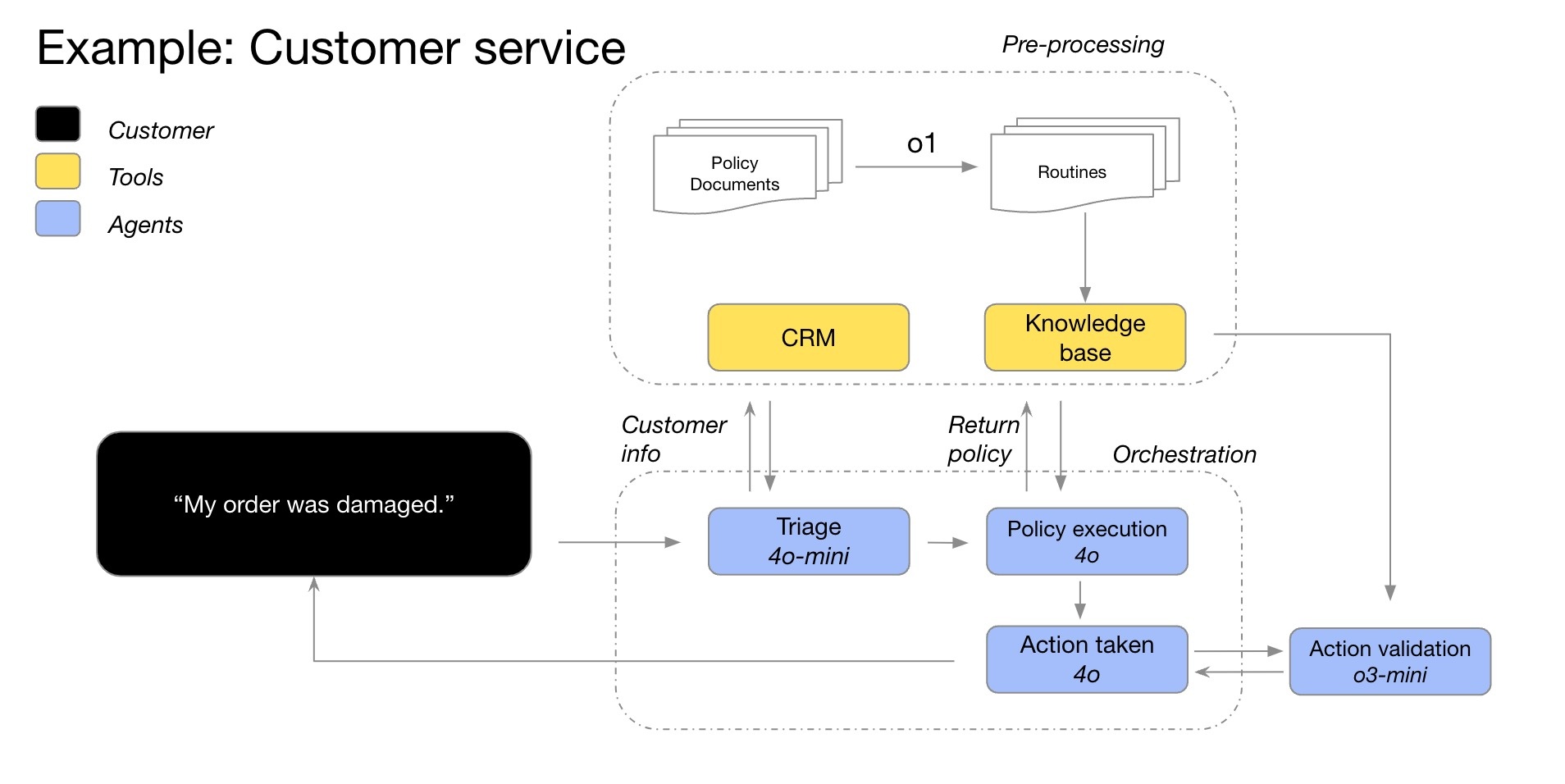

Ett exempel på resonemangsprocessen i O1-modellen i en kundtjänstchatbot. Bild: OpenAI . |

I vissa fall kommer resonemangssystemet att ändra sitt tillvägagångssätt för problemet och kontinuerligt förbättra lösningen. Dessutom kan modellen testa flera lösningar innan ett optimalt val görs, eller kontrollera noggrannheten i tidigare svar.

I allmänhet kommer resonemanget att beakta alla möjliga svar på frågan. Detta liknar det att elever i grundskolan skriver ner många alternativ på papper innan de väljer den lämpligaste lösningen på ett matteproblem.

Enligt New York Times kan AI nu resonera om nästan vilket ämne som helst. Den kommer dock att vara mest effektiv med frågor relaterade till matematik, naturvetenskap och datorprogrammering.

Hur tränas det teoretiska systemet?

På en typisk chatbot kan användare fortfarande begära förklaringar av processen eller verifiera svarets riktighet. Faktum är att många ChatGPT-utbildningsdataset redan innehåller problemlösningsprocedurer.

Resonemangssystemet blir ännu mer avancerat när det kan utföra operationer utan användarinmatning. Denna process är mer komplex och omfattande. Företag använder ordet "resonemang" eftersom systemet fungerar på liknande sätt som människor tänker.

Många företag, som OpenAI, förväntar sig att resonemangssystem är den bästa lösningen för att förbättra de chattrobotar som finns tillgängliga idag. I åratal trodde de att chattrobotar presterade bättre ju mer information de tränades på internet.

År 2024 kommer AI-system att ha förbrukat nästan all text som finns tillgänglig på internet. Det innebär att företag behöver hitta nya lösningar för att uppgradera chatbotar, inklusive resonemangssystem.

|

Startupföretaget DeepSeek skapade en gång uppståndelse med sin resonemangsmodell som hade lägre kostnader än OpenAI. Foto: Bloomberg . |

Sedan förra året har företag som OpenAI fokuserat på förstärkningsinlärningstekniker. Denna process tar vanligtvis flera månader, under vilken AI:n lär sig beteende genom trial and error.

Genom att till exempel lösa tusentals problem kan systemet identifiera den optimala metoden för att komma fram till rätt svar. Därifrån bygger forskare sofistikerade feedbackmekanismer som hjälper systemet att skilja mellan korrekta och felaktiga lösningar.

"Det är ungefär som hur man tränar en hund. Om systemet fungerar bra ger man den en belöning. Annars säger man: 'Den där hunden är busig'", delade Jerry Tworek, forskare på OpenAI.

Är AI framtiden?

Enligt New York Times är förstärkningsinlärningstekniker effektiva när man hanterar krav inom matematik, naturvetenskap och datorprogrammering. Det är områden där rätta eller felaktiga svar kan definieras tydligt.

Omvänt är förstärkningsinlärning ineffektivt inom skrift, filosofi eller etik – områden där det är svårt att skilja mellan gott och ont. Trots detta hävdar forskare att denna teknik fortfarande kan förbättra AI-prestanda, även med icke-matematiska frågor.

”System kommer att lära sig de vägar som leder till positiva och negativa resultat”, säger Jared Kaplan, vetenskaplig chef på Anthropic.

|

Hemsida för Anthropic, startupföretaget som äger Claude AI-modellen. Foto: Bloomberg . |

Det är viktigt att notera att förstärkningsinlärning och resonemangssystem är två olika koncept. Mer specifikt är förstärkningsinlärning en metod för att bygga resonemangssystem. Detta är det sista träningssteget för att chatbotar ska kunna resonera.

Eftersom det fortfarande är relativt nytt kan forskare ännu inte vara säkra på om chatbot-resonemang eller förstärkningsinlärning kan hjälpa AI att tänka som människor. Det bör noteras att många nuvarande AI-träningstrender utvecklas mycket snabbt i början och sedan gradvis saktar ner.

Dessutom kan chatbotar fortfarande göra misstag. Baserat på sannolikhet kommer systemet att välja den process som mest liknar de data det har lärt sig, oavsett om det är från internet eller genom förstärkningsinlärning. Därför kan chatbotar fortfarande välja felaktiga eller ologiska lösningar.

Källa: https://znews.vn/ai-ly-luan-nhu-the-nao-post1541477.html

![[Foto] Ho Chi Minh-staden dekorerad med flaggor och blommor inför valdagen.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/03/13/1773392076518_anh-man-hinh-2026-03-13-luc-15-53-29.png)

![[Foto] Premiärminister Pham Minh Chinh deltar i invigningsceremonin för Vietnam Space Center.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/03/13/1773397068038_ndo_br_dsc-3366-jpg.webp)

Kommentar (0)