บริษัทยักษ์ใหญ่ด้านเทคโนโลยีกำลังเผชิญกับแรงกดดันที่เพิ่มขึ้นในสหรัฐอเมริกาและยุโรป จากข้อกล่าวหาว่าแอปพลิเคชันของตนทำให้เสพติดและก่อให้เกิดปัญหาสุขภาพจิตในกลุ่มเยาวชน

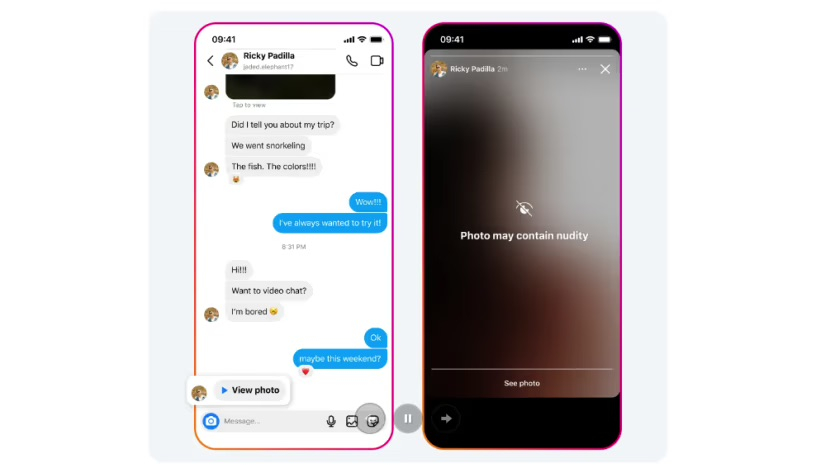

เมื่อมีคนได้รับข้อความใน Instagram ที่มีภาพเปลือย ภาพนั้นจะถูกเบลอโดยอัตโนมัติในหน้าจอแจ้งเตือน (ภาพ: Meta)

Meta ระบุว่าฟีเจอร์ป้องกันข้อความโดยตรงของ Instagram จะใช้เทคโนโลยีการเรียนรู้ของเครื่องบนอุปกรณ์เพื่อวิเคราะห์ว่ารูปภาพที่ส่งผ่านบริการนั้นมีภาพเปลือยหรือไม่

ฟีเจอร์นี้จะเปิดใช้งานโดยค่าเริ่มต้นสำหรับผู้ใช้ที่มีอายุต่ำกว่า 18 ปี และ Meta จะแจ้งเตือนผู้ใหญ่เพื่อกระตุ้นให้พวกเขาเปิดใช้งานฟีเจอร์นี้

บริษัทระบุว่า “เนื่องจากภาพจะถูกวิเคราะห์บนตัวอุปกรณ์เอง คุณสมบัติการป้องกันภาพเปลือยจึงจะทำงานได้ในการสนทนาที่เข้ารหัสแบบ end-to-end ซึ่ง Meta จะไม่สามารถเข้าถึงภาพเหล่านั้นได้ เว้นแต่จะมีผู้ใดรายงานภาพเหล่านั้นให้เราทราบ”

แตกต่างจากแอป Messenger และ WhatsApp ของ Meta ข้อความโดยตรงบน Instagram ไม่ได้เข้ารหัส แต่บริษัทกล่าวว่ามีแผนที่จะใช้การเข้ารหัสสำหรับบริการแชร์รูปภาพของตน

นอกจากนี้ Meta ยังระบุว่าพวกเขากำลังพัฒนาเทคโนโลยีเพื่อช่วยระบุบัญชีที่อาจเกี่ยวข้องกับการหลอกลวงทางเพศ และกำลังทดสอบการเปิดใช้งานการแจ้งเตือนใหม่สำหรับผู้ใช้ที่อาจเคยมีปฏิสัมพันธ์กับบัญชีดังกล่าว

ในเดือนมกราคม Meta ประกาศว่าจะซ่อนเนื้อหาเพิ่มเติมจากวัยรุ่นบน Facebook และ Instagram โดยระบุว่าวิธีนี้จะทำให้เยาวชนเข้าถึงเนื้อหาที่ละเอียดอ่อนได้ยากขึ้น เช่น การฆ่าตัวตาย การทำร้ายตัวเอง และความผิดปกติทางการกิน

ในเดือนตุลาคม 2023 รัฐต่างๆ ในสหรัฐอเมริกา 33 รัฐ รวมถึงแคลิฟอร์เนียและนิวยอร์ก ได้ฟ้องร้องบริษัท Meta โดยกล่าวหาว่าบริษัทเทคโนโลยีแห่งนี้โกหกสาธารณชนซ้ำแล้วซ้ำเล่าเกี่ยวกับอันตรายของแพลตฟอร์มของตน คณะกรรมาธิการยุโรปยังเรียกร้องให้ Meta ปกป้องเด็กจากเนื้อหาที่ผิดกฎหมายและเป็นอันตรายอีกด้วย

ไมอัน (ตามรายงานของ CNA)

[โฆษณา_2]

แหล่งที่มา

การแสดงความคิดเห็น (0)