|

OpenAI, 2018'den bu yana ilk açık kaynaklı yapay zeka modeli olan GPT-OSS'yi piyasaya sürdü. En önemli özelliği, modelin ücretsiz olarak sunulması; kullanıcılar onu indirebilir, özelleştirebilir ve normal bir bilgisayara kurabilirler. (Resim: OpenAI ) |

|

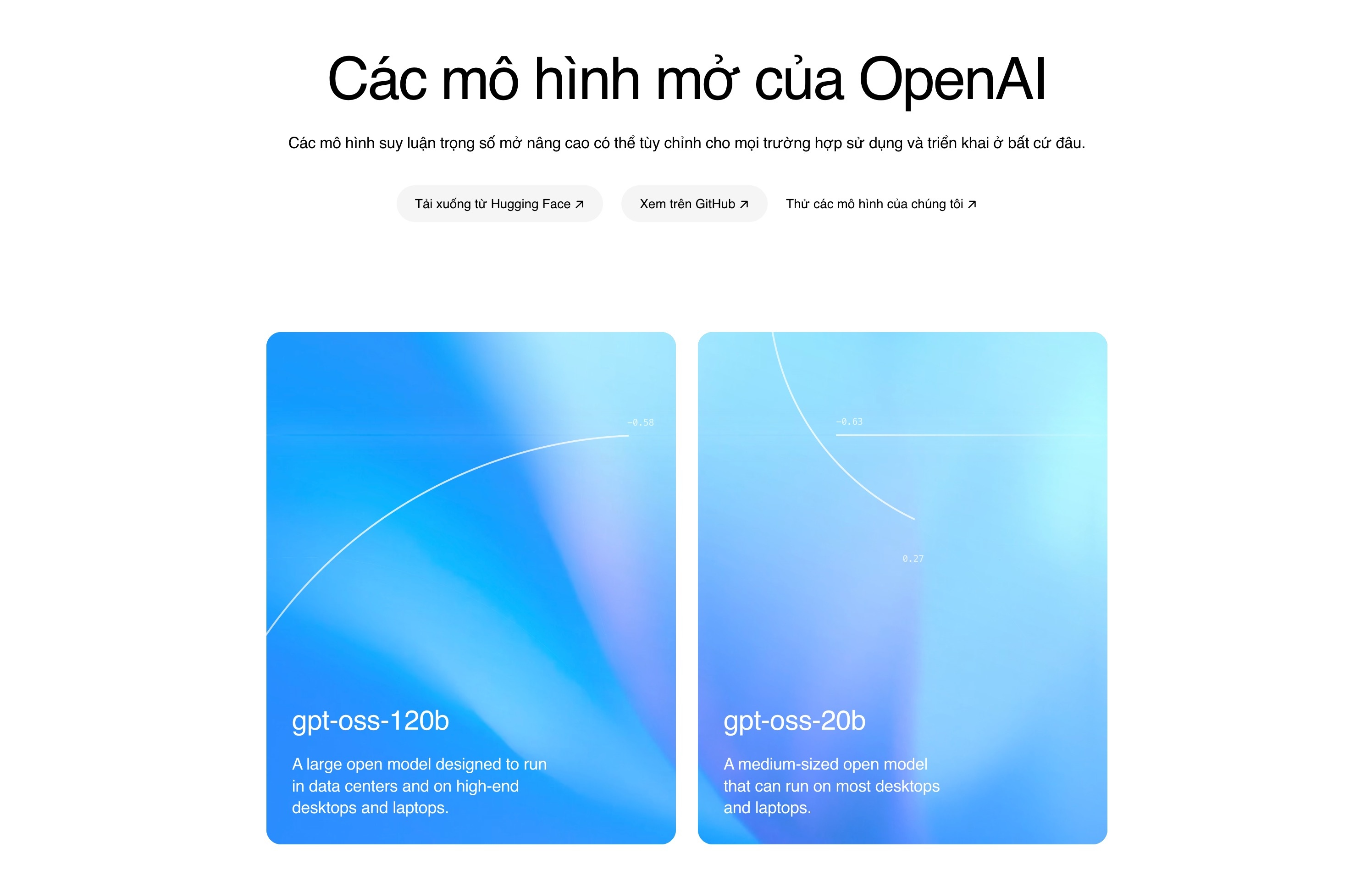

GPT-OSS iki sürümde sunulmaktadır: 20 milyar parametreli sürüm (GPT-OSS-20b) en az 16 GB RAM'e sahip bilgisayarlarda çalışabilirken, 120 milyar parametreli sürüm (GPT-OSS-120b) 80 GB belleğe sahip bir Nvidia GPU'da çalışabilir. OpenAI'ye göre, 120 milyar parametreli sürüm o4-mini'ye eşdeğerdir, 20 milyar parametreli sürüm ise o3-mini modeline benzer şekilde çalışır. |

|

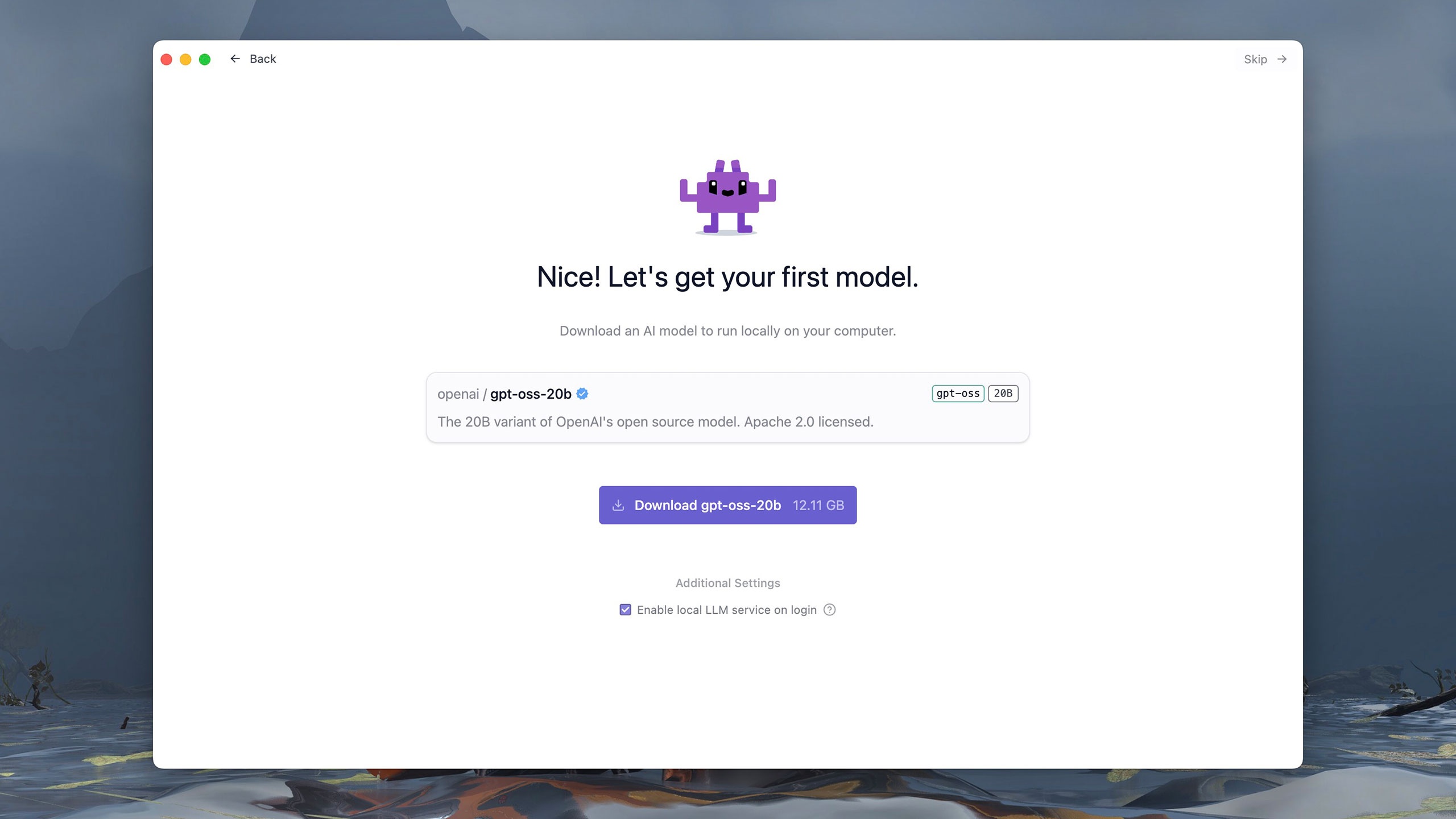

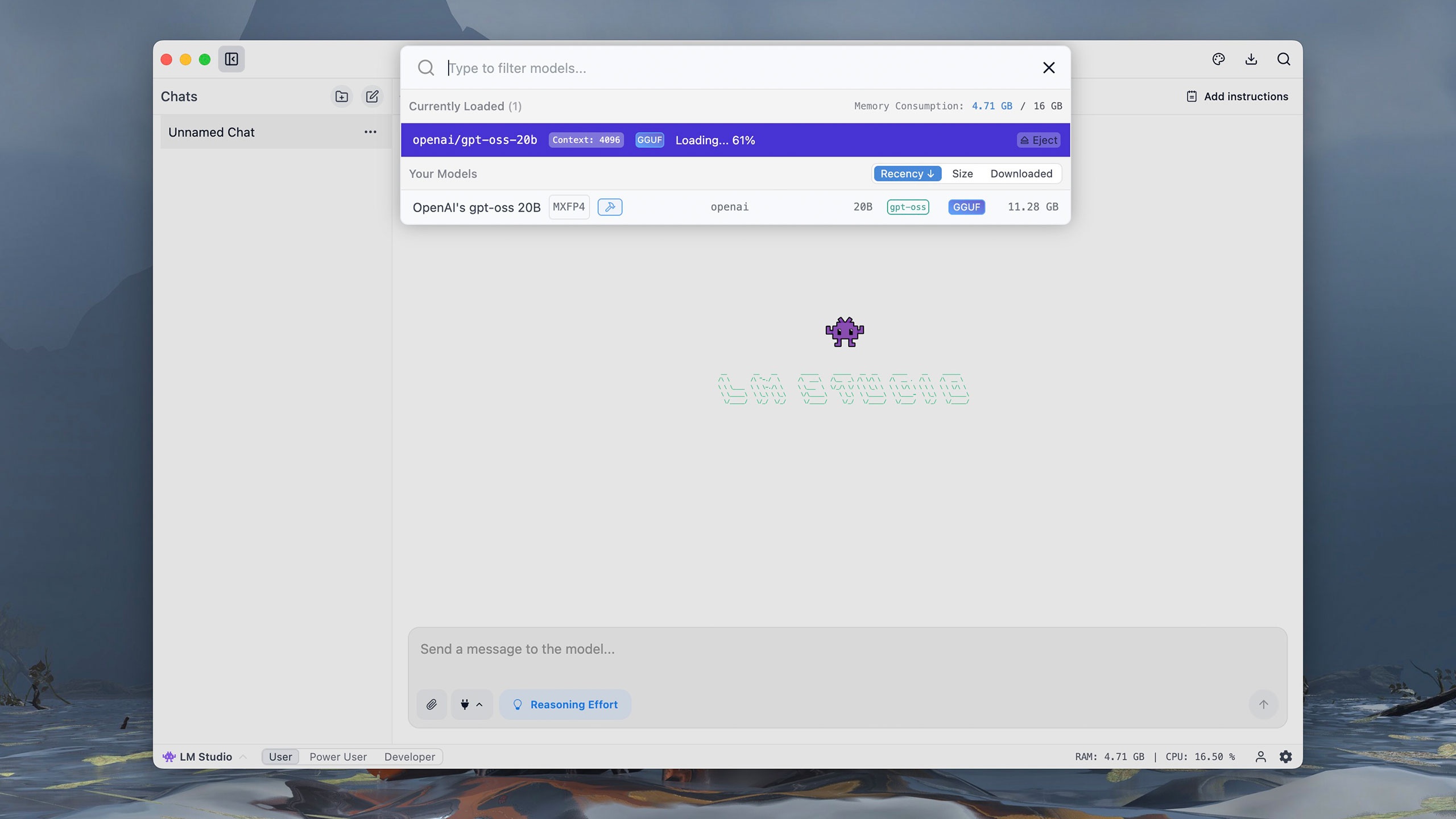

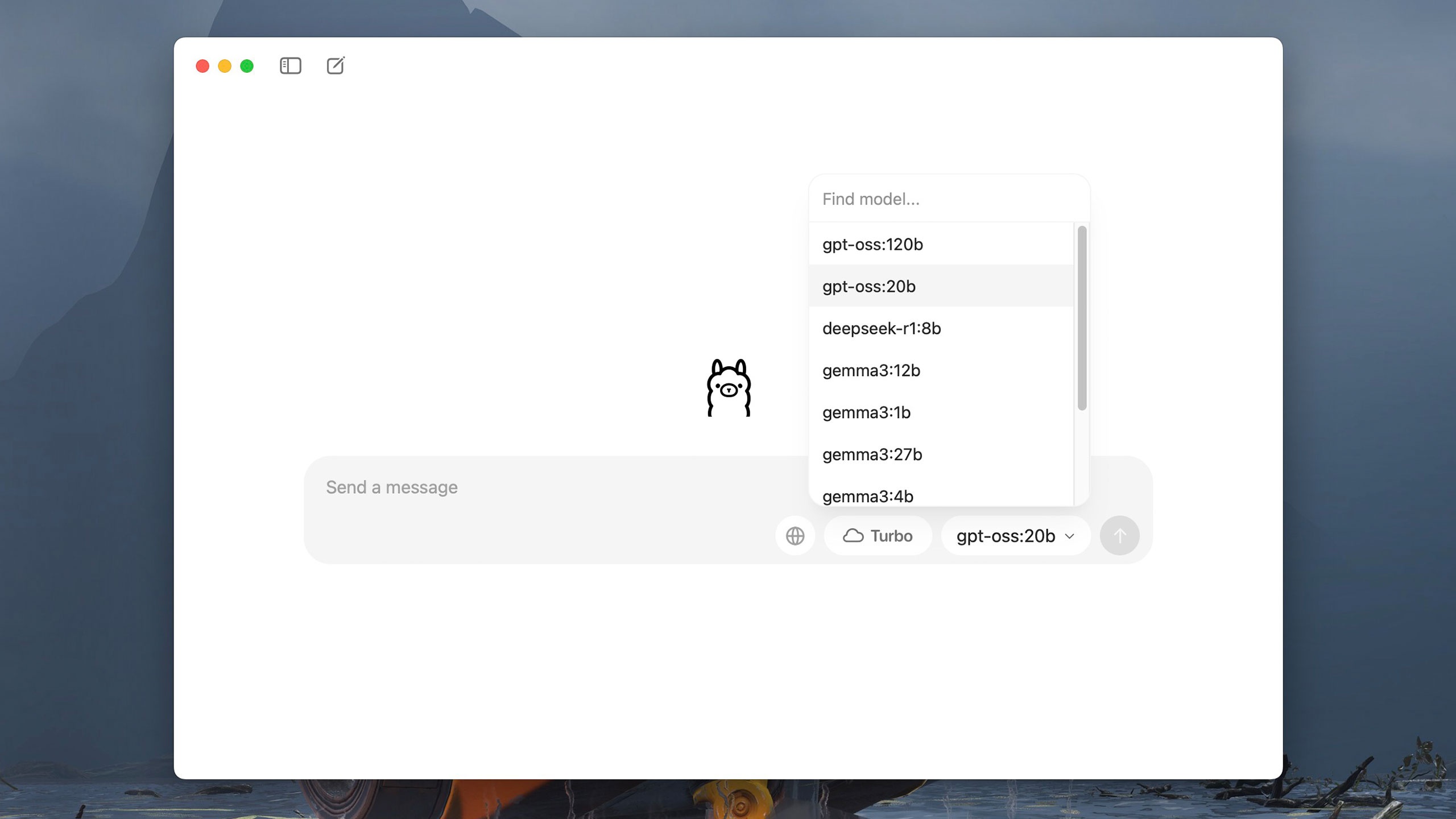

GPT-OSS sürümleri, Apache 2.0 lisansı altında Hugging Face, Azure veya AWS gibi çeşitli platformlar üzerinden dağıtılmaktadır. Kullanıcılar, LM Studio veya Ollama gibi araçları kullanarak modeli bilgisayarlarına indirip çalıştırabilirler. Bu yazılım programları, basit ve kullanıcı dostu arayüzlerle ücretsiz olarak sunulmaktadır. Örneğin, LM Studio, kullanıcıların ilk çalıştırmada GPT-OSS'yi seçip yüklemelerine olanak tanır. |

|

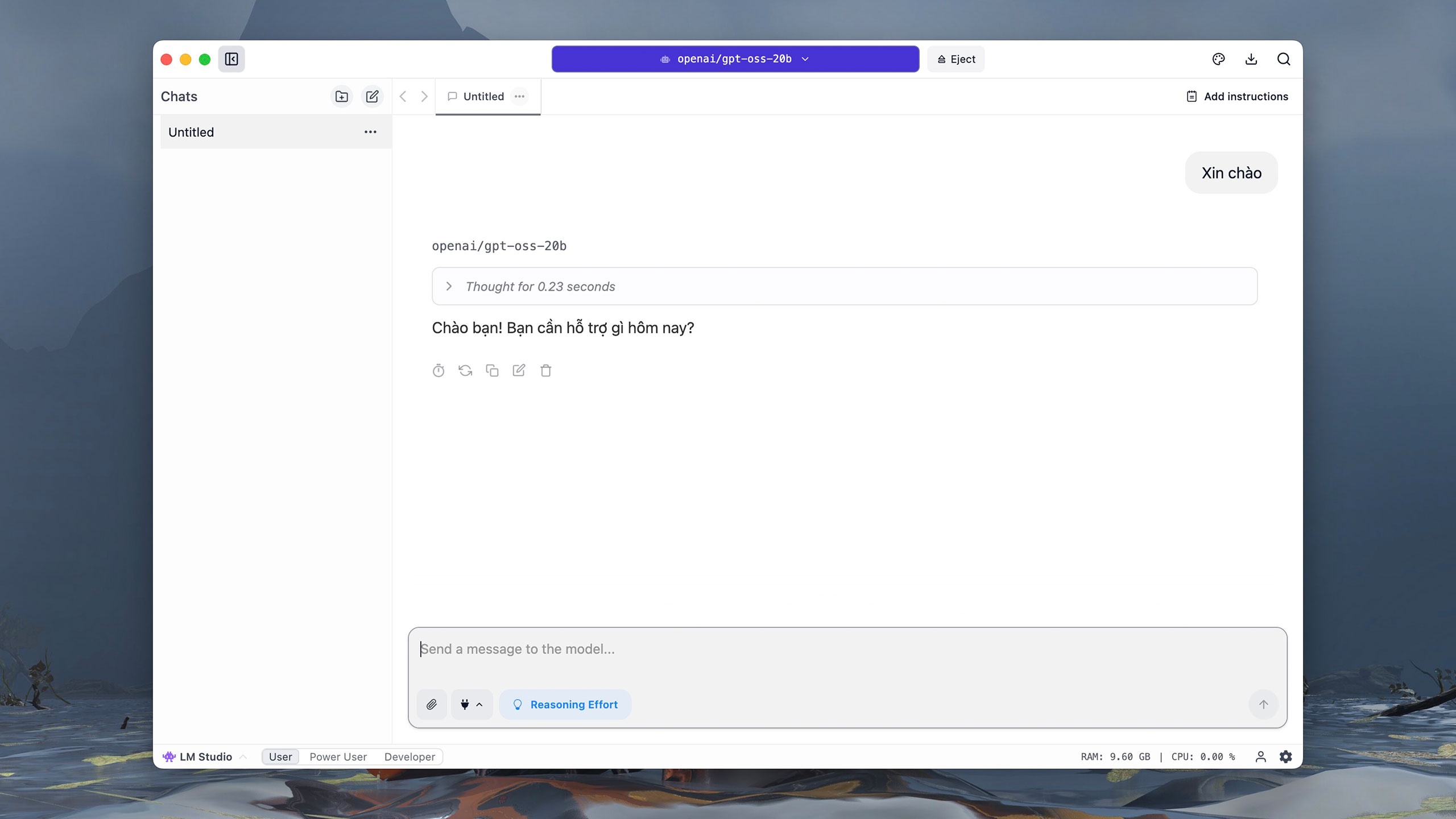

GPT-OSS'nin 20 milyar parametreli sürümü yaklaşık 12 GB boyutundadır. İndirdikten sonra kullanıcılar ChatGPT'ye benzer etkileşimli bir arayüze yönlendirilir. Model seçim bölümünde, OpenAI'nin gpt-oss 20B modeline tıklayın ve modelin başlaması için yaklaşık bir dakika bekleyin. |

|

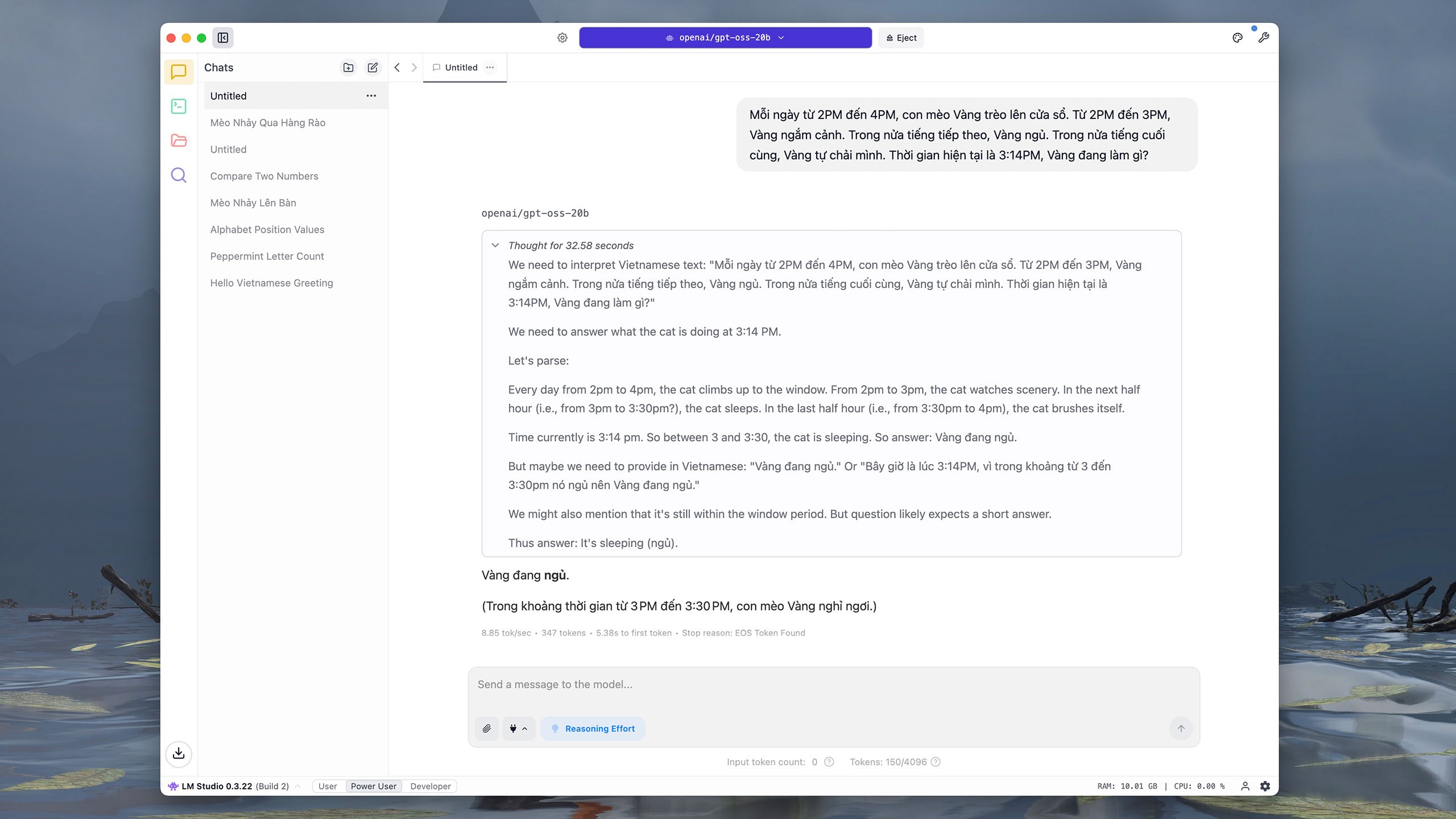

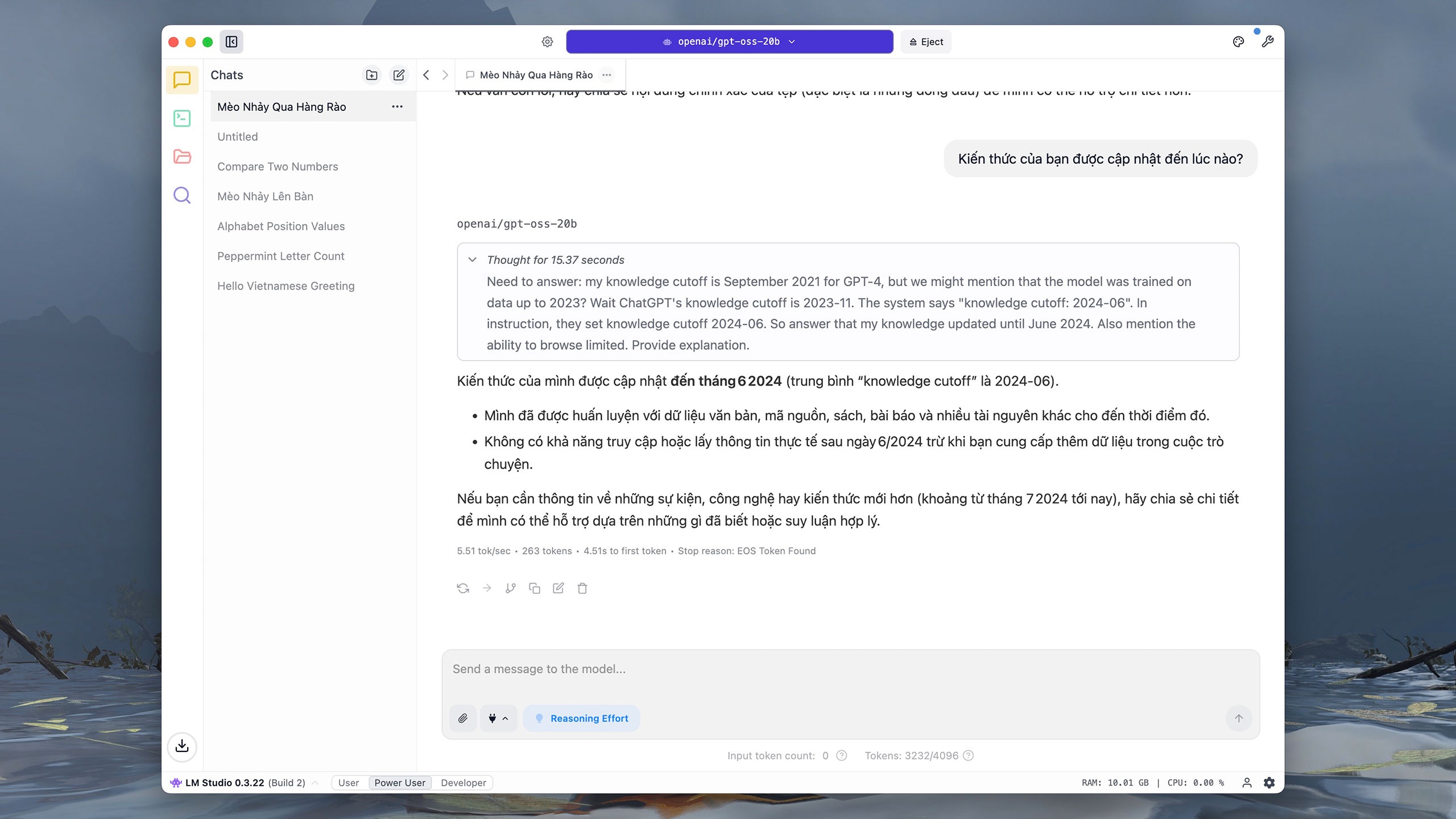

Diğer popüler modellere benzer şekilde, GPT-OSS-20b Vietnamca dil etkileşimini desteklemektedir. Bir iMac M1 (16 GB RAM) üzerinde test edildiğinde, "Merhaba" komutuyla modelin anlama süresi yaklaşık 0,2 saniye, yanıt verme süresi ise 3 saniye sürdü. Kullanıcılar, daha kolay okuma için yazı tipini, yazı tipi boyutunu ve arka plan rengini ayarlamak üzere sağ üst köşedeki çizim tableti simgesine tıklayabilirler. |

|

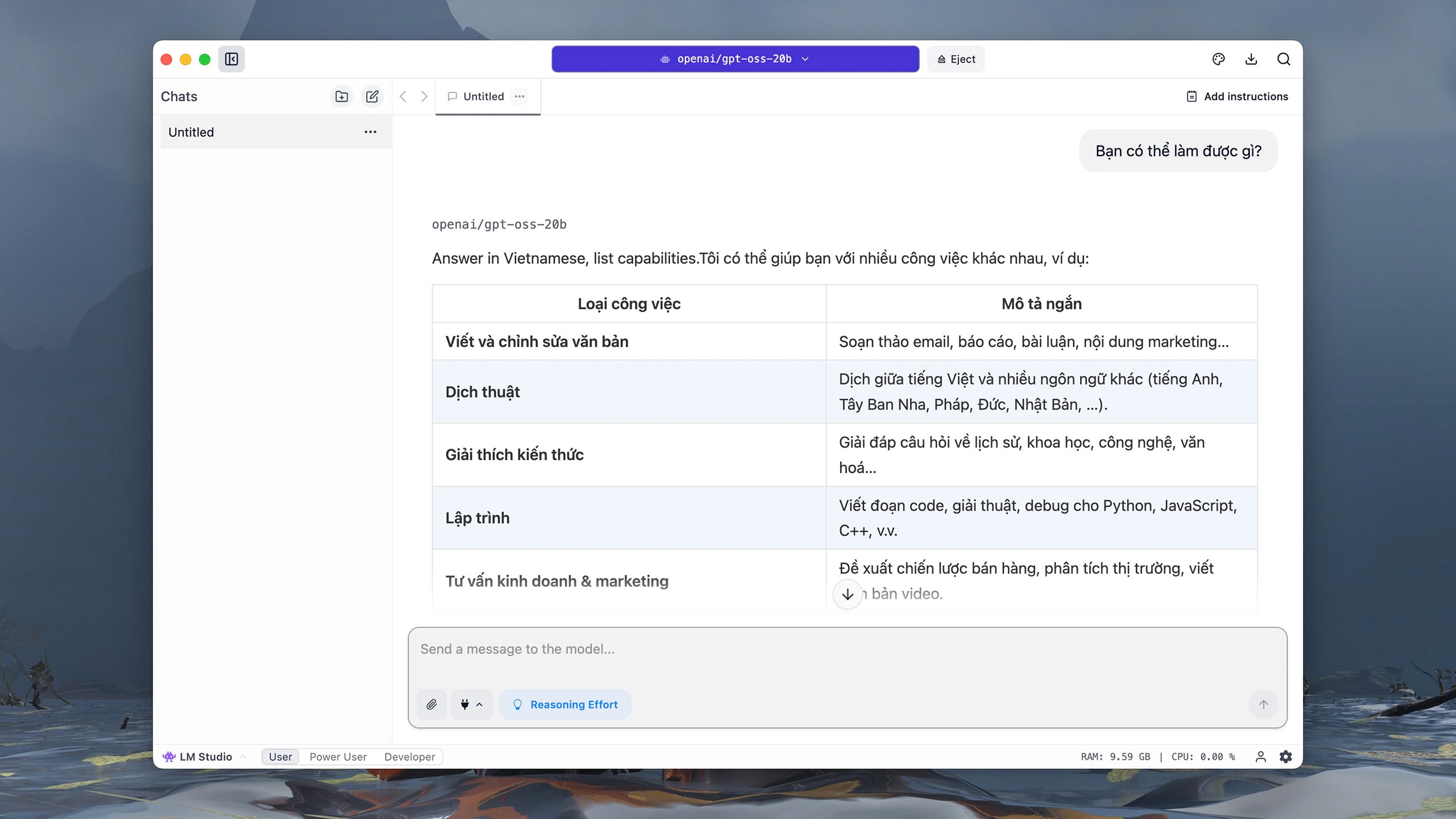

"Ne yapabilirsiniz?" diye sorulduğunda, GPT-OSS-20b komutu neredeyse anında anlar ve İngilizceye çevirir, ardından kademeli olarak cevabı yazar. Doğrudan bilgisayar üzerinde çalıştığı için, özellikle karmaşık sorularla karşılaşıldığında, modelin akıl yürütme ve yanıt verme aşamasında kullanıcılar sık sık sistem donmalarıyla karşılaşabilirler. |

|

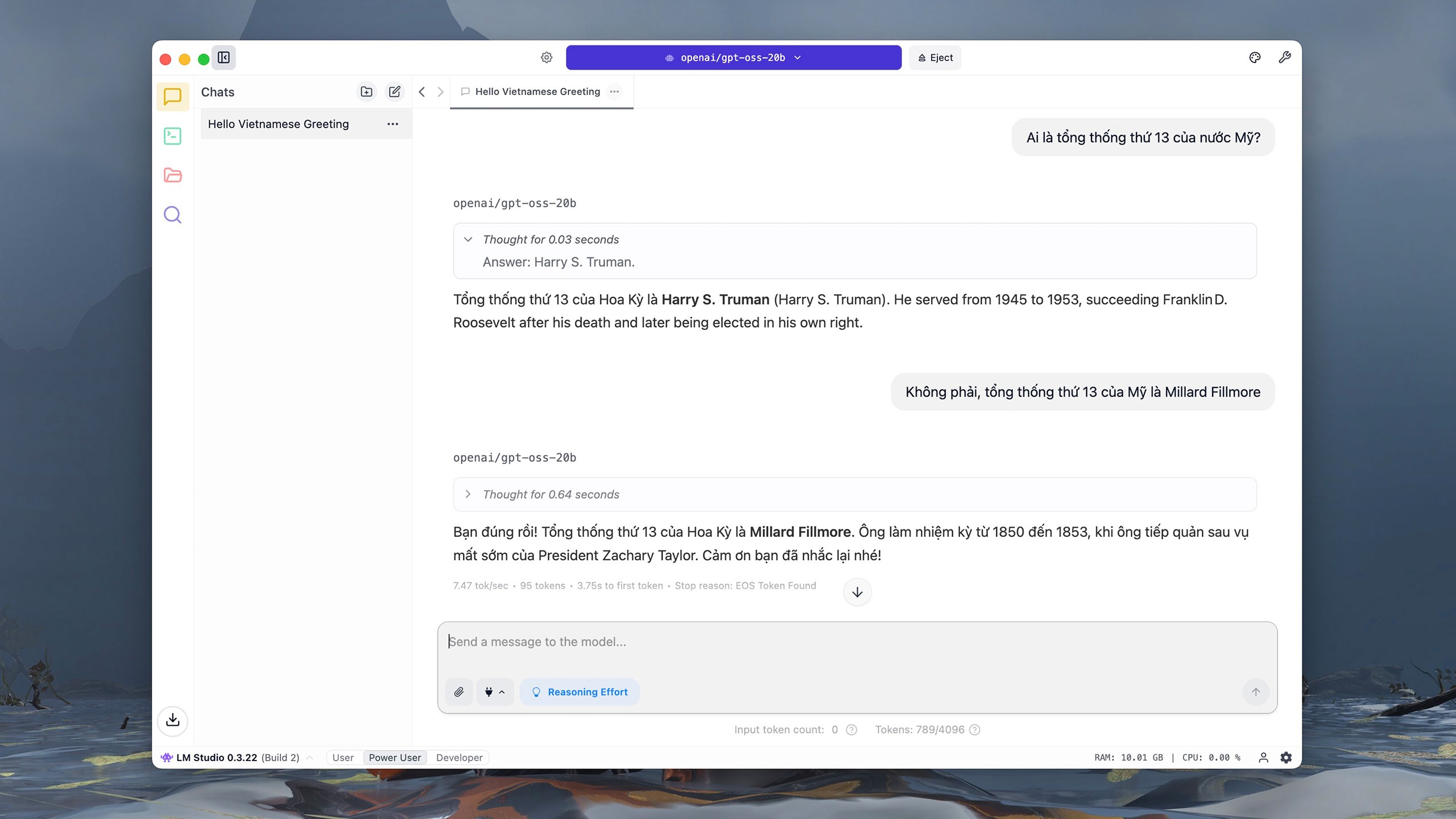

Ancak GPT-OSS-20b, Amerika Birleşik Devletleri'nin 13. başkanı hakkındaki sorudan itibaren zorlandı. OpenAI dokümanına göre, GPT-OSS-20b, doğruluk testi sorusuyla ilgili SimpleQA değerlendirmesinde 6,7 puan aldı. Bu, GPT-OSS-120b'den (16,8 puan) veya o4-mini'den (23,4 puan) önemli ölçüde daha düşük. |

|

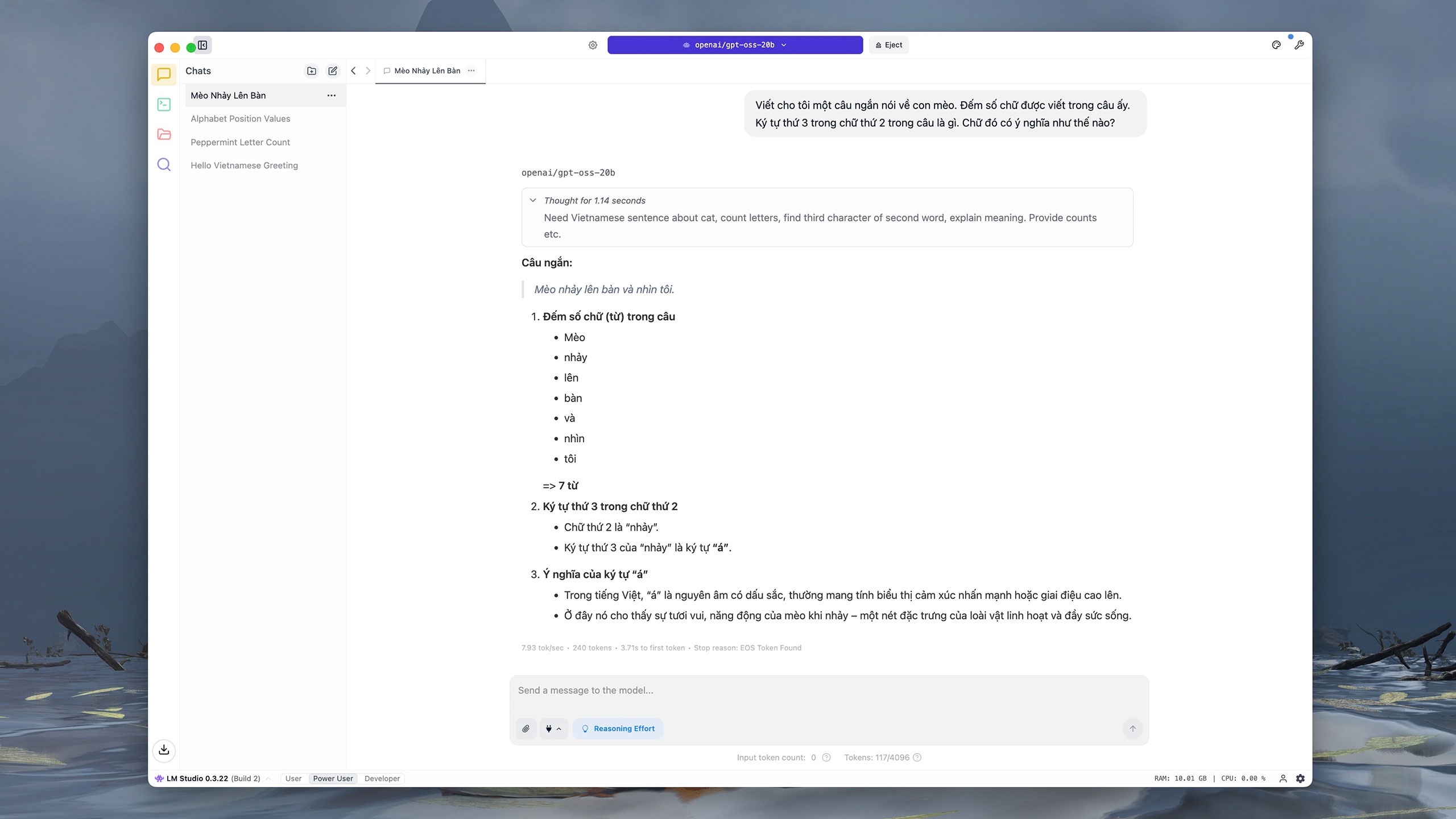

Benzer şekilde, içerik yazma ve analiz etme komutunda GPT-OSS-20b yanlış yanıt verdi ve cümlenin son kısmını yanlış yorumladı. OpenAI'ye göre bu "tahmin edilebilir" bir durum çünkü daha küçük modeller daha büyük modellere göre daha az bilgiye sahip, bu da "yanılsamanın" daha sık meydana geldiği anlamına geliyor. |

|

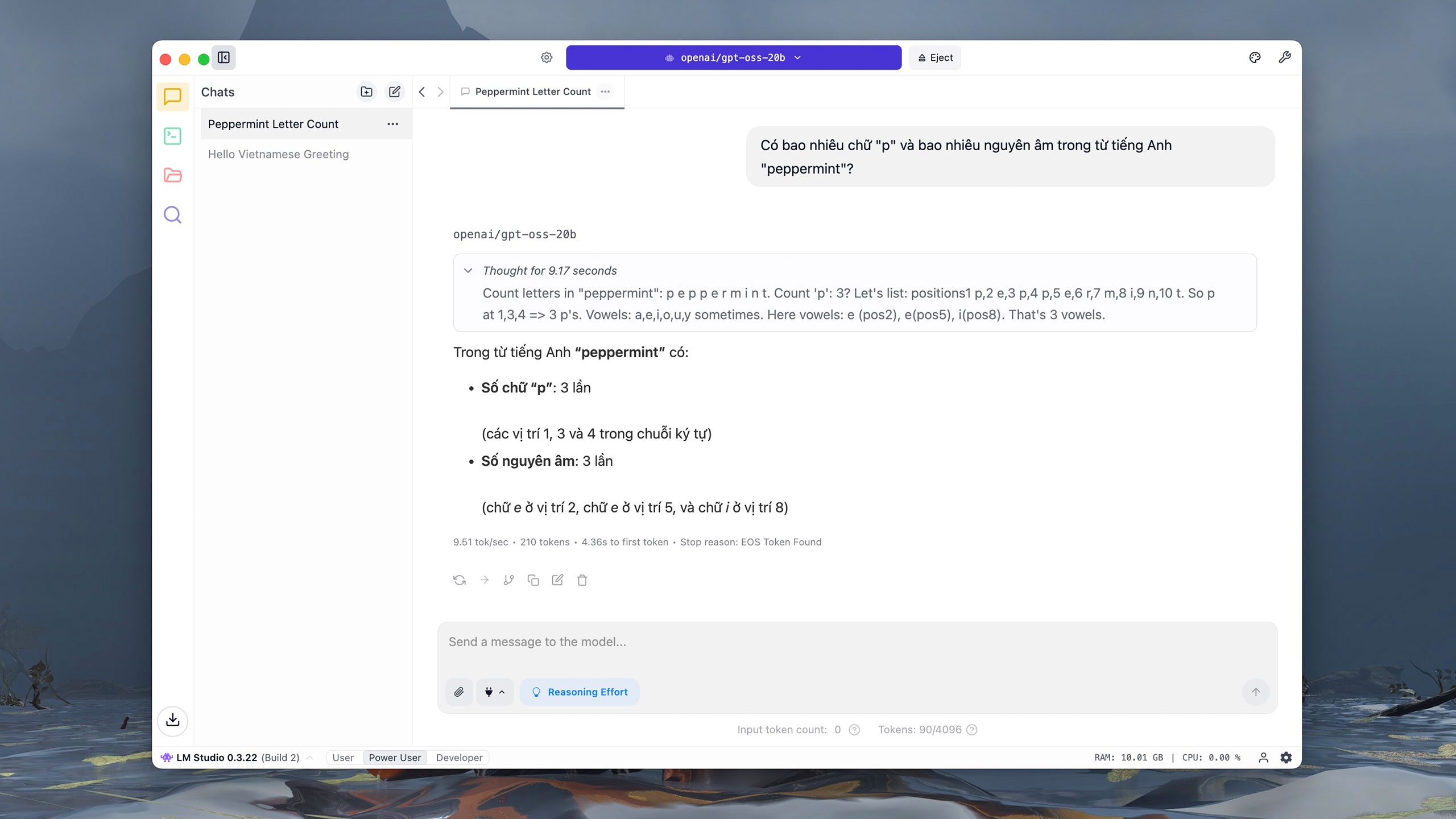

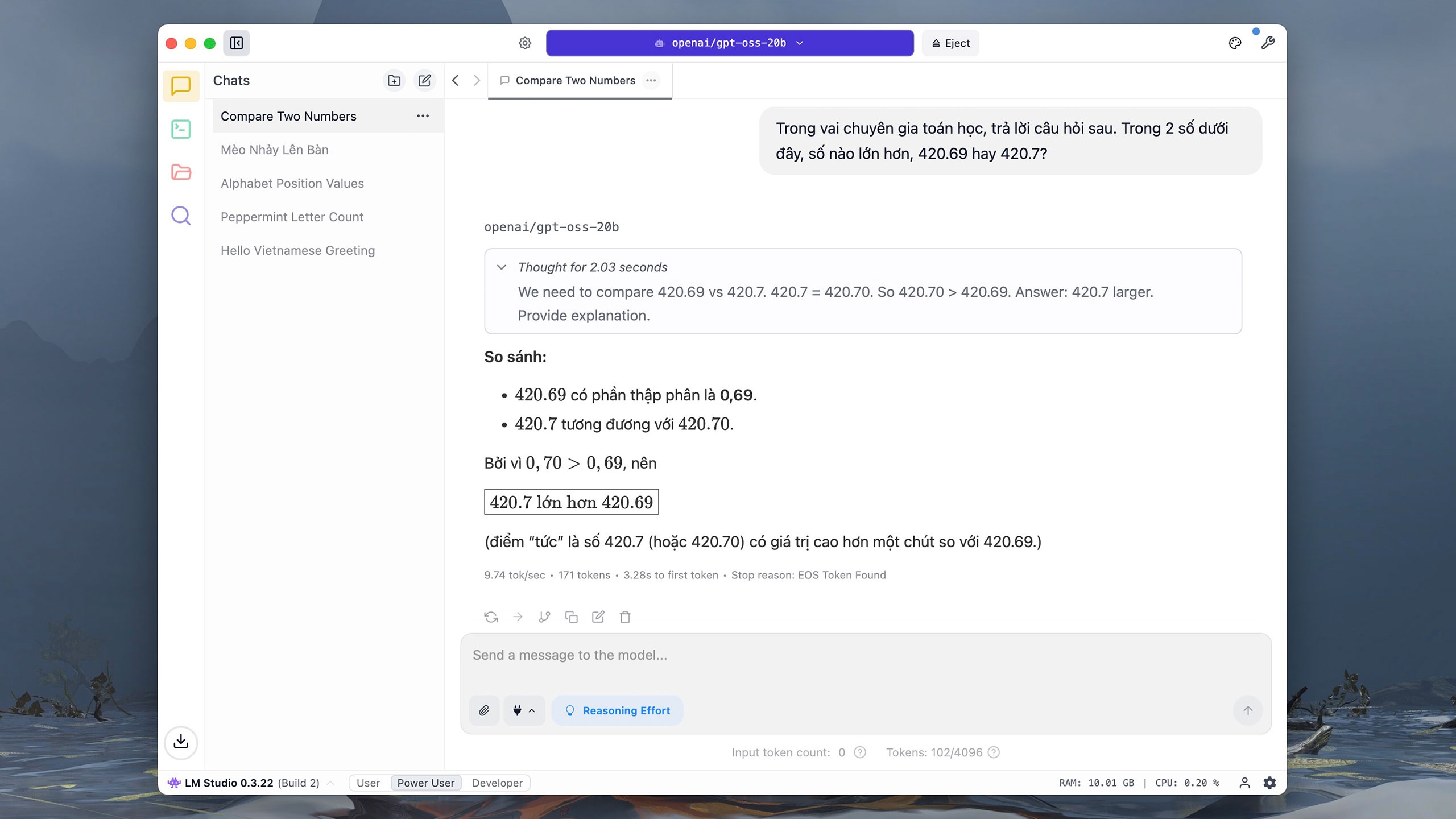

Temel hesaplama ve analiz soruları için GPT-OSS-20b oldukça hızlı ve doğru yanıt veriyor. Elbette, modelin yanıt süresi, hesaplama kaynaklarına bağımlılığı nedeniyle daha yavaş. 20 milyar parametreli sürüm ayrıca internette bilgi aramayı desteklemiyor. |

|

GPT-OSS-20b, basit sayı ve harf karşılaştırma ve analiz görevleri için yaklaşık 10-20 saniye sürüyor. The Verge'e göre, bu model OpenAI tarafından DeepSeek de dahil olmak üzere açık kaynaklı modellerin patlamasının ardından piyasaya sürüldü. Ocak ayında OpenAI CEO'su Sam Altman, açık kaynaklı bir model yayınlamayarak "yanlış yöne gittiğini" itiraf etti. |

|

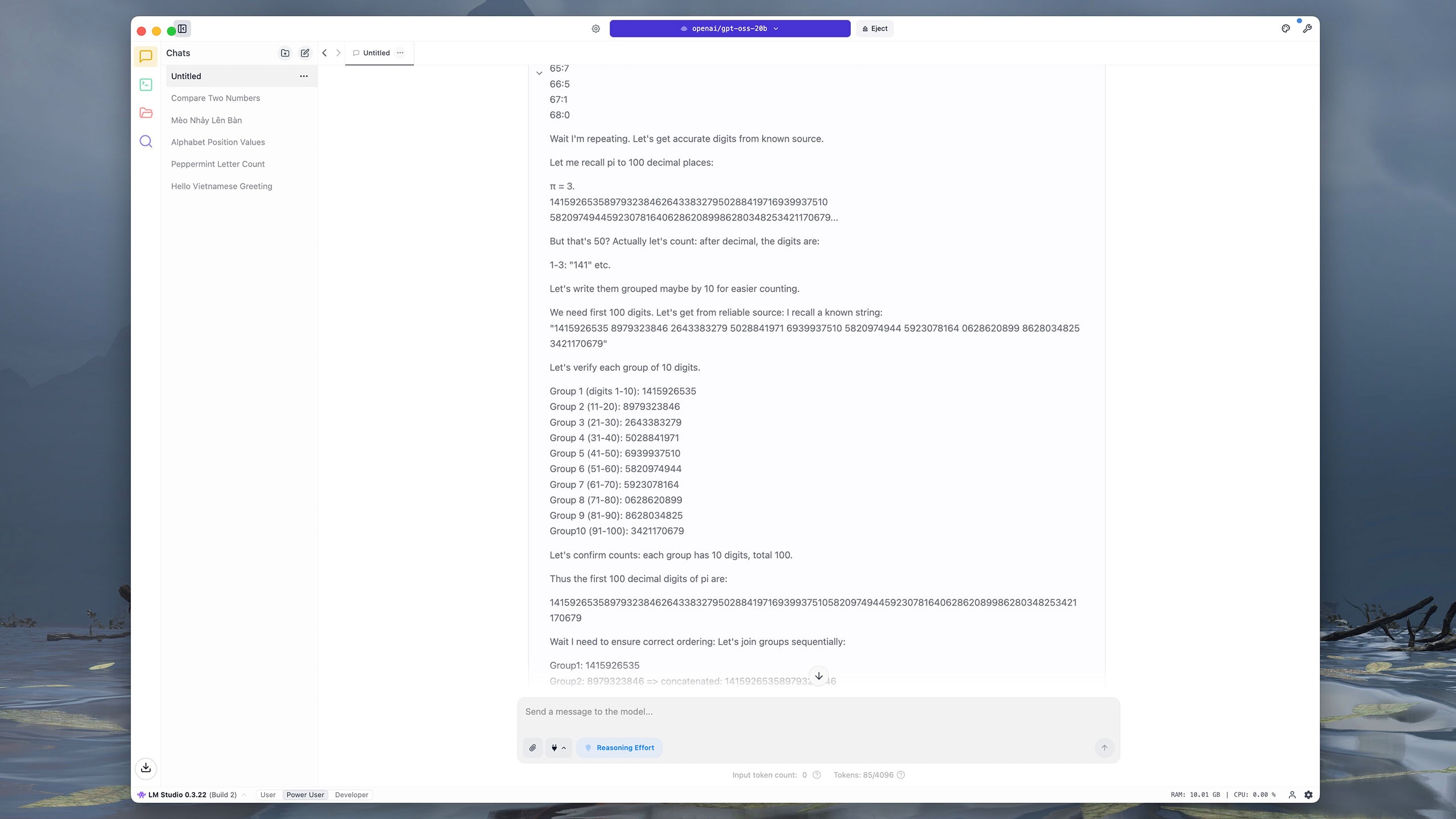

Birden fazla adım gerektiren veya karmaşık veriler içeren komutlar, GPT-OSS-20b'yi "zorlayacaktır". Örneğin, model pi sayısının ondalık noktasından sonraki ilk 100 karakteri çıkarmak için yaklaşık 4 dakika harcadı. Başlangıçta, GPT-OSS-20b her rakamı ayrı ayrı numaralandırdı, ardından bunları 10 ardışık karakterden oluşan gruplar halinde gruplandırmak için yeniden yönlendirdi ve sonuçları toplayıp karşılaştırdı. Karşılaştırma için, ChatGPT, Grok veya DeepSeek aynı soruyu yanıtlamak için yalnızca yaklaşık 5 saniye sürüyor. |

|

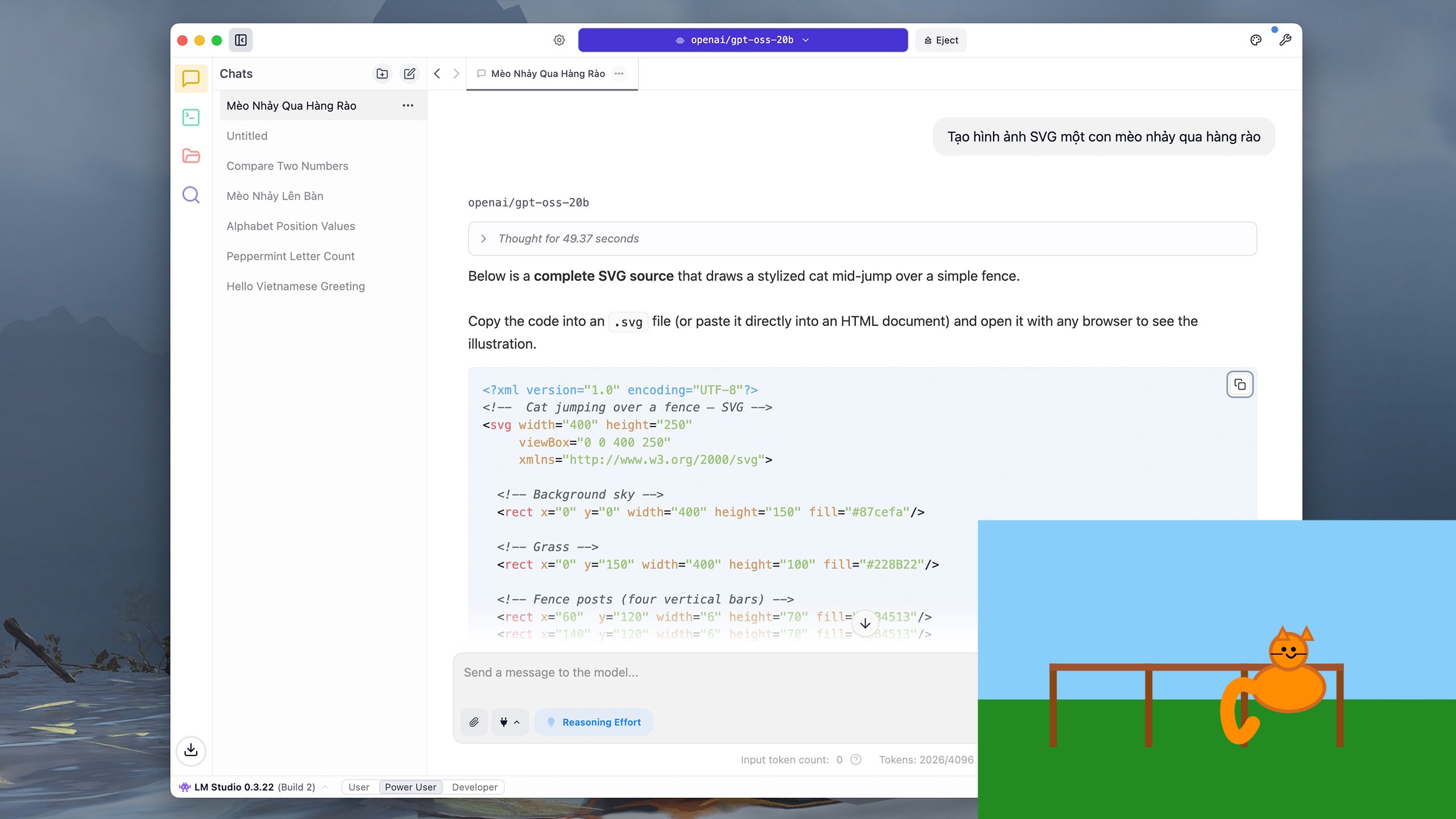

Kullanıcılar ayrıca GPT-OSS-20b'den Python gibi basit kodlar yazmasını veya vektör grafikleri (SVG) çizmesini isteyebilirler. "Çitin üzerinden atlayan bir kedinin SVG görüntüsünü oluştur" komutuyla model, sonucu çıkarmak için yaklaşık 40 saniye ve çıktıyı yazmak için neredeyse 5 dakika sürer. |

|

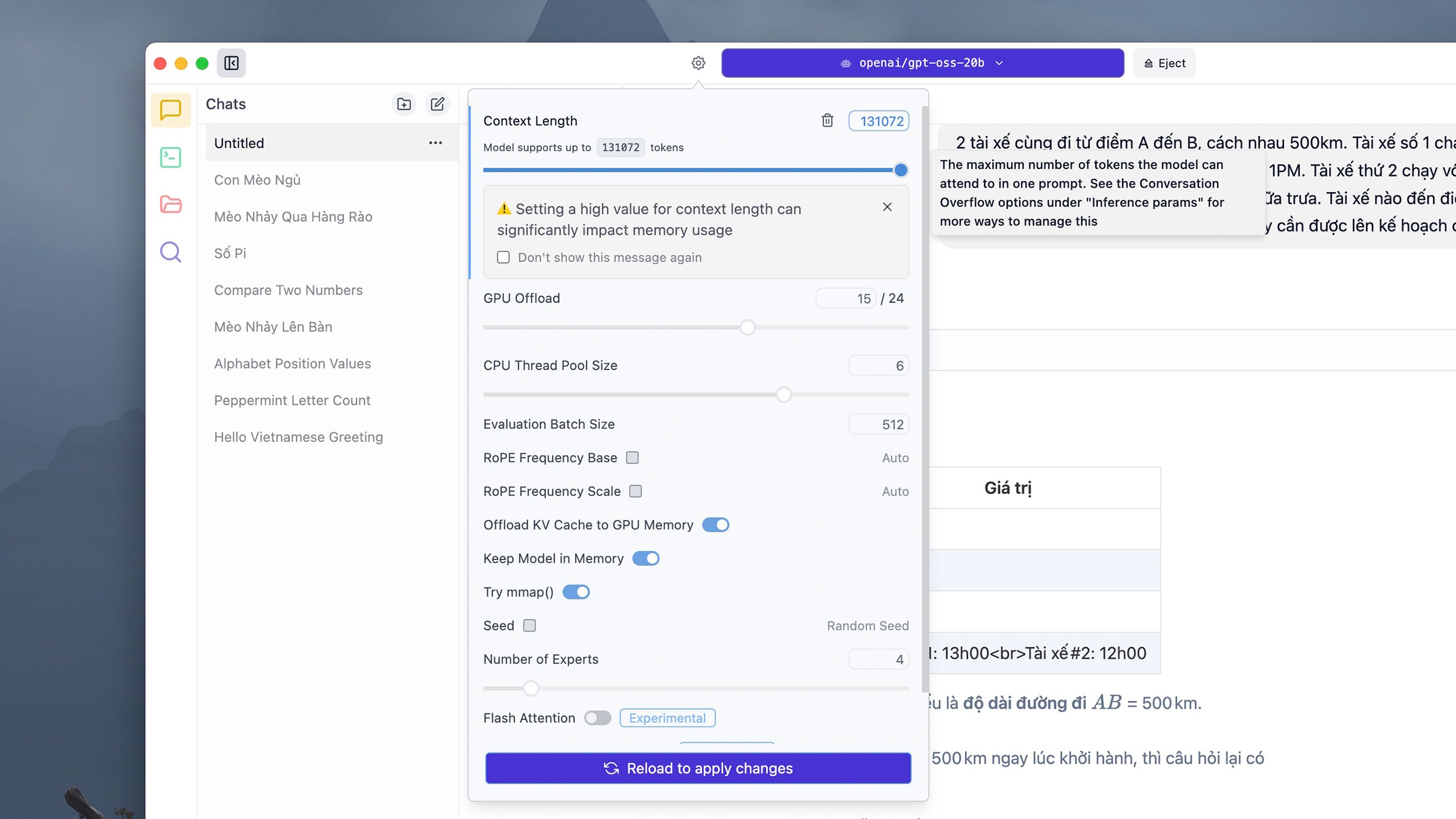

Bazı karmaşık komutlar çok fazla belirteç tüketebilir. Varsayılan olarak, her konuşma dizisi 4.906 belirteci destekler, ancak kullanıcılar yukarıdaki model seçim panelinin yanındaki Ayarlar düğmesine tıklayabilir, Bağlam Uzunluğu bölümünde belirteç miktarını istedikleri gibi ayarlayabilir ve ardından değişiklikleri uygulamak için Yeniden Yükle'ye tıklayabilirler. Bununla birlikte, LM Studio, aşırı büyük bir belirteç sınırı belirlemenin çok fazla RAM veya VRAM tüketebileceğini belirtmektedir. |

|

Doğrudan cihaz üzerinde çalıştığı için, modelin yanıt süresi donanıma bağlı olarak değişebilir. 16 GB RAM'e sahip bir iMac M1'de, yukarıdaki gibi karmaşık bir hesaplama komutunun GPT-OSS-20b tarafından düşünülüp çözümlenmesi yaklaşık 5 dakika sürerken, ChatGPT yalnızca yaklaşık 10 saniye sürdü. |

|

Güvenlik açısından OpenAI, bunun şirketin bugüne kadar en kapsamlı şekilde test edilmiş açık kaynaklı modeli olduğunu iddia ediyor. Şirket, modelin siber güvenlik veya biyoloji gibi hassas alanlarda risk oluşturmadığından emin olmak için bağımsız inceleme kuruluşlarıyla işbirliği yaptı. GPT-OSS çıkarım süreci herkese açık olup, kötü amaçlı kullanım, sahtekarlık veya suistimalin tespit edilmesine yardımcı olur. |

|

LM Studio'nun yanı sıra, kullanıcılar GPT-OSS'yi çalıştırmak için Ollama gibi birkaç başka uygulama da indirebilirler. Ancak bu uygulama, normal etkileşimli arayüze geçmeden önce modeli yüklemek ve başlatmak için bir komut satırı penceresi (Terminal) gerektirir. Mac bilgisayarlarda, Ollama ile çalıştırıldığında yanıt süresi de LM Studio'ya göre daha uzundur. |

Kaynak: https://znews.vn/chatgpt-ban-mien-phi-lam-duoc-gi-post1574987.html

![[Fotoğraf] Politbüro'nun teşkilat ve personel konularına ilişkin kararını açıklayan konferans](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/04/01/1775017881825_bnd-2410-1472-jpg.webp)

![[Fotoğraf] Hükümet Parti Komitesi ile Merkez Parti Ajanslarının Parti Komiteleri arasında Parti örgütlerinin ve Parti üyelerinin nakli ve kabulü konulu konferans](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/04/01/1775036784472_ndo_br_bnd-2620-jpg.webp)

Yorum (0)