ماہرین نے AI کو ٹیکنالوجی انجینئرز کی بنائی ہوئی "مشینوں" سے تشبیہ دی، جن کا طرز عمل انسانوں کی نقل کرتا ہے اور تیزی سے حقیقی ذہانت کے قریب پہنچ رہا ہے۔

اگر AI کو اخلاقی طور پر ڈیزائن اور کنٹرول نہیں کیا گیا تو معاشرے کو بہت سے منفی نتائج کا سامنا کرنا پڑ سکتا ہے۔

اگر متعصب ڈیٹا کا استعمال کرتے ہوئے تیار کیا جائے تو AI صنف اور نسل کی بنیاد پر امتیازی سلوک کا باعث بن سکتا ہے۔ AI بہت سی ملازمتوں کی جگہ لے سکتا ہے، جو لیبر مارکیٹ کے لیے ایک اہم چیلنج ہے۔ معذور افراد، محدود تکنیکی مہارت کے حامل افراد، اور نسلی اقلیتوں کو AI سے مربوط خدمات تک رسائی میں پیچھے رہنے سے بچنے کے لیے مدد کی ضرورت ہے۔

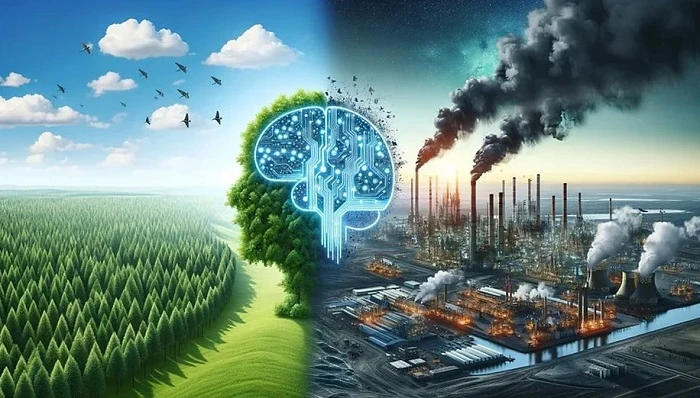

AI کی ترقی سے ماحولیات اور وسائل کے لیے بھی کچھ چیلنجز پیدا ہوں گے۔ ڈیٹا سینٹرز، کلاؤڈ کمپیوٹنگ انفراسٹرکچر، اور سپر کمپیوٹرز کے قیام اور دیکھ بھال کے لیے بجلی اور پانی کے ساتھ ساتھ آلات کی رہائش کے لیے قابل قدر زمین کی ضرورت ہوتی ہے۔

جیسا کہ AI صحت کی دیکھ بھال جیسے اہم شعبوں میں داخل ہوتا ہے، اگر تشخیص یا علاج میں غلطیاں ہوتی ہیں تو جوابدہی کیسی ہوگی؟ خاص طور پر مریض کی معلومات کی حفاظت، عمومی طور پر ذاتی ڈیٹا کا تحفظ، اور ڈیٹا کی درستگی کو یقینی بنانا یہ تمام مسائل ہیں جو خاص طور پر تشویش کے...

مذکورہ بالا خطرات نہ صرف ویتنام بلکہ پوری دنیا کے لیے خطرہ ہیں۔ لہذا، مناسب کنٹرول اور رہنمائی کے طریقہ کار کے ساتھ، AI کی ترقی اور اطلاق پر احتیاط سے غور کرنے کی ضرورت ہے۔

AI اخلاقیات کا تقاضا ہے کہ AI کی ترقی میں شامل افراد اور تنظیمیں صارفین اور معاشرے کے لیے شفاف، منصفانہ اور محفوظ طریقے سے اس "مشین" کو ڈیزائن کرنے، چلانے اور اس کا استحصال کرنے کے لیے ذمہ دار ہوں۔ ساتھ ہی، AI اخلاقیات زندگی پر AI کے منفی اثرات سے نمٹنے میں عالمی برادری اور اقوام کے کردار پر بھی زور دیتی ہے۔

|

| AI کی ترقی ماحول اور وسائل کے لیے کچھ چیلنجز پیش کرتی ہے۔ (مثالی تصویر) |

پارٹی اور ویتنام کی ریاست نے لوگوں کو مرکز میں رکھنے کے جذبے کے ساتھ، لوگوں کی خدمت کے طور پر ڈیجیٹل تبدیلی کے بنیادی مقصد کی نشاندہی کی ہے۔ لہذا، اس کو فروغ دینے اور ترقی دینے کے علاوہ، ہم نے ڈیجیٹل تبدیلی کے عمل کے دوران لوگوں پر ناپسندیدہ اثرات کو کم کرنے پر توجہ مرکوز کی ہے۔

قومی اسمبلی نے روزگار کے قانون پر نظر ثانی کے دوران چوتھے صنعتی انقلاب سے متاثر ہونے والوں کی مدد کے لیے پالیسیوں پر تحقیق کی درخواست کی ہے۔

ہم نے 2024 میں ڈیٹا قانون نافذ کیا ہے، فی الحال پرسنل ڈیٹا پروٹیکشن قانون تیار کر رہے ہیں، اور سائبر سیکیورٹی قانون میں ترمیم کر رہے ہیں...

سیاسی نظام کے اندر ایجنسیاں اور تنظیمیں شہریوں کو زیادہ آسانی سے سمارٹ انتظامی خدمات تک رسائی میں مدد کے لیے مختلف حلوں پر تحقیق کر رہی ہیں۔ ہنوئی سٹی پبلک ایڈمنسٹریٹو سروس سینٹر کا آپریشنل ماڈل ایک مثال ہے…

تاہم، سب سے بڑا چیلنج یہ ہے کہ AI میں اخلاقی تعمیل کی نگرانی کے ساتھ فروغ دینے والی جدت کو کیسے متوازن کیا جائے۔ بہت زیادہ کنٹرول بدعت کو روک سکتا ہے، لیکن بہت زیادہ سست کنٹرول آسانی سے منفی نتائج کا باعث بن سکتا ہے جو پہلے ہی بیان کیے گئے ہیں۔

مزید برآں، متعدد سائنس اور ٹیکنالوجی کی ترقی کی حکمت عملیوں اور پروگراموں کو بیک وقت نافذ کرنے کے لیے محتاط منصوبہ بندی اور توازن کی ضرورت ہوتی ہے، خاص طور پر جب وسائل محدود ہوں۔

|

| چیلنج AI میں اخلاقی تعمیل کی نگرانی کے ساتھ جدت کے فروغ کو متوازن کرنے میں ہے۔ (مثالی تصویر) |

اس تناظر میں، پیشہ ورانہ انجمنوں، کاروباری اداروں، تحقیقی اداروں، سماجی تنظیموں وغیرہ کا حکومت کے ساتھ مل کر اے آئی کی ذمہ دارانہ ترقی کی رہنمائی کے لیے فعال کردار انتہائی اہم ہے۔

حال ہی میں، 22 مارچ، 2025 کو، نیشنل ڈیٹا ایسوسی ایشن کا آغاز کیا گیا، جس کا مقصد ایک مضبوط ڈیٹا ایکو سسٹم بنانا ہے، جس سے ڈیجیٹل اقتصادی ترقی کے فروغ اور قومی معیشت میں ڈیٹا کی قدر کو بڑھانا ہے۔

اس سے پہلے، ویتنام سافٹ ویئر اینڈ انفارمیشن ٹیکنالوجی سروسز ایسوسی ایشن (VINASA) نے مصنوعی ذہانت کی اخلاقیات کمیٹی قائم کی تھی۔ یہ کمیٹی AI ڈیولپمنٹ کمپنیوں کے لیے اخلاقی ضابطہ اخلاق تیار کرنے کے لیے متعلقہ حکام کو مشورہ دینے کے لیے تحقیق کر رہی ہے۔ اس کے ساتھ ہی، کمیٹی ایک معیاری ڈیٹاسیٹ بنانے کی تجویز پیش کرتی ہے، جس کے لیے ویتنام میں AI تیار کرنے والی غیر ملکی کمپنیوں کو کچھ معیارات پر عمل کرنے کی ضرورت ہوتی ہے۔

VINASA کے ماڈل کو نقل کیا جانا چاہئے اور اس کی حوصلہ افزائی کی جانی چاہئے، کیونکہ واضح طور پر، AI اخلاقیات صرف ریگولیٹری ایجنسیوں کا معاملہ نہیں ہے، بلکہ اس کے لیے پورے معاشرے کی اجتماعی کوشش کی ضرورت ہے۔

طویل مدتی میں، ویتنام کو مصنوعی ذہانت کی ترقی کے لیے مجموعی قومی حکمت عملی کے اندر ایک ذمہ دار AI ترقیاتی حکمت عملی تیار کرنے پر غور کرنے کی ضرورت ہے، جس میں انصاف، جامعیت، شفافیت، سلامتی اور جوابدہی کی اقدار کی مکمل تعمیل کو یقینی بنایا جائے۔

زیادہ اہم بات یہ ہے کہ قانون کی تعمیل ایک لازمی ضرورت ہے، جس کا مطالبہ ہے کہ ہر فرد اور تنظیم AI کو تیار کرتے اور لاگو کرتے وقت سوچ اور عمل دونوں میں گہری سمجھ رکھتا ہو۔

قانونی ذمہ داریوں کو واضح طور پر بیان کرنے، خلاف ورزیوں سے نمٹنے کے لیے میکانزم قائم کرنے اور ڈیجیٹل ماحول میں اسٹیک ہولڈرز کے جائز حقوق کے تحفظ کے لیے قانونی نظام کو مزید بہتری کی ضرورت ہے۔

بین الاقوامی تجربات بھی ویتنام کے حوالے کرنے کے لیے ایک اہم بنیاد کے طور پر کام کرتے ہیں، اس طرح ایک مناسب AI گورننس ماڈل تیار کرتے ہیں۔ ایک مکمل قانونی نظام اور ایک موثر نگرانی کا طریقہ کار خطرات کو کنٹرول کرنے اور جدت کی راہ میں رکاوٹ کے بغیر ٹیکنالوجی کے غلط استعمال کو روکنے میں مدد کرے گا۔ تب ہی AI حقیقی معنوں میں انسانیت کی خدمت اور سماجی ترقی کو فروغ دینے کا ایک ذریعہ بن جائے گا۔

ماخذ: https://nhandan.vn/dao-duc-ai-thach-thuc-and-huong-di-post873031.html

![[تصویر] "ریڈ جرنی" 2026: ویتنام کے نوجوان ویتنام اور چین کے درمیان دوستی کے پل کی تعمیر جاری رکھے ہوئے ہیں](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/04/20/1776629730866_4055880775670638308-9618-4200-jpg.webp)

تبصرہ (0)