أعلنت الشركة الأم لفيسبوك مؤخرًا عن طرازين جديدين ضمن مجموعة Llama 4. وهما نفس الطرازين المستخدمين حاليًا في مساعد Meta AI على الويب، وكذلك في واتساب، وماسنجر، وإنستغرام، مما يساعد المستخدمين على إنشاء تجارب وسائط متعددة أكثر تخصيصًا.

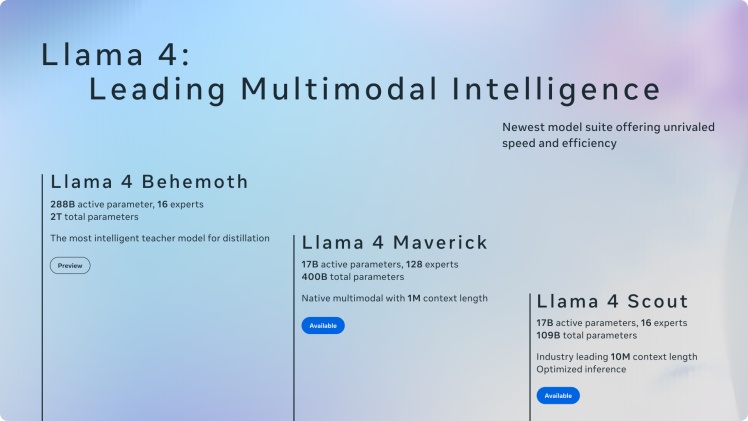

يتوفر الآن نموذجان جديدان للتحميل من موقعي Meta و Hugging Face، وهما Llama 4 Scout و Llama 4 Maverick. وتقول Meta إنها لا تزال في طور تدريب Llama 4 Behemoth، النموذج الضخم الذي يصفه الرئيس التنفيذي مارك زوكربيرج بأنه "النموذج الأفضل أداءً في العالم ".

بحسب شركة ميتا، يمتلك نموذج لاما 4 سكاوت نافذة سياقية تصل إلى 10 ملايين رمز، أي أضعاف ما يمتلكه نموذج جيميني، صاحب أعلى عدد من الرموز حاليًا. ويمثل هذا الرقم الذاكرة العاملة لنموذج الذكاء الاصطناعي.

يصف ميتا النموذج بأنه متفوق على Gemma 3 و Gemini 2.0 Flash-Lite من جوجل، بالإضافة إلى Mistral 3.1، "في عدد من المعايير المنشورة على نطاق واسع"، مع قدرته على "التشغيل على وحدة معالجة رسومات Nvidia H100 واحدة".

بالنسبة لنموذج Llama 4 Maverick، قدمت الشركة ادعاءات مماثلة بشأن الأداء عند مقارنته بنموذج GPT-4o من OpenAI ونموذج Gemini 2.0 Flash من Google. تُضاهي مهام البرمجة والاستدلال في Maverick أداء DeepSeek-V3، على الرغم من أنه يستخدم أقل من نصف عدد المعاملات.

|

صور للنماذج الجديدة في مجموعة لاما 4. الصورة: ميتا. |

في غضون ذلك، يضمّ Behemoth 288 مليار مُعامل نشط من أصل 2 تريليون مُعامل. ورغم أنه لم يُطرح بعد، إلا أن شركة Meta تُشير إلى أن Behemoth لديه القدرة على التفوق على منافسيه (وتحديدًا GPT-4.5 وClaude Sonnet 3.7) "في العديد من معايير العلوم والتكنولوجيا والهندسة والرياضيات".

أعلنت شركة ميتا عن تحوّلها إلى بنية "مزيج الخبراء" (MoE)، وهي نفس البنية التي حققت نجاحًا باهرًا لمنصة ديب سيك. يساهم هذا النهج في توفير الموارد من خلال تفعيل أجزاء النموذج الضرورية فقط لكل مهمة محددة. سيتم الإعلان عن المزيد من التفاصيل حول خطة المنتج في مؤتمر لاماكون في 29 أبريل.

على الرغم من الانتقادات الموجهة لقيود الترخيص، تواصل شركة ميتا تصنيف لاما 4 على أنها "مفتوحة المصدر"، على غرار نماذجها السابقة. فعلى سبيل المثال، يشترط ترخيص لاما 4 على المؤسسات التجارية التي يزيد عدد مستخدميها النشطين شهريًا عن 700 مليون مستخدم الحصول على إذن من ميتا قبل استخدام النموذج.

وفقًا لمبادرة المصادر المفتوحة في عام 2023، فإن هذه اللوائح "جعلت النموذج لم يعد مصنفًا كمصدر مفتوح".

المصدر: https://znews.vn/cha-de-facebook-ra-mo-hinh-ai-moi-post1543744.html

![[صورة] عضو اللجنة الدائمة للجنة المركزية للحزب تران كام تو يقدم قرار تعيين سكرتير لجنة الحزب في أكاديمية هو تشي منه الوطنية للعلوم السياسية.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2026%2F02%2F02%2F1770039902160_le-cong-bo-bt-hvctqg-11-7880-jpg.webp&w=3840&q=75)

![OCOP خلال موسم تيت: [الجزء 3] ورق الأرز فائق الرقة يحقق رواجاً كبيراً.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F402x226%2Fvietnam%2Fresource%2FIMAGE%2F2026%2F01%2F28%2F1769562783429_004-194121_651-081010.jpeg&w=3840&q=75)

تعليق (0)