Útok ze všech úhlů.

Společnost Google uvedla na trh nový produkt umělé inteligence (AI) s názvem „Gemini Nano Banana“, který se nejedná o rozsáhlou lingvistickou AI (LLM) schopnou psaní a uvažování, ale spíše o AI specializující se na úpravu fotografií... Mnoho uživatelů je z tohoto nástroje nadšeno, ale přináší s sebou i řadu nevýhod.

„Je to jako ‚krok zpět‘ v technologii umělé inteligence a etických omezeních,“ řekl Nguyen Hong Phuc, hlavní vědecký ředitel společnosti Conductify AI, a vyjádřil svůj osobní názor. „Gemini Nano Banana má efektivní možnosti úpravy obrázků. Ale odcenzurování Gemini Nano Banana společností Google, uvolnění bariér a omezujících mechanismů, umožňuje této umělé inteligenci vytvářet obrázky, které jsou neuvěřitelně podobné celebritám, sugestivní obrázky, citlivé obrázky atd.,“ řekl Phuc.

Podle pana Nguyen Hong Phuca tato schopnost dělá z Gemini Nano Banana nástroj pro vytváření realistických falešných obrázků, a to do té míry, že je nedokážou rozlišit ani odborníci na umělou inteligenci, což vede k novým rizikům podvodů a kybernetické bezpečnosti, jako je vytváření falešných fotografií se slavnými politiky za účelem šíření falešných informací, a dokonce i to, že jednotlivci jsou vystaveni manipulaci s fotografiemi generovanými umělou inteligencí a pomluvám na sociálních sítích...

Navíc s desítkami dalších nástrojů pro úpravu fotografií s umělou inteligencí, které dobývají internet, se deepfake podvody nedají zastavit. Statistiky bezpečnostních organizací ukazují, že technologie deepfake vytváří phishingové kampaně zaměřené na vysoce hodnotné jednotlivce, zejména na vedoucí pracovníky. V roce 2024 bylo celosvětově zaznamenáno 140 000–150 000 případů, přičemž 75 % z nich bylo zaměřeno na generální ředitele a vedoucí pracovníky... Deepfake by mohly do roku 2027 zvýšit globální ekonomické ztráty o 32 %, což je přibližně 40 miliard dolarů ročně.

Společnost Anthropic, která se zabývá umělou inteligencí, nedávno odhalila a zmařila kybernetickou útočnou kampaň zahraničních hackerů, která poprvé zaznamenala použití umělé inteligence ke koordinaci automatizovaných útočných aktivit. Hackeři konkrétně používali systémy umělé inteligence k plánování, řízení a nasazení operací proti narušení – což je „znepokojivý“ vývoj, který riskuje rozšíření rozsahu a rychlosti kybernetických útočných kampaní…

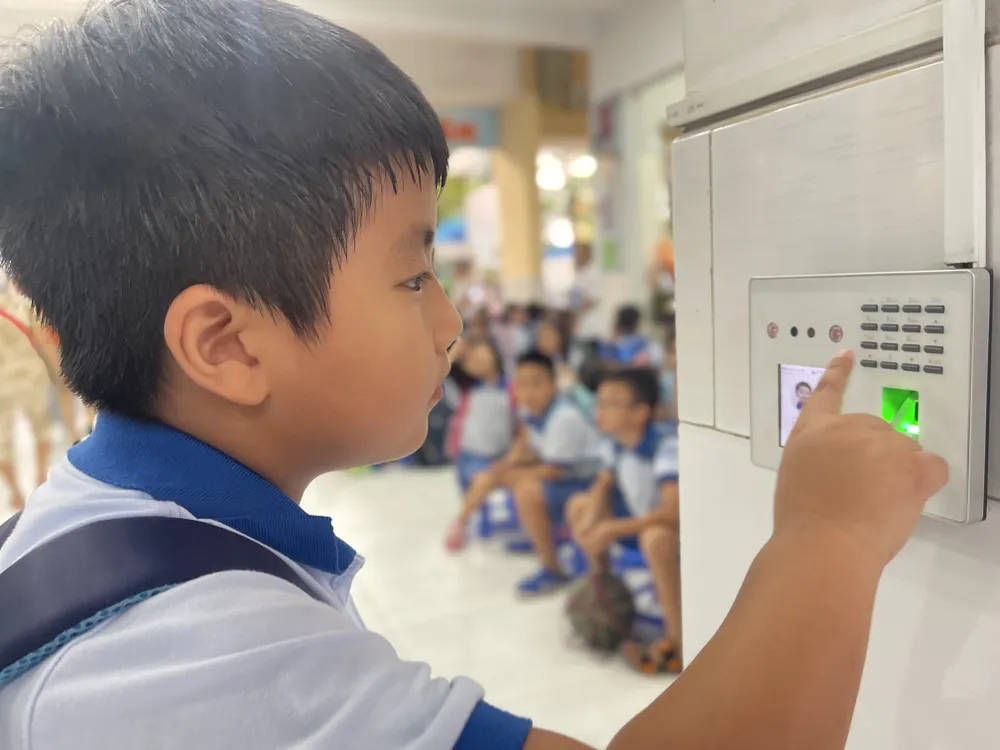

Pan Ngo Minh Hieu, ředitel Organizace pro boj proti podvodům Národní asociace pro kybernetickou bezpečnost, se podělil o to, že nástroje integrované s umělou inteligencí zvyšují rychlost podvodů přibližně 20krát ve srovnání s použitím skutečných lidí. Podvodníci poskytnou umělé inteligenci scénář podvodu k analýze a systém okamžitě automaticky chatuje s oběťmi. Z počátečních dat dokáže umělá inteligence pochopit, co oběť chce, a komunikovat s ní v reálném čase. Nejsofistikovanější taktikou je útok „Man-in-the-Middle“, kdy když uživatel provede video ověření (například zaznamenáním obličeje nebo zadáním příkazů), hacker zasáhne a naruší přenášená data. Kyberzločinci poté vloží předpřipravená deepfake videa, která nahradí skutečný datový tok uživatele, aby obešli proces ověřování. Touto metodou jsou ohroženy i bezpečnostní systémy bank a finančních institucí.

Lepší správa dat

S rostoucím rozšířením umělé inteligence se výrazně zvyšují i bezpečnostní a soukromoprávní rizika. Data uložená a zpracovávaná na vzdálených serverech se stanou atraktivním cílem hackerů a kyberzločinců. Podle údajů Národní asociace pro kybernetickou bezpečnost se jen ve druhém čtvrtletí roku 2025 počet kybernetických útoků s využitím umělé inteligence zvýšil o 62 %, což způsobilo celosvětové ztráty až 18 miliard dolarů...

Odborníci se domnívají, že ochrana dat je klíčová. Shromažďování a prodej dat však otevřeně pokračuje na mnoha platformách „černého trhu“, a to za pouhých 20 dolarů měsíčně. Kyberzločinci mohou používat nástroje, které napodobují jazykové modely, ale jsou přizpůsobeny pro kriminální účely. Tyto nástroje jsou schopny generovat malware a dokonce i obcházet antivirový software.

Ve Vietnamu upravuje ochranu osobních údajů dekret č. 13/2023/ND-CP (účinný od 17. dubna 2023). Zákon o ochraně osobních údajů, jehož účinnost se očekává od 1. ledna 2026, dále otevře silnější právní mechanismus pro řešení rizika úniku a zneužití osobních údajů. Podle Národní asociace pro kybernetickou bezpečnost je však stále třeba posílit účinnost vymáhání práva ve třech pilířích: zvyšování povědomí veřejnosti, zvyšování společenské odpovědnosti a zlepšování zpracovatelské kapacity regulačních orgánů. Kromě technických opatření si každý jednotlivec musí osvojit schopnost identifikovat neobvyklé a podezřelé znaky a proaktivně se chránit před nebezpečnými digitálními interakcemi…

Společnost Kaspersky varovala před zneužíváním temné umělé inteligence (termín označující nasazení rozsáhlých jazykových modelů (LLM), které fungují mimo standardní bezpečnostní kontroly a často umožňují akce, jako je phishing, manipulace, kybernetické útoky nebo zneužití dat). Organizace i jednotlivci se musí připravit na to, že budou čelit stále sofistikovanějším a obtížněji odhalitelným kybernetickým útokům v důsledku vzestupu temné umělé inteligence v asijsko-pacifickém regionu.

Sergej Ložkin, vedoucí globálního výzkumného a analytického týmu (GReAT) pro regiony Blízkého východu, Turecka, Afriky a Asie a Tichomoří ve společnosti Kaspersky, uvedl, že jedním z projevů současného zneužívání umělé inteligence je vznik modelů Black Hat GPT. Jedná se o modely umělé inteligence speciálně vyvinuté nebo upravené tak, aby sloužily neetickým a nelegálním účelům, jako je vytváření malwaru, vytváření plynulých a přesvědčivých phishingových e-mailů pro rozsáhlé útoky, vytváření deepfake hlasů a videí a dokonce i podpora simulovaných útoků.

Odborníci společnosti Kaspersky doporučují, aby jednotlivci i firmy používali bezpečnostní řešení nové generace k detekci malwaru generovaného umělou inteligencí a zároveň upřednostňovali ochranu dat. Firmy by měly implementovat nástroje pro monitorování v reálném čase, aby mohly sledovat zneužívání zranitelností vyvolaných umělou inteligencí; posílit kontrolu přístupu a školení zaměstnanců s cílem omezit působení umělé inteligence v temné zóně a riziko úniku dat; a zřídit operační centrum kybernetické bezpečnosti pro monitorování hrozeb a rychlou reakci na incidenty.

Zdroj: https://www.sggp.org.vn/bao-mat-du-lieu-thoi-ai-post824210.html

![[Fotografie] Generální tajemník a prezident To Lam spolupracuje se stranickým výborem ministerstva zdravotnictví na práci v oblasti vietnamské tradiční medicíny.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/20/1779294323718_a1-bnd-2978-3319-jpg.webp)

![[Fotografie] Předseda Národního shromáždění Tran Thanh Man pracuje se stálým výborem pro delegační záležitosti Národního shromáždění.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/20/1779294340023_ndo_br_1-1691-jpg.webp)

![[Obrázek] „Cesta naděje“ propaguje hnutí za dárcovství orgánů a tkání ve Vietnamu.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/20/1779294400833_1-8910-jpg.webp)

Komentář (0)