|

Το chatbot της OpenAI βελτιώνεται συνεχώς μέσω νέων τεχνολογιών. Φωτογραφία: New York Times . |

Τον Σεπτέμβριο του 2024, η OpenAI λάνσαρε το ChatGPT, μια έκδοση της τεχνητής νοημοσύνης που ενσωματώνει το μοντέλο o1, ικανό για συλλογισμό σε εργασίες που σχετίζονται με τα μαθηματικά, τις επιστήμες και τον προγραμματισμό υπολογιστών.

Σε αντίθεση με την προηγούμενη έκδοση του ChatGPT, η νέα τεχνολογία θα χρειαστεί χρόνο για να «σκεφτεί» λύσεις σε σύνθετα προβλήματα προτού δώσει μια απάντηση.

Μετά το OpenAI, πολλοί ανταγωνιστές όπως η Google, η Anthropic και η DeepSeek έχουν επίσης εισαγάγει παρόμοια μοντέλα συλλογισμού. Αν και δεν είναι τέλεια, εξακολουθεί να αποτελεί μια τεχνολογία αναβάθμισης chatbot στην οποία εμπιστεύονται πολλοί προγραμματιστές.

Πώς συλλογίζεται η Τεχνητή Νοημοσύνη

Ουσιαστικά, η συλλογιστική σημαίνει ότι τα chatbots μπορούν να αφιερώνουν περισσότερο χρόνο στην επίλυση προβλημάτων που θέτουν οι χρήστες.

«Η συλλογιστική είναι ο τρόπος με τον οποίο το σύστημα εκτελεί πρόσθετη εργασία αφού λάβει μια ερώτηση», δήλωσε στους New York Times ο Dan Klein, καθηγητής πληροφορικής στο Πανεπιστήμιο της Καλιφόρνια.

Ένα λογικό σύστημα μπορεί να αναλύσει ένα πρόβλημα σε μικρότερα, μεμονωμένα βήματα ή να το λύσει μέσω δοκιμής και λάθους.

Όταν κυκλοφόρησε για πρώτη φορά, το ChatGPT μπορούσε να απαντά σε ερωτήσεις άμεσα, εξάγοντας και συνθέτοντας πληροφορίες. Αντίθετα, τα συστήματα συλλογισμού χρειάζονταν μερικά δευτερόλεπτα (ή και λεπτά) επιπλέον για να λύσουν το πρόβλημα και να δώσουν μια απάντηση.

|

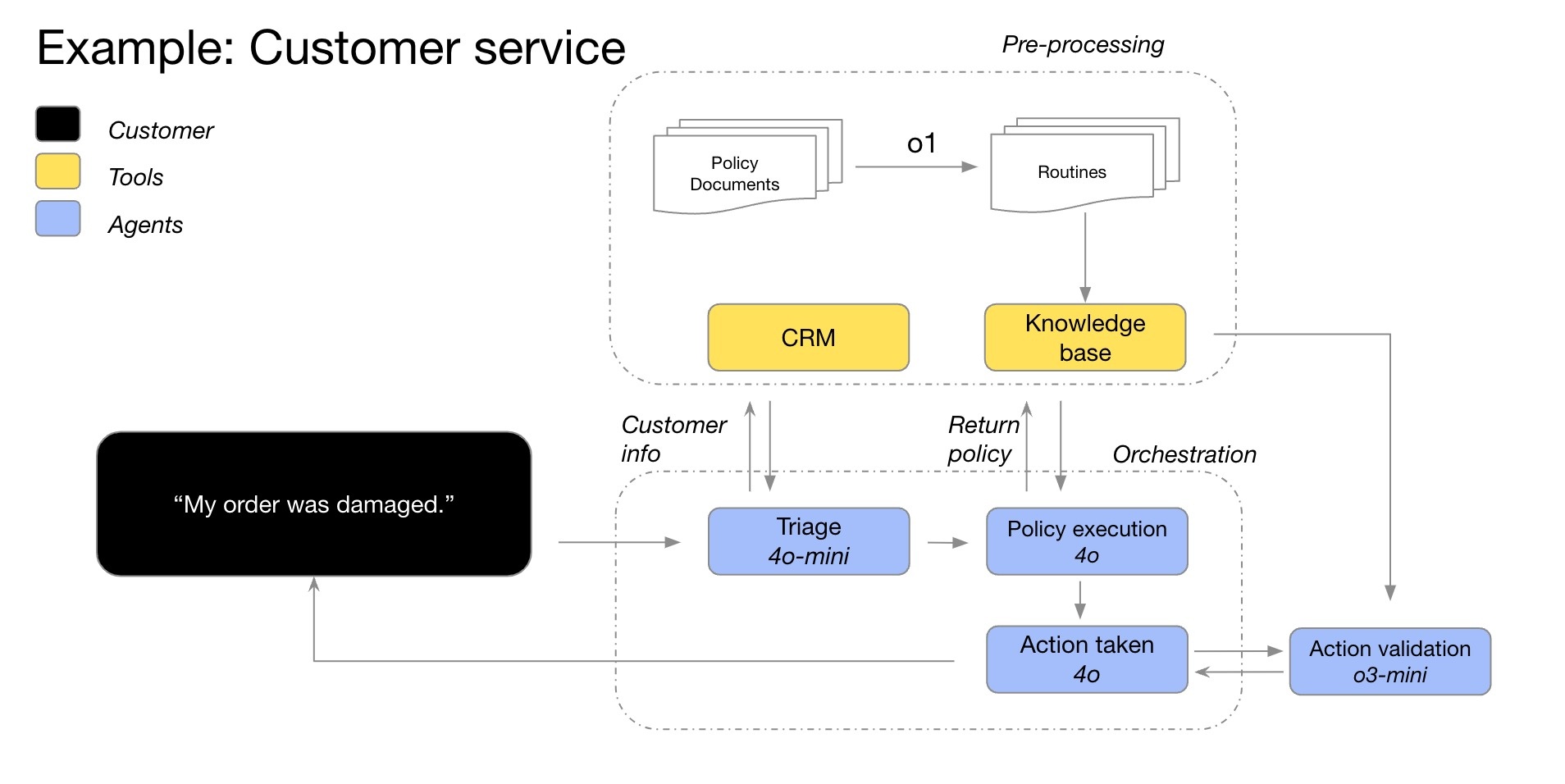

Ένα παράδειγμα της διαδικασίας συλλογισμού του μοντέλου O1 σε ένα chatbot εξυπηρέτησης πελατών. Εικόνα: OpenAI . |

Σε ορισμένες περιπτώσεις, το σύστημα συλλογισμού θα αλλάξει την προσέγγισή του στο πρόβλημα, βελτιώνοντας συνεχώς τη λύση. Επιπλέον, το μοντέλο μπορεί να δοκιμάσει πολλαπλές λύσεις πριν κάνει μια βέλτιστη επιλογή ή να ελέγξει την ακρίβεια προηγούμενων απαντήσεων.

Γενικά, το σύστημα συλλογισμού θα εξετάσει όλες τις πιθανές απαντήσεις στην ερώτηση. Αυτό είναι παρόμοιο με τους μαθητές δημοτικού που γράφουν πολλές επιλογές σε χαρτί πριν επιλέξουν την καταλληλότερη λύση σε ένα μαθηματικό πρόβλημα.

Σύμφωνα με τους New York Times , η Τεχνητή Νοημοσύνη είναι πλέον ικανή να συλλογίζεται σχεδόν σε οποιοδήποτε θέμα. Ωστόσο, θα είναι πιο αποτελεσματική σε ερωτήσεις που σχετίζονται με τα μαθηματικά, τις επιστήμες και τον προγραμματισμό υπολογιστών.

Πώς εκπαιδεύεται το θεωρητικό σύστημα;

Σε ένα τυπικό chatbot, οι χρήστες μπορούν ακόμα να ζητήσουν εξηγήσεις της διαδικασίας ή να επαληθεύσουν την ακρίβεια της απάντησης. Στην πραγματικότητα, πολλά σύνολα δεδομένων εκπαίδευσης ChatGPT περιλαμβάνουν ήδη διαδικασίες επίλυσης προβλημάτων.

Το σύστημα συλλογισμού γίνεται ακόμη πιο προηγμένο όταν μπορεί να εκτελεί λειτουργίες χωρίς την παρέμβαση του χρήστη. Αυτή η διαδικασία είναι πιο περίπλοκη και εκτεταμένη. Οι εταιρείες χρησιμοποιούν τη λέξη «συλλογισμός» επειδή το σύστημα λειτουργεί παρόμοια με τον τρόπο που σκέφτονται οι άνθρωποι.

Πολλές εταιρείες, όπως η OpenAI, αναμένουν ότι τα συστήματα συλλογισμού θα είναι η καλύτερη λύση για τη βελτίωση των chatbot που διατίθενται σήμερα. Για χρόνια, πίστευαν ότι τα chatbot είχαν καλύτερη απόδοση όσο περισσότερες πληροφορίες εκπαιδεύονταν στο διαδίκτυο.

Μέχρι το 2024, τα συστήματα τεχνητής νοημοσύνης θα έχουν χρησιμοποιήσει σχεδόν όλο το κείμενο που είναι διαθέσιμο στο διαδίκτυο. Αυτό σημαίνει ότι οι εταιρείες πρέπει να βρουν νέες λύσεις για την αναβάθμιση των chatbot, συμπεριλαμβανομένων των συστημάτων συλλογισμού.

|

Η νεοσύστατη εταιρεία DeepSeek προκάλεσε κάποτε αίσθηση με το μοντέλο συλλογισμού της, το οποίο είχε χαμηλότερο κόστος από το OpenAI. Φωτογραφία: Bloomberg . |

Από πέρυσι, εταιρείες όπως η OpenAI έχουν επικεντρωθεί σε τεχνικές ενισχυτικής μάθησης. Αυτή η διαδικασία συνήθως διαρκεί αρκετούς μήνες, κατά τους οποίους η Τεχνητή Νοημοσύνη μαθαίνει συμπεριφορά μέσω δοκιμών και σφαλμάτων.

Για παράδειγμα, λύνοντας χιλιάδες προβλήματα, το σύστημα μπορεί να εντοπίσει τη βέλτιστη μέθοδο για να καταλήξει στη σωστή απάντηση. Από εκεί, οι ερευνητές κατασκευάζουν εξελιγμένους μηχανισμούς ανατροφοδότησης που βοηθούν το σύστημα να διακρίνει μεταξύ σωστών και λανθασμένων λύσεων.

«Είναι παρόμοιο με το πώς εκπαιδεύεις έναν σκύλο. Αν το σύστημα λειτουργεί καλά, του δίνεις μια λιχουδιά. Διαφορετικά, λες, "Αυτός ο σκύλος είναι άτακτος"», μοιράστηκε ο Jerry Twerek, ερευνητής στο OpenAI.

Είναι η Τεχνητή Νοημοσύνη το μέλλον;

Σύμφωνα με τους New York Times , οι τεχνικές ενισχυτικής μάθησης είναι αποτελεσματικές όταν ασχολούμαστε με απαιτήσεις στα μαθηματικά, τις θετικές επιστήμες και τον προγραμματισμό υπολογιστών. Αυτοί είναι τομείς όπου οι σωστές ή οι λανθασμένες απαντήσεις μπορούν να καθοριστούν με σαφήνεια.

Αντίθετα, η ενισχυτική μάθηση είναι αναποτελεσματική στη γραφή, τη φιλοσοφία ή την ηθική — τομείς όπου η διάκριση μεταξύ καλού και κακού είναι δύσκολη. Παρ 'όλα αυτά, οι ερευνητές υποστηρίζουν ότι αυτή η τεχνική μπορεί να βελτιώσει την απόδοση της Τεχνητής Νοημοσύνης, ακόμη και με μη μαθηματικά ερωτήματα.

«Τα συστήματα θα μάθουν τις διαδρομές που οδηγούν σε θετικά και αρνητικά αποτελέσματα», δήλωσε ο Jared Kaplan, Επιστημονικός Διευθυντής της Anthropic.

|

Ιστότοπος της Anthropic, της νεοσύστατης εταιρείας που κατέχει το μοντέλο τεχνητής νοημοσύνης Claude. Φωτογραφία: Bloomberg . |

Είναι σημαντικό να σημειωθεί ότι η ενισχυτική μάθηση και τα συστήματα συλλογισμού είναι δύο διαφορετικές έννοιες. Συγκεκριμένα, η ενισχυτική μάθηση είναι μια μέθοδος δημιουργίας συστημάτων συλλογισμού. Αυτό είναι το τελικό στάδιο εκπαίδευσης για να μπορέσουν τα chatbot να συλλογιστούν.

Επειδή είναι ακόμη σχετικά νέο, οι επιστήμονες δεν μπορούν ακόμη να είναι βέβαιοι εάν η συλλογιστική μέσω chatbot ή η ενισχυτική μάθηση μπορούν να βοηθήσουν την Τεχνητή Νοημοσύνη να σκέφτεται όπως οι άνθρωποι. Πρέπει να σημειωθεί ότι πολλές από τις τρέχουσες τάσεις εκπαίδευσης στην Τεχνητή Νοημοσύνη αναπτύσσονται πολύ γρήγορα στην αρχή και στη συνέχεια σταδιακά επιβραδύνονται.

Επιπλέον, η συλλογιστική των chatbot μπορεί να κάνει λάθη. Με βάση την πιθανότητα, το σύστημα θα επιλέξει τη διαδικασία που μοιάζει περισσότερο με τα δεδομένα που έχει μάθει, είτε από το διαδίκτυο είτε μέσω ενισχυτικής μάθησης. Επομένως, τα chatbot μπορούν να επιλέξουν λανθασμένες ή παράλογες λύσεις.

Πηγή: https://znews.vn/ai-ly-luan-nhu-the-nao-post1541477.html

Σχόλιο (0)