Las conversaciones privadas se convierten en datos públicos

Según un informe de Fast Company, Google ha indexado miles de conversaciones privadas. Esto podría ser solo la punta del iceberg, con millones más potencialmente expuestas.

Si bien estas conversaciones no incluyeron información de identificación directa, muchos usuarios compartieron detalles personales extremadamente sensibles, desde relaciones hasta experiencias traumáticas, lo que hizo posible la identificación.

Todo comenzó cuando algunos expertos en ciberseguridad descubrieron que con una simple consulta en Google, los usuarios podían acceder fácilmente a chats compartidos públicamente.

El contenido filtrado no se limita a párrafos de muestra y preguntas técnicas, sino que también incluye información personal, trabajos confidenciales compartidos e incluso confidencias privadas.

Se determinó que la causa fue la función "Compartir chat", una utilidad implementada por OpenAI para que los usuarios compartan contenido de chat. Al seleccionar la opción "Hacer visible este chat", el sistema creará un enlace público que los motores de búsqueda podrán indexar.

Vale la pena mencionar que la interfaz de esta función no es lo suficientemente clara, lo que provoca que muchas personas malinterpreten que solo están compartiendo contenido con amigos o colegas, en lugar de hacerlo público en línea.

En respuesta a la reacción, OpenAI tomó medidas inmediatas: suspendió la difusión de sus hallazgos y trabajó con Google para eliminar los enlaces relevantes.

Según Fast Company, se han descubierto más de 4.500 enlaces de este tipo, una cifra nada pequeña teniendo en cuenta que ChatGPT tiene cientos de millones de usuarios en todo el mundo.

Lo preocupante es que muchas personas han utilizado ChatGPT para escribir correos electrónicos, intercambiar trabajo, explotar información médica o incluso confiar problemas psicológicos personales, creyendo que se trata de un espacio privado.

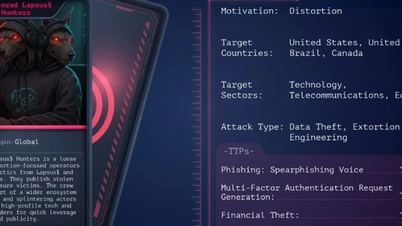

Suenan las alarmas sobre la privacidad en la era de la IA

El incidente plantea importantes interrogantes sobre la responsabilidad de las empresas de IA respecto a los datos de los usuarios. ¿Ofrece OpenAI la suficiente transparencia para que los usuarios comprendan sus derechos de privacidad? ¿El nivel de protección de datos que reciben los usuarios es realmente proporcional a la sensibilidad del contenido?

El director ejecutivo de OpenAI, Sam Altman, advirtió a los usuarios que no compartan datos personales confidenciales con ChatGPT, admitiendo que la empresa podría verse obligada a proporcionar dicha información si un tribunal lo exige legalmente.

Sin embargo, cabe destacar que en sus declaraciones Altman no mencionó que las conversaciones que los usuarios comparten voluntariamente podrían indexarse públicamente en los motores de búsqueda.

Además, esta no es la primera vez que ChatGPT ha sido cuestionado por filtraciones de datos. Los investigadores han advertido que los modelos de lenguaje grandes como GPT pueden recrear accidentalmente datos antiguos si los usuarios formulan preguntas de forma astuta.

Es innegable que herramientas como ChatGPT han revolucionado la forma en que las personas buscan información y crean contenido. Sin embargo, además de la comodidad, los usuarios deben ser conscientes de que nada es verdaderamente privado sin sólidas barreras tecnológicas y un manejo personal cuidadoso.

Fuente: https://baovanhoa.vn/nhip-song-so/hang-nghin-cuoc-tro-chuyen-chatgpt-bi-ro-ri-cong-khai-tren-google-158723.html

![[Foto] El Secretario General To Lam asiste al VIII Congreso del Comité Central del Partido de Seguridad Pública.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/4/79fadf490f674dc483794f2d955f6045)

![[Foto] Bullicioso Festival del Medio Otoño en el Museo de Etnología](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/4/da8d5927734d4ca58e3eced14bc435a3)

![[Foto] Inauguración solemne del VIII Congreso del Comité Central del Partido de Seguridad Pública, período 2025-2030](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/4/f3b00fb779f44979809441a4dac5c7df)

![[VÍDEO] Resumen de la ceremonia del 50º aniversario de Petrovietnam](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/10/4/abe133bdb8114793a16d4fe3e5bd0f12)

![[VÍDEO] EL SECRETARIO GENERAL DE LAM OTORGA A PETROVIETNAM 8 PALABRAS DE ORO: "PIONERA - EXCELENTE - SOSTENIBLE - GLOBAL"](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/7/23/c2fdb48863e846cfa9fb8e6ea9cf44e7)

Kommentar (0)