|

Se utilizan voces de algunos famosos para comentar el partido. Foto: Meta . |

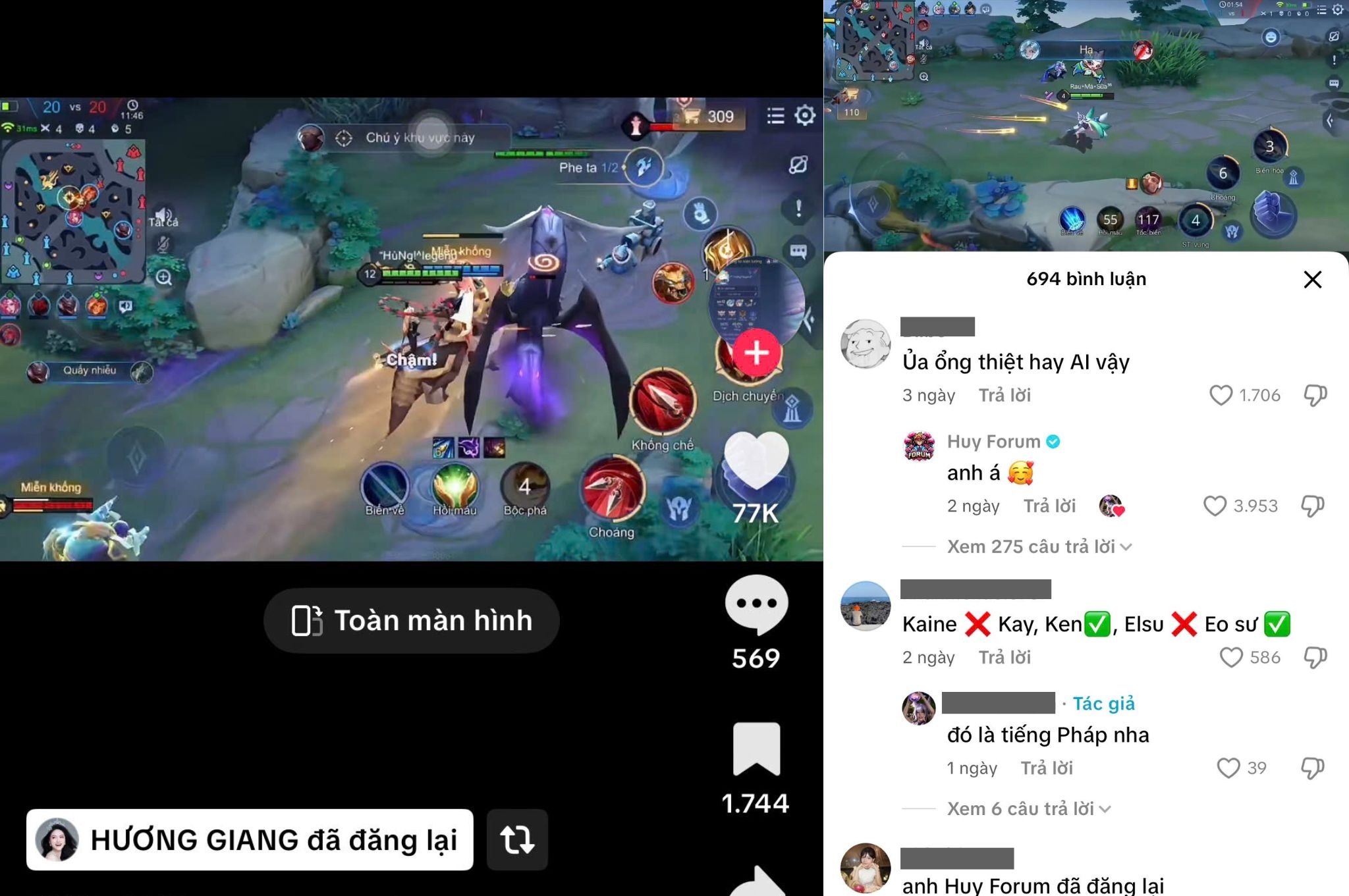

Recientemente, en redes sociales, principalmente TikTok, han aparecido varios videos grabando la pantalla mientras se juega, pero las voces que comentan provienen de famosos. Algunos artistas, como Huong Giang, Bich Phuong, Phuong My Chi, o TikTokers como Huy Forum, Tho Nguyen y Jenny Huynh, han doblado sus voces para analizar y comentar sobre el juego Lien Quan Mobile, deportes ...

Sin embargo, ninguno de los artistas puso voz a los videos , sino que los usuarios usaron IA para imitar sus voces. Siguiendo las instrucciones de una cuenta, la persona usó una herramienta llamada Minimax para convertir texto a voz.

Minimax Technology es una empresa china de inteligencia artificial famosa por su capacidad de clonar voces a partir de una breve grabación. Minimax, junto con otras plataformas como OpenAI TTS y ElevenLabs, ha simplificado la tecnología, permitiendo que cualquier persona pueda crear la voz de cualquier persona.

Minimax cuenta con el respaldo de grandes corporaciones como Tencent, Alibaba y numerosos fondos de capital riesgo. Sus clientes pertenecen a diversos sectores, como videojuegos, educación , finanzas y entretenimiento, con propósitos comunes como el doblaje de videojuegos, la narración de momentos destacados de deportes y su inclusión en vídeos de comedia.

Los clips cortos con voces de famosos pueden viralizarse y convertirse fácilmente en tendencia. Los espectadores se sentirán nuevos e interesantes al escuchar a sus famosos favoritos comentar sobre partidos o decir frases de moda.

La mayoría de la gente reconoció la voz de una IA y comentó intencionalmente para elogiar la voz de la celebridad. Algunas personas reales, como Huong Giang y Huy Forum, también expresaron su satisfacción al ver que sus voces se usaban con humor y republicaron el contenido.

|

Huong Giang y Huy Forum republicaron videos de IA usando sus voces. Foto: TikTok. |

Con tan solo unas pocas grabaciones disponibles, los usuarios solo tienen que rellenar el contenido que quieren imitar y esperar unos minutos para obtener una versión completa. Como resultado, se crean muchas cuentas nuevas, por ejemplo, utilizando la sintaxis del nombre de la celebridad acompañado del título del juego, para publicar este tipo de vídeos. «Casi no queda ninguna celebridad que no juegue a Lien Quan», bromeó un comentarista.

Si bien aporta entretenimiento al mundo digital, algunos usuarios han explotado esta función con fines maliciosos. Las estafas de Deepvoice se han vuelto cada vez más sofisticadas, utilizando las voces de seres queridos en situaciones de emergencia para forzar transferencias de dinero instantáneas.

En Vietnam, un tipo de estafa que se ha vuelto popular recientemente es llamar a los padres para informarles que sus hijos han tenido un accidente y necesitan transferir dinero inmediatamente para una cirugía.

En el extranjero, un director de una empresa en el Reino Unido fue estafado por más de 240.000 dólares tras escuchar a su "jefe" pedirle que transfiriera dinero por teléfono. Un empleado de finanzas de Hong Kong fue estafado para que transfiriera 3,3 millones de dólares tras recibir una llamada de su "director".

En China, Minimax y otras empresas de inteligencia artificial de voz suelen estipular que no se permiten voces humanas reales sin permiso, pero en realidad es muy difícil de controlar. Esta tecnología es bastante similar a los deepfakes que usan rostros de famosos, solo que en este caso se trata de la voz, para publicidad ilegal, declaraciones controvertidas y noticias falsas.

Muchos artistas internacionales como Drake y The Weeknd se han pronunciado tras la viralización de la canción "AI cover" con sus voces. El problema de la invasión de la privacidad y la difusión de noticias falsas mediante IA también está generando controversia en muchos países del mundo, con el objetivo de establecer un marco legal adecuado.

La clonación de voz, además del doblaje para vídeos de entretenimiento como el mencionado, también puede utilizarse con fines positivos, como recrear la voz de un ser querido fallecido o apoyar a quienes han perdido la voz. Sin embargo, cualquier persona que utilice su voz debe ser informada del incidente para controlar y reducir eficazmente el alto riesgo de abuso.

Fuente: https://znews.vn/su-that-ve-clip-phuong-my-chi-huong-giang-binh-luan-game-post1579300.html

![[Foto] Los bloques del desfile pasan por Hang Khay-Trang Tien durante el ensayo preliminar.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/27/456962fff72d40269327ac1d01426969)

![[Foto] Imágenes del ensayo preliminar a nivel estatal del desfile militar en la plaza Ba Dinh](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/27/807e4479c81f408ca16b916ba381b667)

Kommentar (0)