Avec son développement rapide, l'intelligence artificielle (IA) révolutionne de nombreux domaines, de la santé à l'éducation , en passant par le commerce et la vie quotidienne. Cependant, les inconvénients de cette technologie posent des défis importants en matière de gestion et de contrôle de l'information dans le cyberespace.

Inondés de fausses informations générées par l'IA.

Les fausses informations générées par l'IA sont diffusées sur les plateformes de médias sociaux principalement pour obtenir des vues, des « j'aime » et de l'engagement afin de générer des ventes en ligne ou de tirer profit de la plateforme.

Les créateurs de fausses informations exploitent souvent l'actualité brûlante qui capte l'attention du public. Par exemple, après le grave accident de la route survenu le 17 septembre au marché de Tan Long, dans la commune de Lao Bao (province de Quang Tri) , qui a fait 12 victimes, des images bouleversantes sont apparues sur les réseaux sociaux, provoquant l'émotion de nombreux internautes. Ayant identifié ces images comme étant générées par une intelligence artificielle, la police de la commune de Lao Bao a mis en garde contre la diffusion de ces images trompeuses. Ce comportement propage non seulement de fausses informations, mais entrave également les enquêtes.

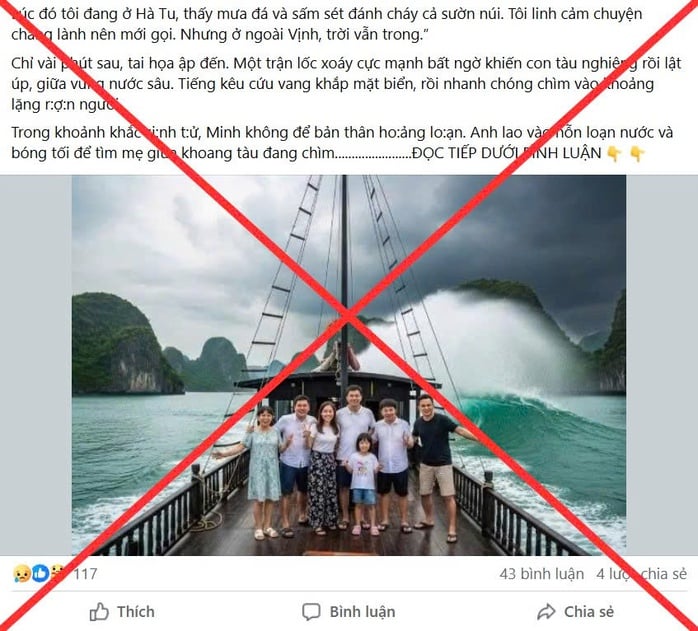

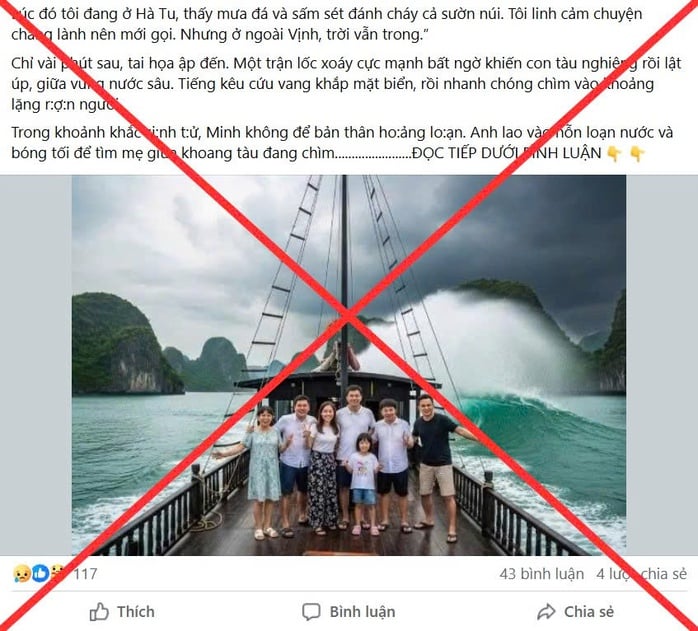

De même, profitant de l'attention médiatique suscitée par le naufrage du bateau touristique Green Bay 58 dans la baie d'Ha Long, province de Quang Ninh, le 19 juillet, qui a coûté la vie à des dizaines de personnes, de nombreux comptes sur les réseaux sociaux ont publié des images et des témoignages poignants sur les victimes. Cependant, une part importante de ce contenu était fausse, créée à l'aide d'intelligence artificielle pour manipuler les émotions et susciter l'interaction des utilisateurs. Il est à noter que la diffusion massive de fausses images, accompagnées d'une compassion exagérée, risque d'aggraver le traumatisme des familles des victimes.

Grâce aux progrès constants de l'intelligence artificielle, il suffit de quelques minutes et de commandes simples pour créer une vidéo au contenu captivant, parfaitement adaptée aux attentes de l'utilisateur. Parmi les plateformes d'IA de nouvelle génération, telles que KlingAI, Veo 3 et Sora, sont très populaires auprès des utilisateurs du monde entier, y compris au Vietnam.

Par ailleurs, la technologie deepfake – qui combine apprentissage profond et falsification – constitue également une préoccupation majeure à l'échelle mondiale, car elle permet de créer des images, des sons ou des vidéos d'un réalisme saisissant, les rendant quasiment indétectables. De ce fait, de nombreuses escroqueries liées à cette technologie ont eu lieu au Vietnam et dans le monde entier.

Le lieutenant-général Nguyen Minh Chinh, vice-président permanent de l'Association nationale de cybersécurité, a constaté une recrudescence des abus de l'IA à des fins illégales. Plus précisément, les cybercriminels exploitent l'IA en tant que service (outils et applications fournis par l'IA) pour créer des logiciels malveillants, usurper des voix, des visages et des textes, et ce, dans le but de commettre des fraudes, des cyberattaques, des intrusions dans les systèmes de données, voire de déstabiliser la sécurité et de nuire à la réputation des organisations, des entreprises et de leurs dirigeants.

Selon M. Tran Ngoc Anh, directeur technique de Hoa Binh Cyber Space Company Limited (CyPeace), l'un des risques pour les utilisateurs d'IA réside dans la possibilité de recevoir de la désinformation générée par l'outil lui-même. S'y ajoutent de nombreux autres problèmes, tels que la fuite d'informations confidentielles et de données personnelles.

De fausses images sont diffusées en ligne pour « faire pleurer les internautes », obtenant ainsi des « j’aime » et augmentant l’interaction (Capture d’écran).

Renforcer la responsabilité des utilisateurs

Avant que des mesures technologiques et juridiques ne soient mises en place pour contrôler strictement le développement et l'utilisation de l'IA, les utilisateurs doivent utiliser cette technologie de manière proactive et responsable.

Vu Ngoc Son, expert en cybersécurité et président du Comité technologique de l'Association nationale de cybersécurité, a souligné que les humains sont les acteurs qui exploitent et utilisent l'IA. Par conséquent, les aspects positifs comme négatifs de l'IA sont étroitement liés à l'humain. Si les utilisateurs sont compétents et l'emploient à bon escient, la technologie déploiera tout son potentiel à leur avantage. À l'inverse, si les utilisateurs de l'IA manquent de compréhension ou l'exploitent à des fins illégales, cela peut avoir de graves conséquences. « Pour utiliser et exploiter efficacement l'IA, il est essentiel de se concentrer sur la constitution d'une équipe et la mise en place de processus. L'IA ne révèle tout son potentiel que lorsqu'elle est entre les mains de ceux qui savent la maîtriser », a déclaré l'expert en cybersécurité.

Compte tenu des dangers que représentent les technologies de deepfake – un outil majeur facilitant la cyberfraude actuelle –, le ministère des Finances a souligné, lors de l'élaboration de la loi sur l'investissement et le commerce, la nécessité de réglementer le secteur des deepfakes comme un secteur d'activité soumis à conditions afin de prévenir toute utilisation abusive de cette technologie, source de perturbations de l'information et de fraudes. Selon le ministère des Finances, le secteur des deepfakes constitue actuellement l'un des nouveaux domaines présentant des risques complexes pour la sécurité et l'ordre public, or il n'est pas encore réglementé comme un secteur d'activité soumis à conditions.

Selon l'avocat Tran Anh Tuan (Barreau de Hanoï), l'utilisation de l'IA pour créer du contenu sans autorisation, notamment pour diffuser des informations fausses, falsifiées ou frauduleuses, peut constituer une infraction au Code civil. Les contrevenants s'exposent à des sanctions administratives ou au versement de dommages et intérêts. Dans les cas les plus graves, des poursuites pénales peuvent être engagées. « Les utilisateurs doivent faire preuve de prudence lorsqu'ils accèdent à l'IA et l'utilisent, en évitant absolument toute action visant à exploiter l'IA pour générer des vues ou des "j'aime". Ils doivent renforcer leur responsabilité individuelle et respecter la loi lorsqu'ils utilisent l'IA et interagissent en ligne », a conseillé l'avocat Tuan.

Le lieutenant-général Nguyen Minh Chinh a souligné que les ressources humaines constituent l'élément central d'un développement durable de l'IA. Des chercheurs aux ingénieurs, en passant par les experts en cybersécurité, les gestionnaires et les utilisateurs, chacun doit posséder toutes les connaissances, les compétences, l'éthique et la sensibilisation juridique nécessaires. Selon lui, il s'agit non seulement de l'équipe qui conçoit et exploite les systèmes d'IA, mais aussi de la force motrice essentielle pour prévenir, détecter et combattre la cybercriminalité.

Le Vietnam se dotera d'une loi sur l'intelligence artificielle.

Lors d'une récente conférence scientifique nationale sur l'IA, le ministre des Sciences et des Technologies, Nguyen Manh Hung, a déclaré que l'IA offre de formidables opportunités, mais soulève également de nombreuses questions d'éthique, d'emploi et de confiance sociale. Par conséquent, le développement de l'IA doit être rapide, sûr et respectueux de l'humain.

Selon le ministre Nguyen Manh Hung, l'IA ne remplace pas l'humain, mais le sert en tant qu'assistant. L'IA est un outil puissant, mais ce sont les humains qui prennent les décisions ; par conséquent, l'IA doit soutenir, et non remplacer, la pensée, les valeurs et les responsabilités humaines. « Le ministère des Sciences et des Technologies publiera un code de déontologie national pour l'IA, harmonisé avec les normes internationales mais adapté au contexte vietnamien, et élaborera également une loi et une stratégie en matière d'IA », a déclaré le ministre Nguyen Manh Hung.

Source : https://nld.com.vn/ngan-cong-nghe-vuot-ranh-gioi-dao-duc-196250923205638915.htm

Comment (0)