Thẩm phán P. Kevin Castel cho biết các luật sư đã hành động vô trách nhiệm. Tuy nhiên, ông ghi nhận lời xin lỗi và các bước khắc phục hậu quả của hai luật sư, đồng thời giải thích lý do tại sao các biện pháp trừng phạt khắc nghiệt hơn là không cần thiết để đảm bảo các luật sư khác sẽ không học theo.

Ảnh: CNYB

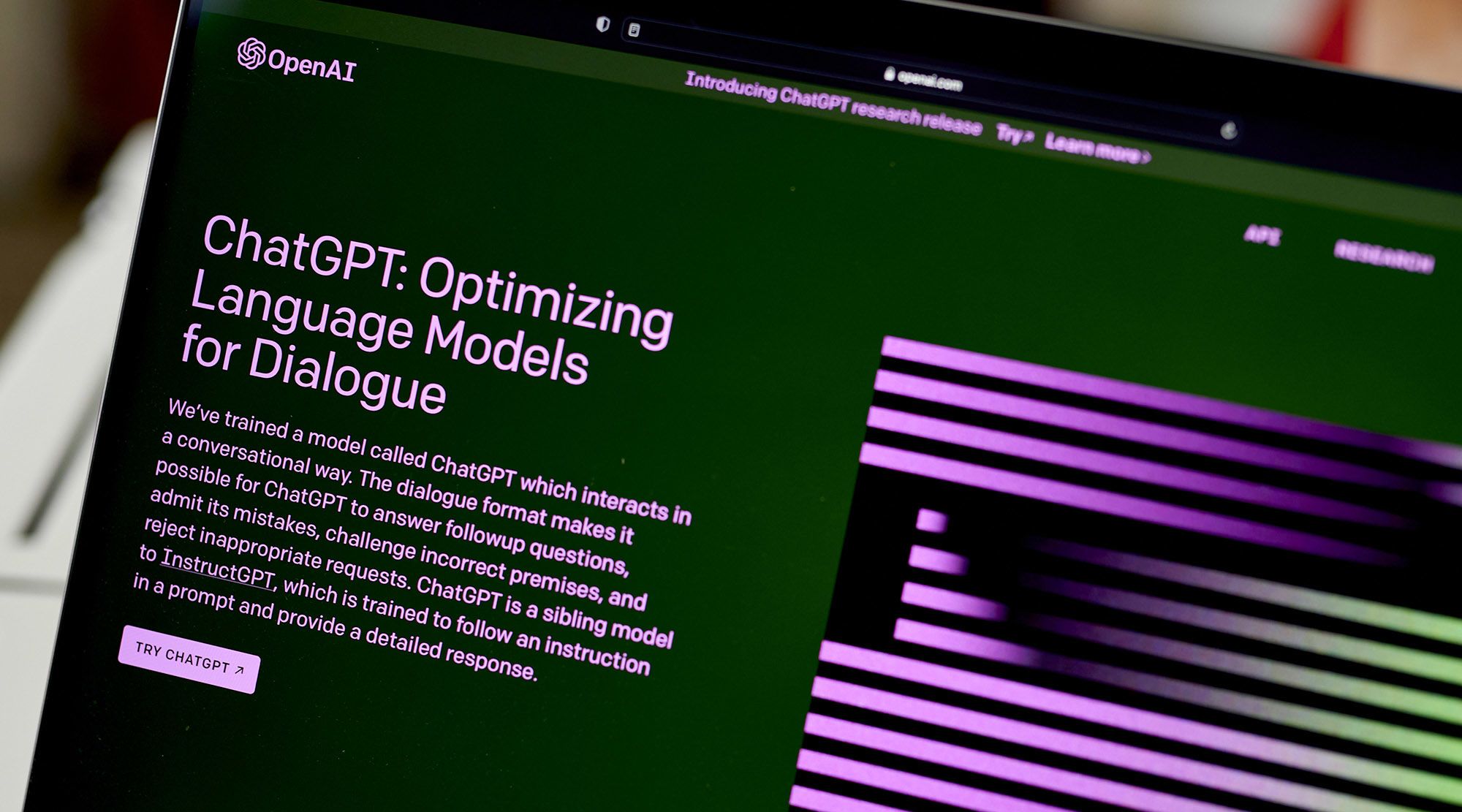

“Những tiến bộ về công nghệ là điều bình thường và không có gì là sai trái khi sử dụng một công cụ trí tuệ nhân tạo đáng tin cậy để được hỗ trợ", ông Castel viết. “Nhưng các quy tắc hiện hành yêu cầu các luật sư phải đảm bảo tính chính xác của hồ sơ mà họ gửi lên”.

Thẩm phán cho biết các luật sư và công ty luật Levidow & Oberman “đã từ bỏ trách nhiệm của mình khi đưa ra các ý kiến tư pháp không tồn tại với các trích dẫn giả do công cụ trí tuệ nhân tạo ChatGPT tạo ra".

Trong một tuyên bố, công ty luật cho biết họ sẽ tuân thủ lệnh của thẩm phán, nhưng nói thêm rằng: “Chúng tôi rất không đồng ý với ý kiến rằng bất kỳ ai tại công ty của chúng tôi đã hành động một cách thiếu trách nhiệm. Chúng tôi đã xin lỗi Tòa án và khách hàng của chúng tôi. Đây là một tình huống chưa từng có với ngành tư pháp, và chúng tôi đã phạm sai lầm khi không tin rằng công nghệ có thể bịa đặt ra hoàn toàn các vụ án không có thật".

Tại một phiên điều trần hồi đầu tháng này, một luật sư cho biết anh đã sử dụng chatbot hỗ trợ trí tuệ nhân tạo để giúp tìm các tiền lệ pháp lý hỗ trợ vụ kiện của một khách hàng chống lại hãng hàng không Colombia Avianca vì một chấn thương xảy ra trên chuyến bay năm 2019.

Thẩm phán cho biết một trong những quyết định giả mạo do chatbot tạo ra “có một số đặc điểm trông có vẻ phù hợp với các quyết định tư pháp thực tế”, nhưng bên trong chúng chứa toàn sự "vô nghĩa".

Quốc Thiên (theo AP)

Nguồn

![[Ảnh] Khám phá "kỳ quan" dưới đáy biển Gia Lai](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/6/befd4a58bb1245419e86ebe353525f97)

![[Ảnh] Nghệ An: Đường tỉnh 543D bị sạt lở nghiêm trọng do mưa lũ](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/5/5759d3837c26428799f6d929fa274493)

Bình luận (0)