इकोलीक और कृत्रिम बुद्धिमत्ता के संभावित जोखिम

जैसे-जैसे कृत्रिम बुद्धिमत्ता (एआई) रिपोर्ट लिखने, ईमेल का जवाब देने और डेटा विश्लेषण करने से लेकर हर चीज़ का हिस्सा बनती जा रही है, ऐसा लगता है कि हम अभूतपूर्व सुविधा के युग में जी रहे हैं। लेकिन सुविधा के नकारात्मक पहलू भी स्पष्ट होने लगे हैं, खासकर जब सुरक्षा की बात आती है।

हाल ही में इकोलीक नामक सुरक्षा भेद्यता के कारण माइक्रोसॉफ्ट कोपायलट सेवा के उपयोगकर्ताओं के लिए यह जोखिम उत्पन्न हो गया है कि उनके द्वारा कोई कार्रवाई किए बिना ही उनका संवेदनशील डेटा लीक हो जाएगा।

जब AI एक सुरक्षा भेद्यता बन जाता है

टुओई ट्रे ऑनलाइन के शोध के अनुसार, इकोलीक एक नई दर्ज सुरक्षा भेद्यता है जिसका कोड CVE-2025-32711 है, जिसे विशेषज्ञों ने NIST के पैमाने के अनुसार 9.3/10 पर खतरनाक माना है।

सुरक्षा विशेषज्ञों को इस बात की चिंता है कि यह "शून्य-क्लिक" प्रकृति का है: हमलावर कोपायलट से डेटा का दोहन कर सकते हैं, बिना उपयोगकर्ता को क्लिक करने, फ़ाइल खोलने, या यहां तक कि कुछ भी हो रहा है, इसकी जानकारी दिए बिना।

यह कोई साधारण बग नहीं है। इस खामी का पता लगाने वाली ऐम लैब्स की शोध टीम का मानना है कि इकोलीक एजेंट- और आरएजी-आधारित एआई सिस्टम में एक आम डिज़ाइन खामी को दर्शाता है। चूँकि कोपायलट, माइक्रोसॉफ्ट 365 ऐप्स के उस सूट का हिस्सा है जिसमें लाखों उपयोगकर्ताओं के ईमेल, दस्तावेज़, स्प्रेडशीट और मीटिंग शेड्यूल होते हैं, इसलिए डेटा लीक होने की संभावना विशेष रूप से गंभीर है।

समस्या सिर्फ़ विशिष्ट कोड में ही नहीं, बल्कि बड़े भाषा मॉडल (LLM) के काम करने के तरीके में भी है। AI को सटीक प्रतिक्रिया देने के लिए काफ़ी संदर्भ की ज़रूरत होती है, और इसलिए उन्हें काफ़ी पृष्ठभूमि डेटा तक पहुँच दी जाती है। इनपुट और आउटपुट पर स्पष्ट नियंत्रण के बिना, AI को ऐसे तरीक़ों से "संचालित" किया जा सकता है जिनके बारे में उपयोगकर्ताओं को पता ही नहीं होता। इससे एक नए तरह का "बैकडोर" बनता है जो कोड में किसी खामी के कारण नहीं, बल्कि इसलिए होता है क्योंकि AI मानवीय समझ से परे व्यवहार करते हैं।

माइक्रोसॉफ्ट ने तुरंत एक पैच जारी किया, और अब तक किसी भी तरह के वास्तविक नुकसान की सूचना नहीं मिली है। लेकिन इकोलीक से सबक स्पष्ट है: जब एआई को कार्य प्रणालियों में गहराई से एकीकृत किया जाता है, तो संदर्भ को समझने में होने वाली छोटी-छोटी गलतियाँ भी सुरक्षा के लिए बड़े परिणाम पैदा कर सकती हैं।

एआई जितना अधिक सुविधाजनक होता जाता है, व्यक्तिगत डेटा उतना ही अधिक नाजुक होता जाता है।

इकोलीक की घटना एक चिंताजनक सवाल खड़ा करती है: क्या लोग एआई पर इतना भरोसा करते हैं कि उन्हें यह एहसास ही नहीं होता कि उन्हें ट्रैक किया जा सकता है या सिर्फ़ एक टेक्स्ट मैसेज से उनकी निजी जानकारी सार्वजनिक हो सकती है ? एक नई खोजी गई खामी, जो हैकर्स को बिना कोई बटन दबाए चुपचाप डेटा निकालने की सुविधा देती है, एक ऐसी चीज़ है जो पहले सिर्फ़ साइंस फिक्शन फ़िल्मों में ही दिखाई जाती थी, लेकिन अब एक हक़ीक़त बन गई है।

जबकि एआई अनुप्रयोग तेजी से लोकप्रिय हो रहे हैं, कोपायलट जैसे आभासी सहायकों से लेकर, बैंकिंग, शिक्षा में चैटबॉट्स, सामग्री लिखने और ईमेल संसाधित करने वाले एआई प्लेटफार्मों तक, अधिकांश लोगों को इस बारे में चेतावनी नहीं दी जाती है कि उनका डेटा कैसे संसाधित और संग्रहीत किया जाता है।

एआई प्रणाली के साथ "चैटिंग" अब केवल सुविधा के लिए कुछ प्रश्न पूछने तक ही सीमित नहीं है, बल्कि यह अनजाने में आपके स्थान, आदतों, भावनाओं या यहां तक कि खाते की जानकारी का भी खुलासा कर सकती है।

वियतनाम में, कई लोग डिजिटल सुरक्षा की बुनियादी जानकारी के बिना भी फ़ोन और कंप्यूटर पर AI का इस्तेमाल करने से परिचित हैं। कई लोग AI के साथ निजी जानकारी साझा करते हैं क्योंकि उनका मानना है कि "यह सिर्फ़ एक मशीन है"। लेकिन वास्तव में, इसके पीछे एक ऐसी प्रणाली होती है जो डेटा को रिकॉर्ड कर सकती है, सीख सकती है और दूसरी जगहों पर भेज सकती है, खासकर जब AI प्लेटफ़ॉर्म किसी तीसरे पक्ष से आता है और सुरक्षा के लिए उसका स्पष्ट रूप से परीक्षण नहीं किया गया हो।

जोखिमों को सीमित करने के लिए, उपयोगकर्ताओं को जरूरी नहीं कि तकनीक छोड़नी पड़े, लेकिन अधिक जागरूक होने की आवश्यकता है: उन्हें सावधानीपूर्वक जांच करनी चाहिए कि वे जिस एआई एप्लिकेशन का उपयोग कर रहे हैं उसका कोई विश्वसनीय स्रोत है या नहीं, क्या डेटा एन्क्रिप्टेड है, और विशेष रूप से आईडी नंबर, बैंक खाते, स्वास्थ्य जानकारी जैसी संवेदनशील जानकारी को स्पष्ट रूप से चेतावनी दिए बिना किसी भी एआई सिस्टम के साथ साझा नहीं करना चाहिए ।

जिस प्रकार इंटरनेट का जन्म हुआ था, उसी प्रकार एआई को भी पूर्ण होने में समय लगता है और उस समय के दौरान, उपयोगकर्ताओं को सबसे पहले सक्रिय रूप से स्वयं की सुरक्षा करनी चाहिए।

क्या आप कभी भी AI के साथ बहुत अधिक जानकारी साझा करते हैं?

"इस रिपोर्ट को मेरे लिए ज़्यादा सहजता से दोबारा लिखें" या "कल की मीटिंग का सारांश" जैसे कमांड टाइप करते समय, बहुत से लोग यह नहीं सोचते कि उनके द्वारा दर्ज की गई सारी जानकारी, जिसमें आंतरिक विवरण, व्यक्तिगत भावनाएँ और कार्य आदतें शामिल हैं, एआई द्वारा रिकॉर्ड की जा सकती है। हम स्मार्ट टूल्स से चैट करने के इतने आदी हो गए हैं कि सुविधा और गोपनीयता के बीच की रेखा ही भूल जाते हैं।

स्रोत: https://tuoitre.vn/lo-hong-bao-mat-trong-microsoft-copilot-canh-bao-moi-ve-nguy-co-ro-ri-du-lieu-tu-ai-20250620103045262.htm

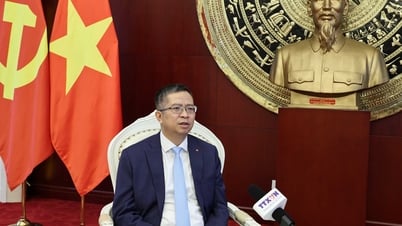

![[फोटो] राष्ट्रपति लुओंग कुओंग न्यूज़ीलैंड संसद के अध्यक्ष गेरी ब्राउनली का स्वागत करते हुए](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/29/7accfe1f5d85485da58b0a61d35dc10f)

टिप्पणी (0)