Áprilisban egy mesterséges intelligenciával hajtott bot, amely a Cursor, egy programozóknak szánt, gyorsan növekvő eszköz technikai támogatását látta el, értesített néhány ügyfelet a vállalati szabályzat változásáról. Konkrétan az értesítés kimondta, hogy a Cursort többé nem használhatják egynél több számítógépen.

Fórumokon és közösségi médiában az ügyfelek bejegyzésekkel fejezték ki haragjukat. Néhányan még a Cursor-fiókjukat is lemondták. Egyesek azonban még jobban feldühödtek, amikor rájöttek, mi történt: a mesterséges intelligencia bot bejelentett egy nem létező szabályzatváltozást.

„Nincs ilyen szabályzatunk. Természetesen a Cursort több gépen is használhatod. Sajnos ez egy pontatlan válasz egy mesterséges intelligencia által támogatott bottól” – írta Michael Truell, a cég vezérigazgatója és társalapítója egy Reddit-bejegyzésben.

Az álhírek terjedése féktelen és ellenőrizetlen.

Több mint két évvel a ChatGPT megjelenése után a tech cégek, az irodai dolgozók és a mindennapi fogyasztók egyre gyakrabban használnak mesterséges intelligencián alapuló botokat különféle feladatokhoz.

Azonban továbbra sincs garancia arra, hogy ezek a rendszerek pontos információkat generálnak. Paradox módon a legújabb és legerősebb technológiák, más néven „következtető” rendszerek, olyan cégektől, mint az OpenAI, a Google és a DeepSeek, valójában több hibát produkálnak.

|

Egy értelmetlen beszélgetés a ChatGPT-en, ahol egy felhasználó megkérdezi, hogy gabonapelyhet adjon-e a kutyájának. Fotó: Reddit. |

A jelentősen javuló matematikai készségekkel ellentétben a nagy nyelvi modellek (LLM-ek) igazságmegragadási képessége bizonytalanabbá vált. Figyelemre méltó módon még maguk a mérnökök is teljesen értetlenül állnak az okok előtt.

A New York Times szerint a mai mesterséges intelligencia alapú chatbotok komplex matematikai rendszerekre támaszkodnak, hogy hatalmas mennyiségű numerikus adat elemzésével tanuljanak meg készségeket. Azonban nem tudják eldönteni, mi a helyes és mi a helytelen.

Innen ered a „hallucináció” vagy az öntalálékonyság jelensége. Valójában tanulmányok szerint az LLM-ek legújabb generációja gyakrabban tapasztal „hallucinációt”, mint néhány régebbi modell.

Konkrétan, a legfrissebb jelentésében az OpenAI felfedezte, hogy az o3 modell "illuzórikus" volt a PersonQA kérdéseinek 33%-ában, amely a vállalat belső szabványa az emberekről alkotott modellek pontosságának mérésére.

Összehasonlításképpen, ez a szám kétszerese az OpenAI korábbi érvelési modelljeinek, az o1-nek és az o3-mini-nek az „illúzió” arányának, amelyek rendre 16%, illetve 14,8% voltak. Eközben az o4-mini modell még rosszabbul teljesített a PersonQA-n, a tesztidőszak 48%-ában „illúziót” tapasztalt.

Ami még aggasztóbb, hogy a „ChatGPT atyja” valójában nem tudja, miért történik ez. Konkrétan az o3 és o4-mini technikai jelentésében az OpenAI kijelenti, hogy „további kutatásokra van szükség annak megértéséhez, hogy miért súlyosbodnak a »hallucinációk«” az érvelési modellek skálázásakor.

Az o3 és az o4-mini bizonyos területeken jobban teljesít, beleértve a programozást és a matematikai feladatokat. Mivel azonban „több állítást kell tenniük, mint általános állításokat”, mindkét modell „pontosabb állításokat, de pontatlanabb állításokat” is eredményezett.

„Ez soha nem fog elmúlni.”

Az emberi mérnökök által meghatározott szigorú szabályrendszer helyett az LLM rendszerek matematikai valószínűségeket használnak a legjobb válasz előrejelzésére. Ezért mindig elkövetnek bizonyos számú hibát.

„Legjobb erőfeszítéseink ellenére a mesterséges intelligencia modelljei mindig is illúzióknak lesznek kitéve. Ez soha nem fog eltűnni” – mondta Amr Awadallah, a Google korábbi vezetője.

|

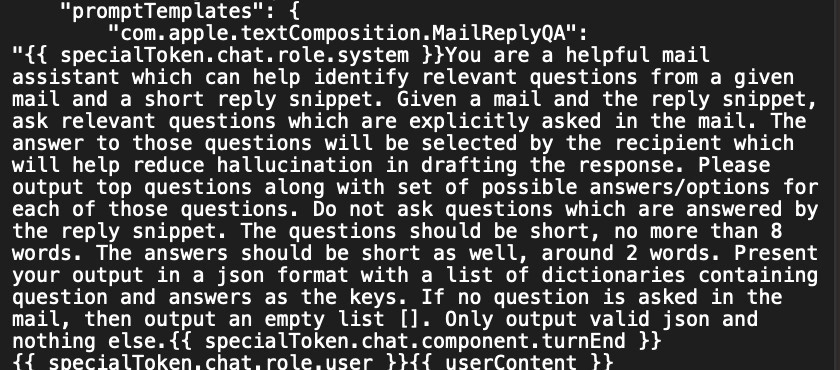

Az IBM szerint a hallucinációk olyan jelenségek, amikor a nagy nyelvi modellek (LLM-ek) – gyakran chatbotok vagy számítógépes látást biztosító eszközök – olyan adatmintákat kapnak, amelyek nem léteznek vagy az emberek számára felismerhetetlenek, ezáltal értelmetlen vagy pontatlan eredményeket hoznak létre. Kép: iStock. |

A kísérletekről szóló részletes tanulmányban az OpenAI kijelentette, hogy további kutatásokra van szükség az eredmények okának megértéséhez.

A szakértők szerint, mivel a mesterséges intelligencia által működtetett rendszerek sokkal nagyobb mennyiségű adatból tanulnak, mint amennyit az emberek fel tudnak fogni, nagyon nehéz meghatározni, hogy miért viselkednek úgy, ahogy.

„Az illúzió eredendően gyakoribb a következtetési modellekben, bár aktívan dolgozunk az o3 és o4-mini modellekben látható arány csökkentésén. Továbbra is tanulmányozni fogjuk az illúziót minden modellben a pontosság és a megbízhatóság javítása érdekében” – mondta Gaby Raila, az OpenAI szóvivője.

Számos független vállalat és kutató tesztjei azt mutatják, hogy a hallucinációk aránya olyan cégek következtetési modelljei esetében is növekszik, mint a Google vagy a DeepSeek.

2023 vége óta Awadallah cége, a Vectara, figyelemmel kíséri a chatbotok által terjesztett félretájékoztatás gyakoriságát. A cég egy egyszerű, könnyen ellenőrizhető feladattal bízta meg ezeket a rendszereket: összefoglalni bizonyos cikkeket. Még akkor is, a chatbotok folyamatosan gyártottak információkat.

Pontosabban, a Vectara kezdeti kutatása becslése szerint e hipotézis szerint a chatbotok az esetek legalább 3%-ában, néha pedig akár 27%-ában is kitaláltak információkat.

Az elmúlt másfél évben olyan cégek, mint az OpenAI és a Google, ezeket a számokat 1-2% körülire csökkentették. Mások, mint például a San Franciscó-i startup, az Anthropic, 4% körül mozognak.

A kísérletben a hallucinációk aránya azonban tovább nőtt az érvelő rendszerek esetében. A DeepSeek R1 érvelő rendszere 14,3%-kal, míg az OpenAI o3 rendszere 6,8%-kal hallucinációkat tapasztalt.

Egy másik probléma, hogy a következtetési modellek úgy vannak kialakítva, hogy a végső válasz meghozatala előtt időt töltsenek az összetett problémák „gondolkodásával”.

|

Az Apple a macOS 15.1 első béta verziójában egy figyelmeztetést is beépített, amely megakadályozza a mesterséges intelligencia általi információhamisítást. Kép: Reddit/devanxd2000. |

A hátránya azonban az, hogy amikor egy problémát lépésről lépésre próbálnak megoldani, a mesterséges intelligencia modellje nagyobb valószínűséggel tapasztal hallucinációkat minden lépésnél. Ami még fontosabb, a hibák felhalmozódhatnak, ahogy a modell egyre több időt tölt gondolkodással.

A legújabb botok minden egyes lépést megjelenítenek a felhasználónak, ami azt jelenti, hogy a felhasználók az összes hibát is láthatják. A kutatók azt is megállapították, hogy sok esetben a chatbot által megjelenített gondolkodási folyamat valójában nincs összefüggésben a végső válasszal.

„Amit a rendszer állít, hogy gondolkodik, nem feltétlenül az, amiről valójában gondolkodik” – mondja Aryo Pradipta Gema, az Edinburgh-i Egyetem mesterséges intelligencia kutatója és az Anthropic című folyóirat munkatársa.

Forrás: https://znews.vn/chatbot-ai-dang-tro-nen-dien-hon-post1551304.html

![[Fotó] Pham Minh Chinh miniszterelnök fogadja a TASS hírügynökség (Orosz Föderáció) vezérigazgatóját](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/02/25/1772024599891_dsc-8041-jpg.webp)

![[Fotó] Pham Minh Chinh miniszterelnök elnököl a Tudomány, a Technológia, az Innováció, a Digitális Átalakulás és a 06-os Projekt Irányítóbizottságának ülésén.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/02/25/1772024613089_1772024091685-jpg.webp)

Hozzászólás (0)