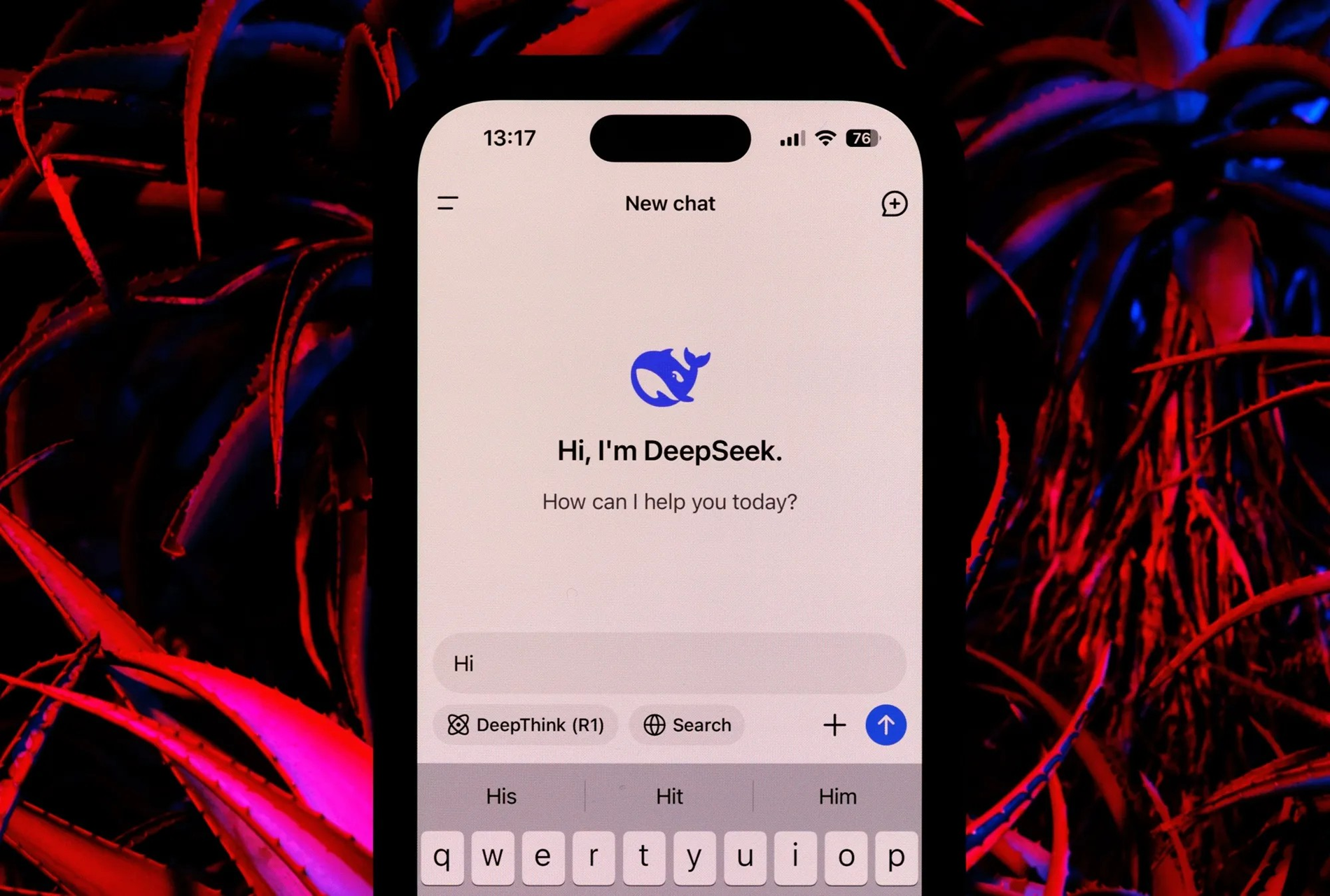

DeepSeek, perusahaan rintisan Tiongkok yang paling populer belakangan ini, telah menimbulkan keraguan tentang klaimnya menciptakan AI yang setara dengan OpenAI hanya dengan $5 juta.

DeepSeek mendapat liputan media yang luas, baik di media massa maupun media sosial, pada awal Tahun Ular, yang menyebabkan guncangan signifikan di pasar saham global.

Namun, sebuah laporan terbaru dari firma konsultan keuangan Bernstein memperingatkan bahwa, terlepas dari pencapaian yang mengesankan, klaim menciptakan sistem AI yang setara dengan OpenAI hanya dengan $5 juta adalah tidak akurat.

Menurut Bernstein, pernyataan DeepSeek menyesatkan dan tidak mencerminkan gambaran yang lebih besar.

“Kami yakin DeepSeek tidak ‘menciptakan OpenAI dengan $5 juta’; model-modelnya fantastis tetapi kami tidak berpikir itu adalah keajaiban; dan kepanikan selama akhir pekan tampaknya telah dibesar-besarkan,” demikian pernyataan dalam laporan tersebut.

DeepSeek mengembangkan dua model AI utama: DeepSeek-V3 dan DeepSeek R1. Model bahasa V3 berskala besar memanfaatkan arsitektur MOE, menggabungkan model-model yang lebih kecil untuk mencapai kinerja tinggi sambil menggunakan lebih sedikit sumber daya komputasi daripada model tradisional.

Di sisi lain, model V3 memiliki 671 miliar parameter, dengan 37 miliar parameter aktif pada waktu tertentu, menggabungkan inovasi seperti MHLA untuk mengurangi penggunaan memori dan memanfaatkan FP8 untuk efisiensi yang lebih besar.

Pelatihan model V3 membutuhkan klaster yang terdiri dari 2.048 GPU Nvidia H800 selama periode dua bulan, setara dengan 5,5 juta jam GPU. Meskipun beberapa perkiraan menyebutkan biaya pelatihan sekitar $5 juta, laporan Bernstein menekankan bahwa angka ini hanya mencakup sumber daya komputasi dan tidak memperhitungkan biaya signifikan yang terkait dengan penelitian, pengujian, dan pengeluaran pengembangan lainnya.

Model DeepSeek R1 dibangun di atas fondasi V3 dengan memanfaatkan Reinforcement Learning (RL) dan teknik lainnya untuk memastikan kemampuan inferensi.

Model R1 dapat bersaing dengan model OpenAI dalam tugas penalaran. Namun, Bernstein menunjukkan bahwa pengembangan R1 membutuhkan sumber daya yang signifikan, meskipun detailnya tidak dijelaskan dalam laporan DeepSeek.

Mengomentari DeepSeek, Bernstein memuji model-model tersebut sebagai sesuatu yang mengesankan. Misalnya, model V3 berkinerja sebaik atau bahkan lebih baik daripada model bahasa utama lainnya dalam linguistik, pemrograman, dan matematika, sementara membutuhkan sumber daya yang lebih sedikit.

Proses pra-pelatihan V3 hanya membutuhkan 2,7 juta jam kerja GPU, atau 9% dari sumber daya komputasi beberapa model unggulan lainnya.

Bernstein menyimpulkan bahwa, meskipun kemajuan DeepSeek patut diperhatikan, kita harus waspada terhadap klaim yang berlebihan. Gagasan untuk menciptakan pesaing OpenAI hanya dengan $5 juta tampaknya keliru.

(Menurut Times of India)

Sumber: https://vietnamnet.vn/deepseek-khong-the-lam-ai-tuong-duong-openai-voi-5-trieu-usd-2367340.html

![[Foto] Perdana Menteri Pham Minh Chinh menghadiri Konferensi Pelaksanaan Tugas-Tugas Sektor Industri dan Perdagangan Tahun 2026](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F19%2F1766159500458_ndo_br_shared31-jpg.webp&w=3840&q=75)

Komentar (0)