Dalam beberapa bulan kebelakangan ini, pakar dan penyelidik keselamatan kanak-kanak telah memberi amaran tentang potensi AI inovatif untuk memburukkan lagi masalah penyalahgunaan dalam talian.

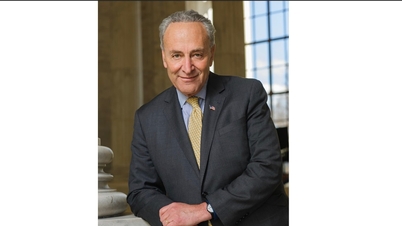

Ketua Pegawai Eksekutif Meta, Mark Zuckerberg memberi keterangan pada pendengaran Jawatankuasa Kehakiman Senat A.S. pada 31 Januari 2024, di hadapan khalayak ramai yang memegang imej yang dijana AI. Foto: Reuters

NCMEC masih belum mengeluarkan jumlah keseluruhan laporan mengenai kandungan penderaan kanak-kanak daripada semua sumber yang mereka terima pada tahun 2023. Tetapi pada tahun 2022, mereka menerima laporan kira-kira 88.3 juta fail mengenai isu ini.

John Shehan, naib presiden NCMEC, berkata: “Kami menerima laporan daripada syarikat AI inovatif itu sendiri, platform (dalam talian) dan orang ramai.”

Ketua Pegawai Eksekutif MetaX, TikTok, Snap dan Discord memberi keterangan di hadapan Senat A.S. pada hari Rabu (31 Januari) mengenai keselamatan kanak-kanak di platform dalam talian. Penggubal undang-undang A.S. mempersoalkan syarikat media sosial tentang usaha mereka untuk melindungi kanak-kanak daripada "pemangsa dalam talian".

Penyelidik di Balai Cerap Internet Stanford menyatakan dalam satu laporan Jun lalu bahawa AI inovatif boleh digunakan oleh pelaku jahat untuk berulang kali membahayakan kanak-kanak sebenar dengan mencipta imej palsu mereka.

Fallon McNulty, pengarah CyberTipline di NCMEC, yang menerima laporan eksploitasi kanak-kanak dalam talian, berkata kandungan yang dijana AI menjadi "semakin realistik", menjadikannya sukar untuk menentukan sama ada mangsa adalah orang sebenar.

McNulty berkata OpenAI, syarikat yang mencipta ChatGPT, telah mewujudkan proses pelaporan kepada NCMEC dan organisasi itu sedang berbincang dengan syarikat AI lain.

Hoang Hai (menurut Reuters, FT)

[iklan_2]

Sumber

![[Foto] Perdana Menteri Pham Minh Chinh mempengerusikan mesyuarat mengenai pembangunan ekonomi sektor swasta.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F20%2F1766237501876_thiet-ke-chua-co-ten-40-png.webp&w=3840&q=75)

Komen (0)