|

AI er ennå ikke i stand til å erstatte mennesker innen programmering. Foto: John McGuire . |

I den senere tid har ledende AI-modeller fra OpenAI og Anthropic blitt stadig mer brukt til programmeringsapplikasjoner. ChatGPT og Claude har økt minne og prosessorkraft for å analysere hundrevis av kodelinjer, mens Gemini integrerer en dedikert Canvas-resultatvisningsfunksjon for programmerere.

I oktober 2024 uttalte Sundar Pichai, administrerende direktør i Google, at 25 % av ny kode i selskapet ble generert av AI. Mark Zuckerberg, administrerende direktør i Meta, uttrykte også ambisjoner om å distribuere AI-kodingsmodeller i stor grad i selskapet.

En ny studie fra Microsoft Research, Microsofts FoU-avdeling, viser imidlertid at AI-modeller, inkludert Anthropics Claude 3.7 Sonnet og OpenAIs o3-mini, ikke klarer å håndtere mange feil i en programmeringsbenchmark kalt SWE-bench Lite.

Studiens forfattere undersøkte ni forskjellige AI-modeller som innlemmet en rekke feilsøkingsverktøy, som en Python-feilsøker, og som var i stand til å håndtere problemer i én setning. Modellene fikk i oppgave å løse 300 programvarefeil valgt fra SWE-bench Lite-datasettet.

|

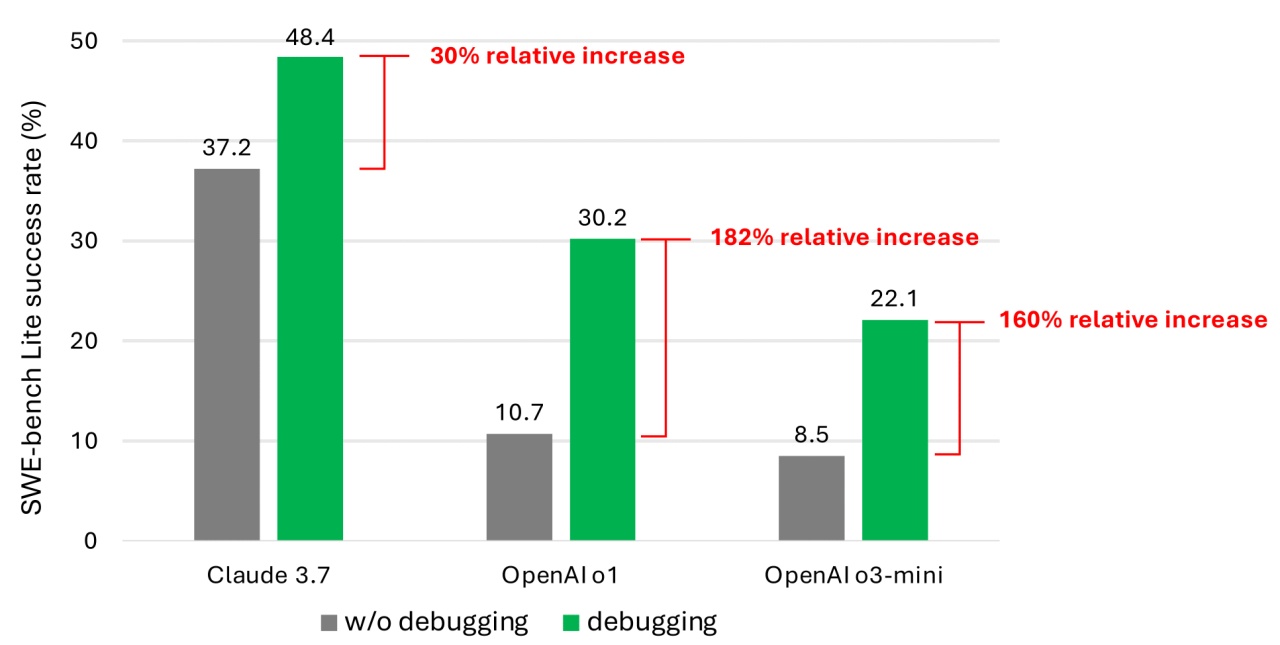

Suksessrate ved løsning av programmeringsproblemer fra SWE-bench Lite-datasettet. Bilde: Microsoft. |

Selv når den var utstyrt med kraftigere og nyere modeller, viste resultatene at AI-agenten sjelden fullførte mer enn halvparten av de tildelte feilsøkingsoppgavene. Blant modellene som ble testet, oppnådde Claude 3.7 Sonnet den høyeste gjennomsnittlige suksessraten på 48,4 %, etterfulgt av OpenAIs o1 på 30,2 % og o3-mini på 22,1 %.

Noen av årsakene til den lave ytelsen nevnt ovenfor inkluderer at noen modeller ikke forstår hvordan de skal bruke de medfølgende feilsøkingsverktøyene. I tillegg, ifølge forfatterne, ligger et større problem i mangelen på tilstrekkelige data.

De argumenterer for at treningssystemet for modellene fortsatt mangler data som simulerer feilsøkingstrinnene mennesker tar fra start til slutt. Med andre ord har ikke AI-en lært nok om hvordan mennesker tenker og handler trinn for trinn når de håndterer en programvarefeil i den virkelige verden.

Trening og forbedring av modellene vil hjelpe dem å bli dyktigere i feilsøking av programvare. «Dette vil imidlertid kreve spesialiserte datasett for treningsprosessen», uttalte forfatterne.

Tallrike studier har påpekt sikkerhetssårbarheter og feil i AI under kodegenerering, på grunn av svakheter som begrenset forståelse av programmeringslogikk. En fersk gjennomgang av Devin, et AI-drevet programmeringsverktøy, viste at det bare fullførte 3 av 20 programmeringstester.

Programmeringsmulighetene til AI er fortsatt gjenstand for mye debatt. Tidligere antydet Kevin Weil, produktdirektør i OpenAI, at AI ville overgå menneskelige programmerere innen utgangen av dette året.

På den annen side tror Bill Gates, medgründer av Microsoft, at programmering vil forbli en bærekraftig karriere i fremtiden. Andre ledere som Amjad Masad (administrerende direktør i Replit), Todd McKinnon (administrerende direktør i Okta) og Arvind Krishna (administrerende direktør i IBM) har også gitt uttrykk for sin støtte til dette synet.

Microsofts forskning, selv om den ikke er ny, tjener som en påminnelse til programmerere, inkludert ledere, om å tenke seg nøyere om før de overlater full kodemyndighet til AI.

Kilde: https://znews.vn/diem-yeu-chi-mang-cua-ai-post1545220.html

![[Foto] Nasjonalforsamlingens leder Tran Thanh Man deltar på åpningsmøtet til IPU-152](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/04/16/1776277863731_ctqh5-jpg.webp)

![[Foto] Generalsekretæren, presidenten og hans kone møter vietnamesisk-kinesiske vennskapsledere.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/04/15/1776264829725_vna-potal-tong-bi-thu-chu-tich-nuoc-to-lam-gap-mat-nhan-sy-huu-nghi-viet-nam-trung-quoc-8703641-3130-jpg.webp)

![[Foto] Fru Ngo Phuong Ly møter og utveksler synspunkter med fru Peng Li Yuan](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/04/16/1776277858080_phu-nhan-1-jpg.webp)

![[Foto] Min sønn om natten: Et tusen år gammelt kulturminne midt i Melkeveien](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/04/15/1776261039184_ndo_br_chon6-jpg.webp)

Kommentar (0)