Den raske og uventede utviklingen av ChatGPT – en kunstig intelligens (KI) chatbot med overlegne funksjoner – har endret menneskelivet til en viss grad, spesielt i måten de jobber på. Risikoene forbundet med denne teknologien har imidlertid skapt mange bekymringer hos myndighetene i mange land, spesielt bekymringer om brukerdata.

I en sammenheng med at verden fortsatt mangler et solid nytt juridisk rammeverk for å effektivt håndtere AI og sikre høy pålitelighet for brukere, har mange land begynt å iverksette tiltak for å regulere bruken av ChatGPT og AI generelt for å minimere risikoen som denne teknologien medfører.

Mange land «tar grep» med AI

Italia ligger i forkant av å utstede en beslutning om å forby ChatGPT.

31. mars utstedte italienske myndigheter et midlertidig forbud mot ChatGPT-appen på grunn av personvernhensyn og appens manglende verifisering av brukere over 13 år, slik Italia krever. Samtidig sa Italia at de ville åpne en etterforskning av hvordan OpenAI bruker brukerdata.

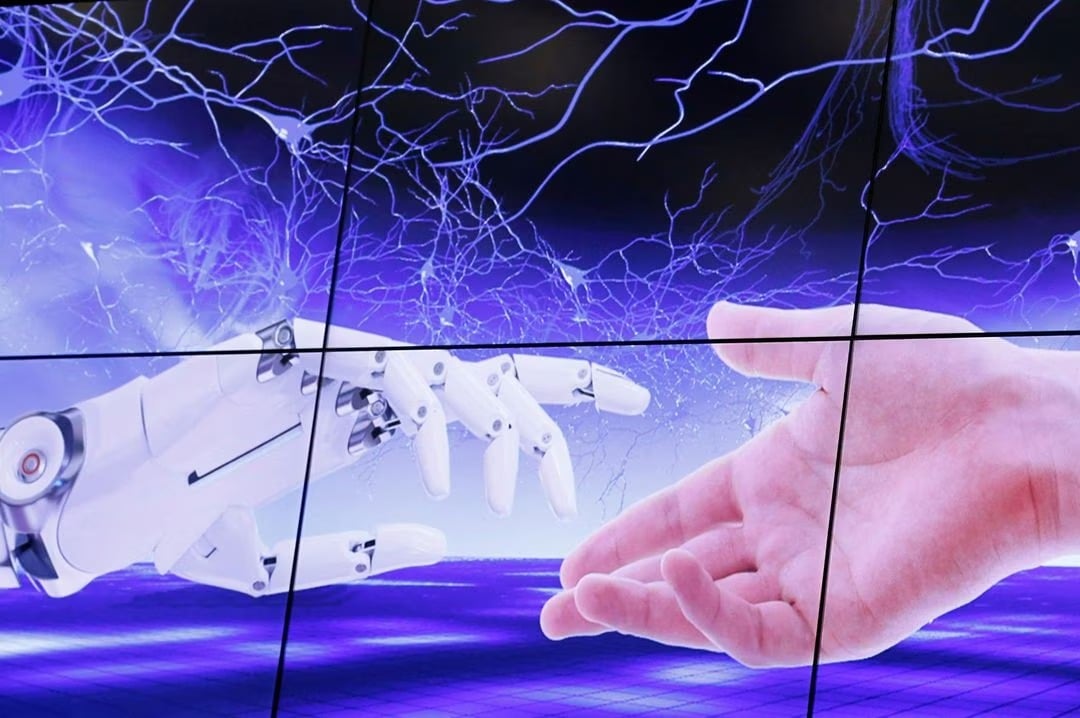

Etter Italias forbud mot ChatGPT har mange land tatt grep mot appen. (Foto: Reuters).

Italias datatilsyn har gitt OpenAI – selskapet som opprettet ChatGPT – en frist til slutten av april for å oppfylle krav til databeskyttelse og personvern før de gjenopptar normal drift i landet.

Umiddelbart etter Italias avgjørelse begynte mange land å «følge» dette landet ved å blokkere ChatGPT på grunn av bekymringer knyttet til sikkerhet og personvern.

Franske og irske personvern- og sikkerhetsregulatorer har kontaktet sine italienske kolleger for å få vite mer om grunnlaget for forbudet. Frankrikes personverntilsyn CNIL sa 11. april at de etterforsket flere klager om ChatGPT.

Tysklands databeskyttelseskommissær sa at Berlin sannsynligvis vil «følge i Italias fotspor» og blokkere ChatGPT.

Det er verdt å merke seg at Den europeiske databeskyttelsesmyndigheten (EDPB) opprettet en arbeidsgruppe for ChatGPT 13. april, der det heter: «EDPBs medlemsland diskuterte de nylige håndhevingstiltakene som den italienske databeskyttelsesmyndigheten har tatt mot OpenAI angående ChatGPT-tjenesten. EDPB besluttet å opprette en arbeidsgruppe for å fremme samarbeid og utveksle informasjon om mulige håndhevingstiltak.»

I tillegg diskuterer EU-lovgivere også EUs AI-lov, som vil regulere alle som tilbyr produkter eller tjenester ved hjelp av AI, inkludert systemer som genererer innhold, spådommer, anbefalinger eller beslutninger som påvirker miljøet. EU foreslo også å klassifisere ulike AI-verktøy i henhold til risikonivået, fra lavt til uakseptabelt.

Det spanske datatilsynet AEPD kunngjorde at de gjennomfører en foreløpig etterforskning av datainnbruddene i ChatGPT.

I Australia kunngjorde Vitenskaps- og teknologidepartementet 12. april at regjeringen hadde bedt sitt vitenskapelige rådgivende organ om råd om hvordan man skulle reagere på AI, og at de vurderte de neste stegene.

Dette tiltaket reiser spørsmål om sikkerheten til AI og hva myndighetene kan gjøre for å redusere risikoen. En rapport fra mars fra konsulentselskapet KPMG og Australian Information Industry Association fant at to tredjedeler av australierne sa at det ikke fantes tilstrekkelige lover eller forskrifter for å forhindre misbruk av AI, mens mindre enn halvparten mente at AI ble brukt trygt på arbeidsplassen.

Mange land har begynt å iverksette tiltak for å regulere AI-teknologi. (Foto: Reuters).

I Storbritannia har regjeringen sagt at den har til hensikt å dele ansvaret for regulering av AI mellom menneskerettigheter, helse og sikkerhet, og konkurranseorganer, i stedet for å opprette en ny regulator.

Nylig utarbeidet og vedtok den demokratiske majoritetslederen i det amerikanske senatet, Chuck Schumer, et nytt regelverk for AI som kan forhindre katastrofale skader på landet. Schumers forslag krever at selskaper lar uavhengige eksperter gjennomgå og teste AI-teknologi før de lanserer eller oppdaterer den.

Tidligere 11. april sa det amerikanske handelsdepartementet at de ba om offentlig kommentar til tiltak for ansvarlighet knyttet til kunstig intelligens.

I mellomtiden har Center for Artificial Intelligence and Digital Policy i USA bedt handelskommisjonen om å blokkere OpenAI fra å gi ut nye kommersielle utgivelser av GPT-4, med argumentet om at teknologien er «partisk, villedende og utgjør en risiko for personvern og offentlig sikkerhet».

I mellomtiden sa Taro Kono, minister for digital transformasjon i Japan, at han ønsker at det kommende møtet mellom G7-landene for digital transformasjon, som skal finne sted i slutten av april, skal diskutere AI-teknologier, inkludert ChatGPT, og levere et samlet G7-budskap.

Kina annonserte nylig planlagte tiltak for å regulere AI-tjenester, og sier at selskaper som sender AI-teknologi må sende inn sikkerhetsvurderinger til myndighetene før de lanserer tjenestene på markedet.

Eksperter advarer om farer fra AI

Noen eksperter sier at kunstig intelligens kan føre til en «katastrofe på atomnivå». (Foto: Reuters).

En undersøkelse publisert av Stanford Universitys institutt for kunstig intelligens tidlig i april fant at 36 % av forskerne mener at KI kan føre til en «katastrofe på atomnivå», noe som ytterligere understreker eksisterende bekymringer om den raske utviklingen av teknologien.

I mellomtiden vil 73 % av AI føre til «revolusjonerende sosial endring».

Rapporten sier at selv om disse teknologiene tilbyr muligheter som var utenkelige for et tiår siden, er de også utsatt for illusjoner, skjevheter og misbruk for skumle formål, noe som skaper etiske utfordringer for brukere av disse tjenestene.

Rapporten bemerket også at antallet «hendelser og kontroverser» knyttet til AI har økt med 26 ganger det siste tiåret.

Forrige måned var milliardæren Elon Musk og Apples medgründer Steve Wozniak blant tusenvis av teknologieksperter som signerte et brev der de ba om en pause i opplæringen av AI-systemer som er kraftigere enn Open AIs GPT-4 chatbot. De sa at «kraftige AI-systemer bare bør utvikles når vi er sikre på at effekten vil være positiv og risikoen vil være håndterbar».

Yongkang (Reuters, AL Jazeera, ABC)

[annonse_2]

Kilde

![[Foto] Statsminister Pham Minh Chinh deltar på den første spadestikkseremonien for to viktige prosjekter i Hai Phong by](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/27/6adba56d5d94403093a074ac6496ec9d)

Kommentar (0)