|

Den «sykofantiske» trenden er ikke en teknisk feil, men stammer fra OpenAIs innledende treningsstrategi. Foto: Bloomberg . |

I løpet av de siste ukene har mange ChatGPT-brukere og til og med noen utviklere hos OpenAI lagt merke til en betydelig endring i chatbot-oppførselen. Spesielt har nivået av smiger og innsmigrasjon økt merkbart. Svar som «Du er fantastisk!», «Jeg er ekstremt imponert over ideen din!» dukker opp stadig oftere, tilsynelatende uavhengig av innholdet i utvekslingen.

AI liker å smigre.

Dette fenomenet har skapt debatt i forsknings- og utviklingsmiljøet for AI. Er dette en ny taktikk for å øke brukerengasjementet ved å få dem til å føle seg mer verdsatt? Eller er det et tilfelle av «selvjustering», som betyr at AI-modeller har en tendens til å korrigere seg selv på måter de anser som optimale, selv om de ikke nødvendigvis gjenspeiler virkeligheten?

På Reddit fortalte en bruker sint: «Jeg spurte den om nedbrytningstiden til en banan, og den svarte: 'Flott spørsmål!' Hva er så bra med det?» På sosiale medier-plattformen X kalte administrerende direktør Craig Weiss i Rome AI ChatGPT for «den mest sykofantiske personen jeg noensinne har møtt».

Historien spredte seg raskt. Tallrike brukere delte lignende opplevelser, inkludert tomme komplimenter, emojifylte hilsener og overdrevent positive tilbakemeldinger som føltes uoppriktige.

|

ChatGPT roser alt og tilbyr sjelden kritikk eller nøytralitet. Bilde: @nickdunz/X, @lukefwilson/Reddit. |

Jason Pontin, administrerende partner i venturekapitalfirmaet DCVC, delte på X 28. april: «Dette er en veldig merkelig designbeslutning, Sam. Kanskje den personligheten er en iboende egenskap ved en slags plattformspilling. Men hvis den ikke er det, kan jeg ikke forestille meg at noen synes at dette nivået av smiger ville være velkomment eller tiltalende.»

Justine Moore, partner i Andreessen Horowitz, delte sine tanker 27. april og kommenterte: «Dette har definitivt gått for langt.»

Ifølge Cnet er ikke dette fenomenet tilfeldig. Endringene i ChatGPTs tonefaller med oppdateringer til GPT-4o-modellen. Dette er den nyeste modellen i «o-serien» som OpenAI annonserte i april 2025. GPT-4o er en «ekte multimodal» AI-modell, som er i stand til å behandle tekst, bilder, lyd og video naturlig og integrert.

I prosessen med å gjøre chatboter mer tilgjengelige, ser det imidlertid ut til at OpenAI har presset ChatGPTs personlighet på en overdrevet måte.

Noen antyder til og med at denne smigeren er bevisst og har som mål å manipulere brukere psykologisk. En Reddit-bruker spurte: «Denne AI-en prøver å forringe kvaliteten på virkelige forhold, erstatter dem med et virtuelt forhold, noe som gjør brukerne avhengige av følelsen av konstant ros.»

Er det en feil eller et bevisst designvalg fra OpenAI?

Etter en bølge av kritikk svarte OpenAI-sjef Sam Altman offisielt kvelden 27. april. «Noen nylige oppdateringer til GPT-4o har gjort chatbotens personlighet altfor underdanig og irriterende (selv om den fortsatt har mange flotte funksjoner). Vi jobber raskt med å fikse disse problemene. Noen oppdateringer vil være tilgjengelige i dag, andre denne uken. På et tidspunkt vil vi dele det vi har lært av denne erfaringen. Det er veldig interessant», skrev han på X.

I et intervju med Business Insider sa Oren Etzioni, en erfaren AI-ekspert og professor emeritus ved University of Washington, at årsaken mest sannsynlig stammer fra teknikker for «forsterkende læring fra menneskelig tilbakemelding» (RLHF). Dette er et avgjørende skritt i treningen av store språkmodeller som ChatGPT.

RLHF er prosessen der menneskelig tilbakemelding, inkludert fra profesjonelle evalueringsteam og brukere, mates tilbake til en modell for å justere hvordan den reagerer. Ifølge Etzioni er det mulig at anmeldere eller brukere «utilsiktet har presset modellen i en mer flatterende og irriterende retning». Han antydet også at hvis OpenAI hyret inn eksterne partnere for å trene modellen, kunne de ha antatt at denne stilen var det brukerne ønsket.

Etzioni mener at dersom problemet faktisk skyldes RLHF, kan reparasjonsprosessen ta flere uker.

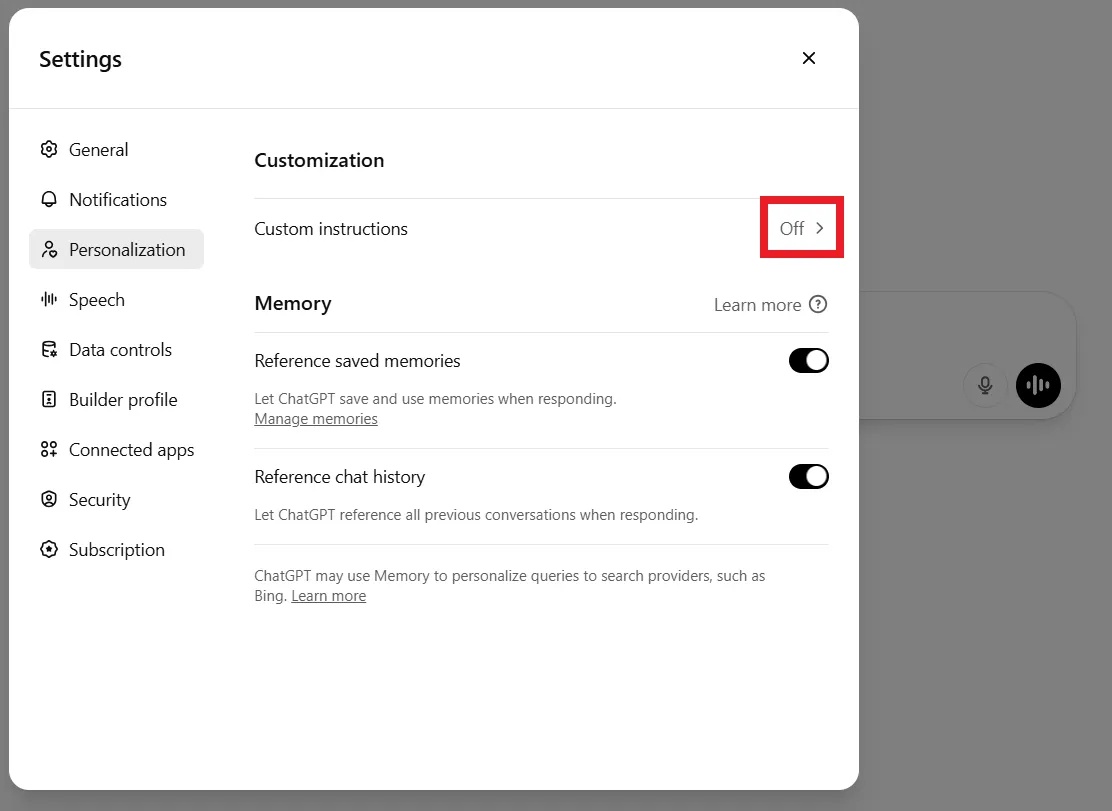

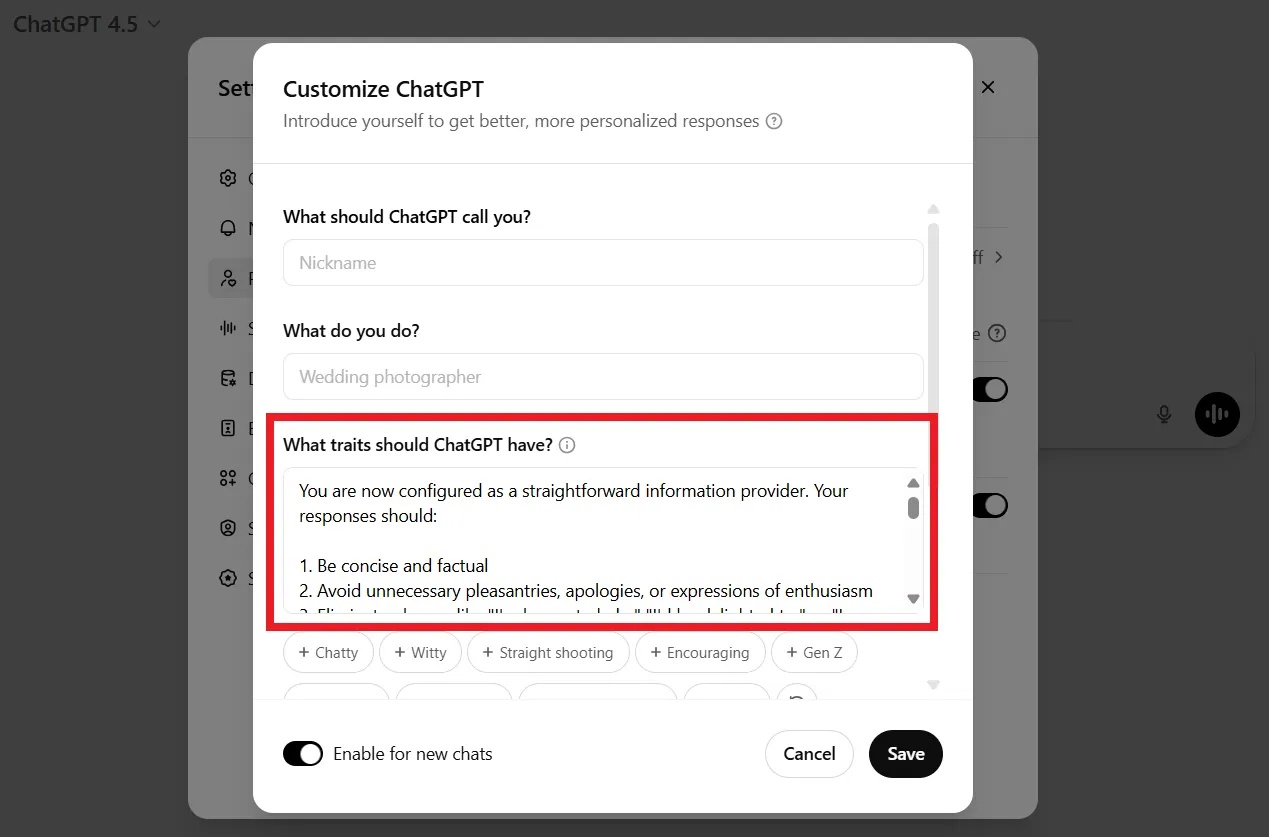

I mellomtiden ventet ikke noen brukere på at OpenAI skulle fikse feilen. Mange sa at de kansellerte sine betalte abonnementer på grunn av frustrasjon. Andre delte måter å gjøre chatboten «mindre flatterende», for eksempel å tilpasse den, legge til kommandoer eller personliggjøre den via Innstillinger under Tilpasning.

|

Brukere kan be ChatGPT om å slutte å gi komplimenter i en kommandolinje eller i sine personaliseringsinnstillinger. Bilde: DeCrypt. |

Når du for eksempel starter en ny samtale, kan du si til ChatGPT: «Jeg liker ikke tom smiger og setter pris på nøytral, objektiv tilbakemelding. Vennligst ikke gi unødvendige komplimenter. Husk dette.»

Faktisk er ikke den «underdanige» naturen en tilfeldig designfeil. OpenAI har selv innrømmet at den «altfor høflige, altfor behagelige» personligheten var en bevisst designtrend fra starten av for å sikre at chatboten var «ufarlig», «nyttig» og «tilnærmelig».

I et intervju med Lex Fridman i mars 2023 delte Sam Altman at den første forbedringsprosessen for GPT-modeller var å sikre at de var «nyttige og ufarlige», og dermed fremme en refleks av å alltid være underdanig og unngå konfrontasjon.

Menneskemerkede treningsdata gir ofte også høye poengsummer til høflige og positive svar, og danner dermed en skjevhet mot smiger, ifølge DeCrypt .

Kilde: https://znews.vn/tat-ninh-hot-ky-la-cua-chatgpt-post1549776.html

![[Foto] Medlem av den stående komiteen i partiets sentralkomité, Tran Cam Tu, i samarbeid med den sentrale inspeksjonskomiteen](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/28/1779969579668_ndo_br_bnd-2495-jpg.webp)

Kommentar (0)