Como funcionam as imagens falsas de IA?

A IA está em toda parte hoje em dia – até mesmo na guerra. As aplicações de inteligência artificial melhoraram tanto este ano que quase qualquer pessoa pode usar geradores de IA para criar imagens que parecem realistas, pelo menos à primeira vista.

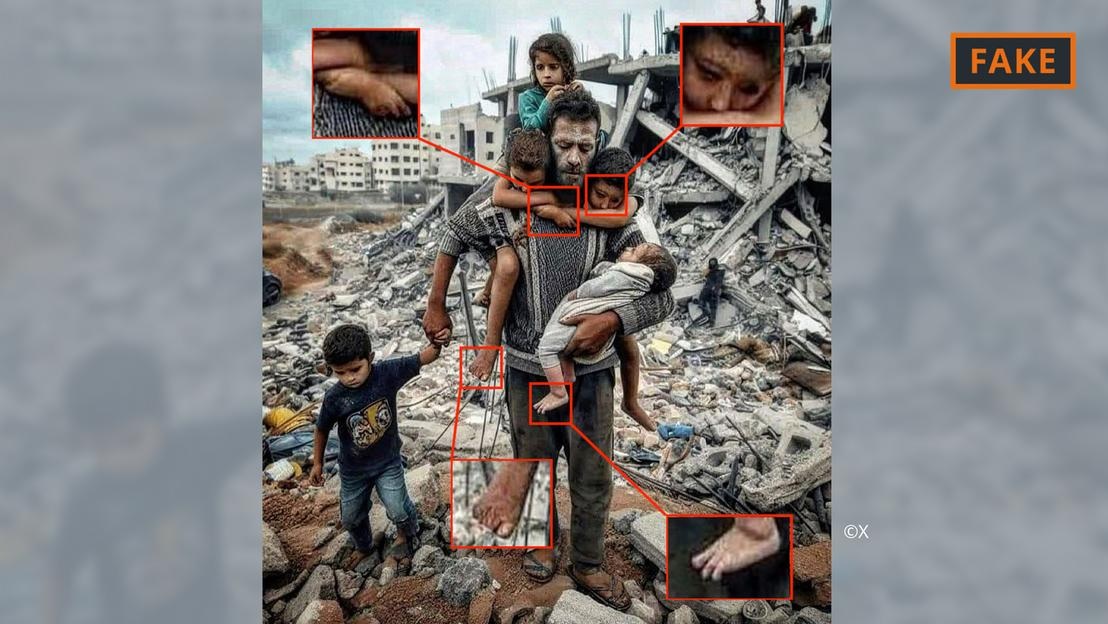

Uma foto falsa gerada por IA da guerra em Gaza.

Para isso, os usuários simplesmente fornecem ferramentas como Midjourney ou Dall-E com alguns prompts, incluindo especificações e informações. As ferramentas de IA então convertem os prompts de texto, ou mesmo de voz, em imagens.

Esse processo de geração de imagens é baseado no que é conhecido como aprendizado de máquina. Por exemplo, se um criador pede para mostrar um homem de 70 anos andando de bicicleta, ele pesquisará em seu banco de dados para encontrar termos que correspondam às imagens.

Com base nas informações disponíveis, o algoritmo de IA gerará uma imagem do ciclista idoso. Com cada vez mais informações e atualizações técnicas, essas ferramentas têm se aprimorado significativamente e estão em constante aprendizado.

Tudo isso está sendo aplicado a imagens relacionadas ao conflito no Oriente Médio. Em um conflito onde "as emoções estão tão à flor da pele", a desinformação, inclusive disseminada por meio de imagens de IA, tem um impacto enorme, afirma o especialista em IA Hany Farid.

Farid, professor de análise digital na Universidade da Califórnia em Berkeley, disse que batalhas ferozes são o ambiente perfeito para criar e disseminar conteúdo falso, além de alimentar emoções.

Tipos de imagens de IA da guerra entre Israel e Hamas

Imagens e vídeos criados com a ajuda de inteligência artificial alimentaram a desinformação relacionada à guerra na Ucrânia, e isso continua acontecendo na guerra entre Israel e o Hamas.

Segundo especialistas, as imagens de IA que circulam nas redes sociais sobre guerras geralmente se enquadram em duas categorias. Uma se concentra no sofrimento das pessoas e evoca compaixão. A outra é uma IA falsa que exagera os eventos, incitando conflitos e aumentando a violência.

Foto falsa gerada por IA de pai e filho nos escombros em Gaza.

Por exemplo, a primeira categoria inclui a foto acima de um pai e seus cinco filhos em frente a uma pilha de escombros. Ela foi compartilhada diversas vezes no X (antigo Twitter) e no Instagram, e visualizada centenas de milhares de vezes.

Esta imagem foi sinalizada pela comunidade, pelo menos no X, como falsa. Ela pode ser reconhecida por vários erros e inconsistências comuns em imagens de IA (veja a imagem acima).

Anomalias semelhantes também podem ser vistas na imagem falsa de IA que se tornou viral no X abaixo, que supostamente mostra uma família palestina comendo junta nas ruínas.

Foto falsa de festa palestina gerada por IA.

Enquanto isso, outra imagem que mostra tropas agitando bandeiras israelenses enquanto passam por um assentamento cheio de casas bombardeadas se enquadra na segunda categoria, criada para incitar ódio e violência.

De onde vêm essas imagens de IA?

A maioria das imagens de conflito geradas por IA são publicadas em plataformas de mídia social, mas também estão disponíveis em diversas outras plataformas e organizações, e até mesmo em alguns sites de notícias.

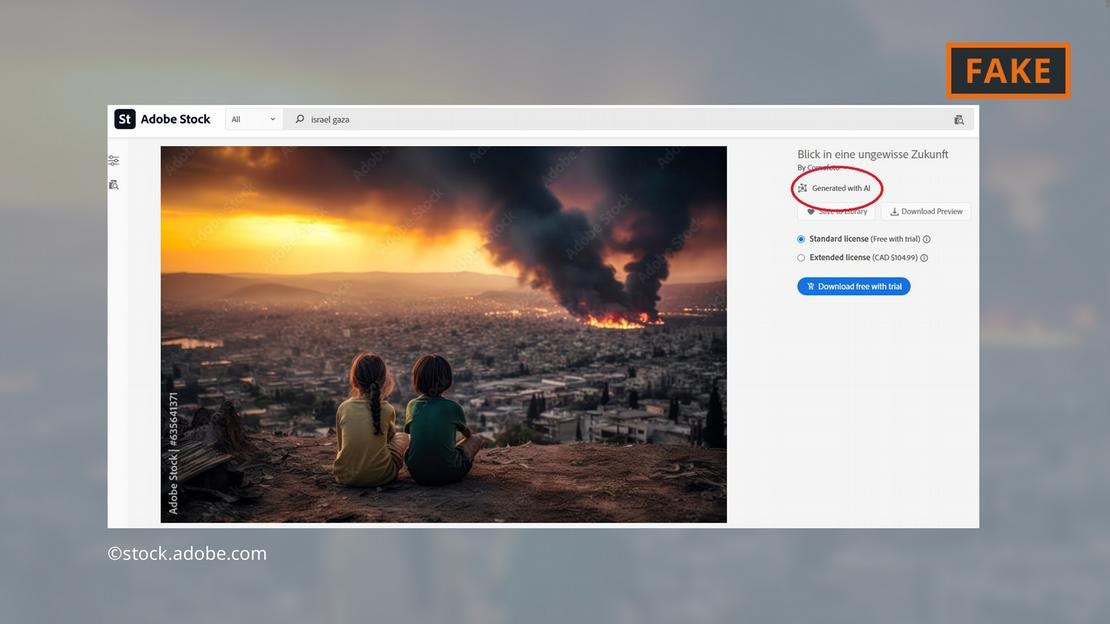

A empresa de software Adobe ganhou as manchetes ao adicionar imagens geradas por IA ao seu acervo de fotos até o final de 2022. Elas serão rotuladas adequadamente no banco de dados.

A Adobe também está oferecendo imagens de IA da guerra no Oriente Médio para venda — como explosões, pessoas protestando ou nuvens de fumaça atrás da Mesquita de Al-Aqsa.

A Adobe está oferecendo imagens geradas por IA dos combates em Gaza.

Críticos consideraram isso preocupante, pois alguns sites continuaram a usar as imagens sem rotulá-las como geradas por IA. A imagem em questão, por exemplo, apareceu na página "Newsbreak" sem qualquer indicação de que foi gerada por IA.

Até mesmo o Serviço de Pesquisa Parlamentar Europeu, o braço científico do Parlamento Europeu, ilustrou um texto online sobre o conflito no Oriente Médio com uma imagem de IA do banco de dados da Adobe — sem rotulá-la como gerada por IA.

O Observatório Europeu de Mídia Digital está pedindo que jornalistas e profissionais de mídia sejam extremamente cuidadosos ao usar imagens de IA, desaconselhando seu uso, especialmente ao cobrir eventos da vida real, como a guerra em Gaza.

Quão perigosas são as imagens de IA?

O conteúdo e as imagens virais da IA certamente farão com que os usuários se sintam desconfortáveis com tudo o que encontram online. "Se entrarmos neste mundo onde imagens, áudio e vídeo podem ser manipulados , tudo se torna suspeito", explica Farid, pesquisador da UC Berkeley. "Então, você perde a confiança em tudo, inclusive na verdade."

Foi exatamente isso que aconteceu no caso a seguir: uma imagem do que se acredita ser o cadáver carbonizado de um bebê israelense foi compartilhada nas redes sociais pelo primeiro-ministro israelense Benjamin Netanyahu e vários outros políticos.

Um influenciador anti-Israel, Jackson Hinkle, posteriormente afirmou que a imagem foi criada usando inteligência artificial. A declaração de Hinkle foi visualizada mais de 20 milhões de vezes nas redes sociais e gerou um debate acalorado na plataforma.

Por fim, inúmeras organizações e ferramentas de verificação declararam que a imagem era real e que a alegação de Hinkle era falsa. No entanto, é evidente que nenhuma ferramenta pode ajudar os usuários a recuperar facilmente a confiança perdida!

Hoang Hai (de acordo com a DW)

[anúncio_2]

Fonte

![[Foto] Abertura solene do 8º Congresso do Comitê Central do Partido de Segurança Pública, mandato 2025-2030](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/4/f3b00fb779f44979809441a4dac5c7df)

![[Foto] O Secretário-Geral To Lam participa do 8º Congresso do Comitê Central de Segurança Pública do Partido](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/4/79fadf490f674dc483794f2d955f6045)

![[Infográfico] Números notáveis após 3 meses de "reorganização do país"](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/4/ce8bb72c722348e09e942d04f0dd9729)

![[Foto] Festival de Meio do Outono no Museu de Etnologia](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/4/da8d5927734d4ca58e3eced14bc435a3)

Comentário (0)