Dacă ați navigat vreodată pe rețelele de socializare, probabil ați dat peste imagini sau videoclipuri create de inteligența artificială. Mulți oameni au fost păcăliți, cum ar fi videoclipul viral cu iepuri care sar pe o trambulină. Dar Sora - o aplicație soră a ChatGPT dezvoltată de OpenAI - duce videoclipurile create de inteligența artificială la un nou nivel, făcând detectarea conținutului fals din ce în ce mai urgentă.

Instrumentele video bazate pe inteligență artificială fac mai dificilă ca niciodată identificarea videoclipurilor autentice. (Sursa: CNET)

Lansată în 2024 și recent actualizată cu Sora 2, această aplicație are o interfață similară cu TikTok, unde toate videoclipurile sunt generate de inteligență artificială. Funcția „cameo” permite inserarea unor persoane reale în filmări simulate, creând videoclipuri înfricoșător de realiste.

Prin urmare, mulți experți se tem că Sora va provoca răspândirea de deepfake-uri, distorsionând informațiile și estompând granițele dintre realitate și fals. Vedetele sunt deosebit de vulnerabile, ceea ce a determinat organizații precum SAG-AFTRA să apeleze la OpenAI pentru a consolida protecția.

Identificarea conținutului generat de inteligența artificială este o provocare majoră atât pentru companiile de tehnologie, platformele de socializare, cât și pentru utilizatori. Există însă modalități de a recunoaște videoclipurile create folosind Sora.

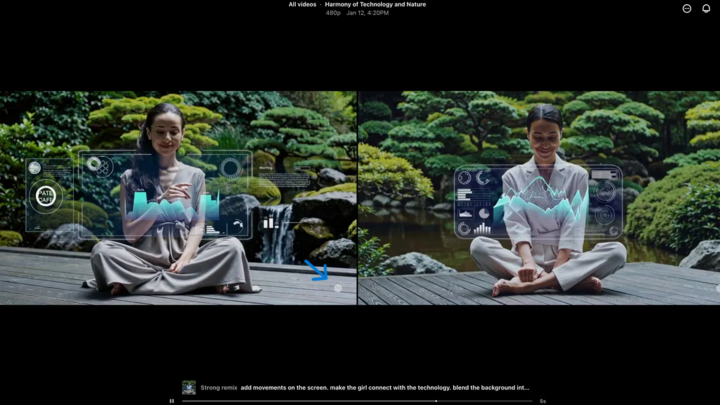

Găsește filigranul Sora

Filigranul Sora (indicat de săgeata albastră) este un marker care identifică instrumentul folosit pentru a crea videoclipul. (Sursa: CNET)

Fiecare videoclip creat în aplicația Sora pentru iOS are un filigran la descărcare – sigla albă Sora (pictograma nor) se mișcă pe marginile videoclipului, similar cu filigranul TikTok.

Aceasta este o modalitate vizuală de a identifica conținutul generat de inteligența artificială. De exemplu, modelul Gemini „nano-banana” de la Google adaugă automat și un filigran imaginilor. Cu toate acestea, filigranele nu sunt întotdeauna fiabile. Dacă filigranul este static, poate fi ușor decupat. Chiar și filigranele dinamice, precum cel al lui Sora, pot fi eliminate folosind aplicații specializate.

Când a fost întrebat despre acest lucru, CEO-ul OpenAI, Sam Altman, a susținut că societatea trebuie să se adapteze la realitatea că oricine poate crea videoclipuri false. Înainte de Sora, nu a existat niciodată un instrument atât de popular, accesibil și care să nu necesite nicio abilitate pentru a crea astfel de videoclipuri. Perspectiva sa subliniază necesitatea de a ne baza pe metode alternative de verificare.

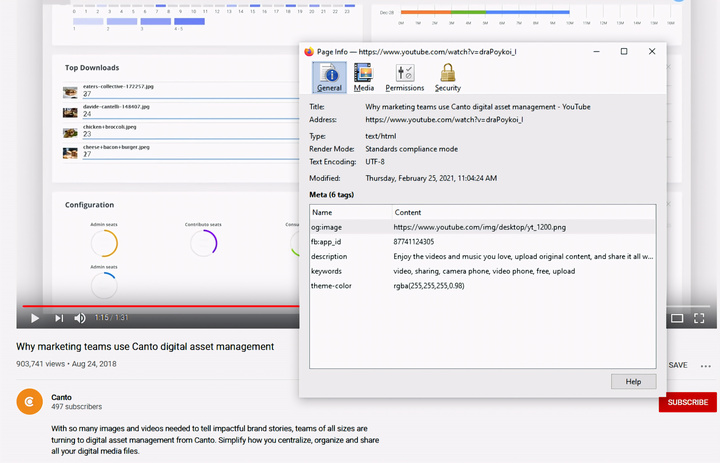

Verificați metadatele

Verificarea metadatelor – un pas crucial în determinarea dacă un videoclip a fost creat de inteligența artificială, precum Sora. (Sursa: Canto)

S-ar putea să credeți că verificarea metadatelor este prea complicată, dar de fapt este destul de simplă și foarte eficientă.

Metadatele sunt un set de informații atașate automat conținutului atunci când acesta este creat, cum ar fi tipul camerei, locația, ora înregistrării și numele fișierului. Indiferent dacă conținutul este generat de om sau de inteligența artificială, acesta are metadate. În cazul conținutului generat de inteligența artificială, metadatele includ adesea informații despre atribuirea sursei.

OpenAI este membru al Coaliției pentru Originea și Autenticitatea Conținutului (C2PA), așadar videoclipurile Sora vor conține metadate C2PA. Puteți verifica acest lucru folosind instrumentul de verificare al inițiativei de autenticitate a conținutului:

Cum se verifică metadatele:

- Vizitați verify.contentauthenticity.org

- Încărcați fișierul care va fi verificat.

- Apăsați „Deschidere”

- Consultați informațiile din tabelul din dreapta.

Dacă videoclipul a fost creat de inteligența artificială, rezumatul va preciza clar acest lucru. Când verificați videoclipurile Sora, veți vedea rândul „publicat de OpenAI” și informații care confirmă că videoclipul a fost creat folosind inteligența artificială. Toate videoclipurile Sora trebuie să conțină aceste informații pentru a le verifica originea.

Sursă: https://vtcnews.vn/cach-nhan-biet-video-that-hay-do-ai-tao-ar972891.html

![[Foto] Tran Cam Tu, membru al Comitetului Permanent al Comitetului Central al Partidului, în colaborare cu Comitetul Central de Inspecție](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/28/1779969579668_ndo_br_bnd-2495-jpg.webp)

![[GALERIE] Un joc „de miliarde de dolari” care nici măcar nu a fost lansat încă îi înnebunește deja pe jucători.](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2026/05/28/1779977371733_goi-3-png.webp)

Comentariu (0)