|

Чат-бот OpenAI постоянно совершенствуется благодаря новым технологиям. Фото: New York Times . |

В сентябре 2024 года OpenAI запустила ChatGPT, версию ИИ, которая интегрирует модель o1, способную рассуждать в задачах, связанных с математикой, наукой и компьютерным программированием.

В отличие от предыдущей версии ChatGPT, новая технология потребует времени на «обдумывание» решений сложных проблем, прежде чем предоставить ответ.

Вслед за OpenAI многие конкуренты, такие как Google, Anthropologie и DeepSeek, также представили аналогичные модели логического мышления. Хотя они и не идеальны, это все же технология для усовершенствования чат-ботов, которой доверяют многие разработчики.

Как рассуждает ИИ

По сути, благодаря логическому мышлению чат-боты могут тратить больше времени на решение проблем, поставленных пользователями.

«Рассуждение — это то, как система выполняет дополнительную работу после получения вопроса», — сказал Дэн Кляйн, профессор информатики Калифорнийского университета, в интервью газете New York Times .

Логическая система может разбить проблему на более мелкие, отдельные шаги или решить ее методом проб и ошибок.

На момент запуска ChatGPT мог мгновенно отвечать на вопросы, извлекая и синтезируя информацию. В отличие от него, системам логического мышления требовалось на несколько секунд (или даже минут) больше времени для решения задачи и предоставления ответа.

|

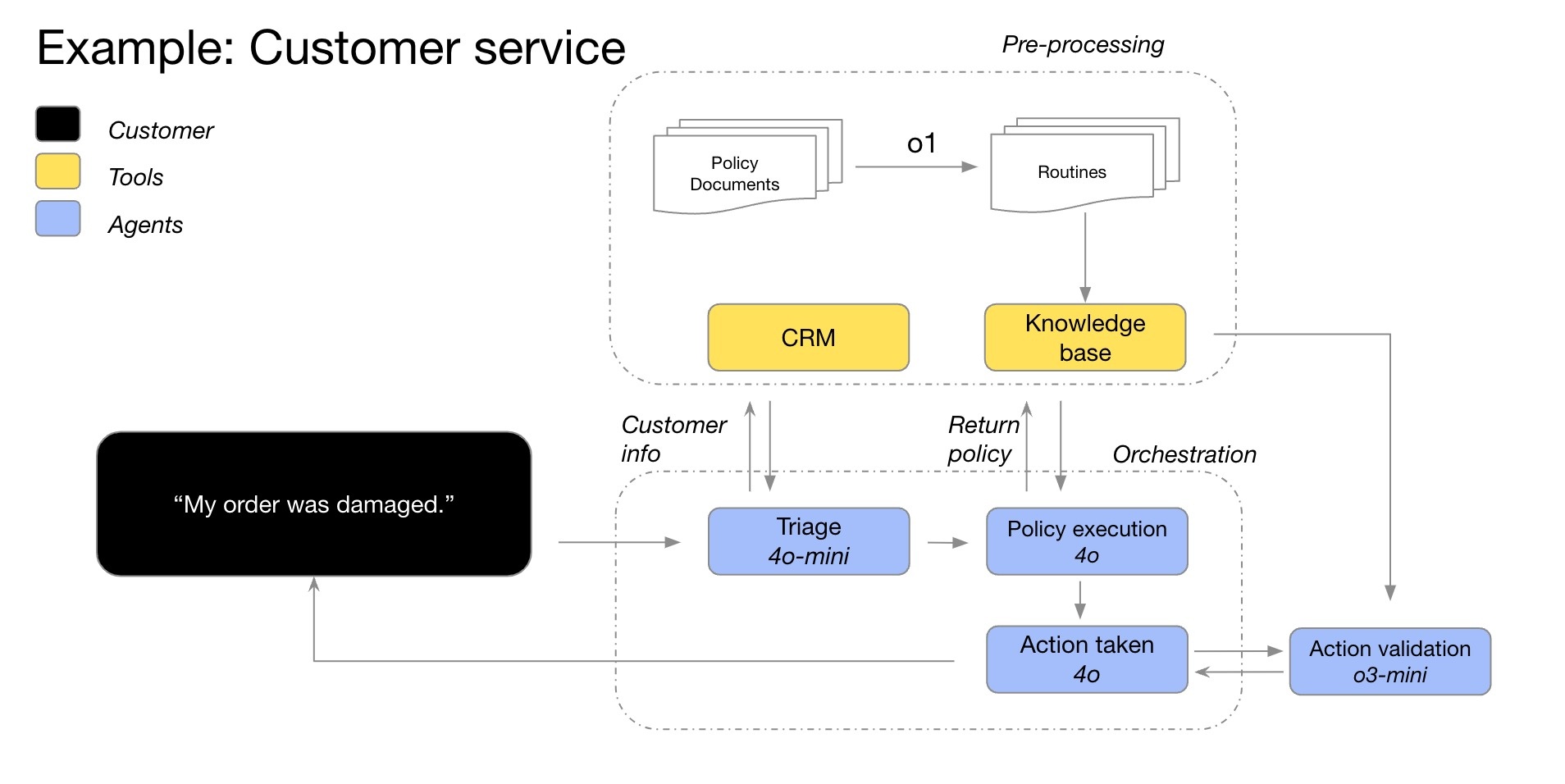

Пример процесса рассуждений модели O1 в чат-боте службы поддержки клиентов. Изображение: OpenAI . |

В некоторых случаях система рассуждений будет менять свой подход к проблеме, постоянно улучшая решение. Кроме того, модель может тестировать несколько решений, прежде чем сделать оптимальный выбор, или проверять точность предыдущих ответов.

В целом, система рассуждений будет рассматривать все возможные ответы на вопрос. Это похоже на то, как ученики начальной школы записывают множество вариантов на бумаге, прежде чем выбрать наиболее подходящее решение математической задачи.

Как сообщает New York Times , искусственный интеллект теперь способен рассуждать практически по любой теме. Однако наибольшую эффективность он проявит в вопросах, связанных с математикой, наукой и программированием.

Как происходит обучение теоретической системы?

В типичном чат-боте пользователи по-прежнему могут запрашивать пояснения к процессу или проверять точность ответа. Фактически, многие обучающие наборы данных ChatGPT уже включают процедуры решения задач.

Система рассуждений становится еще более совершенной, когда она может выполнять операции без участия пользователя. Этот процесс становится более сложным и масштабным. Компании используют слово «рассуждение», потому что система работает аналогично тому, как думают люди.

Многие компании, такие как OpenAI, считают, что системы логического мышления — лучшее решение для улучшения существующих чат-ботов. Долгое время они полагали, что чат-боты работают лучше, чем больше информации они получают в процессе обучения в интернете.

К 2024 году системы искусственного интеллекта израсходуют почти весь доступный в интернете текст. Это означает, что компаниям необходимо найти новые решения для модернизации чат-ботов, включая системы логического мышления.

|

Стартап DeepSeek однажды произвел фурор своей моделью рассуждений, которая оказалась дешевле, чем OpenAI. Фото: Bloomberg . |

Начиная с прошлого года, такие компании, как OpenAI, сосредоточились на методах обучения с подкреплением. Этот процесс обычно занимает несколько месяцев, в течение которых ИИ обучается поведению методом проб и ошибок.

Например, решив тысячи задач, система может определить оптимальный метод получения правильного ответа. Затем исследователи создают сложные механизмы обратной связи, которые помогают системе различать правильные и неправильные решения.

«Это похоже на дрессировку собаки. Если система работает хорошо, вы даете ей лакомство. В противном случае вы говорите: „Эта собака непослушная“», — поделился Джерри Творек, исследователь из OpenAI.

Искусственный интеллект — это будущее?

Согласно газете New York Times , методы обучения с подкреплением эффективны при решении задач в математике, естественных науках и программировании. Это области, где правильные и неправильные ответы могут быть четко определены.

Напротив, обучение с подкреплением неэффективно в литературе, философии или этике — областях, где трудно отличить добро от зла. Тем не менее, исследователи утверждают, что этот метод все же может улучшить производительность ИИ, даже в вопросах, не связанных с математикой.

«Системы научатся определять пути, ведущие к положительным и отрицательным результатам», — сказал Джаред Каплан, главный научный сотрудник компании Anthropic.

|

Веб-сайт Anthropic, стартапа, владеющего моделью искусственного интеллекта Claude. Фото: Bloomberg . |

Важно отметить, что обучение с подкреплением и системы рассуждений — это два разных понятия. В частности, обучение с подкреплением — это метод построения систем рассуждений. Это заключительный этап обучения, позволяющий чат-ботам рассуждать.

Поскольку это относительно новая технология, ученые пока не могут с уверенностью сказать, сможет ли логическое мышление чат-ботов или обучение с подкреплением помочь ИИ мыслить как человек. Следует отметить, что многие современные тенденции в обучении ИИ развиваются очень быстро на начальном этапе, а затем постепенно замедляются.

Кроме того, в работе чат-ботов по-прежнему могут возникать ошибки. На основе вероятностного подхода система выберет процесс, наиболее точно соответствующий полученным данным, будь то из интернета или с помощью обучения с подкреплением. Следовательно, чат-боты всё ещё могут выбирать неверные или нелогичные решения.

Источник: https://znews.vn/ai-ly-luan-nhu-the-nao-post1541477.html

Комментарий (0)