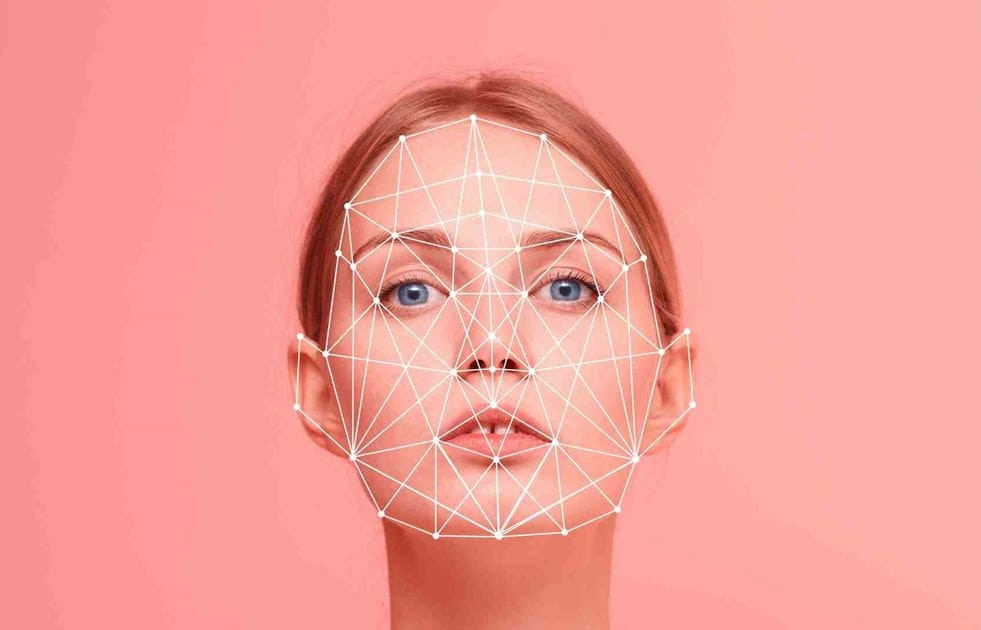

Deepfake, 'Derin Öğrenme' ve 'Sahte' kelimelerinin birleştirilmesiyle oluşturulmuş bir terimdir. Basitçe söylemek gerekirse, sahte ses, görsel veya hatta video ürünleri simüle eden ve üreten bir teknolojidir.

Yapay zekanın (YZ) hızla gelişmesiyle birlikte, deepfake sorunu giderek yaygınlaşmış ve medyada yanlış bilgilendirme dalgaları yaratmıştır. Bu nedenle, görüntülerin ve videoların kaynağını proaktif olarak doğrulamak, dünya çapındaki önde gelen kamera üreticileri için acil bir konudur.

Sony, Canon ve Nikon'un, aynasız (veya DSLR) kamera serilerinde doğrudan dijital imza desteği sunan dijital kameralar piyasaya sürmesi bekleniyor. Kameralarda dijital imza uygulamasının hayata geçirilmesi, menşei ve görüntü bütünlüğünün kanıtı açısından çok önemli bir adımdır.

Bu dijital imzalar tarih, saat, konum, fotoğrafçı gibi bilgileri içerecek ve değiştirilemez olacaktır. Bu, özellikle çalışmaları kimlik doğrulaması gerektiren foto muhabirleri ve diğer profesyoneller için önemlidir.

Fotoğraf makinesi sektörünün üç devi, çevrimiçi doğrulama aracı Verify ile uyumlu dijital imzalar için küresel bir standart üzerinde anlaştı. Küresel haber kuruluşları, teknoloji şirketleri ve fotoğraf makinesi üreticilerinden oluşan bir koalisyon tarafından tanıtılan bu araç, herhangi bir görüntünün orijinalliğinin ücretsiz olarak doğrulanmasına olanak tanıyacak. Bir görüntü yapay zeka kullanılarak oluşturulmuş veya değiştirilmişse, Verify bunu 'İçerik kimlik bilgisi yok' olarak işaretleyecektir.

Eski ABD Başkanı Donald Trump ve Japonya Başbakanı Fumio Kishida gibi ünlü isimlerin yer aldığı deepfake ürünlerinin hızla artması, deepfake karşıtı teknolojilerin önemini artırmaktadır.

Ayrıca, Çin'deki Tsinghua Üniversitesi'nden araştırmacılar, günde yaklaşık 700.000 görüntü üretebilen yeni bir genelleştirilmiş yapay zeka modeli geliştirdiler.

Kamera üreticilerinin yanı sıra, diğer teknoloji şirketleri de deepfake'lere karşı mücadeleye katılıyor. Google, yapay zeka tarafından oluşturulan görüntülere dijital filigran eklemek için bir araç yayınlarken, Intel de fotoğraflardaki cilt tonu değişikliklerini analiz ederek gerçekliğini belirlemeye yardımcı olacak bir teknoloji geliştirdi. Hitachi de çevrimiçi kimlik sahtekarlığını önlemeye yönelik teknolojiler üzerinde araştırma yapıyor.

Yeni teknolojinin 2024 yılının başlarında piyasaya sürülmesi bekleniyor. Sony, teknolojiyi medyaya tanıtmayı planlıyor ve Ekim 2023'te saha denemeleri gerçekleştirdi. Canon, teknolojiyi daha da geliştirmek için Thomson Reuters ve Starling Veri Koruma Laboratuvarı (Stanford Üniversitesi ve Güney Kaliforniya Üniversitesi tarafından kurulan bir araştırma enstitüsü) ile işbirliği yapıyor.

Kamera üreticileri, yeni teknolojinin görüntülere olan kamu güvenini yeniden tesis etmeye ve böylece dünya algımızı şekillendirmeye yardımcı olacağını umuyor.

(OL'ye göre)

Facebook'a deepfake yatırım dolandırıcılığı videolarını yayması için 5.000 dolar ödeyin.

Yeni kötü amaçlı yazılımlar akıllı telefonların kontrolünü ele geçiriyor, deepfake videolar giderek daha da karmaşıklaşıyor.

Deepfake videoları giderek daha karmaşık ve gerçekçi hale geliyor.

İnsanları para transferine ikna etmek için kullanılan Deepfake video görüşmelerine kanmamak için ne yapabilirsiniz?

Deepfake teknolojisi, mağdurların yüzlerini pornografik videolara yerleştirmek için kötüye kullanılıyor.

[reklam_2]

Kaynak

![[Fotoğraf] Genel Sekreter ve Başkan To Lam ile Filipinler Cumhurbaşkanı görüşme yapıyor.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/06/01/1780286997787_anh-man-hinh-2026-06-01-luc-11-09-43.png)

Yorum (0)