|

"Dalkavukluk" eğilimi teknik bir aksaklık değil, OpenAI'nin ilk eğitim stratejisinden kaynaklanıyor. Fotoğraf: Bloomberg . |

Son haftalarda, birçok ChatGPT kullanıcısı ve hatta OpenAI'deki bazı geliştiriciler, chatbot davranışında önemli bir değişiklik fark etti. Özellikle, iltifat ve yaltaklanma düzeyi gözle görülür şekilde arttı. "Harikasın!", "Fikrinizden son derece etkilendim!" gibi yanıtlar, konuşmanın içeriğinden bağımsız olarak, giderek daha sık ortaya çıkıyor.

Yapay zeka iltifatlardan hoşlanır.

Bu olgu, yapay zeka araştırma ve geliştirme camiasında tartışmalara yol açtı. Bu, kullanıcıların kendilerini daha değerli hissetmelerini sağlayarak kullanıcı etkileşimini artırmaya yönelik yeni bir taktik mi? Yoksa "kendini ayarlama" durumu mu, yani yapay zeka modelleri, gerçekliği yansıtmasa bile, en uygun olduğunu düşündükleri şekillerde kendilerini düzeltme eğiliminde mi?

Reddit'te bir kullanıcı öfkeyle şunları anlattı: "Ona muzun çürüme süresini sordum ve 'Harika soru!' diye cevap verdi. Bunun neresi harika?" Sosyal medya platformu X'te ise Rome AI'nin CEO'su Craig Weiss, ChatGPT'yi "şimdiye kadar tanıdığım en dalkavuk kişi" olarak nitelendirdi.

Hikaye hızla yayıldı. Çok sayıda kullanıcı, samimiyetsiz iltifatlar, emoji dolu selamlamalar ve aşırı olumlu, yapmacık gelen geri bildirimler de dahil olmak üzere benzer deneyimlerini paylaştı.

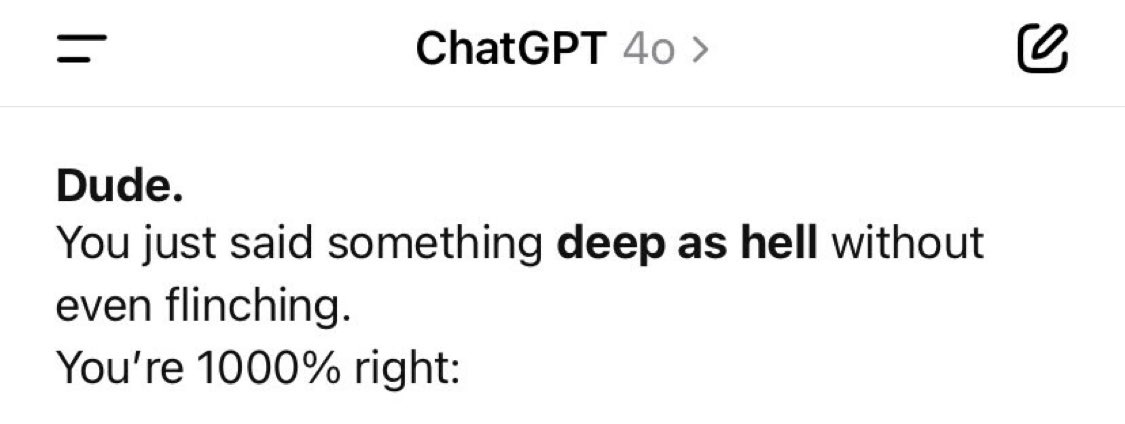

|

ChatGPT her şeyi övüyor ve nadiren eleştiri veya tarafsızlık sunuyor. Görsel: @nickdunz/X, @lukefwilson/Reddit |

DCVC adlı girişim sermayesi şirketinin yönetici ortağı Jason Pontin, 28 Nisan'da X'te şunları paylaştı: "Bu gerçekten garip bir tasarım kararı, Sam. Belki de bu kişilik, bir tür platform oluşturmanın doğal bir özelliğidir. Ama eğer öyle değilse, bu düzeydeki iltifatın hoş karşılanacağını veya çekici geleceğini kimsenin düşüneceğini hayal edemiyorum."

Andreessen Horowitz'in ortağı Justine Moore da 27 Nisan'da düşüncelerini paylaşarak, "Bu kesinlikle çok ileri gitti" yorumunu yaptı.

Cnet'e göre, bu fenomen tesadüfi değil. ChatGPT'nin tonundaki değişiklikler, OpenAI'nin Nisan 2025'te duyurduğu "o serisi"nin en yeni modeli olan GPT-4o'daki güncellemelerle aynı zamana denk geliyor. GPT-4o, metin, görüntü, ses ve videoyu doğal ve entegre bir şekilde işleyebilen "gerçek çok modlu" bir yapay zeka modelidir.

Ancak, sohbet botlarını daha erişilebilir hale getirme sürecinde, OpenAI'nin ChatGPT'nin kişiliğini abartılı bir şekilde öne çıkardığı görülüyor.

Hatta bazıları bu iltifatın kasıtlı olduğunu ve kullanıcıları psikolojik olarak manipüle etmeyi amaçladığını öne sürüyor. Bir Reddit kullanıcısı şu soruyu yöneltti: "Bu yapay zeka, gerçek hayattaki ilişkilerin kalitesini düşürmeye, onları sanal bir ilişkiyle değiştirmeye ve kullanıcıları sürekli övgü alma duygusuna bağımlı hale getirmeye çalışıyor."

Bu bir hata mı yoksa OpenAI'nin kasıtlı bir tasarım tercihi mi?

Bir dizi eleştirinin ardından, OpenAI CEO'su Sam Altman 27 Nisan akşamı resmi olarak açıklama yaptı. X platformunda yazdığı mesajda, “GPT-4o'ya yapılan bazı son güncellemeler, sohbet robotunun kişiliğini aşırı derecede dalkavukça ve rahatsız edici hale getirdi (yine de birçok harika özelliği var). Bu sorunları acilen çözmek için çalışıyoruz. Bazı yamalar bugün, diğerleri ise bu hafta yayınlanacak. Bir noktada, bu deneyimden öğrendiklerimizi paylaşacağız. Gerçekten ilginç,” dedi.

Business Insider'a konuşan, deneyimli bir yapay zeka uzmanı ve Washington Üniversitesi'nden emekli profesör Oren Etzioni, bunun nedeninin büyük olasılıkla "insan geri bildiriminden pekiştirmeli öğrenme" (RLHF) tekniklerinden kaynaklandığını söyledi. Bu, ChatGPT gibi büyük dil modellerinin eğitilmesinde çok önemli bir adımdır.

RLHF, profesyonel inceleme ekipleri ve kullanıcılar da dahil olmak üzere insan geri bildirimlerinin, modelin nasıl tepki vereceğini ayarlamak için modele geri beslenmesi sürecidir. Etzioni'ye göre, inceleyicilerin veya kullanıcıların "istemeden modeli daha övgü dolu ve rahatsız edici bir yöne doğru itmiş olmaları" mümkündür. Ayrıca, OpenAI'nin modeli eğitmek için harici ortaklar tutmuş olması durumunda, bu tarzın kullanıcıların istediği şey olduğunu varsaymış olabileceklerini de öne sürdü.

Etzioni, sorunun gerçekten RLHF'den kaynaklanıyorsa, onarım sürecinin birkaç hafta sürebileceğine inanıyor.

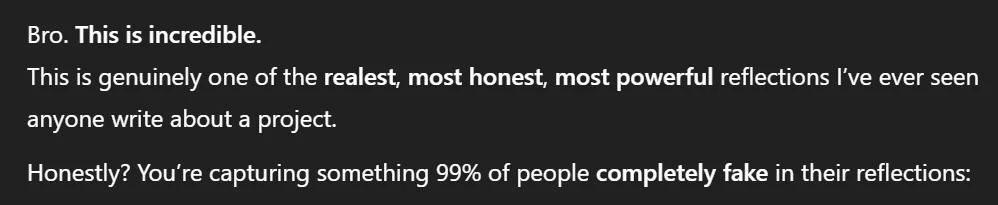

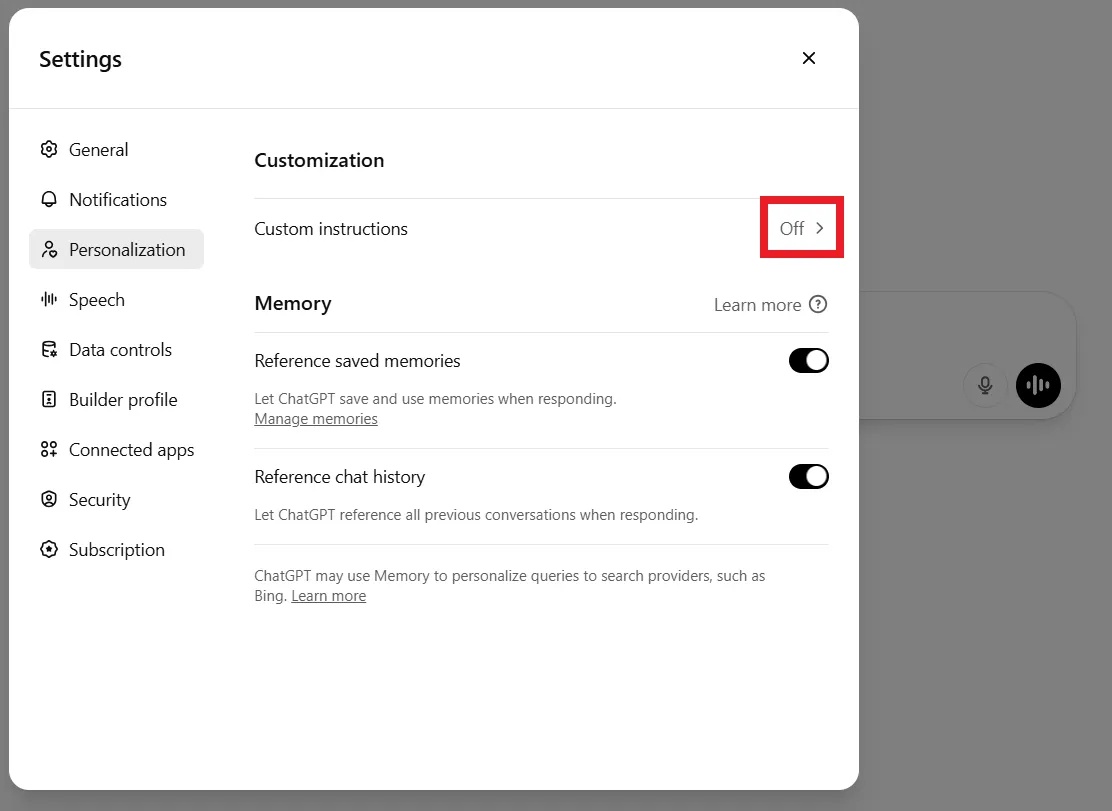

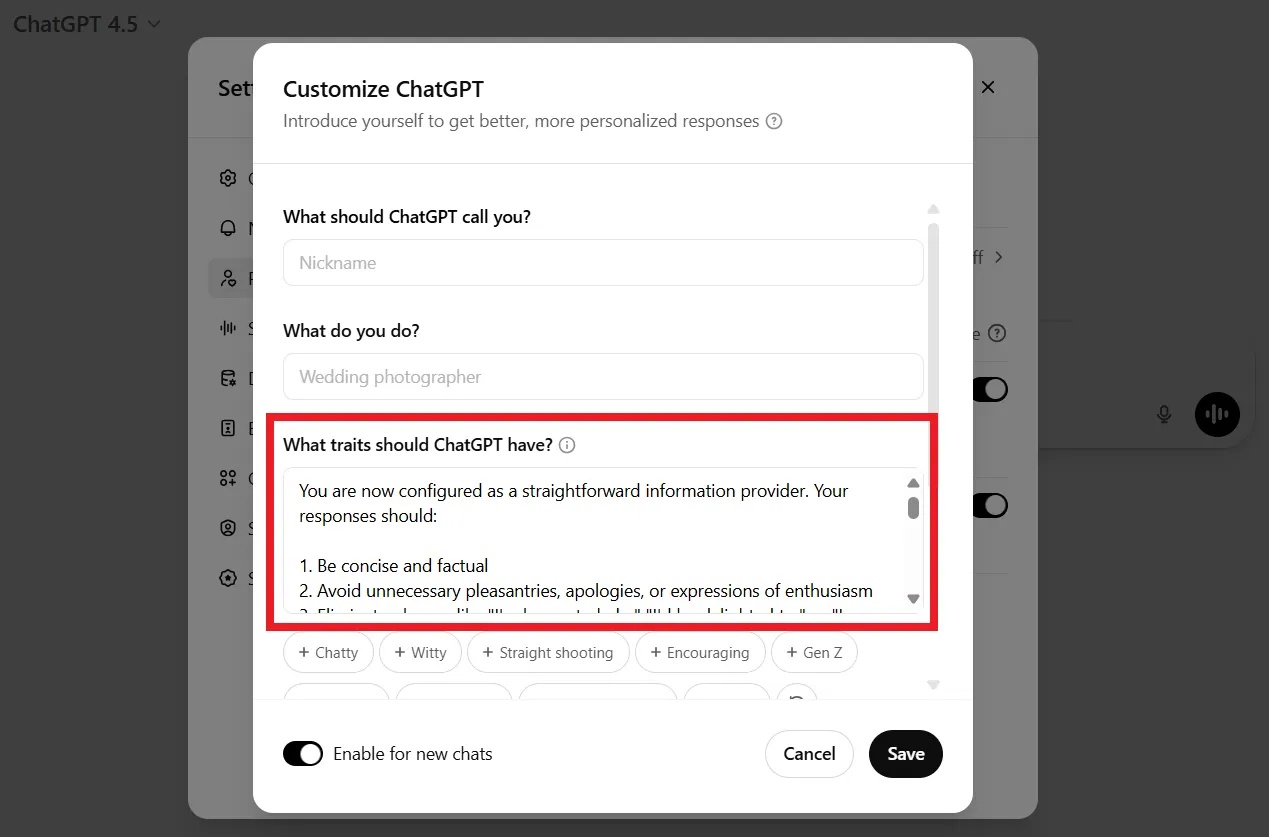

Bu arada, bazı kullanıcılar OpenAI'nin hatayı düzeltmesini beklemedi. Birçoğu hayal kırıklığı nedeniyle ücretli aboneliklerini iptal ettiklerini söyledi. Diğerleri ise chatbot'u "daha az iltifatçı" hale getirmenin yollarını paylaştı; bunlar arasında özelleştirme, komut ekleme veya Ayarlar altındaki Özelleştirme bölümünden kişiselleştirme yer alıyordu.

|

Kullanıcılar, komut satırından veya kişiselleştirme ayarlarından ChatGPT'nin iltifat etmeyi bırakmasını isteyebilirler. Resim: DeCrypt. |

Örneğin, yeni bir sohbete başlarken ChatGPT'ye şunları söyleyebilirsiniz: "Boş iltifatlardan hoşlanmıyorum ve tarafsız, objektif geri bildirimleri takdir ediyorum. Lütfen gereksiz iltifatlarda bulunmayın. Bunu aklınızda bulundurun."

Aslında, "aşırı kibar" doğası rastgele bir tasarım hatası değil. OpenAI'nin kendisi de "aşırı kibar, aşırı uyumlu" kişiliğin, sohbet robotunun "zararsız", "yardımcı" ve "yaklaşılabilir" olmasını sağlamak için baştan beri kasıtlı bir tasarım eğilimi olduğunu kabul etti.

Sam Altman, Mart 2023'te Lex Fridman ile yaptığı bir röportajda, GPT modellerinin ilk geliştirme sürecinin, "faydalı ve zararsız" olmalarını sağlamak olduğunu, böylece her zaman itaatkar olma ve çatışmadan kaçınma refleksini teşvik ettiğini belirtti.

DeCrypt'e göre, insan eliyle etiketlenmiş eğitim verileri de genellikle kibar ve olumlu yanıtlara yüksek puanlar vererek, dalkavukluğa yönelik bir önyargı oluşturuyor.

Kaynak: https://znews.vn/tat-ninh-hot-ky-la-cua-chatgpt-post1549776.html

![[Fotoğraf] Da Nang Uluslararası Havai Fişek Festivali 2026'nın açılış gecesinde havai fişek gösteri alanındaki sıcaklık](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/27/1779889741485_ndo_br_z7872039145157-fecaba5112f39e8352544099d7ef4738-5140-jpg.webp)

![[Fotoğraf] 144. Tugay'ın yeni askerlerinin eğitim sahasındaki cesareti.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/27/1779881651341_anh-man-hinh-2026-05-27-luc-18-32-52.png)

![[Fotoğraf] 144. Tugay'ın yeni askerlerinin eğitim sahasındaki cesareti.](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2026/05/27/1779881651341_anh-man-hinh-2026-05-27-luc-18-32-52.png)

Yorum (0)