В останні місяці експерти та дослідники з безпеки дітей попереджали, що креативний штучний інтелект може посилити онлайн-насильство.

Генеральний директор Meta Марк Цукерберг виступає на слуханнях Юридичного комітету Сенату США 31 січня 2024 року перед натовпом учасників, які тримали зображення, створені штучним інтелектом. Фото: Reuters

NCMEC ще не оприлюднила загальну кількість повідомлень про контент із жорстоким поводженням з дітьми з усіх джерел, отриманих у 2023 році. Але у 2022 році було отримано повідомлення про близько 88,3 мільйона файлів щодо цієї проблеми.

«Ми отримуємо звіти від самих інноваційних компаній у сфері штучного інтелекту, (онлайн) платформ та громадськості», – сказав Джон Шехан, віцепрезидент NCMEC.

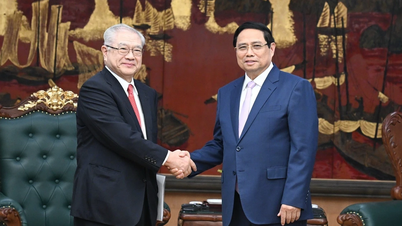

Генеральні директори Meta, X, TikTok, Snap та Discord дали свідчення на слуханнях у Сенаті США щодо безпеки дітей на онлайн-платформах у середу (31 січня). Законодавці США розпитали компанії соціальних мереж про їхні зусилля щодо захисту дітей від «онлайн-хижаків».

Дослідники Стенфордської інтернет-обсерваторії у звіті, опублікованому в червні минулого року, повідомили, що зловмисники можуть використовувати генеративний штучний інтелект для неодноразового завдання шкоди реальним дітям шляхом створення їх підроблених зображень.

Феллон Макналті, директор CyberTipline NCMEC, яка приймає повідомлення про онлайн-експлуатацію дітей, сказав, що контент, створений штучним інтелектом, стає «все більш фотореалістичним», що ускладнює визначення того, чи є жертвами реальні люди.

Макналті сказав, що OpenAI, компанія, яка створила ChatGPT, налаштувала процес подання звітів до NCMEC, і організація веде переговори з іншими компаніями, що займаються штучним інтелектом.

Хоанг Хай (за даними Reuters, FT)

Джерело

![[Фото] Осінній ярмарок 2025 та вражаючі рекорди](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762180761230_ndo_br_tk-hcmt-15-jpg.webp)

![[Фото] Генеральний секретар То Лам приймає посла Сінгапуру Джаю Ратнама](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762171461424_a1-bnd-5309-9100-jpg.webp)

![[Фото] Прем'єр-міністр Фам Мінь Чінь приймає голову Асоціації дружби між Японією та В'єтнамом у регіоні Кансай](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762176259003_ndo_br_dsc-9224-jpg.webp)

![[Фото] Лам Донг: Крупний план незаконного озера з пробитою стіною](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762166057849_a5018a8dcbd5478b1ec4-jpg.webp)

Коментар (0)