Настав час кожному користувачеві стати «цифровим щитом», бути пильним, уважним та відповідальним з кожним кліком та поширенням.

Переваги та тонка грань ШІ

Штучний інтелект ще ніколи не був таким близьким до повсякденного життя. Лише кількома клацаннями ми можемо створювати голоси, зображення та навіть відео з вражаючою реалістичністю. Штучний інтелект заощаджує час, зменшує витрати на виробництво контенту та відкриває еру гнучких цифрових медіа.

Однак, саме ця здатність «реалістично імітувати реальність» стала палицею з двома кінцями. Останнім часом соціальні мережі заполонили відео, створені за допомогою технології діпфейків, у яких обличчя керівників поліції та зображення правоохоронців у делікатних справах маніпулюють та спотворюють закадровим голосом, щоб ввести в оману та розділити громадськість.

Такі постановочні зображення стають дедалі поширенішими в соціальних мережах.

У вірусному кліпі TikTok зображення співробітника ДАІ на чергуванні поєднувалися з образливими діалогами, що супроводжувалися хештегом «штрафи просто для виду», що натякало на те, що офіцер зловживав своєю владою заради особистої вигоди. Багато користувачів, особливо молодь, легко повірили цьому контенту, оскільки візуальні ефекти були дуже реалістичними, а голос точно відповідав рухам губ, що надзвичайно ускладнювало розрізнення між реальністю та фальшивістю.

Молодий ютубер з Дьєнб'єна поплатився адміністративним штрафом та вимушеними публічними вибаченнями лише за бажання «похизуватися» своїми навичками у сфері штучного інтелекту. Вдень 24 січня поліція провінції Дьєнб'єн оголосила, що Департамент кібербезпеки та запобігання злочинам у сфері високих технологій наклав адміністративний штраф на Тонг Ван Т. (2001 року народження, проживає в районі Муонг Анг) у розмірі 7,5 мільйонів донгів за використання штучного інтелекту для створення сфабрикованого відео, що містить спотворений та образливий контент про співробітників дорожньої поліції.

Зокрема, 7 січня Т. завантажила відео тривалістю понад 3 хвилини на свій обліковий запис YouTube «Tuyen Vlog» із шокуючою назвою: «Під час прогулянки мене переслідувала дорожня поліція». У відео зображення та ситуації були інсценовані за допомогою технології штучного інтелекту, імітуючи переслідування громадян дорожньою поліцією, та поєднані з ефектами та коментарями, які були образливими та наклепницькими щодо правоохоронних органів.

Співпрацюючи з поліцією, Т. визнав, що весь вміст кліпу був сфабрикованим продуктом, створеним для «розважальних» цілей та демонстрації його здатності використовувати технологію штучного інтелекту. Окрім штрафу, влада зобов’язала Т. видалити фальшиве відео та публічно вибачитися перед дорожньою поліцією на його особистому каналі YouTube.

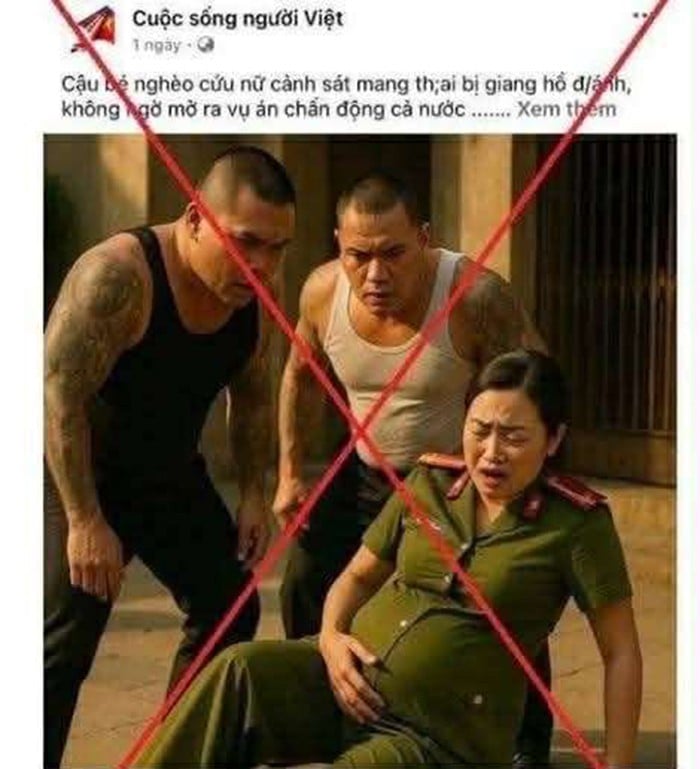

В епоху цифрової революції , особливо швидкого розвитку штучного інтелекту, ворожі та реакційні сили не вагаються використовувати цей інструмент для створення вигаданих образів та історій, спрямованих на спотворення та очорнення іміджу В'єтнамської народної поліції. Нещодавно в соціальних мережах поширилася фотографія, на якій вагітна жінка в поліцейській формі отримує погрози від двох чоловіків із «гангстерською» зовнішністю, є яскравим доказом цієї тактики.

Зображення, створене за допомогою штучного інтелекту, нещодавно стало вірусним у соціальних мережах.

На перший погляд, глядачі можуть легко сплутати це зі справжньою сценою, що супроводжується сенсаційними заголовками на кшталт: «Бідолашний хлопчик рятує вагітну поліцейську, на яку напали гангстери, несвідомо розкриваючи справу, яка шокує всю націю...». Однак насправді це лише постановочна сцена, можливо, з фільму чи розважального продукту, або, що ще гірше, зображення, створене штучним інтелектом, щоб обдурити емоції читача, змусивши його відчувати жалість та сумніватися в справжністі правоохоронних органів.

Ще більш тривожним є те, що поширення такого контенту не лише шкодить репутації та іміджу Народної поліції, яка працює день і ніч для захисту безпеки та порядку в суспільстві, але й являє собою витончену форму психологічної війни. Коли довіра народу до влади підривається оманливими зображеннями, приховані мотиви ворожих сил, спрямовані на розкол національної єдності, поступово проявляються.

Тому кожен громадянин повинен підвищувати свою пильність, розвивати навички критичного мислення та вміння виявляти неправдиву інформацію, а також рішуче засуджувати та спростовувати неправдивий контент, сприяючи захисту ідеологічної основи та підтримці соціальної стабільності перед обличчям сучасної хвилі шкідливої інформації в інтернеті.

У Хошиміні майже хвилинний відеокліп несподівано став вірусним у соціальних мережах, на якому видно, як людина в поліцейській формі «змушує» підозрюваного зізнатися у порушенні правил дорожнього руху в офісі. На відео особа, яку вважають поліцейським, демонструє агресивну поведінку, постійно кричить і навіть використовує грубу мову, що викликає обурення громадськості.

Однак невдовзі після того, як кліп став вірусним, поліція міста Хошимін швидко провела розслідування та підтвердила, що це був складний діпфейк. Згідно з їхніми висновками, обличчя на відео були взяті із запису внутрішньої поліцейської конференції, а потім маніпульовані зловмисниками за допомогою технології штучного інтелекту, щоб накласти їх на постановочну сцену, що змусило глядачів повірити, що це реальна подія.

Зокрема, супровідний аудіозапис містить погрозливі та образливі голоси, які насправді не є справжніми словами жодного чиновника, а скоріше синтезованими голосами штучного інтелекту, запрограмованими та відредагованими, щоб обдурити емоції глядача.

Цей інцидент є яскравим прикладом використання технології діпфейків для спотворення та очорнення Народної поліції, тактики, яку все частіше використовують реакційні та підривні сили в кіберпросторі. Важливо, що якщо такі підроблені продукти не викрити вчасно, вони можуть призвести до серйозних наслідків: підриву довіри громадськості до правоохоронних органів, підбурювання до опору в громаді та сприяння поширенню неправдивих наративів. Це служить чітким попередженням про нагальну необхідність покращення комунікаційних можливостей для спростування, виявлення та боротьби з фейковими новинами, а також закликає кожного громадянина бути пильним та утримуватися від поспішного поширення або коментування неперевіреного контенту з офіційних джерел.

В іншому нещодавньому випадку, пов'язаному з вирішенням порушень у центрі техогляду транспортних засобів на півдні, ворожі елементи поширили фальшиве відео, на якому керівник провінційної поліції виступає на захист корумпованих чиновників. Цей кліп, поширений у Telegram та соціальних мережах під назвою «підтриманий потужними силами», насправді був продуктом штучного інтелекту та не з'являвся на жодних прес-конференціях чи офіційних документах.

В інтернеті непомітно поширюється небезпечна тенденція: зловмисники використовують технології штучного інтелекту для створення фальшивих відео з метою шахрайства та вимагання. Останнім часом багато людей стають жертвами, коли їхні зображення, особливо зображень соціально шанованих осіб, таких як юристи, лікарі та бізнесмени, накладаються на відео, що рекламують «повернення грошей, втрачених в онлайн-шахрайстві».

У цих кліпах штучний інтелект використовується для імітації голосу та обличчя адвокатів, змушуючи глядачів повірити шахраям і легко надавати їм особисту інформацію або переказувати гроші. Ще більш небезпечним є те, що деякі зловмисники використовують технологію діпфейків, щоб накладати обличчя жертв на секс-відео, а потім надсилати їх подружжю або колегам з наміром погрожувати або змусити їх переказати гроші, щоб вони «мовчали».

Шокуючий інцидент стався у березні 2025 року, коли жертву в Ханої попросили переказати десятки мільйонів донгів після отримання фальшивого секс-відео з її участью. Тим часом у Хошиміні іншу особу шантажували на 2 мільярди донгів, якщо вона не хотіла, щоб конфіденційне відео поширювалося. Міністерство громадської безпеки розпочало розслідування, виявивши кілька транснаціональних злочинних груп, переважно з Китаю та Південно-Східної Азії, які стоять за цими мережами та використовують одноразові SIM-картки, електронні гаманці та платформи соціальних мереж для приховування своєї особи.

Це вже не дрібна афера, а форма «високотехнологічної психологічної війни», яка глибоко використовує страх перед честю та соціальними зв’язками для тиску на жертв. Без підвищеної пильності та навичок виявлення незвичайної інформації та поведінки кожен може стати жертвою цих високотехнологічних злочинців. Зіткнувшись із цією витонченою хвилею видання себе за іншу особу, кожен громадянин повинен бути пильним, абсолютно утримуватися від безпідставного обміну особистою інформацією та бути готовим виступити проти незаконної діяльності, сприяючи захисту власної безпеки та безпеки громади.

Для боротьби із загрозою діпфейків потрібен «цифровий щит» з боку спільноти.

За даними Департаменту телерадіомовлення, телебачення та електронної інформації (Міністерства культури, спорту та туризму), у 2024 році цифрові платформи у В'єтнамі були змушені видалити понад 4000 відео, що містили неправдиву та спотворену інформацію, більшість з яких були продуктами, створеними за допомогою технологій штучного інтелекту, таких як діпфейки та голосові клони. Тільки TikTok – платформу, популярну серед молоді – попросили видалити понад 1300 діпфейкових кліпів, переважно пов'язаних з поліцією, урядом та соціальною політикою.

В епоху технологічного буму штучний інтелект розкриває новаторський потенціал, але він також несе безпрецедентні небезпеки, особливо продукти з технологією deepfake, що містять спотворений контент, який атакує репутацію державних установ. Опитування, проведене Інститутом досліджень медіа MICRI, показує, що 62% користувачів соціальних мереж у В'єтнамі не можуть розрізнити справжню та фальшиву інформацію без попереджень від основних ЗМІ чи влади. Це «когнітивна прогалина», яку зловмисні сили ретельно використовують для поширення дезінформації та порушення соціальної психології.

Тонг Ван Т. у поліцейській дільниці.

За словами генерал-майора, доцента та доктора До Кань Тхіна, експерта з кримінології, використання штучного інтелекту для створення фальшивих відеороликів, що видають себе за лідерів, редагування неправдивих заяв або спотворення професійних дій поліції, є новою, але особливо небезпечною тактикою. «Діпфейк — це не просто розважальний продукт, а форма сучасної інформаційної війни, здатна підривати довіру, спричиняти соціальну нестабільність і яку дуже важко контролювати», — заявив генерал-майор До Кань Тхін.

Насправді, кліпи, маніпульовані штучним інтелектом, далеко не нешкідливі; вони часто стосуються делікатних тем, таких як розслідування порушень, злочинів та боротьба з корупцією, що викликає громадську плутанину та недовіру до правоохоронних органів. Ще більш тривожним є те, що багато відео поширюються на великих платформах, таких як YouTube та TikTok, збираючи сотні тисяч переглядів, перш ніж їх видаляють, створюючи негативний хвильовий ефект.

Експерт з цифрових медіа Хоанг Мінь попереджає: «Лише один необережний репост чи лайк може перетворити вас на співучасника фейкових новин. Кожен користувач Інтернету повинен розуміти, що дії в цифровому просторі також мають реальні наслідки».

У цьому контексті як ніколи потрібно побудувати «цифровий щит» зсередини самої спільноти: тобто пильність, інформаційний імунітет та почуття відповідальності за онлайн-середовище. Технології можуть бути нейтральними, але те, як люди їх використовують, визначатиме, чи стане ШІ рушійною силою розвитку, чи руйнівною силою проти соціальної довіри. Збереження ідеологічної стійкості та захист іміджу поліцейського захищає основи національної безпеки — завдання не лише для відповідних органів, а й для кожного громадянина в цифрову епоху.

Джерело: https://baolangson.vn/tinh-hai-mat-cua-ai-5050403.html

![[Фото] Прем'єр-міністр Фам Мінь Чінь головує на діалозі з японським бізнесом.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/03/21/1774097547316_ndo_br_dsc-0448-jpg.webp)

Коментар (0)