تاہم، صارفین نے فوری طور پر دریافت کیا کہ ریستوران کے بلوں کو غلط ثابت کرنے کے لیے اس خصوصیت کا غلط استعمال کیا جا سکتا ہے۔

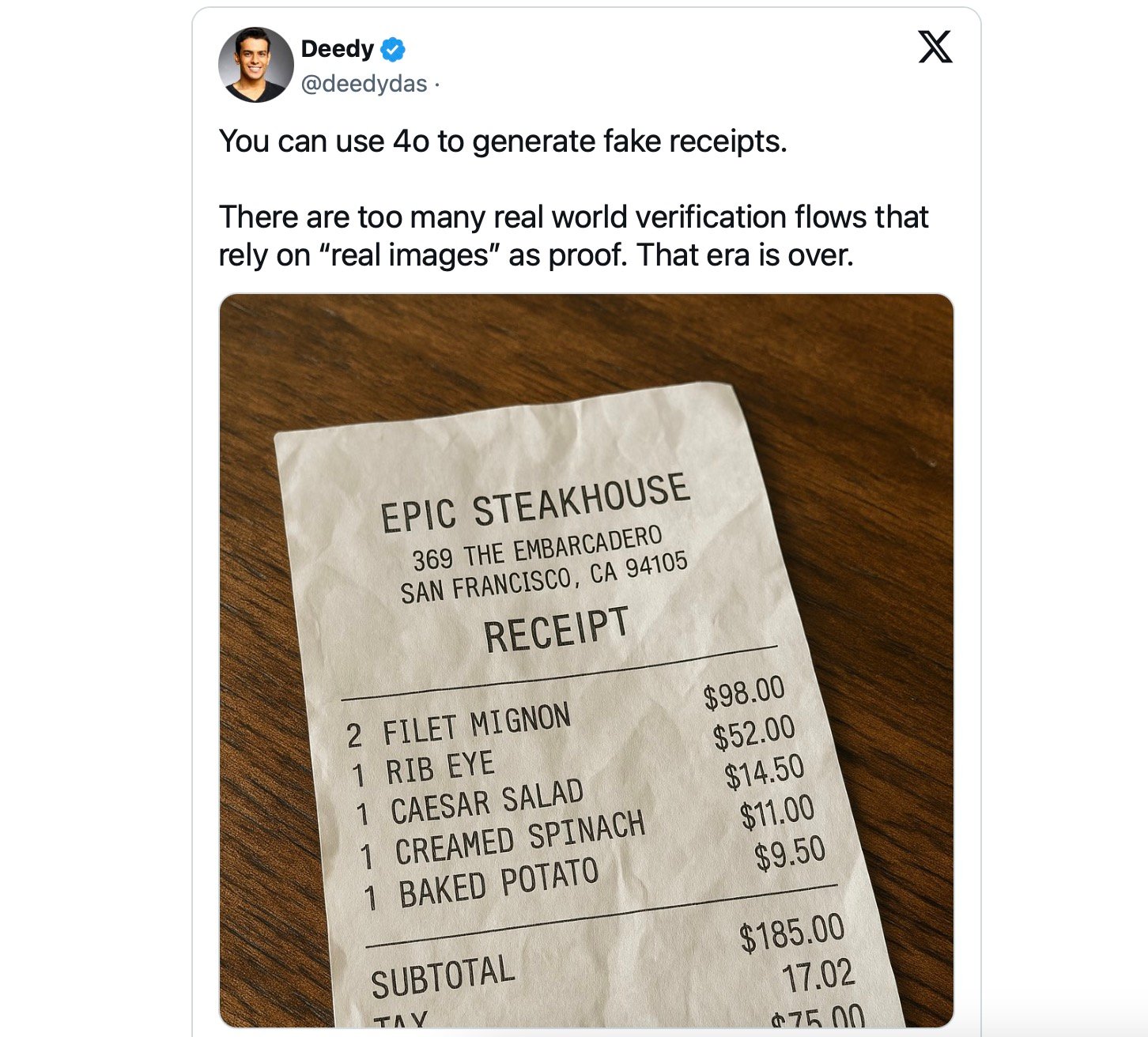

سرمایہ کار ڈیڈی داس نے X پر سان فرانسسکو سٹیک ہاؤس سے جعلی رسید کی تصویر پوسٹ کی، اور دعویٰ کیا کہ تصویر GPT-4o کا استعمال کرتے ہوئے بنائی گئی تھی۔

انوسٹر ڈیڈی نے سوشل میڈیا پلیٹ فارم X پر تصویر شیئر کی۔

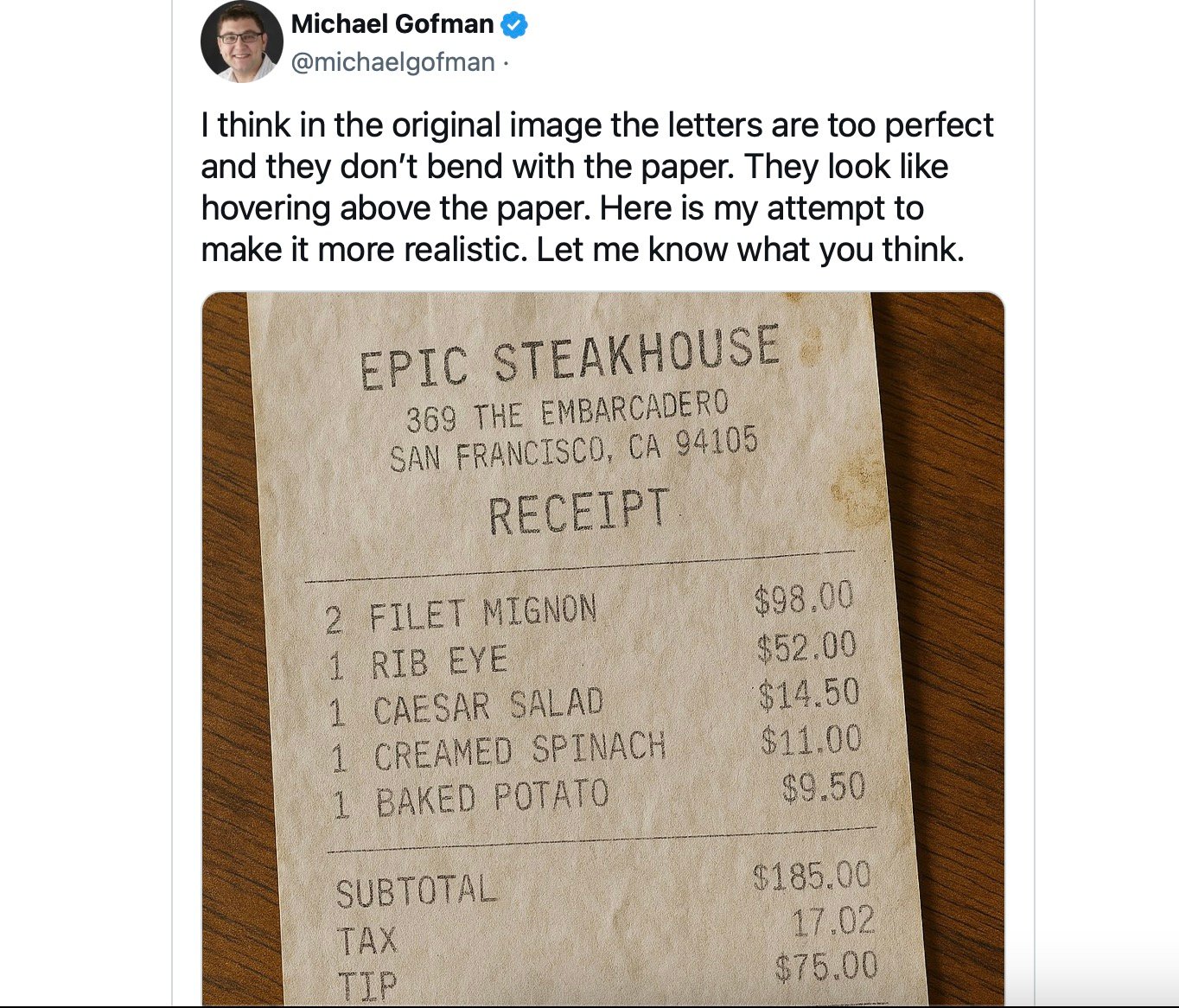

بہت سے دوسرے صارفین نے بھی کامیابی کے ساتھ اثر کو دوبارہ بنایا ہے، یہاں تک کہ حقیقت پسندی کو بڑھانے کے لیے کھانے پینے کے داغ بھی شامل کیے ہیں۔

ایک اور صارف نے کھانے کے داغوں والی رسید کی ایک تصویر شیئر کی جو بہت حقیقت پسندانہ لگ رہی تھی، لیکن اسے ChatGPT نے بھی بنایا تھا۔

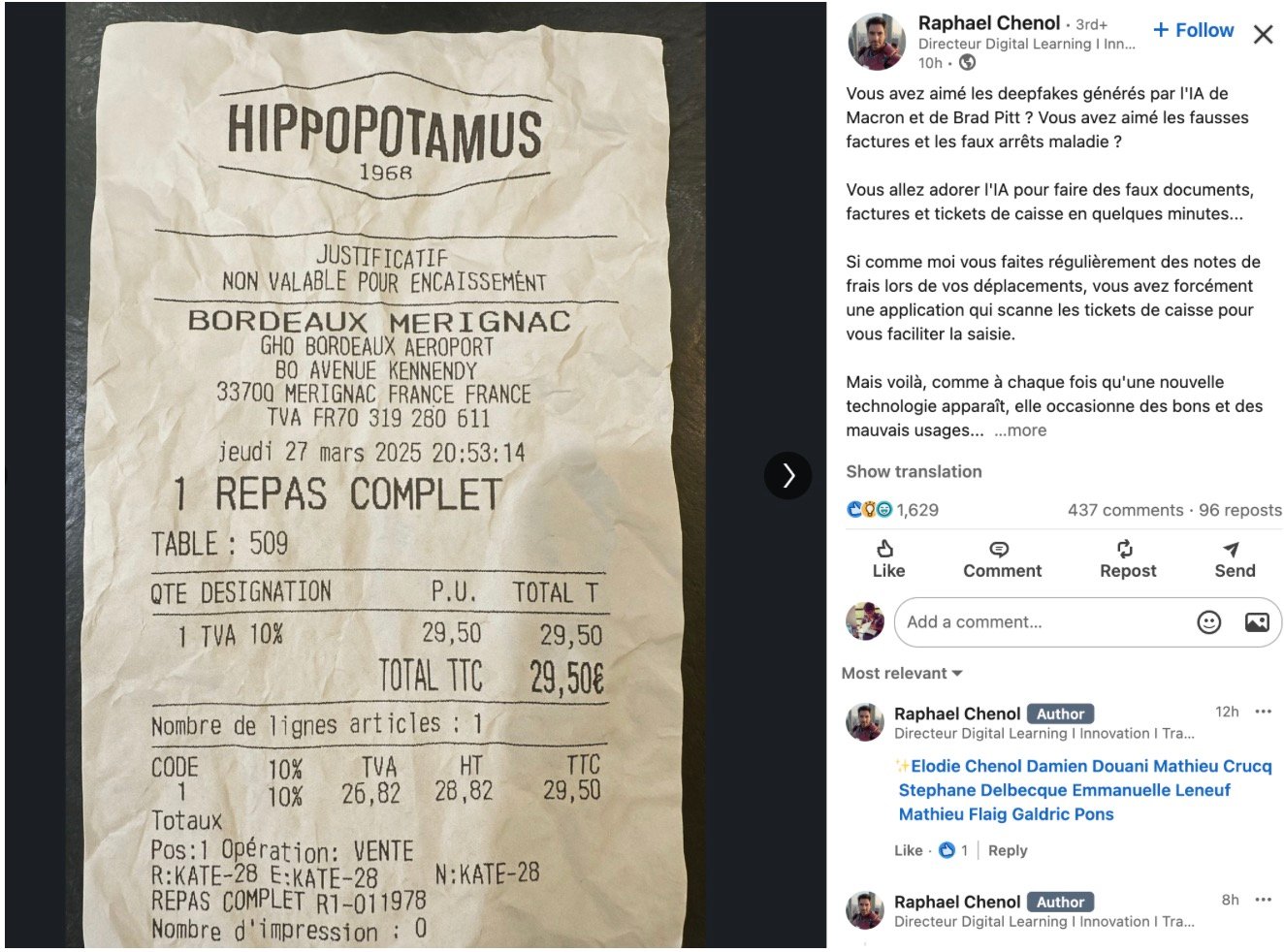

یا، مثال کے طور پر، فرانس میں ایک صارف نے مقامی ریسٹورنٹ چین سے جعلی، پسی ہوئی رسید پوسٹ کی۔

تصویر فرانس کے ایک صارف نے شیئر کی ہے۔

بہت سے دوسرے لوگوں نے نئی خصوصیت کا تجربہ کیا ہے اور اسٹورز کے لیے جعلی رسیدیں بھی تیار کی ہیں، لیکن تصاویر میں اب بھی تضادات ہیں جیسے: کل رقم میں پیریڈز کے بجائے کوما؛ غلط حسابات (بنیادی حسابات میں AI کی کمزوری)۔

تاہم، نقصان دہ اداکار آسانی سے سافٹ ویئر کا استعمال کرکے یا کمانڈز (پرامپٹس) میں ترمیم کرکے آسان ترمیم کرکے اسے ٹھیک کرسکتے ہیں۔

جس آسانی کے ساتھ جعلی رسیدیں بنائی جا سکتی ہیں اس سے اہم خطرات کھل جاتے ہیں، جیسے کہ غیرموجود اخراجات کے لیے دھوکہ دہی کی واپسی۔

اس مسئلے کے جواب میں، OpenAI نے کہا کہ تمام AI سے تیار کردہ تصاویر میں میٹا ڈیٹا ہوتا ہے جو ChatGPT سے ان کی اصلیت کو تسلیم کرتا ہے۔ کمپنی اس وقت بھی "کارروائی کرتی ہے" جب صارفین اس کی پالیسیوں کی خلاف ورزی کرتے ہیں اور حقیقی دنیا کے تاثرات سے "مسلسل سیکھتے ہیں"۔

جب ان سے جعلی رسیدیں بنانے کی اجازت دینے کے بارے میں پوچھا گیا تو، OpenAI کے ترجمان تایا کرسٹیسن نے وضاحت کی کہ اس کا مقصد "تخلیقی آزادی کو زیادہ سے زیادہ کرنا" ہے، اور تجویز دی کہ جعلی رسیدیں مالی تعلیم ، آرٹ، یا اشتہاری مقاصد کے لیے استعمال کی جا سکتی ہیں۔

یہ پہلا موقع نہیں ہے جب AI کا استحصال کیا گیا ہو۔ اس سے پہلے، MidJourney اور DALL-E کا استعمال دستاویزات، شناختی کارڈز اور یہاں تک کہ کرنسی کی جعلی تصاویر بنانے کے لیے کیا جاتا تھا۔

Cao Phong (TC, MSB کے مطابق)

ماخذ: https://www.congluan.vn/moi-nguy-trinh-tao-hinh-anh-moi-cua-chatgpt-trong-viec-lam-gia-bien-lai-post340969.html

![[تصویر] جنرل سکریٹری ٹو لام نے نمائش کی جگہ کا دورہ کیا جس میں کتابوں، تصویری نمائشوں، اور صحافت میں ڈیجیٹل تبدیلی کی کامیابیوں کی نمائش کی گئی ہے۔](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F19%2F1766110879215_1766110240024-jpg.webp&w=3840&q=75)

![[تصویر] نگھے این میں پہاڑی کنارے پر پرفتن قدیم گلاب کا باغ](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F19%2F1766109900916_vuon-hong-chin-do-thu-hut-du-khach-toi-check-in-o-ha-noi-3-20162778-1671624890024-1671624890104198100259.jpeg&w=3840&q=75)

تبصرہ (0)