پیگرد قانونی به دلیل استفاده از افراد برای تقلب در امتحانات فارغ التحصیلی آغاز شد

در حالی که آزمون فارغالتحصیلی دبیرستان ۲۰۲۵ هنوز در جریان بود، اطلاعاتی در رسانههای اجتماعی منتشر شد مبنی بر اینکه داوطلبان از هوش مصنوعی برای کمک به حل مسائل در طول آزمون ریاضی استفاده میکنند. وزارت امنیت عمومی بلافاصله منبع اطلاعات را بررسی کرد و کمتر از یک روز پس از طرح این ادعاها، مشخص شد که سه داوطلب در دو مرکز امتحانی از هوش مصنوعی برای تقلب در طول آزمون استفاده کردهاند. هر سه داوطلب به این تخلف اعتراف کردند.

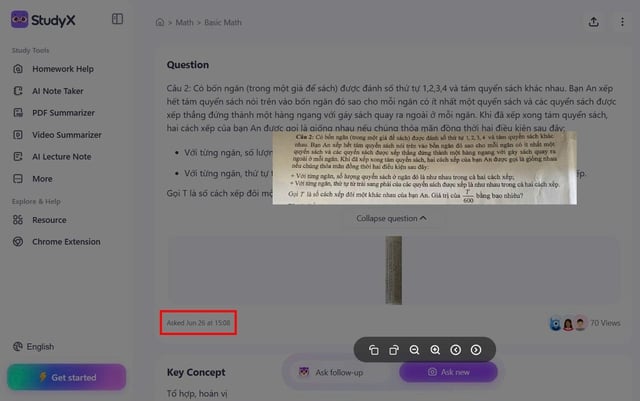

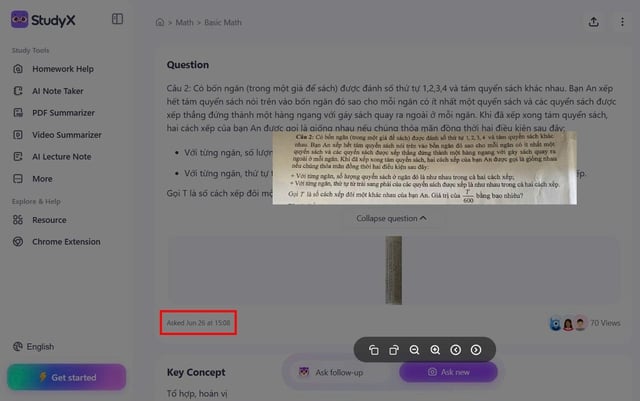

در اوایل ماه جولای، پلیس هانوی گزارش داد که یک داوطلب مخفیانه یک تلفن همراه را به اتاق امتحان آورده، از سوالات امتحان عکس گرفته و با استفاده از دو برنامه هوش مصنوعی، Gemini و StudyX، از آنها برای حل آنها درخواست کمک کرده است. علاوه بر این، در اواخر ماه ژوئن، پلیس در استان سابق لام دونگ نیز داوطلبی را کشف کرد که با استفاده از یک دوربین دکمهای، امتحان رسمی ادبیات را به صورت زنده پخش میکرد و از یکی از دوستانش در بیرون میخواست تا با استفاده از ChatGPT سوالات را برای او حل کند و پاسخها را با صدای بلند بخواند.

علاوه بر استفاده از دستگاههای تکنولوژیکی، برخی از داوطلبان اکنون از برنامههای هوش مصنوعی برای تقلب در امتحانات مهم استفاده میکنند - عکس: CHATGPT

در موارد فوق، پلیس علیه متخلفان اقدامات کیفری آغاز کرد زیرا سوالات امتحان فارغالتحصیلی دبیرستان به عنوان اسرار دولتی «فوق سری» طبقهبندی میشوند.

سرلشکر تران دین چونگ، معاون مدیر اداره امنیت سیاسی داخلی (PA03) تحت نظر وزارت امنیت عمومی، در کنفرانس مطبوعاتی اختتامیه آزمون فارغالتحصیلی دبیرستان ۲۰۲۵، تأیید کرد که این حادثه تقلب در آزمون در مقیاس کوچکی رخ داده و هیچ گونه نشتی از سوالات آزمون وجود نداشته است. ژنرال چونگ تأکید کرد که این موضوع بر امنیت و ایمنی کل آزمون تأثیری نداشته است. او همچنین پیشبینی کرد که استفاده از هوش مصنوعی برای تقلب در آینده به طور فزایندهای پیچیده خواهد شد.

هرچه هوش مصنوعی بیشتر توسعه یابد، کلاهبرداری مبتنی بر هوش مصنوعی بیشتر گسترش خواهد یافت.

یک دانشآموز دبیرستانی در شهر هوشی مین، که امسال وارد کلاس دوازدهم میشود، اظهار داشت که او و همسالانش تقریباً در همه دروس، به ویژه هنگام جستجوی اطلاعات برای ارائهها، از هوش مصنوعی استفاده میکنند.

این دانشجو گفت: «مواردی وجود دارد که دانشآموزان از هوش مصنوعی برای تقلب در امتحانات استفاده میکنند، اما رایج نیست، زیرا هوش مصنوعی فقط در موضوعات نظری علوم اجتماعی کمک میکند، در حالی که اغلب در حل مسائل علوم طبیعی شکست میخورد یا راهحلهای نادرست زیادی ارائه میدهد.» وی افزود: «بنابراین، من فکر میکنم با توسعه هوش مصنوعی، تقلب با استفاده از هوش مصنوعی نیز ممکن است گسترش یابد.»

وزارت آموزش و پرورش میتواند با متخصصان هوش مصنوعی - کسانی که قابلیتها و محدودیتهای هوش مصنوعی را درک میکنند - همکاری کند تا در مورد روشهای مؤثر طراحی سوالات امتحانی در عصر هوش مصنوعی مشاوره دریافت کند.

نگوین جیا هی، M.Sc.، مدرس هوش مصنوعی در دانشگاه سوینبرن (استرالیا)

به گفته سرلشکر تران دین چونگ، این وضعیت نیازمند راهکارهای جامع برای پیشگیری و بازدارندگی است، مانند ادامه استفاده از فناوریهای پیشرفتهتر برای تشخیص تقلب با استفاده از هوش مصنوعی یا تقویت هماهنگی بین همه طرفها. ژنرال چونگ همچنین پیشنهاد کرد که همه طرفها باید آگاهی خود را افزایش دهند و داوطلبان و افراد درگیر را در مورد پیامدهای تقلب در امتحان آموزش دهند تا از همان ابتدا از این مشکل جلوگیری شود.

دانشآموزان از DeepSeek، یک ابزار هوش مصنوعی محبوب از چین، برای حل سوالات انگلیسی برای امتحان فارغالتحصیلی دبیرستان ۲۰۲۵ استفاده میکنند - عکس: NGOC LONG

آیا میتوانید ویژگیهای ابزار را در طول آزمون متوقف یا محدود کنید؟

استاد بویی مان هونگ، بنیانگذار و مدیرعامل اپلیکیشن آموزشی Aiducation، داستان بسیاری از شرکتهای فناوری چینی را بازگو کرد که بهطور موقت خدمات خود را به حالت تعلیق درآوردند یا ویژگیهای خاصی از ابزارهای تولید شده توسط هوش مصنوعی مانند DeepSeek و Doubao را محدود کردند... تا از تقلب در امتحانات ورودی دانشگاههای کشور جلوگیری شود.

بنابراین، آقای هونگ پیشنهاد داد که ویتنام میتواند مقررات مشابهی را در طول دوره امتحانات فارغالتحصیلی دبیرستان اجرا کند. این یک روش مؤثر است زیرا به جلوگیری از ریشه مشکل کمک میکند. آقای هونگ افزود که برنامه Education به طور موقت ویژگیهای هوش مصنوعی مربوط به حل مسئله را در روزهای اخیر امتحانات فارغالتحصیلی دبیرستان غیرفعال کرده است تا از سوءاستفاده از این ابزار برای اهداف تقلب جلوگیری شود.

هونگ با اطمینان گفت: «امیدوارم به زودی سازوکاری برای شرکتهای فناوری مانند ما ایجاد شود تا با وزارت آموزش و پرورش و سایر سازمانهای مربوطه هماهنگی کنند تا بتوانیم همزمان ارائه خدمات هوش مصنوعی مرتبط را به حالت تعلیق درآوریم تا از صحت و جدیت امتحان اطمینان حاصل شود.»

با این حال، نگوین گیا هی، مدرس هوش مصنوعی در دانشگاه سوینبرن (استرالیا) و یکی از بنیانگذاران و مدیرعامل دو کسبوکار متمرکز بر هوش مصنوعی در ویتنام، SkillPixel و AIFicient، استدلال میکند که ممنوعیت ابزارهای هوش مصنوعی بسیار مؤثر فقط برای کشورهایی مانند ایالات متحده و چین که محصولات هوش مصنوعی داخلی قوی دارند، مناسب است. در ویتنام، اگر داوطلبان دکترا بخواهند تقلب کنند، در درجه اول از ابزارهای هوش مصنوعی خارجی به جای ابزارهای داخلی استفاده میکنند.

آقای های گفت: «چین این استراتژی را به طور مؤثر اجرا کرد، زیرا تقریباً تمام محصولات فناوری آمریکایی، از جمله ChatGPT را مسدود کرد. اگر آدرسهای IP این ابزارها را در طول امتحان مسدود کنیم، میتوانیم تقلب را بهتر محدود کنیم، اما این امر تأثیر زیادی بر سایر کاربران خواهد گذاشت زیرا آنها نیز قادر به دسترسی به آنها نخواهند بود. و حتی با مسدود کردن IP، اگر داوطلبان از نرمافزار VPN برای تغییر منطقه استفاده کنند، هنوز هم میتوان آن را دور زد.»

آقای های اضافه کرد، علاوه بر این، اگر از شرکتهای هوش مصنوعی خارجی بخواهیم ویژگی حل تکالیف را غیرفعال کنند، بعید است که این کار را انجام دهند زیرا تحت کنترل دولت ویتنام نیست.

پستی در پلتفرم هوش مصنوعی StudyX با سوالی از امتحان ریاضی فارغالتحصیلی دبیرستان در تاریخ ۲۶ ژوئن مطابقت داشت - عکس: اسکرینشات

تغییر باید از کنکور شروع شود.

بر اساس واقعیت فوق، استاد های یک مدل اقدام سه سطحی را پیشنهاد کرد. در پایینترین سطح، که آگاهی کاندیداها است، باید انتشار و آموزش اخلاق هنگام استفاده از هوش مصنوعی را تقویت کنیم. علاوه بر این، باید مجازاتهای خاصی را تعریف کنیم و موارد تقلب با استفاده از هوش مصنوعی را به شدت کنترل کنیم تا الگو قرار دهیم. استاد های اظهار داشت: «اگرچه نمیتوانیم نیت کاندیداهای سرسختی را که تقلب میکنند تغییر دهیم، اما برای آن دسته از کاندیداهایی که در آستانه نقض قوانین هستند، انتشار و آموزش کامل نتایج بسیار خوبی خواهد داشت.»

سطح بعدی شامل طراحی مجدد قالب سؤال است، زیرا سؤالات چندگزینهای «شرایط بسیار خوبی» برای هوش مصنوعی فراهم میکنند تا مسائل را با دقت بالا حل کند. برعکس، اگر سؤالات به سبک انشا، تحلیلی و حل مسئله موقعیتی باشند، «قابلیتهای هوش مصنوعی را تا حد زیادی محدود خواهد کرد». آقای های پیشنهاد داد: «وزارت آموزش و پرورش میتواند با متخصصان هوش مصنوعی - کسانی که قابلیتها و محدودیتهای هوش مصنوعی را درک میکنند - همکاری کند تا در مورد روشهای مؤثر طرح سؤال در عصر هوش مصنوعی مشاوره دریافت کند.»

پروفسور های افزود: «در دانشگاهی که من در استرالیا تدریس میکنم، به دانشجویان اجازه داده میشود که امتحانات پایان ترم خود را در خانه بدهند، اما اگر از ChatGPT برای حل آنها استفاده کنند، نمرات بالایی نخواهند گرفت زیرا سوالات به گونهای طراحی شدهاند که متناسب با موقعیت باشند. دانشجویان باید مطالب را کاملاً درک کنند و بدانند که چگونه محتوای آموخته شده و دانش را در کار خود به کار گیرند. حتی با وجود یک ابزار پشتیبانی، دانشجویان هنوز هم باید مطالب را واقعاً درک کنند تا بتوانند از این ابزار به طور مؤثر استفاده کنند.»

سطح نهایی، افزایش قابلیتهای نظارتی از طریق فناوری است، زیرا اگر هوش مصنوعی ابزاری برای تسهیل تقلب باشد، میتواند به ابزاری برای جلوگیری از تقلب نیز تبدیل شود. آزمایش آزمایشی سیستمهای نظارتی هوشمند در محلهای امتحان مورد نیاز است، مانند دوربینهای هوش مصنوعی که میتوانند رفتار غیرمعمول داوطلبان را در طول امتحان تشخیص دهند. به گفته استاد های، این یک کاربرد بسیار رایج در زمینه بینایی کامپیوتر با استفاده از هوش مصنوعی است.

در همین راستا، دانشآموز دبیرستانی مذکور در شهر هوشی مین که امسال وارد کلاس دوازدهم میشود، معتقد است که گسترش هوش مصنوعی لزوماً بر عدالت و درستی آزمون فارغالتحصیلی دبیرستان تأثیر نمیگذارد. در طول فرآیند بررسی، بسیاری از معلمان به دانشآموزان تمرینهای «ضد هوش مصنوعی» دادهاند - سؤالاتی که خود معلمان طراحی میکنند یا از منابع غیرقابل اعتمادی میگیرند که نه در اینترنت موجود است و نه برای هوش مصنوعی آسان است که آنها را حل کند. به گفته این دانشآموز، استفاده از این سؤالات در امتحان، استفاده از هوش مصنوعی را بیفایده میکند.

جهان با کلاهبرداری مبتنی بر هوش مصنوعی دست و پنجه نرم میکند.

ویتنام تنها نیست؛ کشورهای توسعهیافته نیز در مواجهه با هوش مصنوعی با مشکلات قابل توجهی روبرو هستند.

یک نظرسنجی توسط گاردین که در ماه ژوئن منتشر شد، نشان داد که نزدیک به ۷۰۰۰ دانشجوی دانشگاه در بریتانیا در طول سال تحصیلی ۲۰۲۳-۲۰۲۴ با استفاده از هوش مصنوعی، مانند ChatGPT، تقلب کردهاند. این بدان معناست که به ازای هر ۱۰۰۰ دانشجو در بریتانیا، ۵.۱ مورد تقلب مبتنی بر هوش مصنوعی وجود داشته است که افزایش قابل توجهی نسبت به رقم ۱.۶ در هر ۱۰۰۰ نفر در سال تحصیلی ۲۰۲۲-۲۰۲۳ نشان میدهد.

در سنگاپور، اگرچه مواردی از سرقت ادبی یا ارائه آثار تولید شده توسط ابزارهای هوش مصنوعی توسط دانشجویان مشاهده شده است، دانشگاهها این تعداد را کم و پدیدهای گسترده نمیدانند.

در همین حال، تحقیقات Nikkei Asia نشان داد که بسیاری از مقالات تحقیقاتی از ۱۴ دانشگاه در کشورهایی مانند ژاپن، کره جنوبی، چین و ایالات متحده حاوی دستورالعملهای پنهانی بودند، به طوری که اگر از نظرات تولید شده توسط هوش مصنوعی استفاده میشد، داوران فقط بازخورد مثبت دریافت میکردند. این دستورالعملهای پنهان اغلب با رنگ سفید برجسته میشدند یا بسیار کوچک ساخته میشدند تا با چشم غیرمسلح قابل مشاهده نباشند.

منبع: https://thanhnien.vn/chong-gian-lan-bang-ai-trong-thi-cu-185250710195249068.htm

![[عکس] دبیرکل و رئیس جمهور، تو لام، از دیوید زاپولسکی، معاون ارشد رئیس آمازون، استقبال میکند](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/22/1779466547770_a1-bnd-3513-6601-jpg.webp)

نظر (0)