در ماههای اخیر، کارشناسان و محققان ایمنی کودکان هشدار دادهاند که هوش مصنوعی خلاقانه میتواند سوءاستفاده آنلاین را تشدید کند.

مارک زاکربرگ، مدیرعامل متا، در جلسه استماع کمیته قضایی سنای ایالات متحده در تاریخ ۳۱ ژانویه ۲۰۲۴، در مقابل جمعیتی از شرکتکنندگان که تصاویر تولید شده توسط هوش مصنوعی را حمل میکردند، سخنرانی میکند. عکس: رویترز

NCMEC هنوز تعداد کل گزارشهای مربوط به محتوای کودکآزاری را از تمام منابعی که در سال ۲۰۲۳ دریافت کرده است، منتشر نکرده است. اما در سال ۲۰۲۲، گزارشهایی در حدود ۸۸.۳ میلیون پرونده در مورد این مشکل دریافت کرد.

جان شهان، معاون رئیس NCMEC، گفت: «ما گزارشهایی را از خود شرکتهای نوآور هوش مصنوعی، پلتفرمهای (آنلاین) و عموم مردم دریافت میکنیم.»

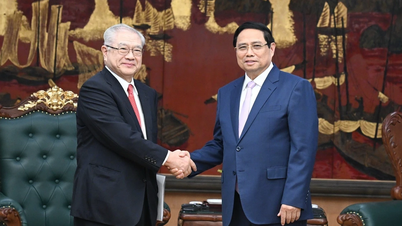

مدیران عامل شرکتهای متا، ایکس، تیک تاک، اسنپ و دیسکورد روز چهارشنبه (۳۱ ژانویه) در جلسه استماع سنای ایالات متحده در مورد ایمنی کودکان در پلتفرمهای آنلاین شهادت دادند. قانونگذاران آمریکایی از شرکتهای رسانههای اجتماعی در مورد تلاشهایشان برای محافظت از کودکان در برابر «شکارچیان آنلاین» سوال کردند.

محققان رصدخانه اینترنتی استنفورد در گزارشی که در ژوئن گذشته منتشر شد، گفتند که هوش مصنوعی مولد میتواند توسط افراد شرور برای آسیب رساندن مکرر به کودکان واقعی با ایجاد تصاویر جعلی از آنها مورد استفاده قرار گیرد.

فالون مکنالتی، مدیر CyberTipline در NCMEC، که گزارشهای مربوط به سوءاستفاده آنلاین از کودکان را دریافت میکند، گفت محتوای تولید شده توسط هوش مصنوعی «بیش از پیش واقعگرایانهتر» میشود و تشخیص اینکه آیا قربانیان افراد واقعی هستند یا خیر را دشوار میکند.

مکنالتی گفت OpenAI، شرکتی که ChatGPT را ایجاد کرده است، فرآیندی را برای ارسال گزارشها به NCMEC راهاندازی کرده است و این سازمان در حال مذاکره با سایر شرکتهای هوش مصنوعی است.

هوانگ های (به نقل از رویترز، فایننشال تایمز)

منبع

![[عکس] نمایشگاه پاییزی ۲۰۲۵ و رکوردهای چشمگیر](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762180761230_ndo_br_tk-hcmt-15-jpg.webp)

![[عکس] نخست وزیر فام مین چین، رئیس انجمن دوستی ژاپن و ویتنام را در منطقه کانسای به حضور پذیرفت.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762176259003_ndo_br_dsc-9224-jpg.webp)

![[عکس] دبیرکل تو لام از جایا راتنام، سفیر سنگاپور، استقبال میکند](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762171461424_a1-bnd-5309-9100-jpg.webp)

![[عکس] لام دونگ: نمای نزدیک از دریاچه غیرقانونی با دیوار شکسته](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762166057849_a5018a8dcbd5478b1ec4-jpg.webp)

نظر (0)