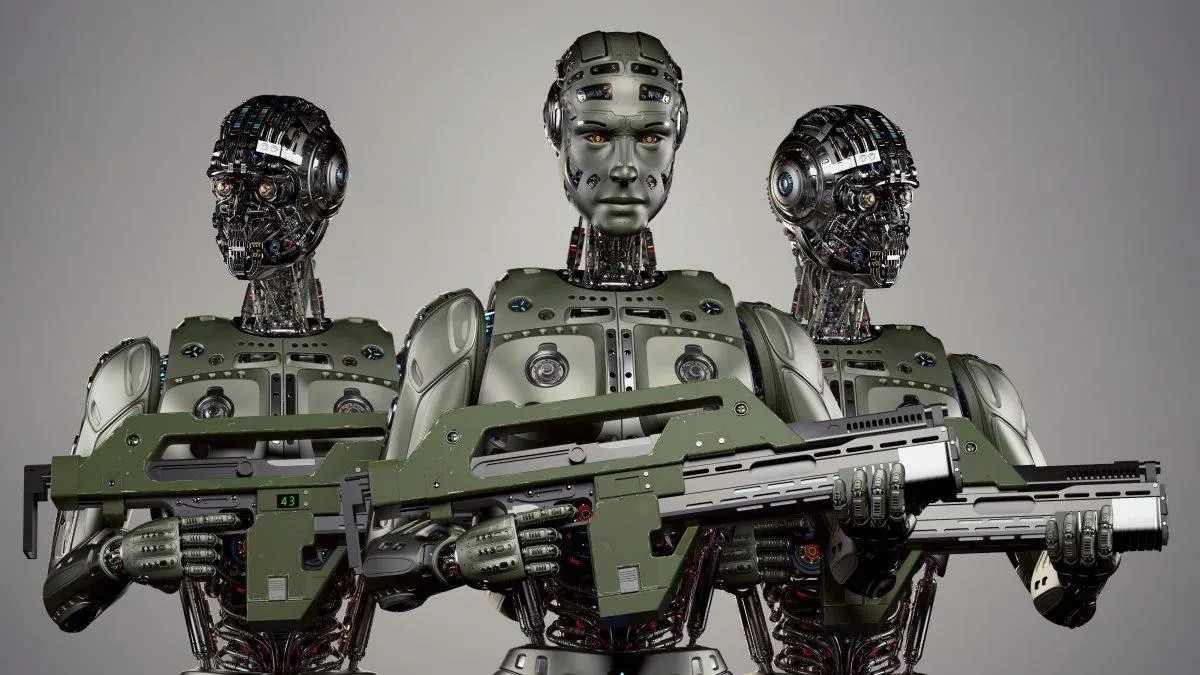

A mesterséges intelligencia által fejlesztett gyilkos robotok használatának összetett képe.

Ha a mesterséges intelligencia képessé tesz fegyverrendszerek irányítását, az azt jelentheti, hogy a célpontokat emberi beavatkozás nélkül azonosítják, megtámadják és megsemmisítik. Ez komoly jogi és etikai kérdéseket vet fel.

A helyzet súlyosságát hangsúlyozva Alexander Schallenberg osztrák külügyminiszter kijelentette: „Ez a mi generációnk Oppenheimer-pillanata.”

A mesterséges intelligenciával működő robotok és fegyverek széles körben elterjedtek számos ország hadseregében. Fotó: Forbes

Valóban, az, hogy a „dzsinn milyen mértékben szabadult ki az üvegből”, sürgető kérdéssé vált, tekintettel a drónok és a mesterséges intelligencia (MI) széles körű használatára a hadseregek világszerte .

Wilson Jones, a GlobalData védelmi elemzője megosztotta: „Az orosz és ukrán drónok használata modern konfliktusokban, az amerikai drónok használata célzott csapásmérő műveletekben Afganisztánban és Pakisztánban, valamint – ahogy azt a múlt hónapban nyilvánosságra hozták – Izrael Lavender programjának részeként történő alkalmazása jól mutatja, hogy a mesterséges intelligencia információfeldolgozási képességeit a világ hadseregei aktívan használják támadó erejük fokozására.”

A londoni székhelyű Hadügyminisztérium (Office of War Investigations) vizsgálata kimutatta, hogy az izraeli hadsereg Lavender mesterséges intelligencia rendszere 90%-os pontossággal azonosította a Hamászhoz köthető személyeket, ami azt jelenti, hogy 10% nem. Ez civil áldozatokat eredményezett a mesterséges intelligencia azonosítási és döntéshozatali képességei miatt.

Veszély a globális biztonságra.

A mesterséges intelligencia ilyen módon történő használata rávilágít a technológiamenedzsment szükségességére a fegyverrendszerekben.

Dr. Alexander Blanchard, a Stockholmi Nemzetközi Békekutató Intézet (SIPRI) Mesterséges Intelligencia Irányítás programjának vezető kutatója, amely egy független, globális biztonsággal foglalkozó kutatócsoport, a következőket magyarázta az Army Technologynak: „A mesterséges intelligencia fegyverrendszerekben való használata, különösen a célzás során, alapvető kérdéseket vet fel azzal kapcsolatban, hogy kik vagyunk – emberek –, és a háborúhoz fűződő kapcsolatunkkal, konkrétabban pedig azzal, hogy milyen feltételezéseink vannak arról, hogyan alkalmazhatunk erőszakot fegyveres konfliktusokban.”

Kaotikus környezetben használva a mesterséges intelligencia rendszerek kiszámíthatatlanul működhetnek, és előfordulhat, hogy nem azonosítják pontosan a célpontokat. (Kép: MES)

„Vajon a mesterséges intelligencia megváltoztatja-e a katonaságok célpontválasztásának és ellenük való erőszak alkalmazásának módját? Ezek a változások viszont számos jogi, etikai és operatív kérdést vetnek fel. A legnagyobb aggodalom humanitárius jellegű” – tette hozzá Dr. Blanchard.

A SIPRI szakértője kifejtette: „Sokan aggódnak amiatt, hogy az automatizált rendszerek tervezésétől és használatától függően azok nagyobb veszélynek tehetik ki a civileket és a nemzetközi jog által védett másokat. Ez azért van, mert a mesterséges intelligencia rendszerei, különösen kaotikus környezetben használva, kiszámíthatatlanul működhetnek, és előfordulhat, hogy nem tudják pontosan azonosítani a célpontokat és megtámadni a civileket, vagy nem tudják azonosítani azokat a harcosokat, akik kívül esnek a tűzvonalon.”

A GlobalData védelmi elemzője, Wilson Jones a kérdéssel kapcsolatban megjegyzi, hogy a bűnösség meghatározásának kérdése megkérdőjeleződhet.

„A jelenlegi háborús törvények értelmében létezik a parancsnoki felelősség fogalma” – mondta Jones. „Ez azt jelenti, hogy egy tiszt, tábornok vagy más vezető jogilag felelős a parancsnoksága alatt álló csapatok tetteiért. Ha a csapatok háborús bűncselekményeket követnek el, a tisztet akkor is felelősségre vonják, ha nem ő adta ki a parancsot; a bizonyítási teher rajta van, bizonyítva, hogy mindent megtett a háborús bűncselekmények megelőzése érdekében.”

„A mesterséges intelligenciarendszereknél ez bonyolítja a dolgokat. Egy informatikus a felelős? Egy rendszertervező? Nem világos. Ha nem világos, akkor erkölcsi kockázatot jelent, ha a szereplők azt hiszik, hogy cselekedeteiket nem védik a hatályos törvények” – hangsúlyozta Jones.

Egy amerikai katona robotkutyával járőrözik. Fotó: Forbes

Fegyverzet-ellenőrzési egyezmények: Számos jelentős nemzetközi megállapodás korlátozza és szabályozza a fegyverek bizonyos felhasználási módjait. Ezek közé tartozik a vegyi fegyverek tilalma, a nukleáris fegyverek elterjedésének megakadályozásáról szóló szerződések és az egyes hagyományos fegyverekről szóló egyezmény, amelyek tiltják vagy korlátozzák az olyan fegyverek használatát, amelyekről úgy ítélik meg, hogy szükségtelen vagy indokolatlan szenvedést okoznak a harcosoknak, vagy válogatás nélkül érintik a civileket.

„A nukleáris fegyverzetek ellenőrzéséhez évtizedekig tartó nemzetközi együttműködésre és az azt követő szerződésekre van szükség ahhoz, hogy végrehajthatóak legyenek” – magyarázza Wilson Jones védelmi elemző. „Még akkor is folytattuk a légköri tesztelést az 1990-es évekig. A nukleáris fegyverek elterjedésének megakadályozásának sikerének egyik fő oka az Egyesült Államok és a Szovjetunió közötti együttműködés volt a bipoláris világrendben. Ez már nem létezik, és a mesterséges intelligencia technológiája több ország számára is elérhetőbbé vált, mint az atomenergia.”

„Egy kötelező érvényű szerződésnek minden érintett felet egy asztalhoz kellene ültetnie, hogy megállapodjanak abban, hogy nem használnak olyan eszközt, amely növeli katonai erejüket. Ez valószínűleg nem lesz hatékony, mivel a mesterséges intelligencia minimális pénzügyi és anyagi költséggel javíthatja a katonai hatékonyságot.”

Jelenlegi geopolitikai perspektíva

Bár az ENSZ országai elismerték a mesterséges intelligencia felelősségteljes katonai használatának szükségességét, még sok munka van hátra.

Laura Petrone, a GlobalData vezető elemzője az Army Technology-nak elmondta: „A világos irányítási keret hiánya miatt ezek a kijelentések nagyrészt ambiciózusak. Nem meglepő, hogy egyes országok meg akarják őrizni saját szuverenitásukat a belföldi védelmi és nemzetbiztonsági kérdésekben, különösen a jelenlegi geopolitikai feszültségek kontextusában.”

Petrone asszony hozzátette, hogy bár az EU mesterséges intelligencia törvénye bizonyos követelményeket határoz meg a mesterséges intelligenciarendszerekkel szemben, nem foglalkozik a katonai célú mesterséges intelligenciarendszerekkel.

„Úgy gondolom, hogy e kizárás ellenére a mesterséges intelligencia törvénye fontos erőfeszítés egy régóta esedékes keretrendszer létrehozása érdekében a mesterséges intelligencia alkalmazásai számára, ami a jövőben a vonatkozó szabványok bizonyos fokú harmonizációjához vezethet” – jegyezte meg. „Ez a harmonizáció a katonai MI számára is kulcsfontosságú lesz.”

Nguyễn Khánh

[hirdetés_2]

Forrás: https://www.congluan.vn/moi-nguy-robot-sat-thu-ai-dang-de-doa-an-ninh-toan-cau-post304170.html

![[Kép] A hanoi rendőrség hivatalosan is megkoronázta a 2025/2026-os V-League bajnokát](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/31/1780244769054_ndo_br_039d561b692be875b13a-jpg.webp)

![[Fotó] A főtitkár, az elnök és felesége megkezdik állami látogatásukat a Fülöp-szigeteken.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/31/1780230559452_anh-man-hinh-2026-05-31-luc-19-28-11.png)

![[Fotó] Csodálja meg a korall "remekművet" Dak Lak tartomány millió éves örökségében.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/31/1780221235105_anh-man-hinh-2026-05-31-luc-16-53-27.png)

![[Fotó] Ünnepélyes fürdőszertartás és Buddha-körmenet Huếban](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/31/1780228263543_1-jpg.webp)

![[Videó] Naplemente a Lap An lagúnánál – Ahol a nap lenyugszik a halászhálók felett](https://vphoto.vietnam.vn/thumb/340x192/vietnam/resource/IMAGE/2026/05/31/1780192137701_beach-landscape-sea-water-nature-grass-745871-pxhere-com.jpeg)

![[Fotó] Csodálja meg a korall "remekművet" Dak Lak tartomány millió éves örökségében.](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2026/05/31/1780221235105_anh-man-hinh-2026-05-31-luc-16-53-27.png)

Hozzászólás (0)