これは、ChatGPT、Google Bard、Bing AIといったツールの使用に関する規制を政府が導入する初の試みです。DTAのディレクターであるクリス・フェヒナー氏によると、これらの技術は急速に進化しており、政府当局が使用リスクを評価する中で、ガイダンスの必要性が高まっています。

DTAの規制は、「 テクノロジーの安全かつ責任ある利用を支援する」、「危害を最小限に抑える」、「すべてのオーストラリア国民にとってより安全で、より信頼性が高く、より公平な結果を達成する」ことを目指しています。また、「AIアプリケーションの影響を受ける人々への悪影響のリスクを軽減する」こと、「AIの利用において最高の倫理基準を実現する」ことも目指しています。最後に、透明性を確保することで、「政府による新技術の利用に対する信頼」を構築します。

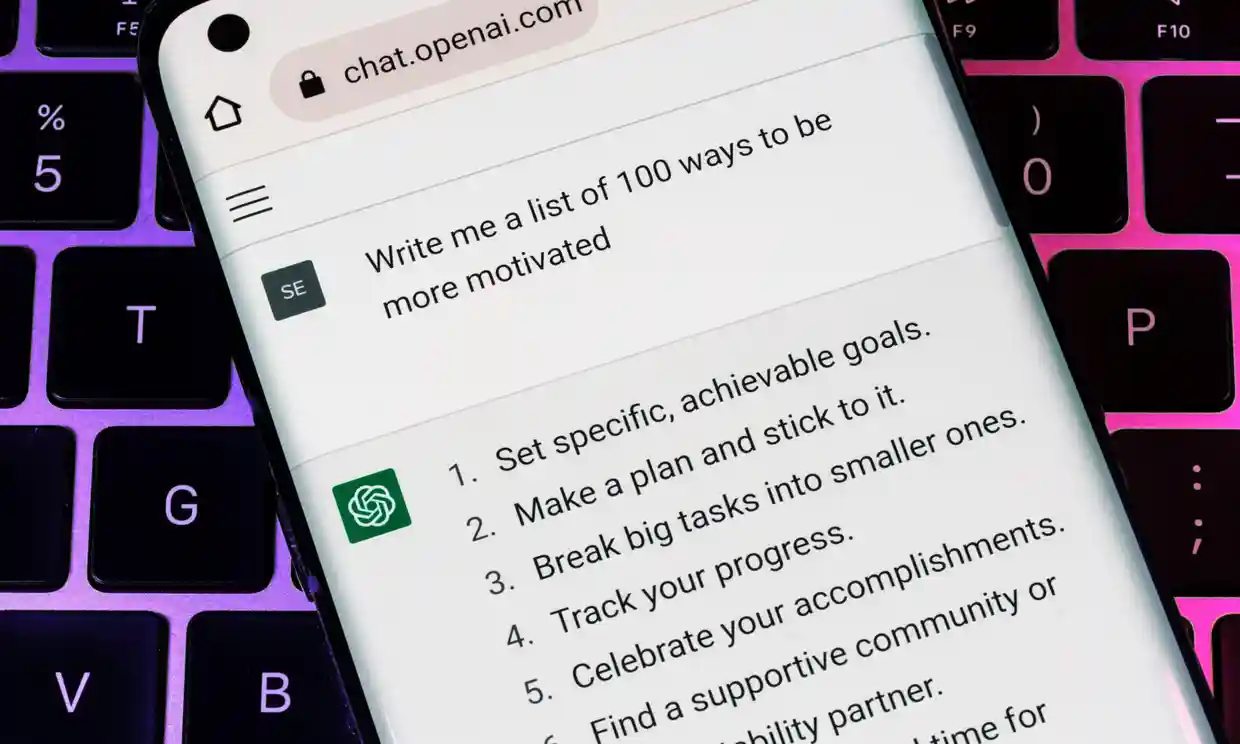

公共サービスの責任者は、職員に生成AIツールの使用を許可し、その活動を公式記録に記録することが推奨されています。このガイダンスでは、AIの実際の活用例として、プロジェクトの進捗状況の確認、プレゼンテーションスライドの作成におけるAIの利用、入札書類の技術基準の検証におけるAIの利用の3つを挙げています。いずれの場合も、DTAは、プロジェクトの詳細や機密情報を公開AIプラットフォームに入力しないなどのガイドラインを示しています。

逆に、許容できないリスクシナリオには、「大量の政府データ」、「極秘の機密文書」、「政府システムで使用される暗号化された出力」を伴うタスクが含まれます。

DTAは、従業員にAIの不正使用を電子メールで報告するよう義務付けるよう政府機関に要請している。

オーストラリアは、政府職員が生成AIツールを利用する際のガイドラインを策定している唯一の国ではありません。英国内閣府は先月、生成AIの利用に関する正式なガイダンスを発行し、潜在的な用途を検討し、必要な制限を定めました。具体的には、政策変更に関連する文書の起草にこの技術を使用することを禁止しています。

グローバル・ガバメント・フォーラムの調査によると、公務員は業務にAIを活用しています。カナダの公務員の10%以上が、ChatGPTのようなAIツールを使用していると認めています。

(グローバル・ガバメント・フォーラムによると)

[広告2]

ソース

コメント (0)