តើរូបភាព AI ក្លែងក្លាយដំណើរការយ៉ាងដូចម្តេច?

សព្វថ្ងៃនេះ AI មាននៅគ្រប់ទីកន្លែង សូម្បីតែនៅក្នុងសង្គ្រាមក៏ដោយ។ កម្មវិធីបញ្ញាសិប្បនិមិត្តបានប្រសើរឡើងច្រើននៅឆ្នាំនេះ ដែលស្ទើរតែគ្រប់គ្នាអាចប្រើម៉ាស៊ីន AI ដើម្បីបង្កើតរូបភាពដែលមើលទៅដូចពិត យ៉ាងហោចណាស់នៅក្រឡេកមើលដំបូង។

រូបថតក្លែងក្លាយដែលបង្កើតដោយ AI នៃសង្រ្គាមនៅហ្គាហ្សា។

អ្នកប្រើប្រាស់គ្រាន់តែផ្តល់ឧបករណ៍ដូចជា Midjourney ឬ Dall-E ជាមួយនឹងការជម្រុញមួយចំនួន រួមទាំងព័ត៌មានលម្អិត និងព័ត៌មាន ដើម្បីធ្វើកិច្ចការនេះ។ ឧបករណ៍ AI បន្ទាប់មកបំប្លែងអត្ថបទឬសូម្បីតែសំឡេងក៏ប្រាប់ទៅជារូបភាព។

ដំណើរការបង្កើតរូបភាពនេះគឺផ្អែកលើអ្វីដែលគេស្គាល់ថាជា machine learning។ ជាឧទាហរណ៍ ប្រសិនបើអ្នកបង្កើតស្នើឱ្យបង្ហាញបុរសអាយុ 70 ឆ្នាំដែលកំពុងជិះកង់ ពួកគេនឹងស្វែងរកមូលដ្ឋានទិន្នន័យរបស់ពួកគេដើម្បីផ្គូផ្គងពាក្យទៅនឹងរូបភាព។

ដោយផ្អែកលើព័ត៌មានដែលមាន ក្បួនដោះស្រាយ AI នឹងបង្កើតរូបភាពរបស់អ្នកជិះកង់វ័យចំណាស់។ ជាមួយនឹងការបញ្ចូល និងបច្ចុប្បន្នភាពបច្ចេកទេសកាន់តែច្រើនឡើង ឧបករណ៍ទាំងនេះបានប្រសើរឡើងយ៉ាងខ្លាំង ហើយកំពុងសិក្សាឥតឈប់ឈរ។

ទាំងអស់នេះកំពុងត្រូវបានអនុវត្តចំពោះរូបភាពទាក់ទងនឹងជម្លោះមជ្ឈិមបូព៌ា។ អ្នកជំនាញផ្នែក AI លោក Hany Farid មានប្រសាសន៍ថា នៅក្នុងជម្លោះមួយដែល "អារម្មណ៍ខ្ពស់ខ្លាំង" ព័ត៌មានមិនពិត រួមទាំងការផ្សព្វផ្សាយតាមរយៈរូបភាព AI មានឥទ្ធិពលយ៉ាងខ្លាំង។

Farid សាស្ត្រាចារ្យផ្នែកវិភាគឌីជីថលនៅសាកលវិទ្យាល័យកាលីហ្វ័រញ៉ានៅ Berkeley បាននិយាយថាការប្រយុទ្ធដ៏សាហាវគឺជាកន្លែងបង្កាត់ពូជដ៏ល្អឥតខ្ចោះសម្រាប់ការបង្កើត និងផ្សព្វផ្សាយខ្លឹមសារក្លែងក្លាយ ក៏ដូចជាការជំរុញអារម្មណ៍។

ប្រភេទនៃរូបភាព AI នៃសង្រ្គាមអ៊ីស្រាអែល-ហាម៉ាស

រូបភាព និង វីដេអូ ដែលបង្កើតដោយជំនួយពីបញ្ញាសិប្បនិមិត្តបានបញ្ឆេះព័ត៌មានមិនពិតទាក់ទងនឹងសង្រ្គាមនៅអ៊ុយក្រែន ហើយរឿងនោះនៅតែបន្តកើតមាននៅក្នុងសង្រ្គាមអ៊ីស្រាអែល-ហាម៉ាស។

យោងតាមអ្នកជំនាញ រូបភាព AI ដែលផ្សព្វផ្សាយនៅលើប្រព័ន្ធផ្សព្វផ្សាយសង្គមអំពីសង្គ្រាម ជារឿយៗធ្លាក់ជាពីរប្រភេទ។ មួយផ្តោតលើការរងទុក្ខរបស់មនុស្ស និងបង្កើតការអាណិតអាសូរ។ មួយទៀតគឺ AI ក្លែងក្លាយដែលបំផ្លើសព្រឹត្តិការណ៍ ដោយហេតុនេះញុះញង់ឱ្យមានជម្លោះ និងបង្កើនអំពើហិង្សា។

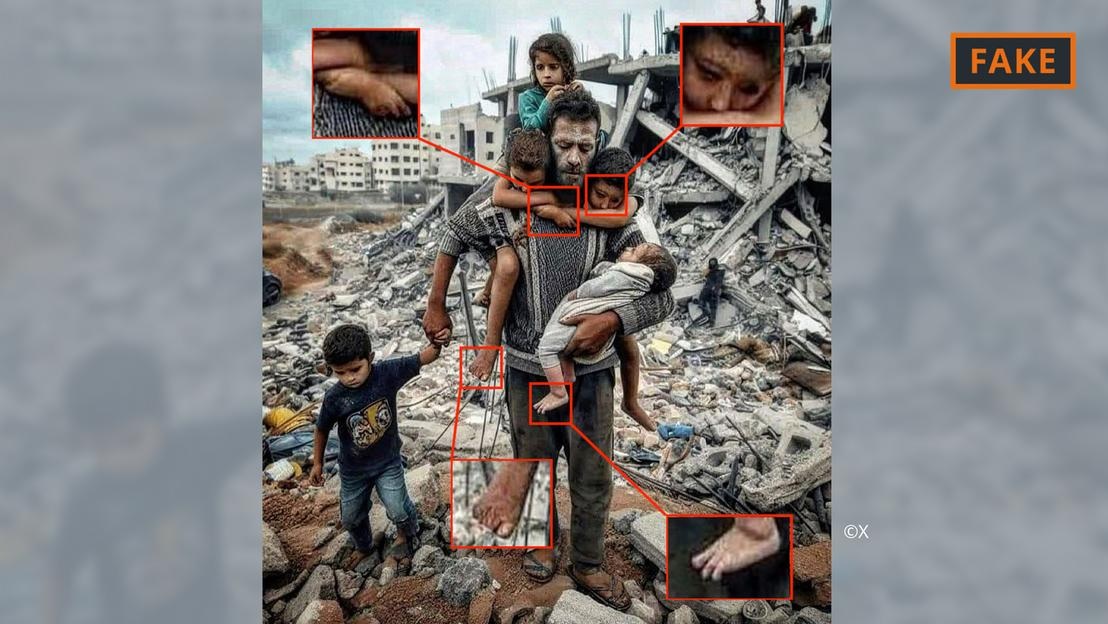

រូបថតក្លែងក្លាយដែលបង្កើតដោយ AI របស់ឪពុក និងកូននៅក្នុងគំនរបាក់បែកនៅហ្គាហ្សា។

ជាឧទាហរណ៍ ប្រភេទទីមួយរួមមានរូបថតខាងលើរបស់ឪពុក និងកូនប្រាំនាក់របស់គាត់នៅពីមុខគំនរបាក់បែក។ វាត្រូវបានចែករំលែកច្រើនដងនៅលើ X (អតីត Twitter) និង Instagram ហើយបានមើលរាប់រយរាប់ពាន់ដង។

រូបភាពនេះត្រូវបានសម្គាល់ដោយសហគមន៍ យ៉ាងហោចណាស់នៅលើ X ថាជារូបភាពក្លែងក្លាយ។ វាអាចត្រូវបានទទួលស្គាល់ដោយកំហុសនិងភាពមិនស៊ីសង្វាក់គ្នាជាទូទៅចំពោះរូបភាព AI (មើលរូបភាពខាងលើ)។

ភាពមិនប្រក្រតីស្រដៀងគ្នានេះក៏អាចត្រូវបានគេមើលឃើញនៅក្នុងរូបភាព AI ក្លែងក្លាយដែលបានរីករាលដាលនៅលើ X ខាងក្រោម ដែលបង្ហាញថាគ្រួសារប៉ាឡេស្ទីនកំពុងញ៉ាំអាហារជាមួយគ្នានៅលើប្រាសាទ។

រូបថតក្លែងក្លាយដែលបង្កើតដោយ AI នៃគណបក្សប៉ាឡេស្ទីន។

ទន្ទឹមនឹងនេះ រូបភាពមួយទៀតដែលបង្ហាញពីកងទ័ពកំពុងគ្រវីទង់ជាតិអ៊ីស្រាអែល នៅពេលពួកគេឆ្លងកាត់ការតាំងទីលំនៅដែលពោរពេញទៅដោយផ្ទះដែលត្រូវបានទម្លាក់គ្រាប់បែក ធ្លាក់ចូលទៅក្នុងប្រភេទទីពីរ ដែលត្រូវបានរចនាឡើងដើម្បីបញ្ឆេះការស្អប់ខ្ពើម និងអំពើហិង្សា។

តើរូបភាព AI បែបនេះមកពីណា?

រូបភាពនៃជម្លោះដែលបង្កើតដោយ AI ភាគច្រើនត្រូវបានបង្ហោះនៅលើវេទិកាប្រព័ន្ធផ្សព្វផ្សាយសង្គម ប៉ុន្តែពួកវាក៏មាននៅលើវេទិកា និងស្ថាប័នមួយចំនួនផ្សេងទៀត និងសូម្បីតែនៅលើគេហទំព័រព័ត៌មានមួយចំនួនផងដែរ។

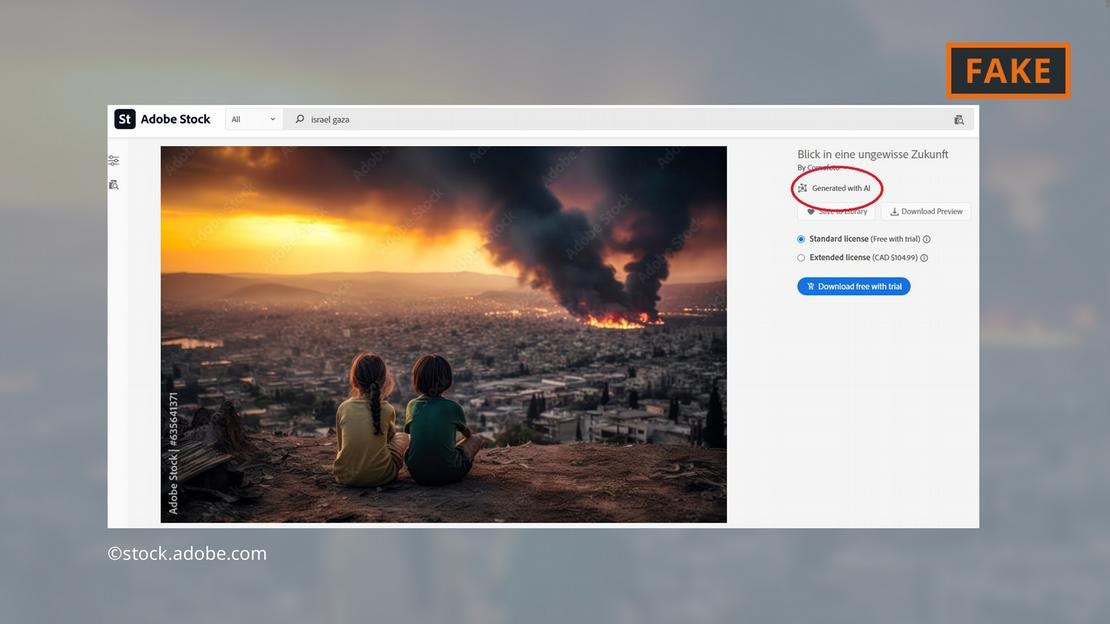

ក្រុមហ៊ុនកម្មវិធី Adobe បានបង្កើតចំណងជើងដោយបន្ថែមរូបភាពដែលបង្កើតដោយ AI ទៅក្នុងជួររូបថតស្តុករបស់ខ្លួននៅចុងឆ្នាំ 2022។ ពួកវានឹងត្រូវបានដាក់ស្លាកស្របតាមមូលដ្ឋានទិន្នន័យ។

ឥឡូវនេះ Adobe ក៏កំពុងផ្តល់ជូននូវរូបភាព AI នៃសង្រ្គាមនៅមជ្ឈិមបូព៌ាសម្រាប់លក់ផងដែរ ដូចជាការផ្ទុះ មនុស្សតវ៉ា ឬផ្សែងហុយផ្សែងនៅខាងក្រោយវិហារ Al-Aqsa ជាដើម។

Adobe កំពុងផ្តល់ជូននូវរូបភាពដែលបង្កើតដោយ AI នៃការប្រយុទ្ធគ្នានៅហ្គាហ្សា។

អ្នករិះគន់បានរកឃើញបញ្ហានេះ ដោយសារតែគេហទំព័រមួយចំនួនបានបន្តប្រើប្រាស់រូបភាពដោយមិនដាក់ស្លាកថាជារូបភាពដែលបង្កើតដោយ AI។ ជាឧទាហរណ៍ រូបភាពដែលចោទសួរបានលេចឡើងនៅលើទំព័រ "Newsbreak" ដោយគ្មានសញ្ញាណាមួយថាវាត្រូវបានបង្កើតដោយ AI ។

សូម្បីតែសេវាកម្មស្រាវជ្រាវសភាអ៊ឺរ៉ុប ដែលជាដៃ វិទ្យាសាស្ត្រ របស់សភាអឺរ៉ុប បានបង្ហាញអត្ថបទលើអ៊ីនធឺណិតអំពីជម្លោះមជ្ឈិមបូព៌ាជាមួយនឹងរូបភាព AI ពីមូលដ្ឋានទិន្នន័យ Adobe ដោយមិនដាក់ស្លាកថាវាជា AI បង្កើត។

ក្រុមសង្កេតការណ៍ប្រព័ន្ធផ្សព្វផ្សាយឌីជីថលអឺរ៉ុបកំពុងជំរុញឱ្យអ្នកសារព័ត៌មាន និងអ្នកជំនាញប្រព័ន្ធផ្សព្វផ្សាយមានការប្រុងប្រយ័ត្នខ្ពស់នៅពេលប្រើប្រាស់រូបភាព AI ដោយណែនាំប្រឆាំងនឹងការប្រើប្រាស់របស់ពួកគេ ជាពិសេសនៅពេលគ្របដណ្តប់ព្រឹត្តិការណ៍ក្នុងជីវិតពិត ដូចជាសង្រ្គាមនៅហ្គាហ្សាជាដើម។

តើរូបភាព AI មានគ្រោះថ្នាក់ប៉ុណ្ណា?

ខ្លឹមសារ និងរូបភាព AI មេរោគត្រូវបានចងភ្ជាប់នឹងធ្វើឱ្យអ្នកប្រើប្រាស់មានអារម្មណ៍មិនសប្បាយចិត្តចំពោះអ្វីគ្រប់យ៉ាងដែលពួកគេជួបប្រទះនៅលើអ៊ីនធឺណិត។ អ្នកស្រាវជ្រាវ UC Berkeley Farid ពន្យល់ថា "ប្រសិនបើយើងចូលទៅក្នុងពិភពលោកនេះ ដែលជាកន្លែងដែលរូបភាព អូឌីយ៉ូ និងវីដេអូ អាចត្រូវបានរៀបចំ អ្វី គ្រប់យ៉ាងនឹងក្លាយទៅជាការសង្ស័យ" ។ “ដូច្នេះអ្នកបាត់បង់ការទុកចិត្តលើអ្វីគ្រប់យ៉ាង រួមទាំងការពិតផងដែរ”។

នោះហើយជាអ្វីដែលបានកើតឡើងនៅក្នុងករណីដូចខាងក្រោម៖ រូបភាពនៃអ្វីដែលត្រូវបានគេជឿថាជាសាកសពទារកជនជាតិអ៊ីស្រាអែលត្រូវបានចែករំលែកនៅលើប្រព័ន្ធផ្សព្វផ្សាយសង្គមដោយនាយករដ្ឋមន្ត្រីអ៊ីស្រាអែល Benjamin Netanyahu និងអ្នកនយោបាយមួយចំនួនទៀត។

Jackson Hinkle ដែលជាអ្នកមានឥទ្ធិពលប្រឆាំងនឹងអ៊ីស្រាអែល ក្រោយមកបានអះអាងថា រូបភាពនេះត្រូវបានបង្កើតឡើងដោយប្រើបញ្ញាសិប្បនិម្មិត។ សេចក្តីថ្លែងការណ៍របស់ Hinkle ត្រូវបានគេមើលច្រើនជាង 20 លានដងនៅលើប្រព័ន្ធផ្សព្វផ្សាយសង្គម ហើយនាំឱ្យមានការជជែកគ្នាយ៉ាងក្តៅគគុកនៅលើវេទិកា។

នៅទីបំផុត អង្គការ និងឧបករណ៍ផ្ទៀងផ្ទាត់ជាច្រើនបានប្រកាសថារូបភាពនោះពិត ហើយការអះអាងរបស់ Hinkle គឺមិនពិត។ ទោះជាយ៉ាងណាក៏ដោយ វាច្បាស់ណាស់ថាគ្មានឧបករណ៍ណាអាចជួយអ្នកប្រើប្រាស់ឱ្យទទួលបានទំនុកចិត្តដែលបាត់បង់របស់ពួកគេឡើងវិញបានយ៉ាងងាយស្រួលនោះទេ!

Hoang Hai (យោងតាម DW)

ប្រភព

![[រូបថត] អគ្គលេខាធិកា To Lam លេខាគណៈកម្មាធិការយោធាមជ្ឈិមចូលរួមមហាសន្និបាតបក្សលើកទី ១២ នៃកងទ័ព](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/30/9b63aaa37ddb472ead84e3870a8ae825)

![[រូបថត] ប្រធានរដ្ឋ Luong Cuong ទទួលជួបប្រធានរដ្ឋសភាគុយបា Esteban Lazo Hernandez](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/30/4d38932911c24f6ea1936252bd5427fa)

![[រូបថត] ការបើកមហាសន្និបាតបក្សយោធាលើកទី ១២ សម្រាប់អាណត្តិ ២០២៥-២០៣០](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/30/2cd383b3130d41a1a4b5ace0d5eb989d)

![[រូបថត] ទេសភាពនៃស្ពានស្នាក់នៅដោយខ្សែកាប ដែលជាឧបសគ្គចុងក្រោយនៃផ្លូវល្បឿនលឿន Ben Luc-Long Thanh](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/30/391fdf21025541d6b2f092e49a17243f)

![[រូបថត] មហាសន្និបាតលើកទី ១ របស់គណៈកម្មាធិការបក្សខេត្ត Phu Tho អាណត្តិ ២០២៥-២០៣០](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/30/1507da06216649bba8a1ce6251816820)

![[Infographic] ភារកិច្ចសំខាន់ៗក្នុងអាណត្តិ 2025-2030 របស់ខេត្ត Dong Nai](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/9/30/59bd43f4437a483099313af036fef0db)

Kommentar (0)