Mogelijke risico's bij het verspreiden van desinformatie

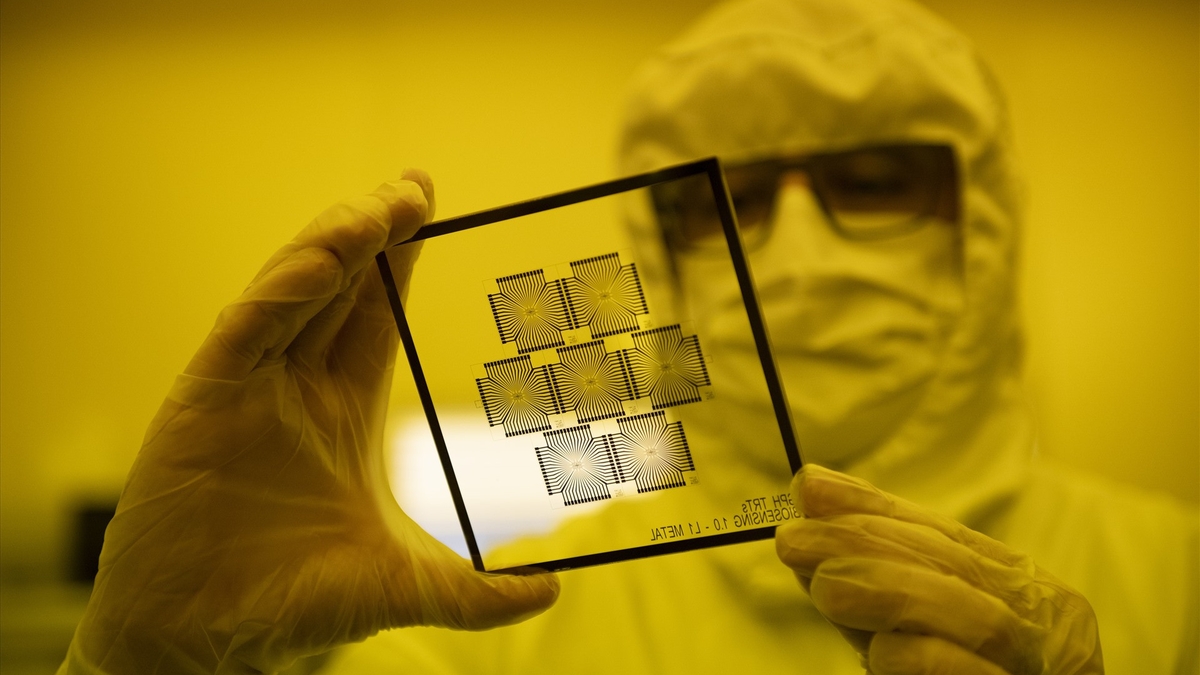

Wetenschap en technologie hebben niet alleen invloed op de manier waarop pers en media hun boodschappen overbrengen, maar beïnvloeden ook de manier en effectiviteit van de publieke toegang, en hebben ook een grote impact op de kwaliteit van informatie.

De journalistiek heeft zich de afgelopen jaren snel kunnen aanpassen aan technologische innovaties. Kunstmatige intelligentie (AI) is geleidelijk populair geworden in de massamedia en op redacties van persbureaus. De toepassing van AI heeft zowel journalisten als mediaorganisaties voordelen opgeleverd. Het bevrijdt journalisten van saaie dagelijkse taken, waardoor ze tijd besparen en zich kunnen richten op creatiever en hoogwaardiger werk.

Hoewel AI veel voordelen biedt, roept het ook enkele zorgen op. Een van de grootste risico's is de potentiële verspreiding van misinformatie door AI-gegenereerde content.

De tien grootste persbureaus ter wereld roepen op tot collectieve en transparante onderhandelingen tussen mediabedrijven en AI-ontwikkelaars om te bepalen welke auteursrechtelijk beschermde materialen mogen worden gebruikt bij het trainen van AI-tools. Ook willen ze vooroordelen in AI-algoritmen wegnemen.

Afgelopen week ondertekenden tien van 's werelds toonaangevende persbureaus een brief waarin ze opriepen tot transparantie en duidelijke auteursrechtwetgeving met betrekking tot AI. De persbureaus betoogden dat AI de potentie heeft om "de duurzaamheid van het media-ecosysteem te bedreigen" door het vertrouwen van lezers in de kwaliteit en integriteit van nieuws aanzienlijk te ondermijnen.

Volgens veel studies kan AI worden gebruikt om verhalen te filteren en te selecteren die lezers het meest waarschijnlijk zullen aantrekken en boeien. Hierdoor ontstaat een onevenwicht in het nieuws dat niet zou bestaan als verhalen op een objectieve manier, geproduceerd door mensen, zouden worden gepresenteerd. Het publiek wordt slechts aan één kant van het verhaal blootgesteld en kan zich daardoor laten leiden door eenzijdige informatie die door AI wordt gegenereerd. Bovendien kan AI worden gebruikt om desinformatie en nepnieuws onder het publiek te verspreiden door verzonnen verhalen naast echte verhalen te presenteren.

AI kan ook kwetsbaar zijn voor nepnieuws. AI-algoritmen zijn ontworpen om data snel en nauwkeurig te verwerken, waardoor het moeilijk is om onderscheid te maken tussen echt en nepnieuws. Bovendien is AI niet in staat om de emotionele en morele implicaties van het verwerkte nieuws te begrijpen. Naarmate AI geavanceerder wordt, zal de kwetsbaarheid voor nepnieuws toenemen, waardoor het nog moeilijker wordt om onderscheid te maken tussen echt en nepnieuws.

Volgens universitair hoofddocent dr. Nguyen Ngoc Oanh, hoofd van de faculteit Internationale Betrekkingen van de Academie voor Journalistiek en Communicatie, is het moment waarop AI krachtig wordt, ook het moment waarop we extra alert moeten zijn en proactief moeten optreden tegen het risico dat slechteriken en vijandige krachten AI gebruiken om schadelijk en nepnieuws te verspreiden. Vanuit het perspectief van mediaveiligheid toont dit het potentiële risico van misinformatie, verdraaiing en nepnieuws. Zodra kunstmatige intelligentie wordt toegepast in de informatietechnologie, kan technologie helpen bij het creëren van nepstemmen, -beelden, nepverhalen en -verklaringen die echt lijken om het publiek te misleiden, met name op sociale netwerken.

"Mensen met kwade bedoelingen misbruiken de rol en het prestige van de pers om informatie te vervalsen en het publiek te laten geloven dat het om informatie gaat die door de pers wordt verstrekt en weerspiegeld. De ontwikkeling van nepnieuws zal steeds geavanceerder en complexer worden. Daarom moeten methoden voor het identificeren, beantwoorden en aanpakken van nepnieuws, naast het vergroten van de waakzaamheid, gericht zijn op investeringen in slimme technologie en systematische aanpak. De capaciteit van sociaal management en persbureaus moet worden verbeterd om zich aan te passen aan veranderingen", aldus universitair hoofddocent dr. Nguyen Ngoc Oanh.

De nieuwsindustrie moet manieren vinden om haar creatieve content te beschermen.

Sinds de lancering van ChatGPT in november 2022 worden er bijna dagelijks nieuwe applicaties op basis van generatieve AI gelanceerd. Hierdoor is het internet gevuld met door AI gegenereerde content. Hoewel er soms verbluffende content tussen zit, is er ook veel saaie, repetitieve content. Dit maakt het verspreiden van misinformatie gemakkelijker en legt een grotere druk op de mediasector om vertrouwen onder lezers op te bouwen en te herstellen.

Journalist Nguyen Hoang Nhat, adjunct-hoofdredacteur van de krant Vietnamplus, herinnerde zich lessen uit het verleden, toen veel experts zeiden dat een van de eerste grote fouten van de pers was dat ze te traag reageerde op het belang en de invasie van sociale netwerken. "We hebben een lange periode achter de rug waarin we al onze content op sociale netwerken plaatsten en onze kernactiviteiten aanpasten om die te dienen, wat soms niet onze kracht is of wat lezers nodig hebben. Kortom, we hebben sociale netwerken te veel macht gegeven en ervoor gezorgd dat ze zich omdraaiden en ons opslokten", aldus journalist Nguyen Hoang Nhat.

Toen het Vietnamese vrouwenteam meedeed aan het WK, stonden de sociale media vol met bronnen die verdraaide en gefabriceerde informatie verspreidden. (Foto: VTC)

Kijkend naar de huidige dreiging van AI, zei journalist Nguyen Hoang Nhat dat AI redacties in het algemeen helpt hun werk sneller te doen en kosten te besparen, maar dat het redacteuren en verslaggevers wel soepeler zal maken en zal bijdragen aan een snellere verspreiding van valse informatie. "Zo ging tijdens het recente WK vrouwenvoetbal nepcontent over het Vietnamese vrouwenelftal enorm 'viraal' via memes die waren gemaakt met AI-tools, waardoor de algemene psychologie van een deel van het publiek tot het uiterste werd gedreven", gaf journalist Nguyen Hoang Nhat een voorbeeld.

In het buitenland rapporteerde News Guard een schokkende statistiek: 347 nieuwssites die eruitzien als legitieme nieuwssites, maar vol staan met door AI gegenereerde content en desinformatie promoten. Uit een recent onderzoek van het Massachusetts Institute of Technology (MIT) blijkt dat mensen eerder geneigd zijn om door AI gegenereerde desinformatie te geloven dan door mensen gegenereerd nepnieuws.

Volgens journalist Nguyen Hoang Nhat zorgt deze realiteit ervoor dat de nieuwsindustrie manieren moet vinden om haar creatieve content en intellectuele eigendom te beschermen. Tegelijkertijd kan ze de gemakken die AI met zich meebrengt niet negeren.

Universitair hoofddocent dr. Nguyen Ngoc Oanh beoordeelde de uitdagingen op het gebied van eerlijkheid in nieuws en zei dat Chat GPT, hoewel het veel uitstekende functies heeft, uiteindelijk slechts een hulpmiddel is dat journalisten moeten leren beheersen en gebruiken om hun werk te ondersteunen en werk en persproducten te creëren volgens de principes van het vak. Het verifiëren van de informatiebronnen van verslaggevers en journalisten is uiterst belangrijk als ze de verspreiding van onjuiste informatie niet willen "helpen".

Uit vele seminars en discussies over kunstmatige intelligentie is gebleken dat het risico op het gebruik van nepdata en nepnieuws in journalistiek werk zeer hoog is als het contentmanagement op de redactie de ontwikkeling van digitale technologie niet kan bijbenen. Aangezien de juridische gang van zaken voor digitale journalistiek in Vietnam nog niet is bijgehouden, vormen juridische problemen, bedreigingen voor de mediaveiligheid, gevallen van inbreuk op auteursrechten en controverses over journalistieke ethiek, de maatschappelijke verantwoordelijkheid van de pers bij de toepassing van geautomatiseerde journalistiek... vandaag de dag grote uitdagingen.

Phan Hoa Giang

Bron

![[Video] Hue Monumenten heropenen om bezoekers te verwelkomen](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/05/1762301089171_dung01-05-43-09still013-jpg.webp)

Reactie (0)